相关工作

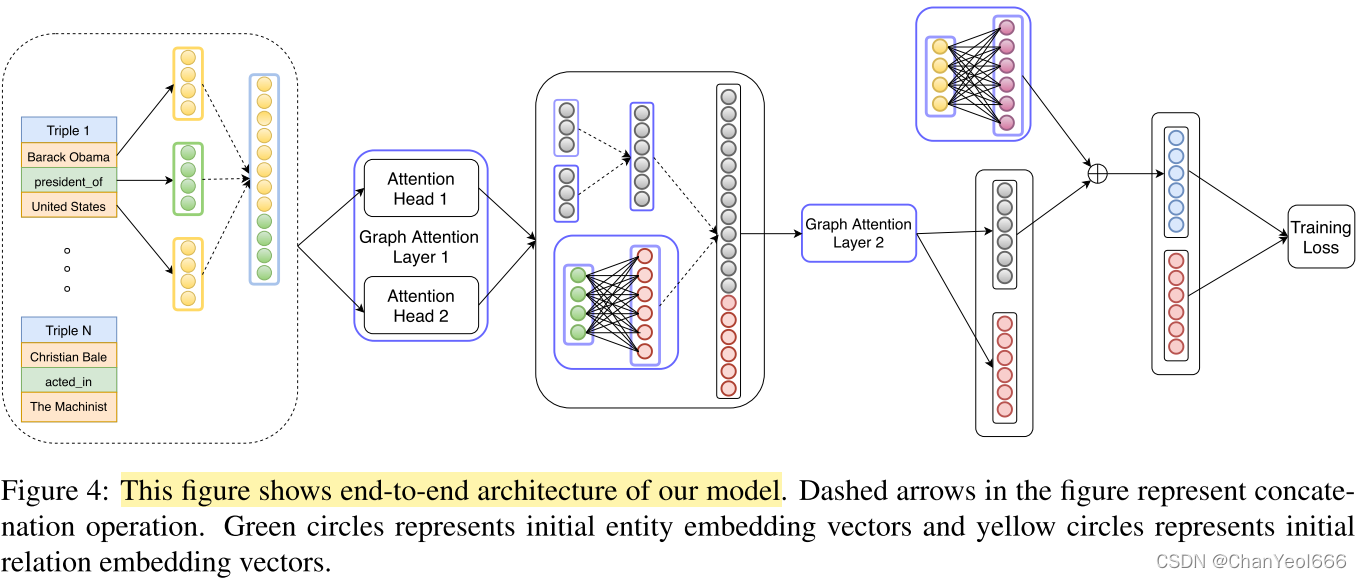

现有的方法通过仅关注实体特征或以不相交的方式考虑实体和关系的特征学习KG嵌入,相反,我们提出的图注意力模型从整体上捕获了KG中任何给定实体的n跳领域中的多跳和语义相似的关系。

我们的方法

1.GAT

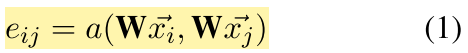

单个GAT层为:

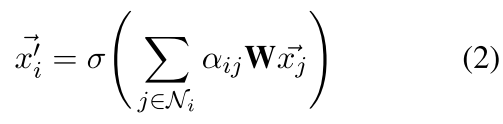

输出层:

相对注意力aij是使用softmax函数计算领域中所有值的。

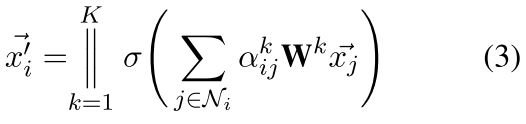

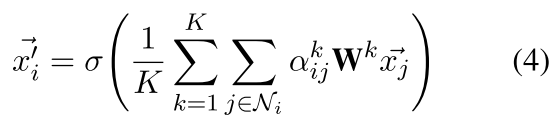

连接K个注意力头的多头注意力过程如下:

最后一层的输出嵌入是使用平均而不是连接操作来计算的,以实现多头注意力:

2.关系很重要

提出了一个新的嵌入方法,将关系和相邻节点特征结合到注意机制中。

定义了一个注意力层,是我们模型的构建块,与GAT类似,我们的框架与注意力机制的特定选择无关。

通过对对应于特定三元组

的实体和关系特征向量的串联执行线性变换来学习这些嵌入。

的实体和关系特征向量的串联执行线性变换来学习这些嵌入。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?