本系列博客包括6个专栏,分别为:《自动驾驶技术概览》、《自动驾驶汽车平台技术基础》、《自动驾驶汽车定位技术》、《自动驾驶汽车环境感知》、《自动驾驶汽车决策与控制》、《自动驾驶系统设计及应用》,笔者不是自动驾驶领域的专家,只是一个在探索自动驾驶路上的小白,此系列丛书尚未阅读完,也是边阅读边总结边思考,欢迎各位小伙伴,各位大牛们在评论区给出建议,帮笔者这个小白挑出错误,谢谢!

此专栏是关于《自动驾驶技术概览》书籍的笔记。

1.自动驾驶汽车硬件平台

自动驾驶硬件平台直接决定了系统的感知能力、运算能力、功耗强度、可靠性等;自动驾驶硬件平台分为传感器平台、计算平台、线控车辆平台3部分;

1.1 传感器平台

自动驾驶常用车载传感器包括:雷达、车载摄像头、定位定姿传感器等;

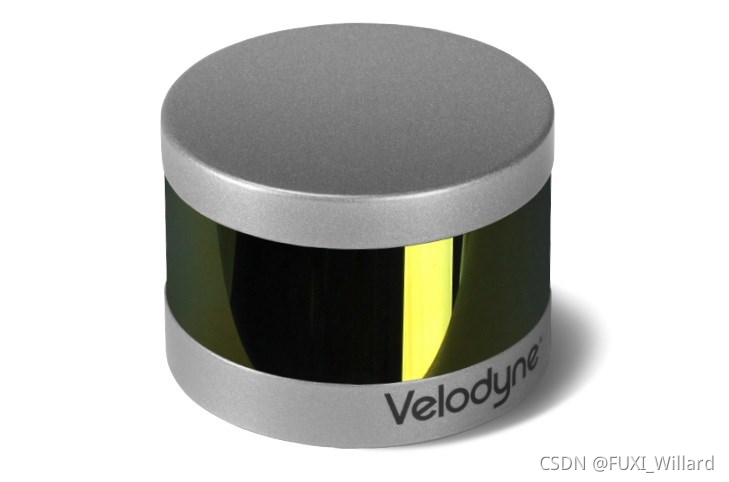

1.1.1 激光雷达

- 激光雷达(LiDAR)具有较高的距离、角度、速度分辨率,抗干扰能力强,点云信息丰富,不易受光照条件影响,可用于全天工作,激光雷达多用于三维环境建模和同步定位与建图;

- 激光雷达分为:单线雷达和多线雷达;

- 单线雷达:获取二维数据,但无法获得高度信息;

- 多线雷达:可以获取三维数据,精度高于单线雷达;

- 主流的多线雷达:4线、8线、16线、32线、64线;

1.1.2 毫米波雷达

毫米波雷达的探测距离远,测速、测距精度高,可全天候工作,成本较低;毫米波雷达常用于驾驶辅助功能,如:自适应巡航控制、前方碰撞预警、紧急辅助制动等;

1.1.3 车载摄像头

- 车载摄像头分类:单目和双目摄像头;

- 单目摄像头:主要基于机器学习,对图像数据进行训练和学习,用于环境感知;

- 双目摄像头:基于视差原理测量驾驶环境,测距精度较高;

- 摄像头应用。

- 前置摄像头:一般安装在前挡风玻璃上方,感知行车前方环境、检测目标;

- 后摄像头;一般布置在车尾;

- 环视摄像头:一般安装在车辆前、后、左、右侧,实现360°环境感知;

1.1.4 GNSS系统

- GNSS信号容易受到楼宇、树荫等影响,导致定位漂移;

- GNSS更新频率低(10Hz),在车辆快速行驶时难以给出精准的实时定位;

- 惯性传感器(IMU)可以在短时间内提供稳定的位置更新,但是定位误差会随时间累积;

- GNSS通常辅助以惯性传感器用来增强定位的精度;这两种传感器通过卡尔曼滤波技术实现实时融合,可以实现导航设备的优势互补,提高定位精度和适用范围;

1.2 计算平台

自动驾驶系统各模块实时运行过程中,产生大量的数据;需要选择性能强劲的计算平台完成实时大规模数据处理任务,计算平台的性能对自动驾驶的安全性、可靠性、实时性很重要;目前主流的计算平台包括:基于GPU、DSP、FPGA、ASIC等方案的计算平台。

- 基于GPU的自动驾驶计算平台。

英伟达公司(NVIDIA)的PX平台是基于GPU的自动驾驶计算平台,支持多路摄像头、激光雷达、超声波雷达、定位等感知设备输入;Drive PX Pegasus基于英伟达的CUDA GPU,内置4个AI处理器,其中:两个为Xavier SoC芯片,两个为独立GPU,用于强化深度学习和计算机视觉;

- 基于DSP的自动驾驶计算平台

德州仪器公司的TDA2x SoC是基于DSP的自动驾驶计算平台;该计算平台有两个浮点DSP内核C66x和4个专为视觉处理设计的完全可编程的视觉加速器,可实现各摄像头应用同步运行,用于车道保持、自适应巡航、目标检测等驾驶功能;同时,该计算平台可用于摄像头、雷达等感知传感器的数据融合处理; - 基于FPGA的自动驾驶计算平台

Altera公司的Cyclone V Soc是基于FPGA的自动驾驶计算平台,集成了基于ARM处理器的硬件处理器系统,具有有效的逻辑综合功能;该方案可为传感器融合提供优化,可结合分析来自多个传感器的数据以完成高度可靠的物体检测; - 基于ASIC的自动驾驶计算平台

Mobileye公司的Mobileye EyeQ5是基于ASIC的自动驾驶视觉芯片,Mobileye EyeQ5芯片装备了8枚多线程CPU内核,同时搭载了18枚Mobileye的视觉处理器;EyeQ5 SOC装备有4种异构的全编程加速器,对计算机视觉、信号处理和机器学习等算法进行了优化;

1.3 线控车辆平台

线控车辆平台包括:车辆线控和通信总线;

- 线控技术的主要特征:执行机构与操纵机构没有直接的机械连接,驾驶意图将转换成对应的电信号驱动执行机构精确运动;

- 基于线控技术,自动驾驶控制器可以通过通信总线发送响应驾驶动作指令,完成机械控制;

- 通信总线如:CAN、USB3.0、LIN等,用于实现数据和指令的有效传递;

本文介绍了自动驾驶汽车的硬件平台,包括传感器平台、计算平台和线控车辆平台。传感器部分详述了激光雷达、毫米波雷达、车载摄像头和GNSS系统的特点与应用。计算平台方面,提到了基于GPU、DSP、FPGA和ASIC的解决方案。线控车辆平台则涉及车辆的线控技术和通信总线。内容适合对自动驾驶感兴趣的初学者,探讨了技术基础和关键组件的作用。

本文介绍了自动驾驶汽车的硬件平台,包括传感器平台、计算平台和线控车辆平台。传感器部分详述了激光雷达、毫米波雷达、车载摄像头和GNSS系统的特点与应用。计算平台方面,提到了基于GPU、DSP、FPGA和ASIC的解决方案。线控车辆平台则涉及车辆的线控技术和通信总线。内容适合对自动驾驶感兴趣的初学者,探讨了技术基础和关键组件的作用。

1995

1995

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?