Shallow-UWnet:水下图像增强新网络,该体系结构可保持性能,并具有比最新模型更少的参数,表现SOTA!由于Deep SESR、WaterNet等,发表于人工智能顶级会议AAAI(CCF推荐A类会议),作者单位:马萨诸塞大学阿默斯特分校。

下载地址:https://arxiv.org/abs/2101.02073

Shallow-UWnet: Compressed models for underwater image enhancement

Abstract(摘要)

在过去的数十年里,由于水下图像增强对于水下机器人和海洋工程的重要意义,吸引了越来越多的研究工作。研究工作从实现基于物理的解决方案到使用非常深的CNNs和GANs展开。但是,这些算法状态在计算上很昂贵且需要大量内存。因此很难将这些算法部署在便携式设备上,并用于水下勘探任务。这些模型在合成的或有限的现实世界数据集上进行训练,从而在现实世界中实现了极少的实用性。本文中,我们提出了浅层的神经网络体系结构:Shallow-UWnet,与最新的模型相比,该模型可保持性能并减少参数。我们还通过基准综合和真实数据集的性能来证明模型的一般化。本文所用的数据和代码详见:https://github.com/mkartik/Shallow-UWnet

Introduction(引言)

水下机器人代表着一个快速增长的研究领域。最近,在开发无人水下航行器(AUV)方面正在做出巨大努力,以应对工程问题水下监视、海底测绘、水下考古勘探、垃圾收集、水下作业和军事作业方面的挑战。这些应用中的许多应用都需要对AUV进行图像/视频的实时解释,以便智能地感知环境并采取后续措施。

固有地,水下图像由于波长依赖性吸收以及由于水中粒子的向前和向后散射而降低。这些降级的图像具有较高的可见性,降低的对比度,颜色偏差以及甚至导致色偏,这限制了它们在水下视觉下的下游任务(如跟踪,分类和检测)的适用性。另外,水下图像主要呈现绿色或蓝色,这是由于红色的波长趋向于被深水吸收。为了解决上述问题,在进行水下图像解释任务之前,首先要进行图像改进,其中包括图像增强,图像修复和辅助任务特定方法。我们专注于图像增强任务,该任务通过实时恢复图像的感知和统计质量来帮助缓解问题。

水下图像增强方法可以提取图像信息,而无需任何有关环境的知识,因此它们比图像恢复方法具有更广泛的含义。现有的基于非常深的卷积神经网络(CNN)和基于生成对抗网络(GAN)的模型集中了诸如噪声去除,对比度增强,多信息组合和深度学习以消除图像模糊等方面的关注。但是,较高的计算量和内存需求使大型模型变得难以处理,从而使它们无法实时执行水下图像增强任务。因此,为了通过减少计算和内存需求来提高机器学习模型的可应用性,同时保持与最新模型状态相当的性能,我们提出了Shallow-UWnet。

Background(背景)

在过去的几年中,人们提出了各种图像增强方法,可以将图像归纳为以下三种类型:非物理模型,基于物理模型的方法和深度学习方法。

非物理模型通过调整图像像素值而不是数学方程式来改善,而物理模型通过估算模型的参数来计算图像的退化过程。但是,两者都不足以增强水下图像,因为它们忽略了特定的水下属性。

深度学习方法往往会更好,因为它们只专注于色彩校正。这些主要围绕生成对抗网络,卷积神经网络。我们详细审查了基于GAN的当前最新模式和基于CNN的模型。

FUnIE-GAN 它通过系统阐述图像到图像的转换问题来使图像变清晰,假设歪曲的图像和增强的图像之间存在非线性映射。而且,在大规模数据集上通过对抗训练,使用基于GAN模型学习这种映射。但是,它对模型的错误建模,会放大背景中的噪声点,并且导致过饱和和欠饱和的图像。

Water-Net 它是一种门控融合(gated fusion)的卷积神经网络,在UIEB数据集上进行水下图像增强。为了适应退化的水下图像的特性,Water-Net模型通过三种方法增强输入图像,分别是白平衡(WB)、伽马矫正(GC)和直方图均衡(HE)。但是这是一个复杂的CNN结构,受到反向散射的影响。

UResnet 这是一个基于CNN的残差网络结构,是一种用于水下图像增强的更广泛的监督学习方法。

Underwater Datasets(水下数据集)

我们探索了范围广泛的水下图像数据集,这些数据集从综合的角度看待到真实世界的水下图像。我们根据参考的最新模型,对其中的三个模型进行了详细介绍。

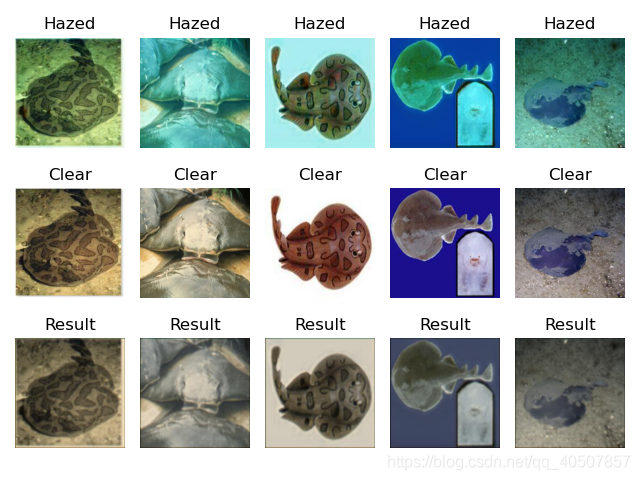

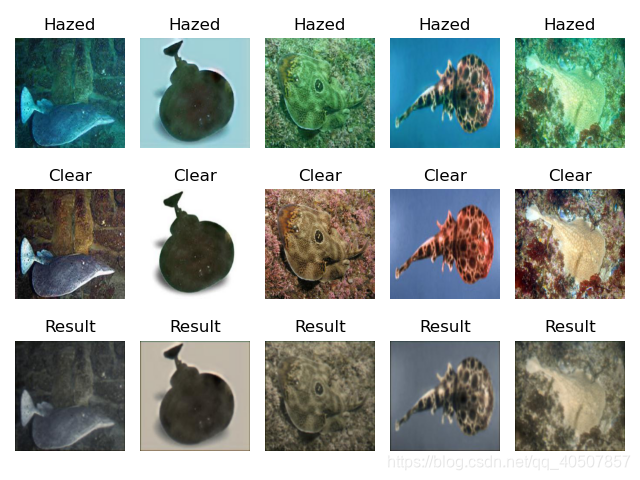

EUVP Dataset EUVP数据集(Enhancement of Underwater Visual Perception,增强水下视觉感知)是一个具有10K个配对图像和25K个未配对图像,包括较差和较好感知质量图像的大型集合,这些图像是在海洋勘探时不同能见度条件下被作者捕获的。配对的图像通过使用基于CycleGAN的水下图像失真模型对真实世界的图像进行处理而生成的。我们使用ImageNet的配对图像,一部分EUVP数据集用于我们的模型的训练和验证,剩余的EUVP-Dark数据集是高度不清晰的图像,用于我们的模型的测试。

UIEB Dataset UIEB数据集(Underwater Image Enhancement Benchmark,水下图像增强基准)包含890张真实的水下图像,这些图像是在不同光照条件下捕获的,并且具有多种颜色范围和对比度。作者提供了无色差(相对纯正的彩色)的相应参考图像,并且与源图像相比,它们具有更好的可见性和亮度。我们在此数据集上测试我们的模型,因为该数据集在不使用合成技术的情况下,使用真实世界的水下图像和参考图像。

UFO-120 Dataset UFO-120数据集包含1620张配对的水下图像, 这些图像在不同水环境的海洋勘探过程中收集得到。作者采用了风格转移技术,以生成各自的失真图像。该数据集可以对两种水下图像增强效果以及水下图像超分辨率模型进行评估。我们在UFO-120数据集上的测试集中的120张有标签的配对图像,对模型进行了测试。

Evaluation Metrics(评价指标)

我们使用标准指标对模型输出图像进行定量评估,包括PSNR(Peak Signal-to-Noise Ratio,峰值信噪比)和SSIM(Structural Similarity Index Measure,结构相似性指标测度)。SSIM和PSNR分别使用参考图像来量化增强输出图像的结构相似性和重构质量。我们还使用非参考水下图像质量度量(UIQM)分析了生成的输出图像的质量。UIQM包含三个水下图像属性度量:图像色彩度(UICM),清晰度(UISM)和对比度(UIConM),其中每个属性评估水下图像退化的一个方面。UIQM度量方法如下所示。

U I Q M = c 1 × U I C M + c 2 × U I S M + c 3 × U I C o n M UIQM=c_1 \times UICM+c_2 \times UISM+c_3\times UIConM UIQM=c1×UICM+c2×UISM+c

Shallow-UWnet是一种新的水下图像增强网络,它在减少参数数量的同时保持高性能。该模型适用于水下图像增强,解决了现有深度学习模型计算成本高和内存需求大的问题,便于在便携设备上实时应用。在多个水下数据集上的实验表明,Shallow-UWnet具有良好的泛化能力和与最新模型相当的性能。

Shallow-UWnet是一种新的水下图像增强网络,它在减少参数数量的同时保持高性能。该模型适用于水下图像增强,解决了现有深度学习模型计算成本高和内存需求大的问题,便于在便携设备上实时应用。在多个水下数据集上的实验表明,Shallow-UWnet具有良好的泛化能力和与最新模型相当的性能。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1956

1956

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?