双目视觉技术是一种基于人类双目视觉原理的图像处理技术。人类的双眼能够根据两个不同的视角获取到的图像信息进行深度感知,从而实现对物体形状和距离的认知。双目视觉技术通过模拟人类的双眼视觉系统,使用两个摄像头(或相机)分别捕获不同视角的图像,并通过计算两个图像之间的差异,来获取物体的深度信息。【文章图片均引用于百度百科】

双目视觉技术的原理

-

视差原理:视差是指当两个目标点在不同视角下的位置差异。在双目视觉系统中,通过比较两个图像对应像素点的位置差异,可以计算出物体的视差。视差越大,表示物体离摄像头越近;视差越小,表示物体离摄像头越远。

-

三角测量原理:基于视差原理,可以通过三角测量原理计算出物体的距离。在双目视觉系统中,首先需要进行标定,确定两个摄像头之间的几何关系和参数;然后通过计算视差和基线长度,使用三角测量原理计算出物体的距离。

-

深度图像生成:双目视觉技术可以生成深度图像,即像素点对应的深度信息。深度图像可以用于目标检测、跟踪、三维重建等应用。

-

视觉融合:通过将两个摄像头捕获到的图像进行融合,可以提高图像的清晰度和稳定性。视觉融合可以通过图像配准、图像拼接等方法实现。

应用

双目视觉技术利用人类双眼的视觉原理,通过比较两个视角下的图像信息来获取物体的深度信息,并通过计算和图像处理技术实现三维重建和距离测量等应用。目前应用领域有有以下几点。

- 自动驾驶汽车:双目视觉技术可以帮助汽车通过分析路面和周围环境的深度信息,实现准确的障碍物检测和距离测量,从而提高自动驾驶汽车的安全性和驾驶效果。

双目视觉技术在自动驾驶汽车中的应用是利用两个摄像头模拟人眼的立体视觉,通过对两个图像之间的差异进行分析,实现车辆的距离测量、障碍物检测、道路识别等功能。以OpenCV为例,以下是一个简单的双目视觉代码实现示例:

import cv2

import numpy as np

# 初始化摄像头

left_camera = cv2.VideoCapture(0)

right_camera = cv2.VideoCapture(1)

while True:

# 读取左右相机图像

ret1, frame1 = left_camera.read()

ret2, frame2 = right_camera.read()

# 立体校正

R1, R2, P1, P2, Q, roi1, roi2 = cv2.stereoRectify(cameraMatrix1, distCoeffs1, cameraMatrix2, distCoeffs2, imageSize, R, T)

# 计算视差图

stereo = cv2.StereoSGBM_create()

disparity = stereo.compute(frame1, frame2)

# 物体距离测量

f = cameraMatrix1[0][0] # 焦距

B = baseline # 基线长度

depth = f * B / disparity

# 显示视差图和物体距离

cv2.imshow('Disparity Map', disparity)

cv2.imshow('Depth Map', depth)

# 按下q键退出循环

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放摄像头

left_camera.release()

right_camera.release()

# 关闭窗口

cv2.destroyAllWindows()

注意: 以上代码只是一个简单示例,实际应用中需要根据具体情况进行参数调整和算法优化。同时,以上代码中缺少了一些关键的参数和函数,需要根据实际情况进行补充和修改。双目视觉技术在自动驾驶汽车中的应用是利用两个摄像头模拟人眼的立体视觉,通过对两个图像之间的差异进行分析,实现车辆的距离测量、障碍物检测、道路识别等功能。

- 人脸识别技术:双目视觉技术可以通过分析眼睛之间的距离和眼睛的位置来识别人脸,并获得更准确的人脸识别结果。这种技术在安全领域和人机交互领域有广泛的应用,如人脸解锁、人脸支付等。

双目视觉技术在人脸解锁方面的应用主要是通过使用两个摄像头同时获取人脸图像,并对两个图像进行比对来确保人脸解锁的准确性和安全性。以下是一个使用OpenCV库实现双目视觉人脸解锁的简单示例代码:

import cv2

import numpy as np

# 初始化两个摄像头

cap1 = cv2.VideoCapture(0)

cap2 = cv2.VideoCapture(1)

# 加载人脸识别模型

face_cascade = cv2.CascadeClassifier('haarcascade_frontalface_default.xml')

while True:

# 从两个摄像头获取图像

ret1, frame1 = cap1.read()

ret2, frame2 = cap2.read()

# 在图像中检测人脸

gray1 = cv2.cvtColor(frame1, cv2.COLOR_BGR2GRAY)

gray2 = cv2.cvtColor(frame2, cv2.COLOR_BGR2GRAY)

faces1 = face_cascade.detectMultiScale(gray1, 1.3, 5)

faces2 = face_cascade.detectMultiScale(gray2, 1.3, 5)

# 检查是否检测到了人脸

if len(faces1) == 1 and len(faces2) == 1:

(x1, y1, w1, h1) = faces1[0]

(x2, y2, w2, h2) = faces2[0]

# 提取人脸区域

face1 = gray1[y1:y1+h1, x1:x1+w1]

face2 = gray2[y2:y2+h2, x2:x2+w2]

# 对人脸进行比对

similarity = cv2.compareHist(face1, face2, cv2.HISTCMP_CORREL)

# 如果相似度大于阈值,认为是同一个人脸

if similarity > 0.9:

print("人脸解锁成功!")

# 显示图像

cv2.imshow('left', frame1)

cv2.imshow('right', frame2)

# 按下ESC键退出程序

if cv2.waitKey(1) == 27:

break

# 释放摄像头和关闭窗口

cap1.release()

cap2.release()

cv2.destroyAllWindows()

注意 上述代码是一个简单示例,使用了两个摄像头同时进行人脸检测和比对。实际应用中,可能需要进行更复杂的算法优化和安全性措施。双目视觉技术在人脸解锁方面的应用主要是通过使用两个摄像头同时获取人脸图像,并对两个图像进行比对来确保人脸解锁的准确性和安全性。

-

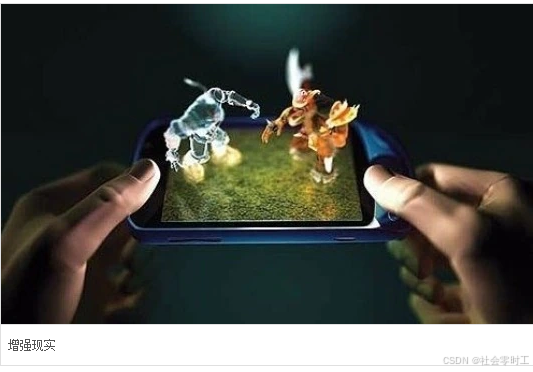

增强现实技术:双目视觉技术可以实时追踪用户的眼睛和头部的运动,根据用户的视线和头部姿势来调整虚拟物体的位置和视角,从而实现更真实和沉浸的增强现实体验。双目视觉技术在增强现实方面的应用主要是用于实现深度感知和立体观察。通过双目摄像头获取场景的双目图像,然后利用双目视差来计算物体的距离和深度信息,从而实现对物体的立体感知。基于双目视觉技术,可以实现以下增强现实应用:

1)虚实融合:通过双目摄像头获取实际场景的图像,然后在其中添加虚拟物体,并根据计算得到的深度信息将虚拟物体进行精确位置的投射,从而实现虚实融合的增强现实效果。

2)物体识别和跟踪:利用双目视觉技术获取场景的双目图像,并通过图像处理算法进行特征提取和物体识别,从而实现对场景中物体的识别和跟踪。可以将识别结果和跟踪信息叠加在实际场景中,实现增强现实的物体识别和跟踪功能。

3)手势识别和交互:通过双目视觉技术获取用户的手部图像,然后利用图像处理和机器学习算法进行手势识别,从而实现对用户手势的识别和交互。可以将识别的手势与虚拟场景进行交互,实现增强现实的手势控制功能。

下面是一个基于OpenCV库的双目视觉代码示例,实现了立体匹配和深度图生成的功能:

import cv2

# 打开双目摄像头

left_camera = cv2.VideoCapture(0)

right_camera = cv2.VideoCapture(1)

# 设置摄像头参数

left_camera.set(cv2.CAP_PROP_FRAME_WIDTH, 640)

left_camera.set(cv2.CAP_PROP_FRAME_HEIGHT, 480)

right_camera.set(cv2.CAP_PROP_FRAME_WIDTH, 640)

right_camera.set(cv2.CAP_PROP_FRAME_HEIGHT, 480)

# 创建双目图像匹配器

stereo_matcher = cv2.StereoBM_create(numDisparities=16, blockSize=15)

while True:

# 读取左右目图像

_, left_image = left_camera.read()

_, right_image = right_camera.read()

# 转换为灰度图像

left_gray = cv2.cvtColor(left_image, cv2.COLOR_BGR2GRAY)

right_gray = cv2.cvtColor(right_image, cv2.COLOR_BGR2GRAY)

# 匹配左右图像,计算视差图

disparity = stereo_matcher.compute(left_gray, right_gray)

# 归一化视差图

normalized_disparity = cv2.normalize(disparity, None, alpha=0, beta=255, norm_type=cv2.NORM_MINMAX, dtype=cv2.CV_8U)

# 显示视差图和左右目图像

cv2.imshow('Disparity', normalized_disparity)

cv2.imshow('Left Image', left_image)

cv2.imshow('Right Image', right_image)

# 按下 'q' 键退出

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放摄像头并关闭窗口

left_camera.release()

right_camera.release()

cv2.destroyAllWindows()

以上代码使用OpenCV的StereoBM_create函数创建了一个双目图像匹配器,然后从双目摄像头中获取左右目图像,转换为灰度图像,然后调用compute函数计算视差图。最后将视差图、左右目图像显示在窗口中,按下 ‘q’ 键退出程序。

- 机器人导航和感知:双目视觉技术可以帮助机器人感知环境的深度信息,从而实现避障、路径规划和导航等任务。通过结合双目视觉和其他传感器,机器人可以更准确地理解周围环境并进行智能决策。在机器人导航中,双目视觉可以通过计算场景中物体的深度信息,实现障碍物检测与避障。双目视觉可以利用视差(Disparity)来计算物体与摄像头之间的距离。通过设定一定的阈值,可以将前方的障碍物与其他物体进行区分,并采取相应的避障策略。双目视觉可以提供更加准确的深度信息,相比于单目视觉,能够提供更好的导航性能。

在机器人感知中,双目视觉可以实现三维重建与建图。通过两个摄像头获取到场景的不同视角的图像,可以利用立体视觉算法恢复出场景中物体的三维结构。通过三维重建,可以实现对场景的精确感知,并将感知结果用于机器人的导航和决策。此外,双目视觉还可以利用三角测量原理,实现目标跟踪与定位。通过获取目标物体在不同图像中的位置关系,可以计算出目标物体在真实世界中的准确位置,从而实现精确的目标跟踪与定位。

代码实现上,双目视觉涉及到摄像头图像的获取、立体匹配算法、距离计算等。常见的双目视觉库有OpenCV和ROS中的Stereo Vision库。以下是一个使用OpenCV实现双目视觉的简单代码示例:

import cv2

# 创建左右摄像头对象

left_camera = cv2.VideoCapture(0)

right_camera = cv2.VideoCapture(1)

#计算深度和阈值分割

def compute_depth(disparity, min_disparity, max_disparity):

# 根据视差图计算深度图

depth_map = np.zeros_like(disparity, dtype=np.float32)

# 通过视差和相机参数计算深度

depth_map = 1000 / (disparity_map + 0.0001) # 这里使用了一个简单的线性关系,实际应根据相机参数进行计算

# 根据最小和最大视差范围进行阈值分割

thresholded_map = np.where((disparity >= min_disparity) & (disparity <= max_disparity), depth_map, 0)

return thresholded_map

while True:

# 读取左右摄像头图像

ret1, left_image = left_camera.read()

ret2, right_image = right_camera.read()

# 进行立体匹配,计算视差图

stereo = cv2.StereoBM_create(numDisparities=16, blockSize=15)

disparity = stereo.compute(left_image, right_image)

# 可以对视差图进行进一步处理,如阈值分割、深度计算等

# 设置最小和最大视差范围

min_disparity = 100

max_disparity = 200

# 计算深度图

depth_map = compute_depth(disparity, min_disparity, max_disparity)

# 显示图像

cv2.imshow('Left Image', left_image)

cv2.imshow('Right Image', right_image)

cv2.imshow('Disparity Map', disparity)

cv2.imshow('Depth Map', depth_map )

# 按下Esc键退出循环

if cv2.waitKey(1) == 27:

break

# 释放摄像头对象

left_camera.release()

right_camera.release()

# 关闭窗口

cv2.destroyAllWindows()

这是一个简单的双目视觉代码示例,实时获取左右摄像头的图像,并进行立体匹配,计算视差图。可以根据需求,进一步对视差图进行处理,如阈值分割、深度计算等。最后显示左右图像和视差图,并通过按下Esc键退出循环。

需要注意的是,双目视觉涉及到很多复杂的算法和参数调整,上述代码只是一个简单的示例,具体的实现需要根据具体的需求和环境进行调整。

- 抓取和操作物体:双目视觉技术可以帮助机器人感知物体的立体形状和距离,从而实现精准的抓取和操作。这种技术在工业自动化、物流和仓储等领域有广泛的应用。

这里代码的实现和上面比较类似,主要是通讯建立与机械手机器人合作完成实现物体的抓取和操作。

1709

1709

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?