摘要

最近,将知识图谱(KG)作为辅助信息增强推荐引起了相当大的关注。知识感知推荐(KGR)的技术趋势是开发基于图神经网络(GNN)的端到端模型。然而,它们也有一些问题:

1)稀疏交互导致的监督信号不足限制了基于监督学习的 GNN 模型;

2)稀疏交互(CF部分)和冗余KG事实(KG部分)的结合进一步导致信息利用不平衡;

3)GNN 范式聚合了本地邻居进行节点表示学习,但忽略了非本地 KG 事实,使得知识提取不足。

引言

• 稀疏监督信号。现有的基于 GNN 的方法依赖于观察到的用户项交互作为监督信号,在统一的异构图上执行图表示学习。然而,在实际场景中,用户-项目交互实际上非常稀疏,这使得它不足以实现令人满意的性能,甚至导致可怕的副作用,例如退化问题(即,将节点嵌入分布退化为窄锥,甚至导致生成的节点表示难以区分)。

• 不平衡的信息利用。当稀疏的user-item交互遇到冗余知识事实时,KGR中会出现不平衡的异构结构,从而导致信息利用不平衡问题。一个普遍认可的事实是,决定用户偏好的是 CF 信号,因为它们是由用户的历史交互组成的。然而,由于信息利用不平衡,嘈杂的 KG 信息在最终用户/项目建模中得到更多强调,这反而忽略了关键 CF 信号,并进一步导致次优表示学习。

• 知识提取不足。尽管存在冗余的 KG 事实,但由于 GNN 的局部聚合特性,因此之前基于 GNN 的模型提取的信息实际上还远远不够。基于 GNN 的方法通常通过在其本地 KG 结构(即项目本身的相邻区域)上聚合相邻实体来学习项目表示,这会忽略非本地 KG 事实(即相似项目的相邻区域),从而导致知识提取不足。然而,简单地聚合非本地 KG 事实可能会引入更多不相关的噪声,进一步导致模型性能下降。

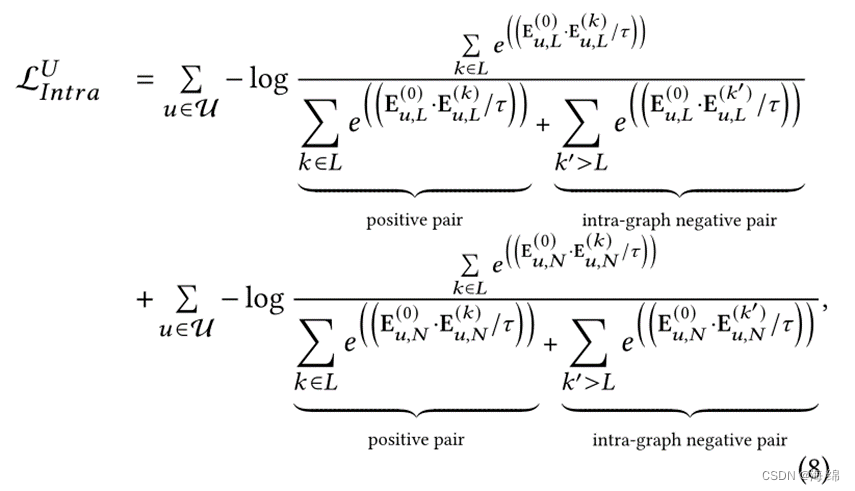

受最近在对比学习方面取得成功的启发,我们自然地建议利用 SSL 的优势来缓解稀疏监督信号的第一个问题。一个直截了当的想法是,我们可以将输入的用户-项目-实体图扩充(或破坏)为图视图,并将其中的节点与原始节点进行对比。然而,这种范式以相对独立的方式进行对比学习,仅对比不同图视图的相同部分(CF或KG部分),因此忽略了图中不同部分的内部交互。即 CF 和 KG 表示学习的改进是相互隔离的,CF 部分在最终用户/物品建模中的影响仍然有限。

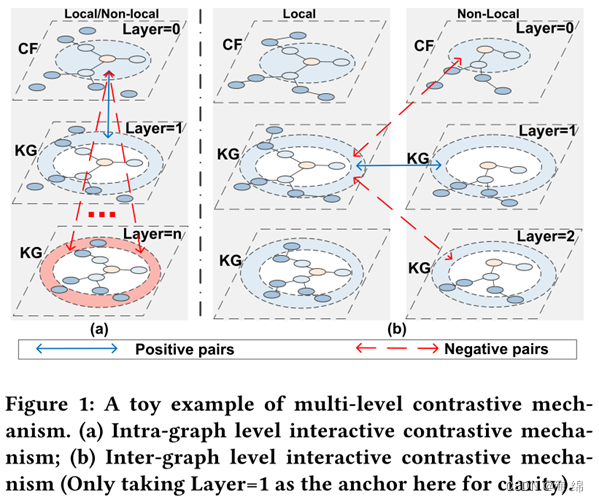

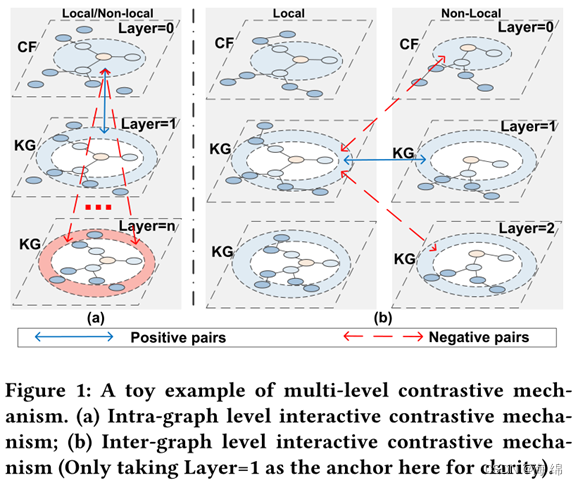

因此,在传统的对比机制下,上述第二和第三个问题仍远未解决或缓解。因此,有必要考虑一种在 CF 和 KG 部分之间进行有效信息交互的能力的对比学习范式,以便在不依赖额外显式标签的情况下连贯地利用每个部分的信息。这促使我们设计了一种为 KGR 任务量身定制的交互式图对比机制,需要总结以下几个方面以解决上述限制:1)如图1(a)所示,对比 CF 和 KG 部分以平衡它们对表示学习的影响; 2)如图1(b)所示,对比KG中的本地和非本地图以提取信息丰富的非本地KG事实。

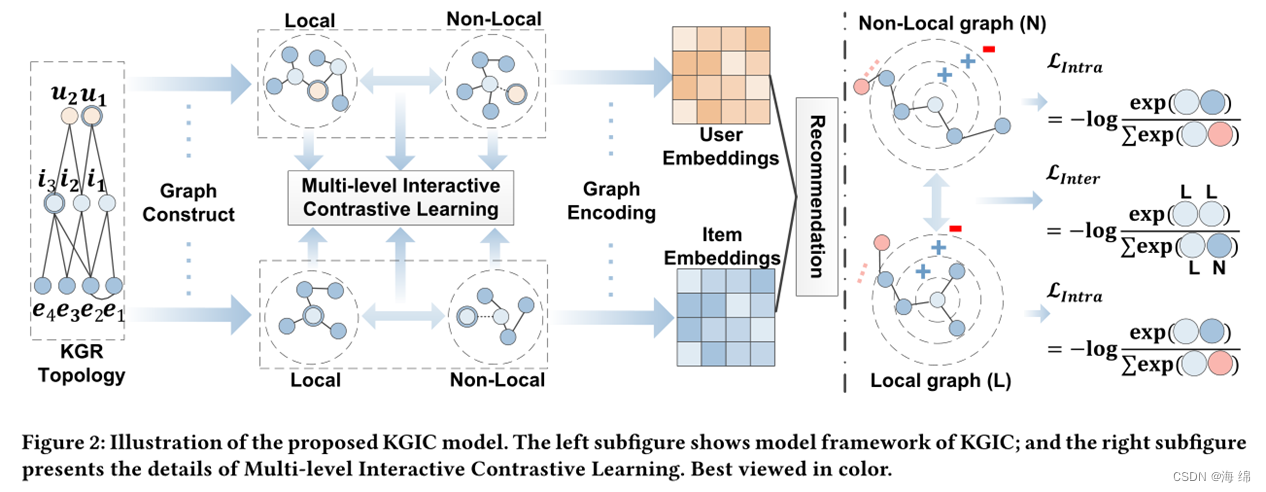

具体说,我们开发了一种新颖的模型,即具有多级交互式对比学习 (KGIC) 的知识感知推荐系统,以解决上述限制和挑战。KGIC 专注于探索适合 KGR 的图内对比学习机制,旨在以自监督的方式统一两个关键但相对独立的部分(即 CF 和 KG)。特别是,我们首先在图内进行交互式图对比学习,将 CF 信号与用户/项目的每个本地/非本地图中的 KG 信息进行对比,旨在增加 CF 和 KG 部分之间的信息一致性.然后进行图间级交互式图对比学习,将本地 KG 事实与非本地 KG 事实进行对比,以整合更多的 KG 信号并对非本地 KG 信息进行去噪。我们对这项工作的贡献可以总结如下:

• 我们强调了结合自监督学习来统一 CF 和 KG 信息以进行知识感知推荐的重要性,该推荐将层自判别作为自我监督任务提供辅助用于连贯图表示学习的信号。

• 我们提出了一种新颖的模型KGIC,它为知识感知推荐设计了一个多层次的交互式对比机制。 KGIC 将多阶 CF 与 KG 相结合,构建本地和非本地图,以充分探索外部知识。然后,KGIC 在本地和非本地图之间执行图内级别和图间级别的交互式对比学习,以在 CF 和 KG 中充分和连贯地利用信息。

• 我们对三个基准数据集进行了广泛的实验。结果证明了我们的 KGIC 在更好的表示学习方面的优势,这表明了我们的多级交互式对比学习对 KGR 的有效性。

方法

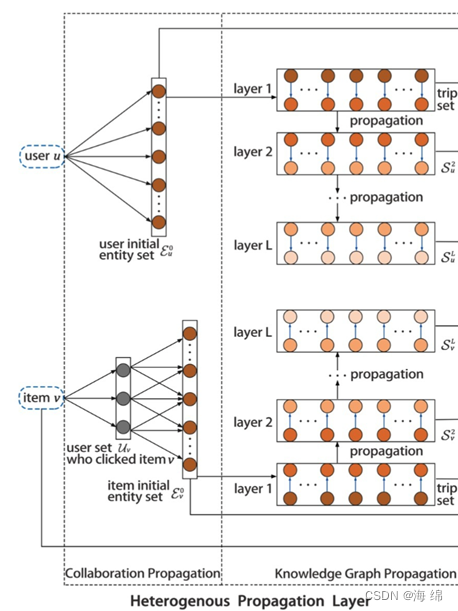

KGIC 旨在通过交互式对比机制统一 CF 和 KG 部分,以实现连贯的信息利用,从而改善用户/项目表示学习。图 2 展示了 KGIC 的工作流程,主要由三个关键部分组成:

Graph Constructing and Encoding

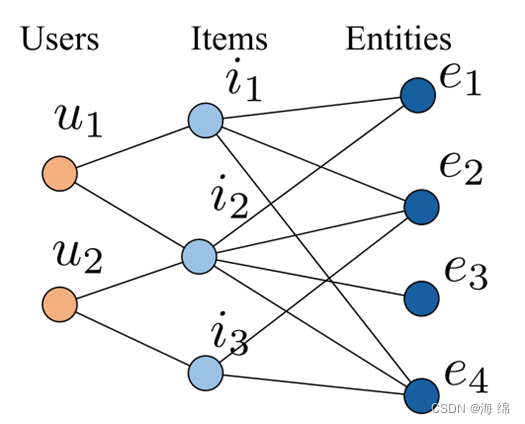

与以往仅将本地相邻区域的 KG 实体集成到用户/项目表示学习中的知识感知推荐方法不同,我们建议将可以从相似项目的相邻 KG 实体获取的非本地 KG 信息合并(即 CF 中的共现项),旨在充分探索 KG 中的外部事实。我们首先通过将相应的 CF 信号与 KG 相结合,为用户/项目构建本地图和非本地图(即本地和非本地子 KG)。然后在每个图中采用注意力嵌入机制进行层编码。

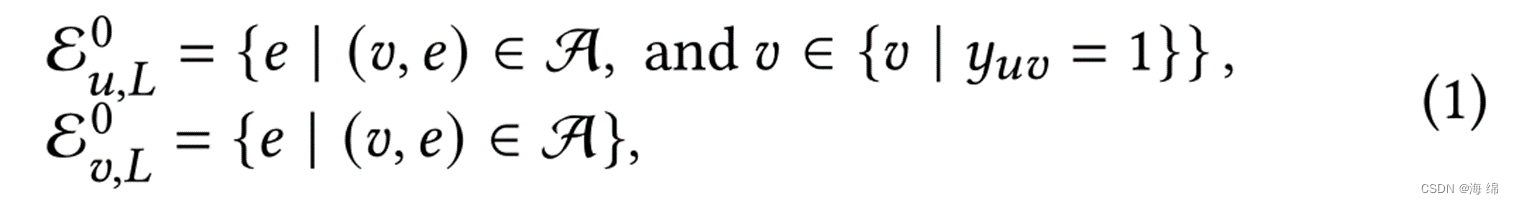

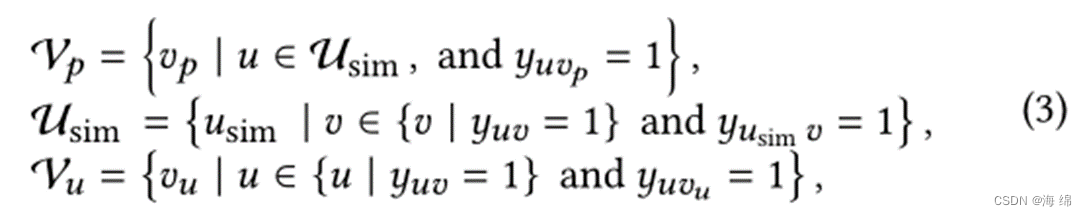

本地图构建。本地图由一阶 CF(即用户的交互项目或项目本身)和用户/项目的相关 KG 事实组成。首先,从用户-项目交互 Y 中提取用户/项目的一阶 CF 信号。然后通过item-entity对齐,将一阶CF信号的items与KG对齐 ![]() ,得到KG中的初始实体如下:

,得到KG中的初始实体如下:

![]()

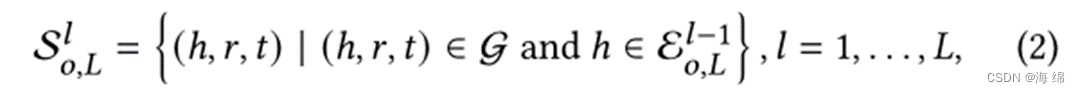

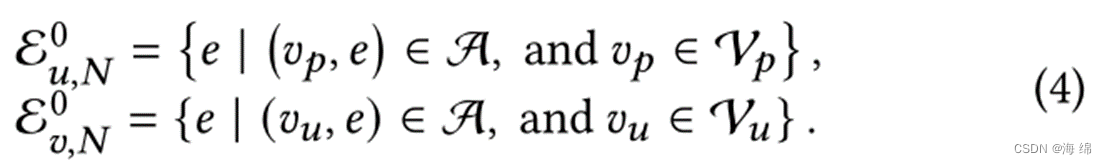

之后,通过 KG 中的自然传播(即沿 KG 中的链接传播)获得更多层的相关 KG 事实。通过这样做,构建了用户/项目的本地图。本地图中的三元组如下获得:

其中符号 o 是一个统一的占位符,表示 u 或 v, Su,𝐿l S_(u,L)^l 和 Sv,𝐿l S_(v,L)^l 表示本地图的第 l 层中用户和项目的三元组,由 (l −1) 层头实体、关系和 l 层尾实体组成。通过这种方式,我们得到了一个用户/项目的层本地图,它分别包含用户和项目的用户-项目-实体和项目异构结构。

非本地图构建。非本地图包含高阶 CF 信号(即 CF 中的 item-user-item 共现项目)和用户/项目的更多外部 KG 事实。类似地,非本地图是通过将 CF 的高阶项与 KG 和 KG 传播对齐来构建的。首先,通过在 user-item 交互中传播来获取 user/item 的高阶 item,如下所示:

其中VpV_p和 UsimU_"sim" 代表用户的高阶物品和相似用户, VuV_u是物品的高阶物品。

此外,KG 中对齐的初始,

获得如下:

然后通过在 KG 中传播这些初始实体,构建用户/项目的非本地图,其三元组形成如下

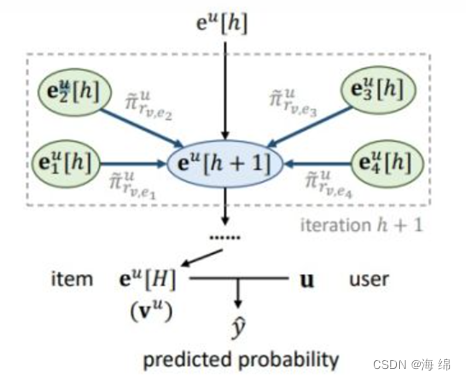

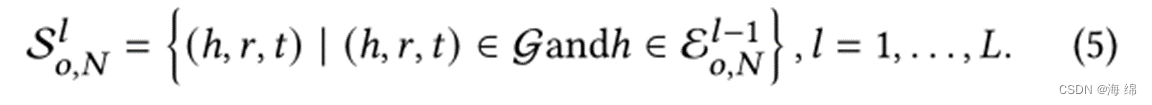

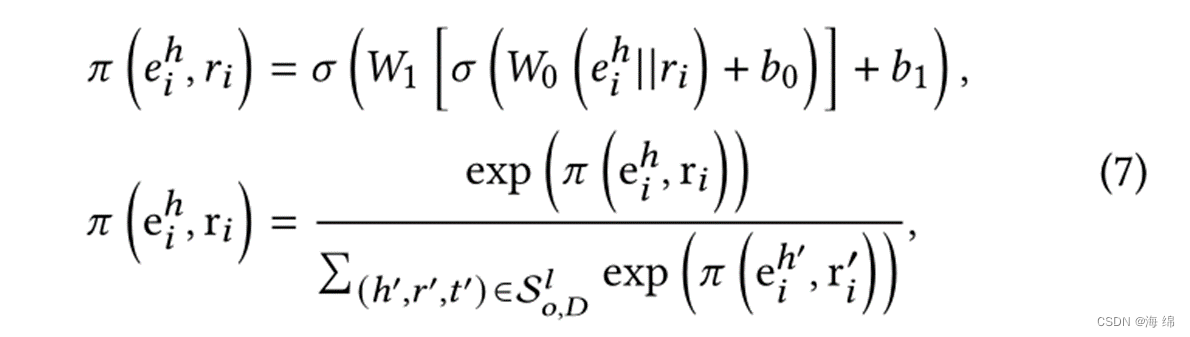

Graph Encoding

获取用户/项目的本地和非本地图,将每一层信息编码为嵌入以学习全面表示是必不可少的。受之前 知识感知 推荐工作的启发,这里采用了一种注意力嵌入机制,它揭示了不同上下文的尾部实体的不同含义,并产生不同的注意力权重。考虑 (ℎ, r, t) 第 l 层三元组的第 i个 三元组,我们可以得到第 l 层的表示如下:

其中符号 D 是一个统一的占位符,表示 L 或 N , 表示 l 层在本地/非本地图中嵌入 u 或 v。并且 m 是第 l 层的三元组数,

和

,

是第 i 个 三元组的头实体、关系和尾实体的嵌入。权重 𝜋(

,

)是通过注意力机制获得的,描述如下:

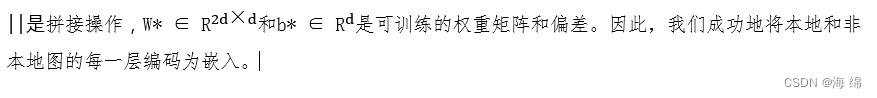

图内交互式对比学习

基于构建的用户/项目的本地和非本地图,我们继续鼓励在这些图中平衡信息利用。由本地和非本地图具有相对不平衡的异构结构,由稀疏的用户-项目交互和冗余的 KG 连接组成,因此关键的 CF 信号对表示学习的影响往往较小。因此,提出了图内交互式对比学习,通过对比学习执行 CF 和 KG 信息之间的交互,从而一致地使用 CF 和 KG。具体来说,图内交互式对比学习将 CF 部分(即等式(1)中的初始实体)作为锚点,位于本地/非本地图的中心层。用于学习用户/项目表示的聚合所涉及的知识信息形成正对,而其他 KG 实体(即图中未使用的较高层)形成负对。使用定义的正负对,我们对用户有以下对比损失:

通过这种方式,CF 和 KG 信号成功地相互监督,以进行更连贯和充分的表示学习。

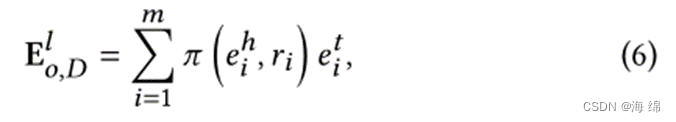

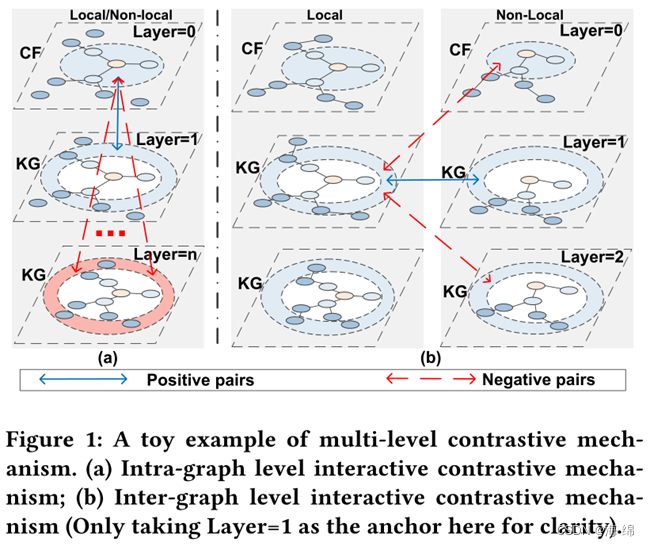

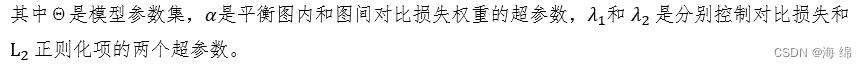

图间交互对比学习

虽然图内交互对比学习在每个单独的图中都实现了连贯的信息利用,但是将本地和非本地信息整合在一起仍然是一个挑战,因为非本地信息更加嘈杂。由于非局部图由高阶 CF 信号及其对应的 KG 事实组成,因此包含更多外部有用的外部事实以及噪声信息。因此,提出了图间交互式对比学习,通过将非本地图与更清晰的本地图进行对比并相互协同监督来提取信息性非局部信息。

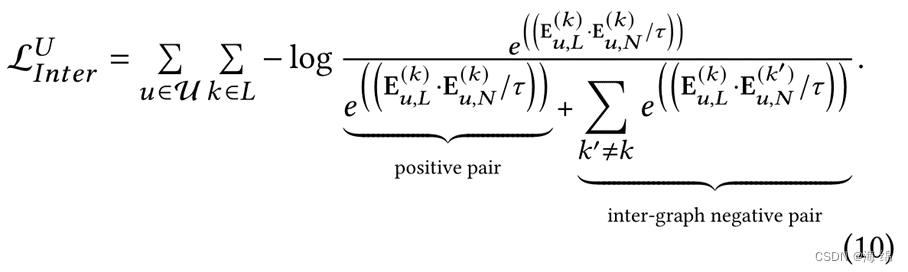

更具体地说,图间交互式对比学习将本地图的任意层作为锚点,非本地图中的同一层形成正对,非本地图中的其他层自然是视为负对。类似于图内交互式对比机制,我们对用户有以下对比损失:

![]()

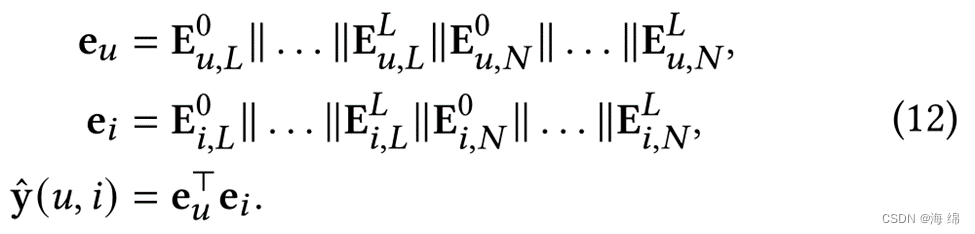

模型预测

在更新了所有层的嵌入之后,我们获得了用户本地和非本地图、项目本地和非本地图的每一层的嵌入。每个层的嵌入都表达了用户/项目表示的一部分,并强调了不同层和组件的影响。通过拼接每一层的这些表示向量,得出最终的用户/项目嵌入,用于通过内积预测它们的匹配分数,如下所示:

多任务训练

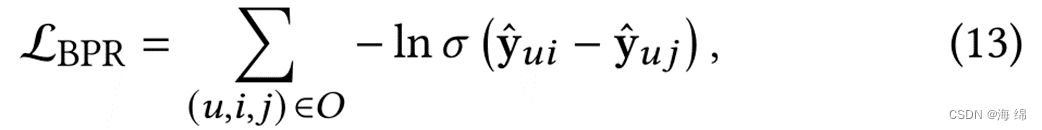

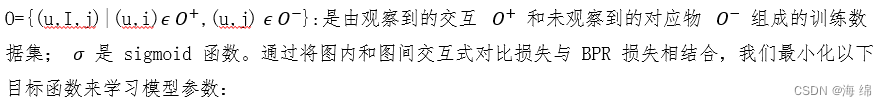

为了将推荐任务与自我监督任务相结合,我们将提出的两个对比学习损失作为补充。因此,利用多任务学习策略来联合训练 KG 感知推荐损失和提议的对比损失。对于 KG-aware 推荐任务,采用成对 BPR 损失来重建历史数据,鼓励用户历史项目的预测分数高于未观察项目。

![]()

实验

在三个公共数据集上进行了广泛的实验,以回答以下研究问题:

• RQ1:与最先进的模型相比,KGIC 的表现如何?

• RQ2:主要组成部分(例如,图内和图间交互式对比学习)如何影响 KGIC 的表现?

• RQ3:不同的超参数设置(例如,模型深度、对比系数)如何影响 KGIC?

• RQ4:自监督任务真的提高了表征学习的质量吗?

实验设置

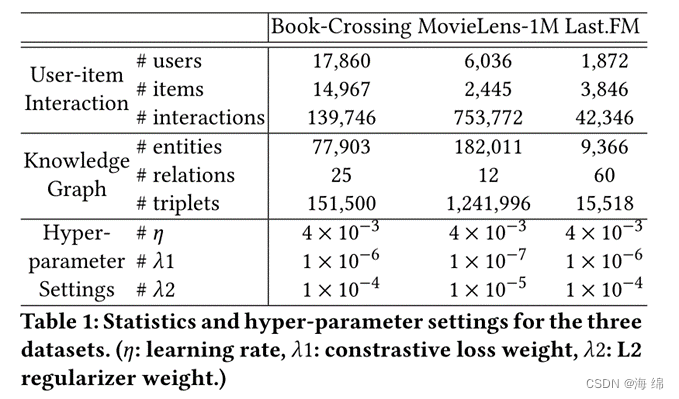

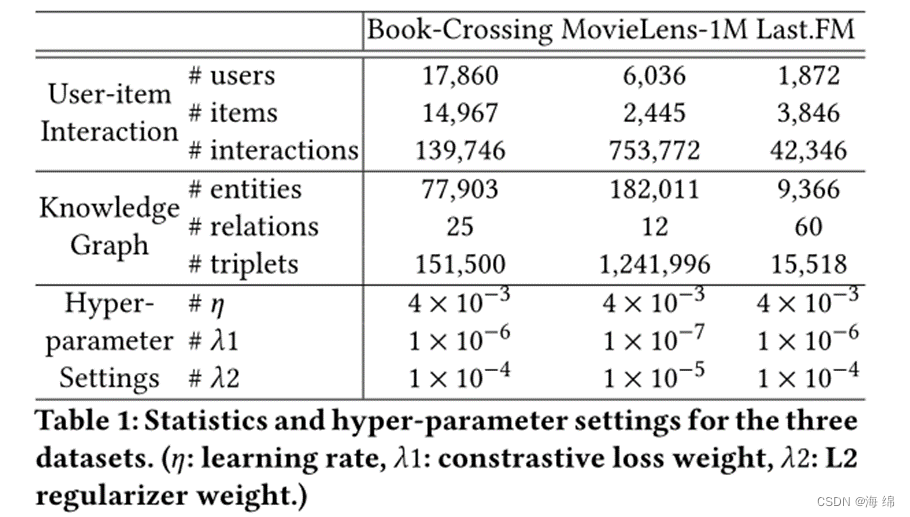

数据集描述。三个公开可用的数据集用于评估 KGIC 的有效性:Book-Crossing、MovieLens1M 和 Last.FM,它们的大小和稀疏性各不相同,使我们的实验更有说服力。三个数据集的基本统计数据如表 1 所示。

• Book-Crossing1:它包括来自图书交叉社区的各种书籍的清晰评分(范围从 0 到 10)。

• MovieLens-1M2:它包含大约 100 万个电影推荐的明确评级(范围从 1 到 5)。

• Last.FM3:收集自Last.FM 在线音乐系统,包含大约2000 名用户的收听历史。

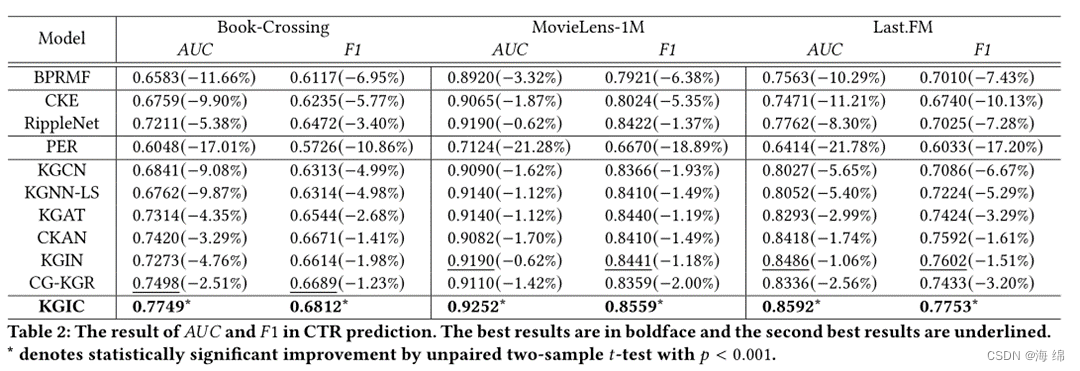

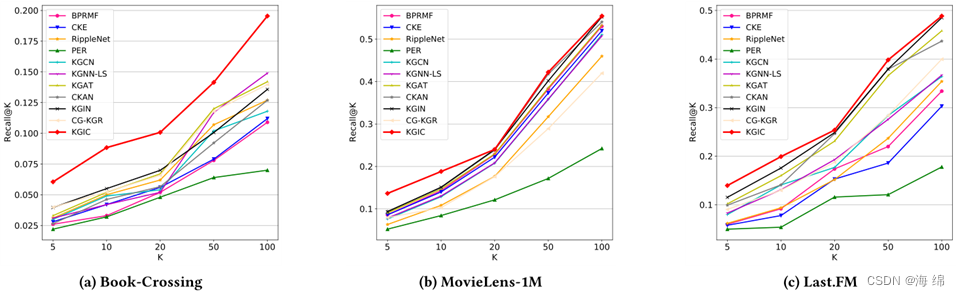

性能比较(RQ1)

• 我们提出的 KGIC 取得了最好的结果。我们将这种改进归因于以下方面:

(1)通过将CF与局部/非局部图中的KG信号进行对比,图内级交互式对比学习在两个部分之间进行交互并相互监督以改进表示学习。

(2)通过对比用户/项目的局部和非局部图,图间级交互式对比学习充分融合了非局部KG事实,并从两种图中学习判别表示。

• 大多数 KG 感知模型实现了更好的性能。

• 简单地集成 KG 并不能保证性能改进。

• 提取更多信息的 KG 事实提高了模型性能。

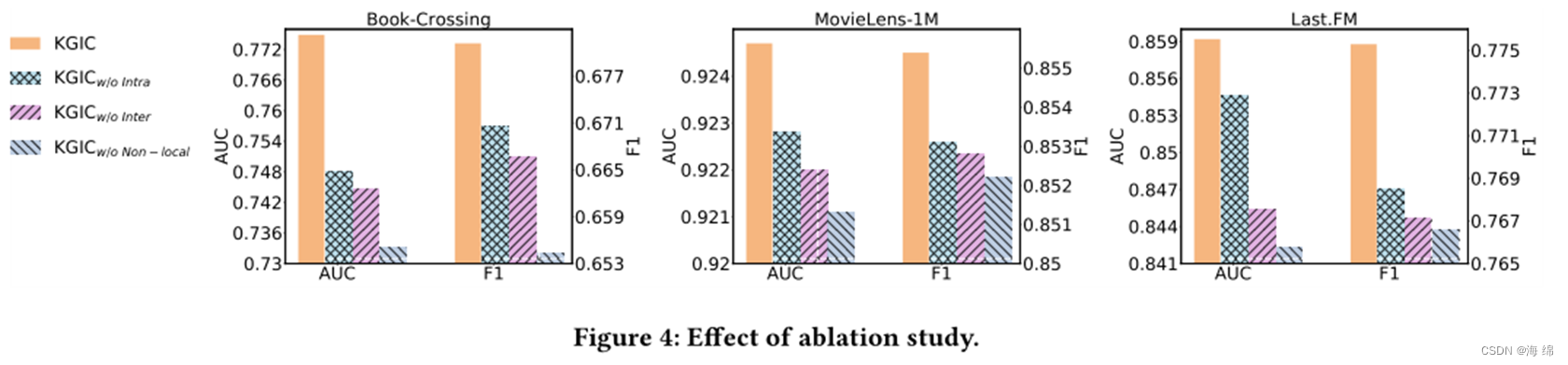

消融实验(RQ2)

为了检查我们模型中主要组件的贡献,我们将 KGIC 与以下变体进行比较:

(1) :在这个变体中,我们禁用了图内交互式对比学习模块。

(2) :此变体删除了图间交互式对比学习模块。

(3) :该变体去除了非本地图,因此非本地图的图内对比损失和图间对比损失都被禁用。实验结果报告在图 4 中,从中我们可以总结以下观察结果:

• 与 KGIC 相比, 和 K

始终获得更差的性能,这意味着删除每个对比损失的减少会导致性能下降。这一事实证明了利用交互式对比学习来改进用户/项目表示学习的重要性。此外,它揭示了这两种对比损失相辅相成,并在不同方面提高了性能。 •去除非本地图会显着降低模型性能,

是最没有竞争力的模型。这是有道理的,因为

只考虑本地图中的图内对比损失,这也验证了图内和图间对比学习的重要性

•在大多数情况下,所有三个变体都超过了三个数据集的基线模型,这进一步证明了图内和图间对比学习的有效性。

敏感性分析(RQ3)

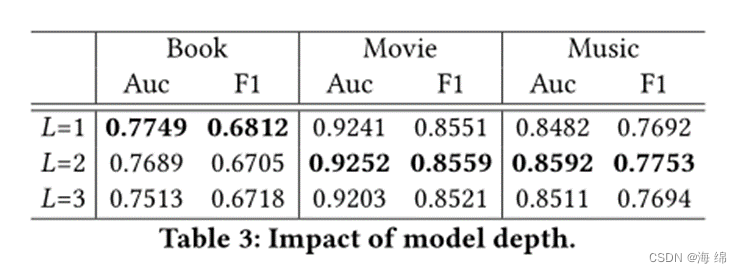

模型深度的影响。模型深度 L 代表局部/非局部图中的聚合层,也代表交互对比机制中的正对层。

为了研究模型深度的影响,我们在 {1, 2, 3} 范围内改变 L,并在表 3 中展示了在书籍、电影和音乐数据集上的性能比较。当 L = 1、2、2 时,KGIC 表现最佳,分别在书籍、电影和音乐上。我们可以观察到:(1)一两层是聚合局部/非局部图中相邻信息的适当距离,进一步堆叠更多层只会引入更多噪声。 (2) 在 CF 和 KG 层之间进行交互时,一两层的正对足以学习判别嵌入。

敏感性分析(RQ3)

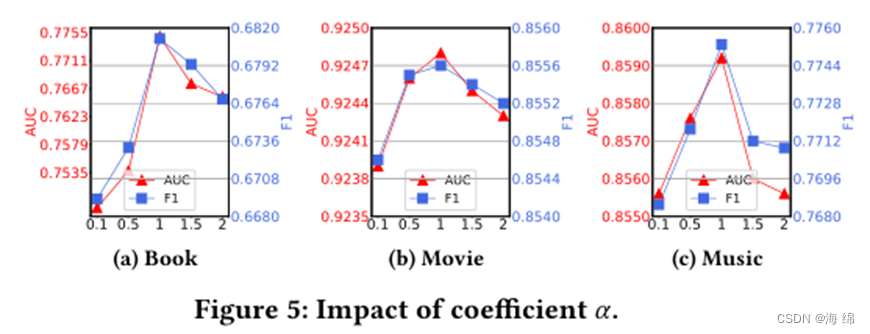

图内对比损失权重 𝛼 的影响。在等式(14)定义的整体对比损失中,𝛼 可以平衡图内和图间对比损失的影响。为了分析系数 𝛼 的影响,我们在 {0.1, 0.5, 1, 1.5, 2,} 中改变 𝛼 并将结果报告在图 5 中。从结果中我们可以观察到:适当的 𝛼 可以有效提高对比的性能学习。具体来说,当 𝛼 = 1 时模型表现最佳,这意味着图内和图间对比学习之间存在同等重要性。此外,在不同的 𝛼 下,我们的 KGIC 的性能始终优于其他基线,这也证实了我们的多级交互式对比学习机制的有效性。

可视化(RQ4)

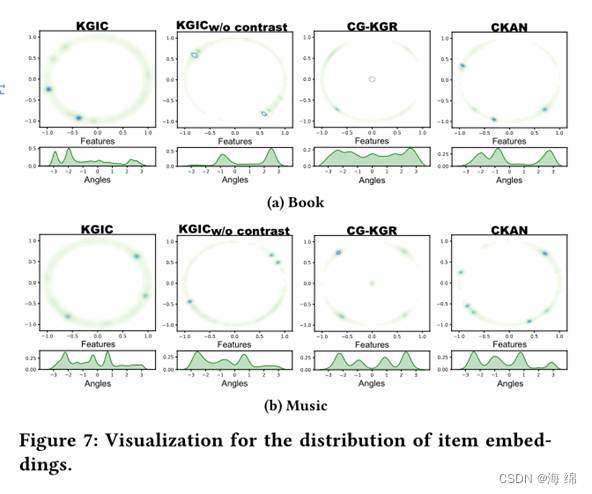

为了更直观地评估所提出的交互式对比机制如何影响表示学习性能,我们在图 7 中可视化了学习的项目嵌入。在之前的对比学习工作之后,我们绘制了项目嵌入分布二维空间中的高斯核密度估计 (KDE) (颜色越深,该区域中的点越多),我们还在角度上绘制 KDE(即 Arctan2 (y,x)对于对上图中的每个点 (x,y) 进行更清晰的展示。如图 7 所示,我们比较了 KGIC、 KGIC_(𝑤/𝑜 contrast) 、CG-KGR 和 CKAN 在书籍和音乐上的可视化结果,从中我们有以下观察结果:

• CG-KGR 和 CKAN 显示高度聚集的特征,主要位于一些狭窄的弧上,而我们的 KGIC 显然具有更均匀的分布,因此能够呈现更多不同的节点特征信息。在适当的范围内,更均匀的分布意味着更好的能力来模拟节点特征的多样性。这一事实证明了 KGIC 在更好的表示学习和缓解表示退化问题方面的优势。

• 通过消除KGIC 中的所有对比损失,学习的项目嵌入不太均匀,并落入几个连贯的集群。这一现象证实了表示学习的促进来自所提出的交互式对比机制,以保留关于表示的最大信息并提高学习表示的一致性。

结论

在本文中,我们专注于将对比学习纳入 KG 感知推荐,以自我监督的方式充分和连贯地使用 CF 和 KG。我们提出了一个新的框架,KGIC,它从两个维度实现了更好的用户/项目表示学习:

(1)KGIC 通过执行图内交互式对比学习,在每个本地/非本地图中连贯地利用 CF 和 KG 信息。对比 CF 和 KG 部分的层。

(2) KGIC通过构建非本地图和进行本地和非本地图对比的图间交互式对比学习,充分提取和整合更多的KG事实用于用户/项目表示学习。在三个公共数据集上进行的大量实验表明,KGIC 在点击率预测和 Top-K 推荐任务上都显着提高了推荐性能。

2806

2806

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?