Fisher线性判别

Fisher判别法介绍

Fisher判别法是判别分析的方法之一,它是借助于方差分析的思想,利用已知各总体抽取的样品的p维观察值构造一个或多个线性判别函数y=l′x其中l= (l1,l2…lp)′,x= (x1,x2,…,xp)′,使不同总体之间的离差(记为B)尽可能地大,而同一总体内的离差(记为E)尽可能地小来确定判别系数l=(l1,l2…lp)′。数学上证明判别系数l恰好是|B-λE|=0的特征根,记为λ1≥λ2≥…≥λr>0。所对应的特征向量记为l1,l2,…lr,则可写出多个相应的线性判别函数,在有些问题中,仅用一个λ1对应的特征向量l1所构成线性判别函数y1=l′1x不能很好区分各个总体时,可取λ2对应的特征向量l′2建立第二个线性判别函数y2=l′2x,如还不够,依此类推。有了判别函数,再人为规定一个分类原则(有加权法和不加权法等)就可对新样品x判别所属 [1] 。

Fisher判别法是根据方差分析的思想建立起来的一种能较好区分各个总体的线性判别法,由Fisher在1936年提出。该判别方法对总体的分布不做任何要求。

Fisher判别法是一种投影方法,把高维空间的点向低维空间投影。在原来的坐标系下,可能很难把样品分开,而投影后可能区别明显。一般说,可以先投影到一维空间(直线)上,如果效果不理想,在投影到另一条直线上(从而构成二维空间),依此类推。每个投影可以建立一个判别函数 [2] 。

Fisher线性判别

Fisher分类器也叫Fisher线性判别(Fisher Linear Discriminant),或称为线性判别分析(Linear Discriminant Analysis,LDA)。LDA有时也被称为Fisher’s LDA。最初于1936年,提出Fisher线性判别,后来于1948年,进行改进成如今所说的LDA。

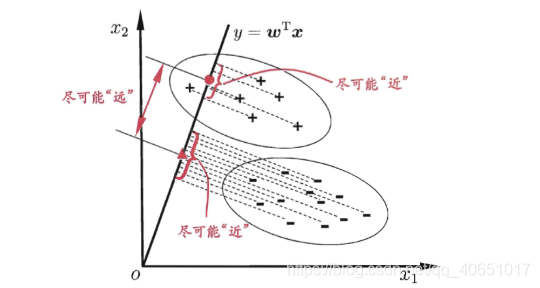

Fisher的基本思想是:

训练时,将训练样本投影到某条直线上,这条直线可以使得同类型的样本的投影点尽可能接近,而异类型的样本的投影点尽可能远离。要学习的就是这样的一条直线。

预测时,将待预测数据投影到上面学习到的直线上,根据投影点的位置来判断所属于的类别。

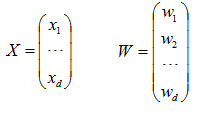

线性判别函数的一般形式可表示成

g(X)= W T W^T WTX+ w 0 w_0 w0

其中

Fisher选择投影方向W的原则,即使原样本向量在该方向上的投影能兼顾类间分布尽可能分开,类内样本投影尽可能密集的要求。

Fisher准则函数的定义

几个必要的基本参量:

- 在d维X空间

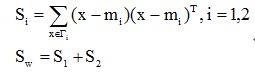

(1)各类样本的均值向量mi

(2)样本类内离散度矩阵Si和总样本类内离散度矩阵Sw

其中Sw是对称半正定矩阵,而且当N>d时通常是非奇异的。(半正定矩阵:特征值都不小于零的实对称矩阵;非奇异矩阵:矩阵的行列式不为零)

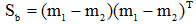

(3)样本类间离散度矩阵Sb

Sb是对称半正定矩阵。 - 在一维Y空间

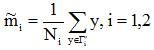

(1)各类样本的均值

(2)样本类内离散度 和总样本类内离散度

Fisher线性判别法是一种基于方差分析的判别分析方法,用于区分不同总体。它寻找最佳线性投影,使得类间离差最大化,类内离差最小化。Fisher准则函数用于确定最优投影方向。本文还介绍了Fisher线性判别在Python中的实现,并提到了鸢尾花数据集的线性分类应用。

Fisher线性判别法是一种基于方差分析的判别分析方法,用于区分不同总体。它寻找最佳线性投影,使得类间离差最大化,类内离差最小化。Fisher准则函数用于确定最优投影方向。本文还介绍了Fisher线性判别在Python中的实现,并提到了鸢尾花数据集的线性分类应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1425

1425

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?