ChatGLM3离线运行

获取开源代码

开源的ChatGLM3的运行程序中包括多个实用的工具,我们开源通过直接从github下载或者直接用git指令下载。

在本测试中,我们采用的下载zip文件然后解压的方式处理。github地址如下:

模型下载和配置

模型的下载和配置请见之前的文章:

ChatGLM3-6B大语言模型离线执行

在本次的项目中,模型文件的位置设置为:

C:\VM\Chatbot\ChatGLM3-main\THUDM\chatglm3-6b

文件的修改

1. 文件目录的变更

基于测试,我们首先需要将文件放置到和模型的前两级相同的位置,模型才能正确运行,在本测试中,需要执行的文件为web_demo_streamlit.py.

因此首先需要将文件从

C:\VM\Chatbot\ChatGLM3-main\basic_demo

移动到

C:\VM\Chatbot\ChatGLM3-main

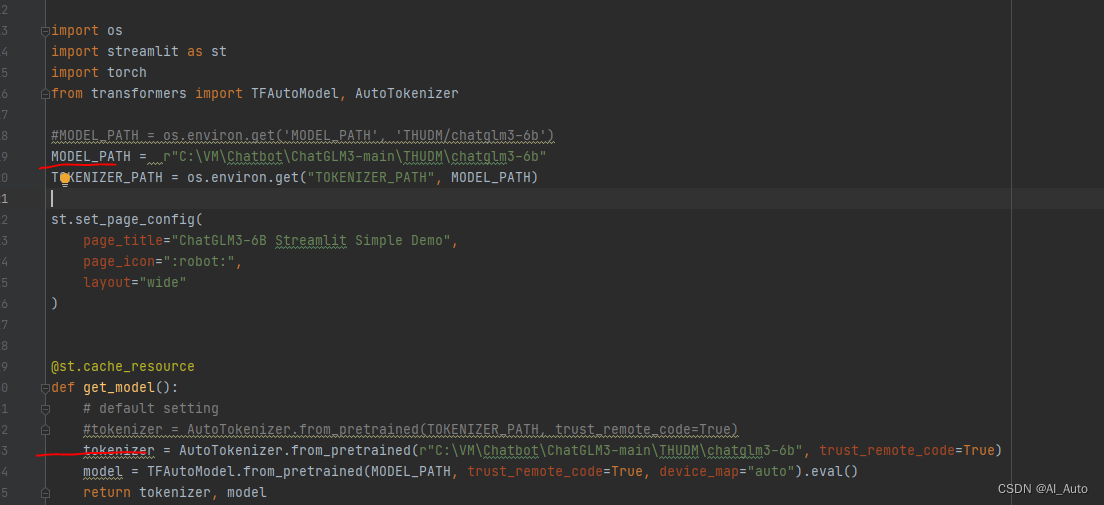

2. 模型的目标位置变更

由于项目为离线部署,因此需要调用的模型为本地模型,需要修改配置文件,将模型文件修改为本地。

需要修改的内容如下:

3. 程序执行

在运行栏,通过如下指令即可执行相应的python程序。

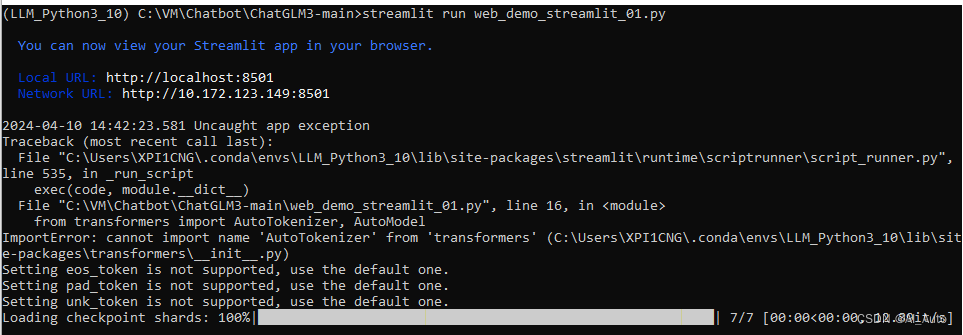

streamlit run web_demo_streamlit_01.py

正常情况下,相应输出如下图所示,否则需要修正问题。

异常处理:

异常处理:

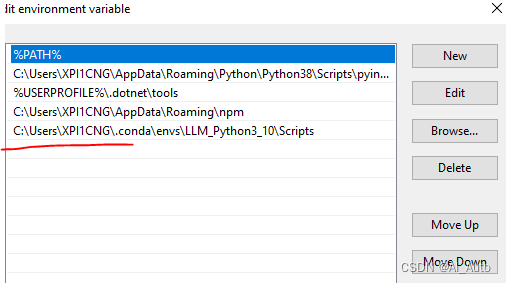

在使用sreamlit指令时,可能出现指令无法识别的情况,测试需要修改电脑的path,将相应文件存放的script地址放到path中

1786

1786

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?