ML-逻辑回归

一、逻辑回归

逻辑回归解决的问题是分类问题。

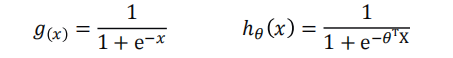

Sigmoid/Logistic Function

我们定义逻辑回归的预测函数为 h θ ( x ) = g ( θ T x ) h_\theta(x)=g(\theta^Tx) hθ(x)=g(θTx),其中 g ( x ) g(x) g(x)函数是 s i g m o i d sigmoid sigmoid函数。

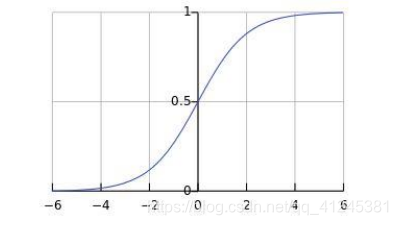

s i g m o i d sigmoid sigmoid函数图像

0.5可以作为分类的边界:

当 z ≥ 0 z≥0 z≥0的时候 g ( z ) ≥ 0.5 g(z)≥0.5 g(z)≥0.5,当 θ T X ≥ 0 \theta^TX≥0 θTX≥0的时候 g ( θ T X ) ≥ 0.5 g(\theta^TX)≥0.5 g(θTX)≥0.5;

当 z ≤ 0 z≤0 z≤0的时候 g ( z ) ≤ 0.5 g(z)≤0.5 g(z)≤0.5,当 θ T X ≤ 0 \theta^TX≤0 θTX≤0的时候 g ( θ T X ) ≤ 0.5 g(\theta^TX)≤0.5 g(θTX)≤0.5。

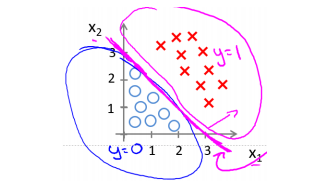

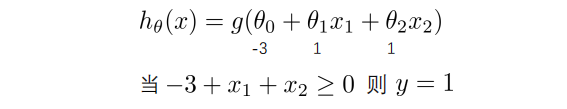

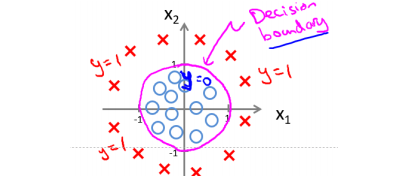

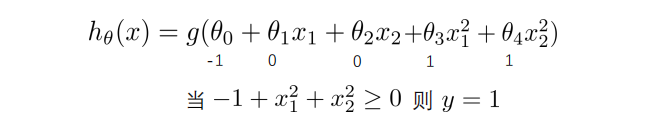

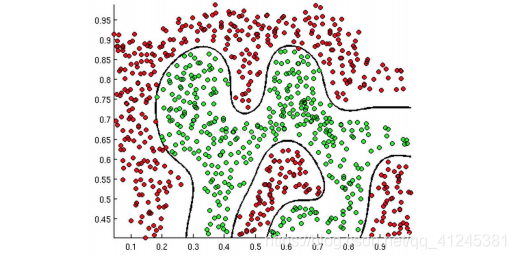

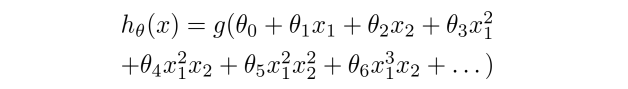

决策边界

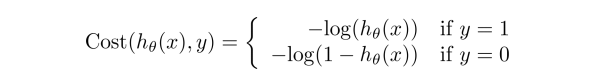

代价函数

当 y = 1 y = 1 y=1, h θ ( x ) = 1 ℎ_\theta(x)= 1 hθ(x)=1时, c o s t = 0 cost=0 cost=0

当 y = 1 y = 1 y=1, h θ ( x ) = 0 ℎ_\theta(x)= 0 hθ(x)=0时, c o s t = ∞ cost=∞ cost=∞</

该内容介绍了逻辑回归在分类问题中的应用,包括sigmoid函数、决策边界、代价函数及梯度下降法。还讨论了多分类问题的解决策略以及正则化的逻辑回归。此外,提到了查准率、查全率和F1值作为评估分类模型性能的指标。

该内容介绍了逻辑回归在分类问题中的应用,包括sigmoid函数、决策边界、代价函数及梯度下降法。还讨论了多分类问题的解决策略以及正则化的逻辑回归。此外,提到了查准率、查全率和F1值作为评估分类模型性能的指标。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4055

4055

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?