目录

可行性

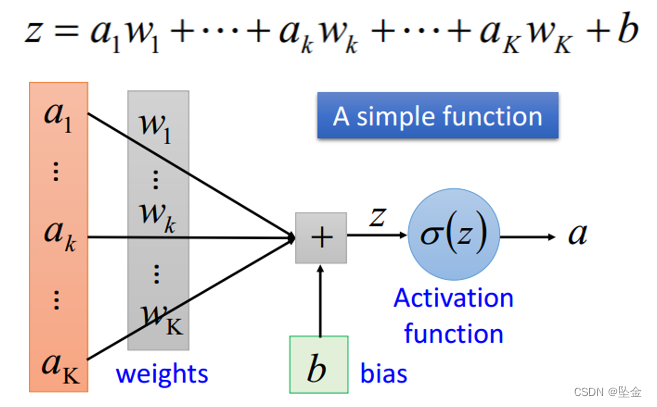

前面几篇博客提到y=w1x1+w2x2+w3x3...+b可以用线性回归求解,观察到,所有特征都输入节点y,本质就是全连接层(FC层 也称dense层)

故回归问题也可以用多层感知机,即最简化版的神经网络求解

实现

模型定义

from torch import nn

"""

nn.module 继承这个类

init 初始化所有层

forward 定义前向传播(模型的运算过程)

"""

class Model(nn.Module):

def __init__(self,input_len=9,hidden=18,output_len=1):

super().__init__() #继承父类中所有属性

self.liner_1=nn.Linear(input_len,hidden)

self.liner_2=nn.Linear(hidden,output_len)

#可以在这加relu层

def forward(self,x):

x=self.liner_1(x)

x=self.relu_1(x)

订阅专栏 解锁全文

订阅专栏 解锁全文

532

532

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?