介绍

Pytorch入门选手的学习笔记 (序号与视频序号完全对应), 本文尽可能的在详细记录了自己的学习内容, 包括但不限于(加了详细注释的代码, 截图并补充了说明的插图, UP讲课时的关键内容),因为自己学习过程中看其他博主的笔记, 有所收获,.

希望我的笔记也可以帮助一起学习的小伙伴, 加油哇~

视频链接

PyTorch深度学习快速入门教程【小土堆】:通往学习之门-点 这 里 !!!

参考的其他博主的笔记链接 ,非常感谢!!

笔记链接 再次感谢上述博主分享, 在学习过程中有效帮助我节约了时间并加深了理解~

27. 完整的模型训练套路(一)

- model.py

# 搭建神经网络

import torch

from torch import nn

from torch.nn.modules.flatten import Flatten

class Tudui(nn.Module):

def __init__(self):

self.model = super(Tudui,self).__init__()

# 把网络放在一个序列中

self.model = nn.Sequential(

nn.Conv2d(3, 32, 5,stride=1, padding=2),

nn.MaxPool2d(2),

nn.Conv2d(32, 32, 5, 1,2),

nn.MaxPool2d(2),

nn.Conv2d(32, 64, 5, 1,2),

nn.MaxPool2d(2),

Flatten(),

nn.Linear(1024, 64),

nn.Linear(64, 10)

)

def forward(self,x):

x = self.model(x)

return x

# 创建主方法

if __name__ == '__main__':

tudui = Tudui()

input = torch.ones((64,3,32,32)) # batch_size=64,

output = tudui(input)

print(output.shape)

train.py

# 准备数据集

import torch

import torchvision

from torch.utils.tensorboard import SummaryWriter

from model import *

from torch.utils.data import DataLoader

train_data = torchvision.datasets.CIFAR10(root="../data",train=True,transform=torchvision.transforms.ToTensor(),

download=True)

test_data = torchvision.datasets.CIFAR10(root="../data",train=False,transform=torchvision.transforms.ToTensor(),

download=True)

# 查看数据集大小 length 长度

train_data_size = len(train_data)

test_data_size = len(test_data)

print("训练数据集长度为:{}",format(train_data_size))

print("测试数据集长度为:{}",format(test_data_size))

# 利用 DataLoader 来加载数据集

train_dataloader = DataLoader(train_data,batch_size=64)

test_dataloader = DataLoader(test_data,batch_size=64)

# 创建网络模型

tudui = Tudui()

# 定义损失函数 用交叉熵

loss_fn = nn.CrossEntropyLoss()

# 定义优化器 选择的是随机梯度下降

# 1e-2 = 1*(10)^(-2) = 1/100 =0.01

learning_rate = 1e-2

optimizer = torch.optim.SGD(tudui.parameters(),lr=learning_rate)

# 设置训练网络的一些参数

# 记录训练的次数

total_train_step = 0

# 记录测试的次数

total_test_step = 0

# 训练的轮数

epoch = 10

# 添加tensorboard

writer = SummaryWriter()

for i in range(epoch):

print("-----------第{}轮训练开始-----------".format(i+1))

# 训练步骤开始

for data in train_dataloader:

imgs,targets = data

outputs = tudui(imgs)

loss = loss_fn(outputs,targets)

# 优化器优化模型

# 利用优化器将梯度清零

optimizer.zero_grad()

# 利用反向传播得到每个梯度的结点

loss.backward()

# 调用优化器

optimizer.step()

# 训练次数+1

total_train_step += 1

if total_train_step % 100 == 0:

print("训练次数:{},Loss:{}".format(total_train_step,loss))

writer.add_scalar("train_loss",loss.item(),total_train_step)

# 测试步骤开始

# 计算整个数据集上的loss

total_test_loss = 0

with torch.no_grad():

for data in test_dataloader:

imgs,targets = data

outputs = tudui(imgs)

# 计算数据的损失

loss = loss_fn(outputs,targets)

# 计算整体损失

total_test_loss = total_test_loss + loss

print("整体测试集上的loss:{}".format(total_test_loss))

writer.add_scalar("test_loss",total_test_loss,total_test_step)

total_train_step += 1

# 保存训练时每一轮的模型

torch.save(tudui,"tudui_{}.pth".format(i))

print('模型已保存')

writer.close()

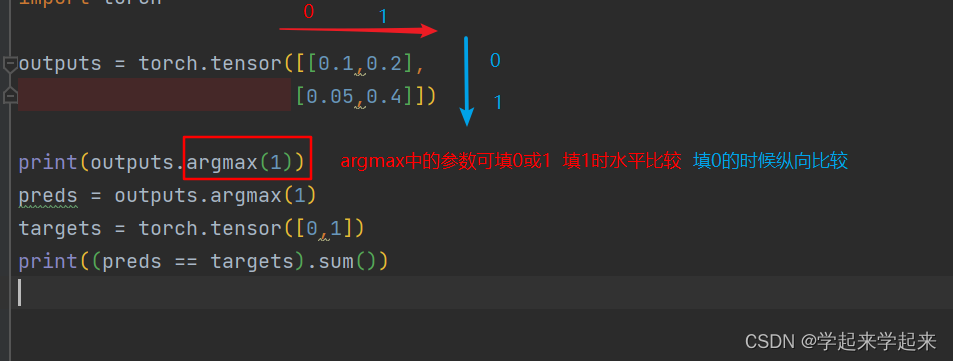

28. 完整的模型训练套路(二)

- 增加优化代码:添加测试数据集正确率

- 正确率的计算思路

# 准备数据集

import torch

import torchvision

from torch.utils.tensorboard import SummaryWriter

from model import *

from torch.utils.data import DataLoader

train_data = torchvision.datasets.CIFAR10(root="../data",train=True,transform=torchvision.transforms.ToTensor(),

download=True)

test_data = torchvision.datasets.CIFAR10(root="../data",train=False,transform=torchvision.transforms.ToTensor(),

download=True)

# 查看数据集大小 length 长度

train_data_size = len(train_data)

test_data_size = len(test_data)

print("训练数据集长度为:{}",format(train_data_size))

print("测试数据集长度为:{}",format(test_data_size))

# 利用 DataLoader 来加载数据集

train_dataloader = DataLoader(train_data,batch_size=64)

test_dataloader = DataLoader(test_data,batch_size=64)

# 创建网络模型

tudui = Tudui()

# 定义损失函数 用交叉熵

loss_fn = nn.CrossEntropyLoss()

# 定义优化器 选择的是随机梯度下降

# 1e-2 = 1*(10)^(-2) = 1/100 =0.01

learning_rate = 1e-2

optimizer = torch.optim.SGD(tudui.parameters(),lr=learning_rate)

# 设置训练网络的一些参数

# 记录训练的次数

total_train_step = 0

# 记录测试的次数

total_test_step = 0

# 训练的轮数

epoch = 10

# 添加tensorboard

writer = SummaryWriter()

for i in range(epoch):

print("-----------第{}轮训练开始-----------".format(i+1))

# 训练步骤开始

for data in train_dataloader:

imgs,targets = data

outputs = tudui(imgs)

loss = loss_fn(outputs,targets)

# 优化器优化模型

# 利用优化器将梯度清零

optimizer.zero_grad()

# 利用反向传播得到每个梯度的结点

loss.backward()

# 调用优化器

optimizer.step()

# 训练次数+1

total_train_step += 1

if total_train_step % 100 == 0:

print("训练次数:{},Loss:{}".format(total_train_step,loss))

writer.add_scalar("train_loss",loss.item(),total_train_step)

# 测试步骤开始

# 计算整个数据集上的loss

total_test_loss = 0

# 计算整体的正确率 整体正确的个数 初始为0

total_accuracy = 0

with torch.no_grad():

for data in test_dataloader:

imgs,targets = data

outputs = tudui(imgs)

# 计算数据的损失

loss = loss_fn(outputs,targets)

# 计算整体损失

total_test_loss = total_test_loss + loss

# 横向比较

# argmax(1)中 填1 水平比较 如果为正确为True sum + 1

accuracy = (outputs.argmax(1) == targets).sum()

total_accuracy = total_accuracy + accuracy

print("整体测试集上的loss:{}".format(total_test_loss))

print("整体测试集上的正确率:{}".format(total_accuracy/test_data_size))

writer.add_scalar("test_loss",total_test_loss,total_test_step)

writer.add_scalar("test_accuracy",total_accuracy/test_data_size,total_test_step)

total_train_step += 1

# 保存训练时每一轮的模型

torch.save(tudui,"tudui_{}.pth".format(i))

print('模型已保存')

writer.close()

29. 完整的模型训练套路(三)

浅浅修改, 增加了

tudui.train() # 作用:将网络设置成训练模式 只对部分网络层有作用,例如Dropout层,BatchNorm层等

tudui.eval() # 设置模型进入验证状态 只对特定层有作用,例如Dropout层,BatchNorm层等

# 准备数据集

import torch

import torchvision

from torch.utils.tensorboard import SummaryWriter

from model import *

from torch.utils.data import DataLoader

train_data = torchvision.datasets.CIFAR10(root="../data",train=True,transform=torchvision.transforms.ToTensor(),

download=True)

test_data = torchvision.datasets.CIFAR10(root="../data",train=False,transform=torchvision.transforms.ToTensor(),

download=True)

# 查看数据集大小 length 长度

train_data_size = len(train_data)

test_data_size = len(test_data)

print("训练数据集长度为:{}",format(train_data_size))

print("测试数据集长度为:{}",format(test_data_size))

# 利用 DataLoader 来加载数据集

train_dataloader = DataLoader(train_data,batch_size=64)

test_dataloader = DataLoader(test_data,batch_size=64)

# 创建网络模型

tudui = Tudui()

# 定义损失函数 用交叉熵

loss_fn = nn.CrossEntropyLoss()

# 定义优化器 选择的是随机梯度下降

# 1e-2 = 1*(10)^(-2) = 1/100 =0.01

learning_rate = 1e-2

optimizer = torch.optim.SGD(tudui.parameters(),lr=learning_rate)

# 设置训练网络的一些参数

# 记录训练的次数

total_train_step = 0

# 记录测试的次数

total_test_step = 0

# 训练的轮数

epoch = 10

# 添加tensorboard

writer = SummaryWriter()

for i in range(epoch):

print("-----------第{}轮训练开始-----------".format(i+1))

# 训练步骤开始

tudui.train() # 作用:将网络设置成训练模式 只对部分网络层有作用,例如Dropout层,BatchNorm层等

for data in train_dataloader:

imgs,targets = data

outputs = tudui(imgs)

loss = loss_fn(outputs,targets)

# 优化器优化模型

# 利用优化器将梯度清零

optimizer.zero_grad()

# 利用反向传播得到每个梯度的结点

loss.backward()

# 调用优化器

optimizer.step()

# 训练次数+1

total_train_step += 1

if total_train_step % 100 == 0:

print("训练次数:{},Loss:{}".format(total_train_step,loss))

writer.add_scalar("train_loss",loss.item(),total_train_step)

# 测试步骤开始

tudui.eval() # 设置模型进入验证状态 只对特定层有作用,例如Dropout层,BatchNorm层等

# 计算整个数据集上的loss

total_test_loss = 0

# 计算整体的正确率 整体正确的个数 初始为0

total_accuracy = 0

with torch.no_grad(): # 本行要有, 测试时不要改变梯度

for data in test_dataloader:

imgs,targets = data

outputs = tudui(imgs)

# 计算数据的损失

loss = loss_fn(outputs,targets)

# 计算整体损失

total_test_loss = total_test_loss + loss

# 横向比较

# argmax(1)中 填1 水平比较 如果为正确为True sum + 1

accuracy = (outputs.argmax(1) == targets).sum()

total_accuracy = total_accuracy + accuracy

print("整体测试集上的loss:{}".format(total_test_loss))

print("整体测试集上的正确率:{}".format(total_accuracy/test_data_size))

writer.add_scalar("test_loss",total_test_loss,total_test_step)

writer.add_scalar("test_accuracy",total_accuracy/test_data_size,total_test_step)

total_train_step += 1

# 保存训练时每一轮的模型

torch.save(tudui,"tudui_{}.pth".format(i))

# 官方推荐的保存方式 torch.save(tudui.stats_dict(),"tudui_{}.path.format)

print('模型已保存')

writer.close()

2061

2061

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?