前言:FLUX和HunYuan-Video是目前开源效果最好的图像生成模型和视频生成模型,背后成功的关键之一就是双流+单流MM-DiT。很多社区的朋友讨论说DiT的效果很多方面表现不如UNet,诚然,改进版本双流+单流MM-DiT才是彻底击败UNet的关键。这篇博客是解读HunYuan Video代码的第一篇,首先解读最核心的网络结构。

目录

MM-DiT总揽

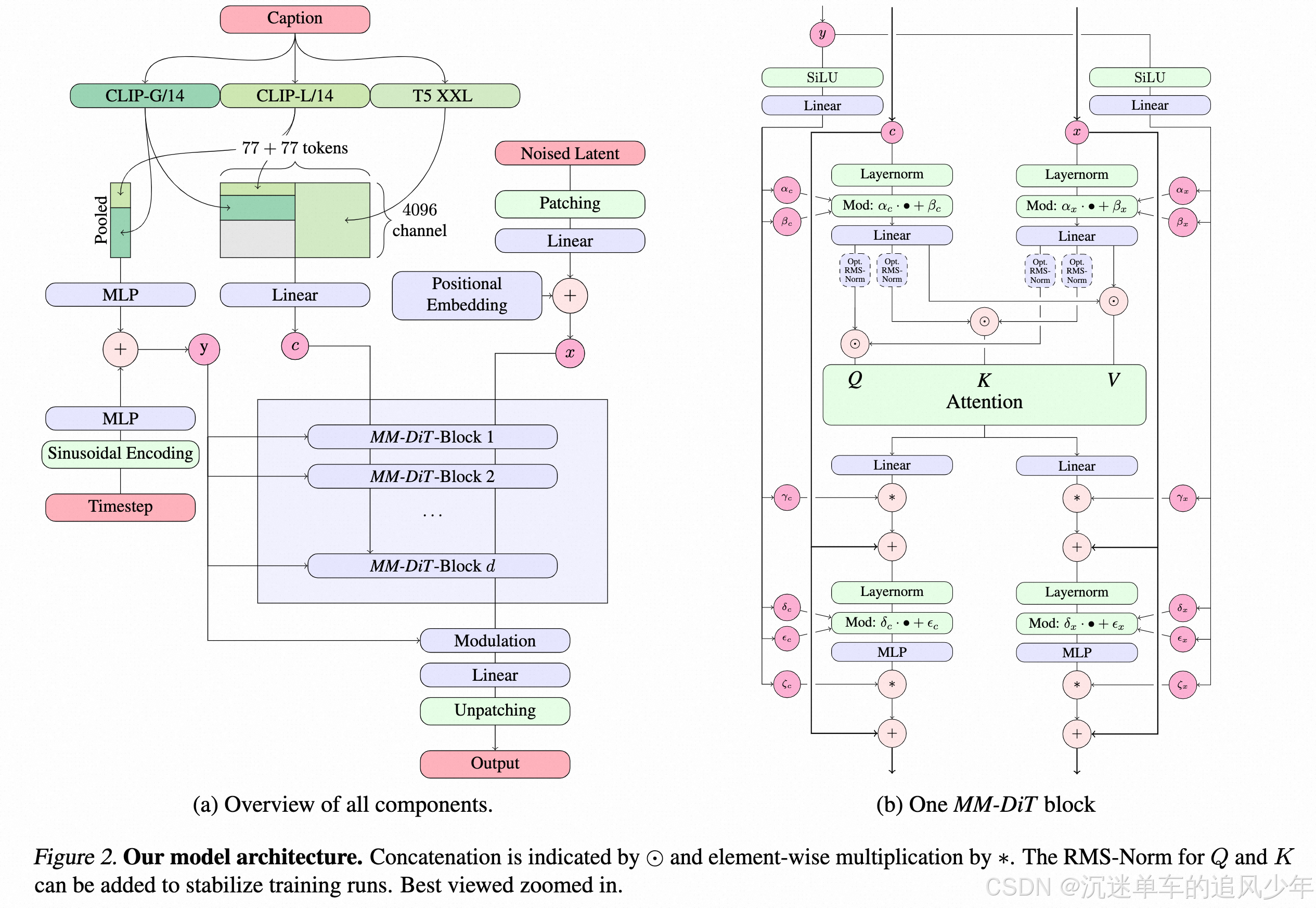

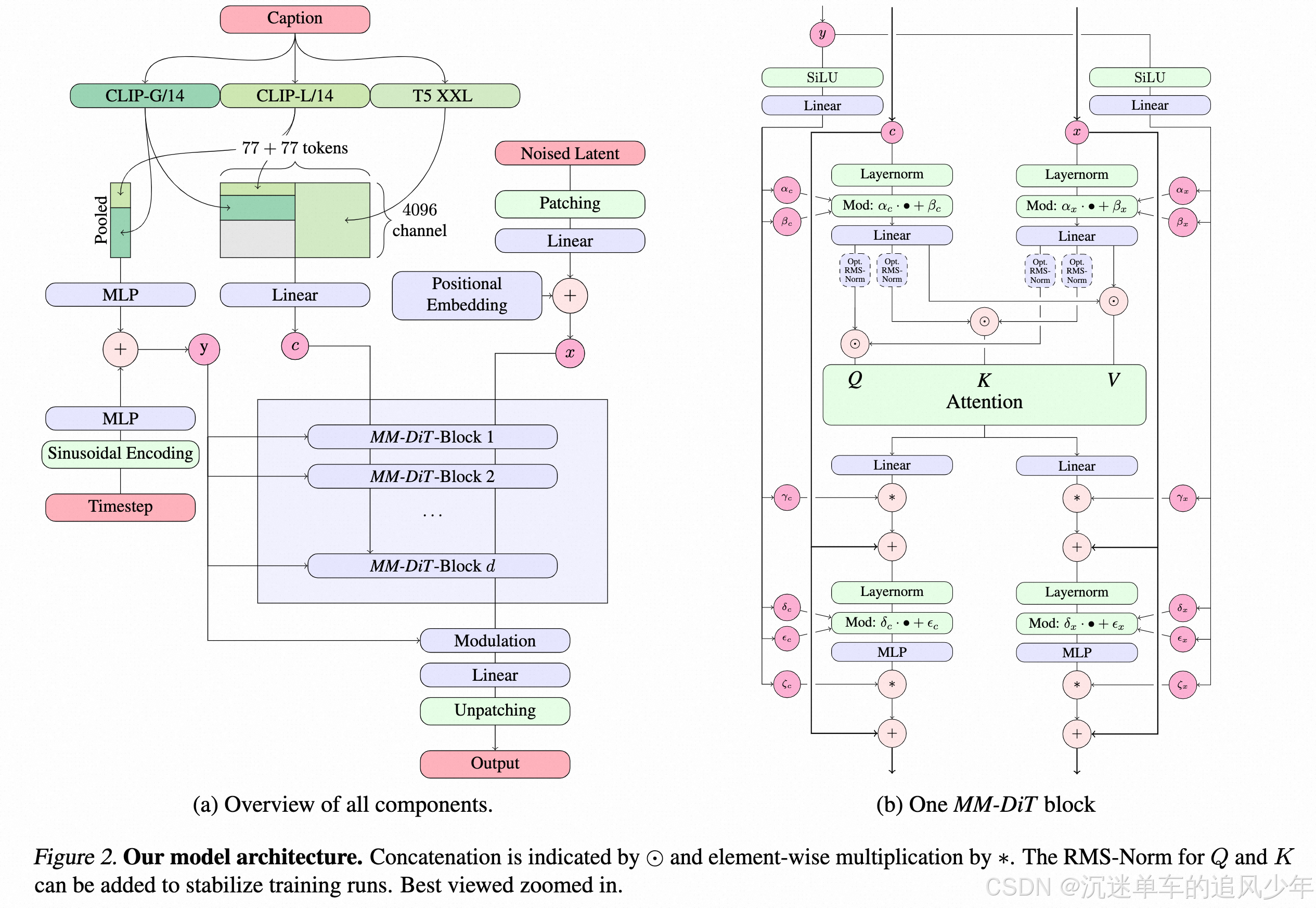

有据可查的MM-DiT结构来自SD3

原始论文《Scaling Rectified Flow Transformers

前言:FLUX和HunYuan-Video是目前开源效果最好的图像生成模型和视频生成模型,背后成功的关键之一就是双流+单流MM-DiT。很多社区的朋友讨论说DiT的效果很多方面表现不如UNet,诚然,改进版本双流+单流MM-DiT才是彻底击败UNet的关键。这篇博客是解读HunYuan Video代码的第一篇,首先解读最核心的网络结构。

目录

有据可查的MM-DiT结构来自SD3

原始论文《Scaling Rectified Flow Transformers

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?