简介

- 项目名称:DeepSeek-V3 - 自研开源大模型

- GitHub 链接:https://github.com/deepseek-ai/DeepSeek-V3

- 上周 Star 数:8000+

DeepSeek绝对是最近一段大模型圈子的重磅炸弹,就在2024年马上要过完的时候,DeepSeek放大招了,12月26日DeepSeek V3正式发布。它是一款完全国产的自研开源大模型,基于 MoE 架构,671B 参数,激活 37B,在 14.8T token 上进行了预训练,而且最为恐怖的是训练成本上,这次V3版本主需要557万美元,仅需2000多张卡就可以完成。

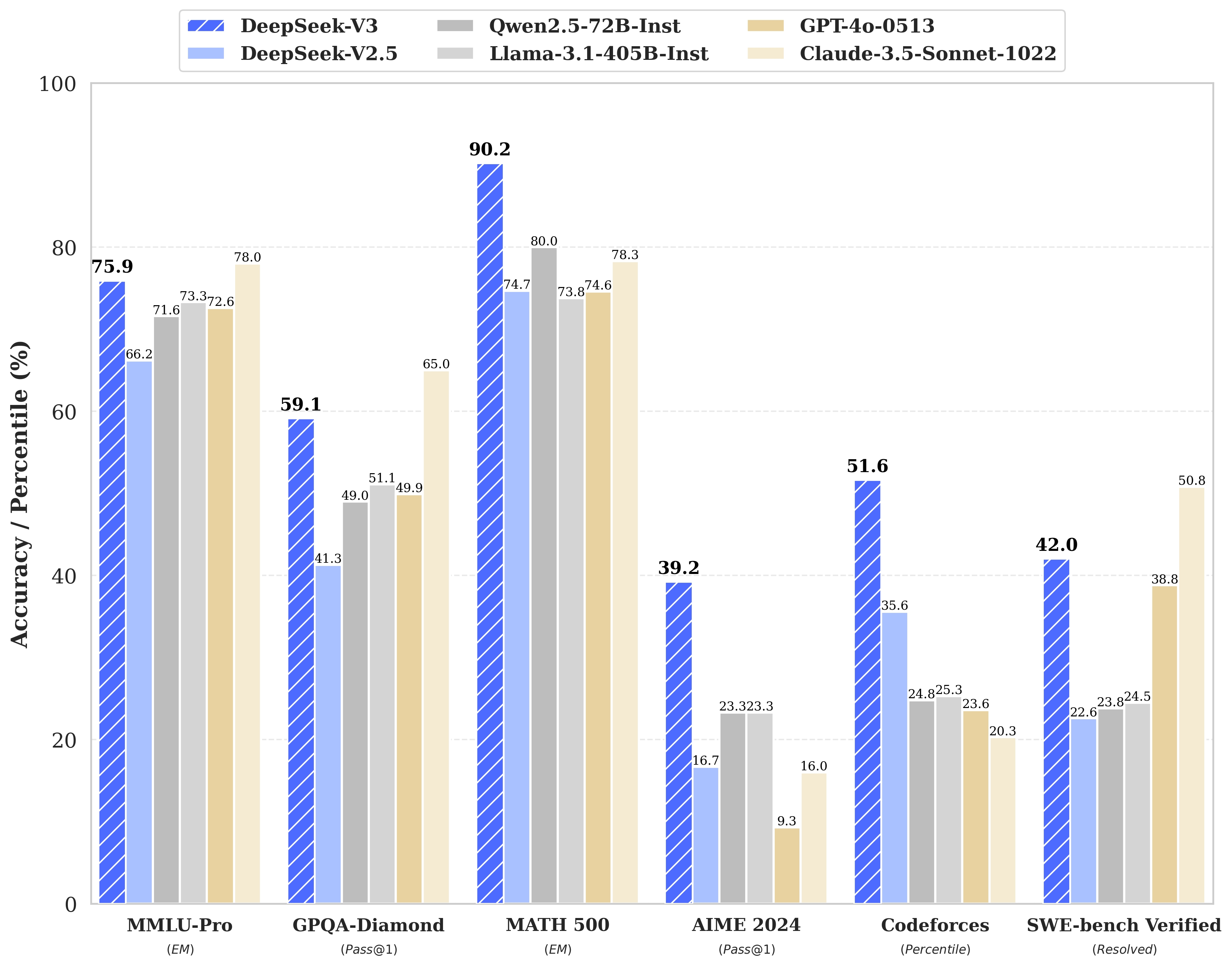

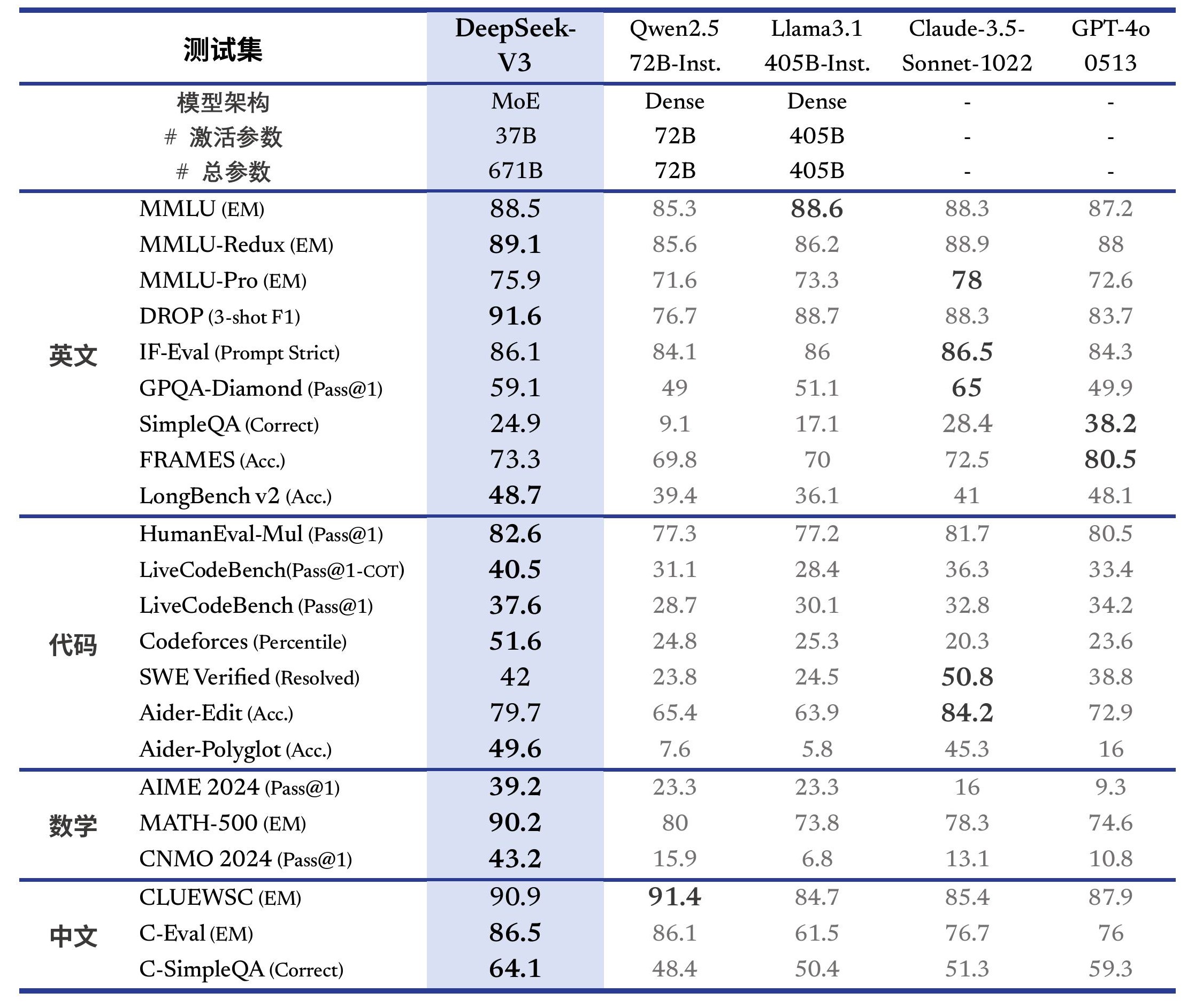

DeepSeek-V3 多项评测成绩超越了 Qwen2.5-72B 和 Llama-3.1-405B 等其他开源模型,并在性能上和世界顶尖的闭源模型 GPT-4o 以及 Claude-3.5-Sonnet 不分伯仲。

- 百科知识: DeepSeek-V3 在知识类任务(MMLU, MMLU-Pro, GPQA, SimpleQA)上的水平相比前代 DeepSeek-V2.5 显著提升,接近当前表现最好的模型 Claude-3.5-Sonnet-1022。

- 长文本: 在长文本测评中,DROP、FRAMES 和 LongBench v2 上,DeepSeek-V3 平均表现超越其他模型。

- 代码: DeepSeek-V3 在算法类代码场景(Codeforces),远远领先于市面上已有的全部非 o1 类模型;并在工程类代码场景(SWE-Bench Verified)逼近 Claude-3.5-Sonnet-1022。

- 数学: 在美国数学竞赛(AIME 2024, MATH)和全国高中数学联赛(CNMO 2024)上,DeepSeek-V3 大幅超过了所有开源闭源模型。

- 中文能力: DeepSeek-V3 与 Qwen2.5-72B 在教育类测评 C-Eval 和代词消歧等评测集上表现相近,但在事实知识 C-SimpleQA 上更为领先。

通过算法和工程上的创新,DeepSeek-V3 的生成吐字速度从 20 TPS 大幅提高至 60 TPS,相比 V2.5 模型实现了 3 倍的提升,为用户带来更加迅速流畅的使用体验。

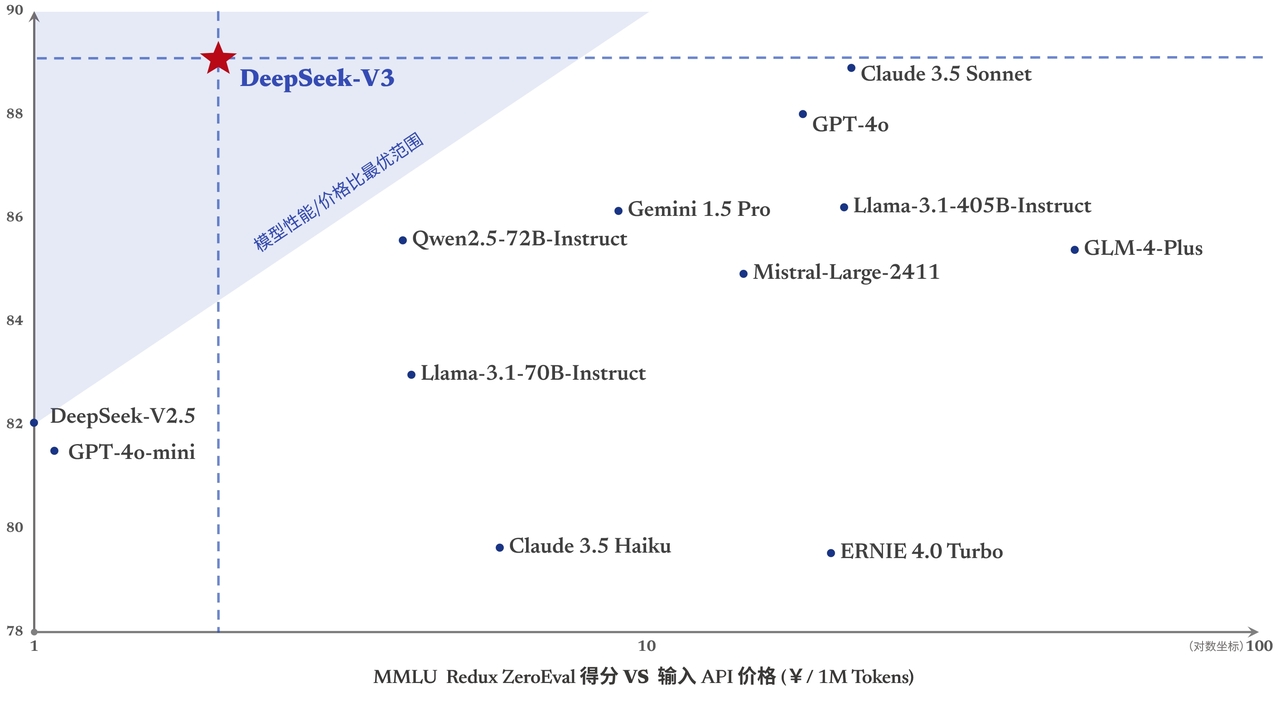

DeepSeek还被成为大模型界的拼多多,它在价格方面总是让人充满惊喜,这次V3发布依然保持了价格屠夫的本色,每百万输入 tokens 0.5 元(缓存命中)/ 2 元(缓存未命中),每百万输出 tokens 8 元,确实便宜。

最近说实话,关于deepseek的消息有点多,我也是进行了一番体验,概况来说就是很不错,但是也没那么神,本周我会出一期关于deepseek-V3的视频,来详细说说它到底怎么样。

论文解读

论文链接:https://github.com/deepseek-ai/DeepSeek-V3/blob/main/DeepSeek_V3.pdf

DeepSeek-V3 是一个强大的Mixture-of-Experts (MoE)语言模型,拥有庞大的 671B参数,但每个令牌仅激活 37B参数,以确保计算效率。DeepSeek-V3 采用了 Multi-head Latent Attention (MLA) 和 DeepSeekMoE 架构,旨在实现高效的推理和成本效益高的训练。

为了实现负载均衡并避免由于辅助损耗导致的性能下降,DeepSeek-V3 开创了一种无辅助损失的策略。此外,模型还设定了一个多标记预测(MTP)训练目标,以增强性能和推测性解码,从而有可能提高文本生成的一致性。

DeepSeek-V3 是在配备 2048 块 NVIDIA H800 GPU 的集群上进行训练的。每个节点H800 集群包含 8 个 GPU,通过 NVLink 和 NVSwitch 在节点内连接,并提出了一种细粒度的混合精度框架,利用 FP8 数据格式对 DeepSeek-V3 进行训练。

在推理与展开阶段,DeepSeek-V3 优化了部署流程,包括单独的预填充和解码阶段,并使用不同的并行策略来提高吞吐量和减少隐藏通信开销。为了提高硬件性能,建议对硬件进行改进,如引入专用的通信协处理器,以减少计算瓶颈。

DeepSeek-V3 在 14.8 万亿个多样化和高质量的标记上进行了预训练,并随后进行了监督微调强化学习阶段,以充分挖掘其潜力。综合评估显示,DeepSeek-V3 的性能优于其他开源模型,并实现了与领先的闭源模型相当的性能。尽管其性能出色,但 DeepSeek-V3 的完整训练仅需要 278.8 万个 H800 GPU 小时,这一表现优于其他开源模型,如 GPT-4 和 Claude-3.5。

综上所述,DeepSeek-V3 是一个高效、强大且经过全面验证的语言模型,其独特的架构和训练策略使其在计算效率和性能方面均表现出色。

767

767

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?