2015-IEEE

论文链接:Lift: Multi-Label Learning with Label-Specific Features | IEEE Journals & Magazine | IEEE Xplore

摘要

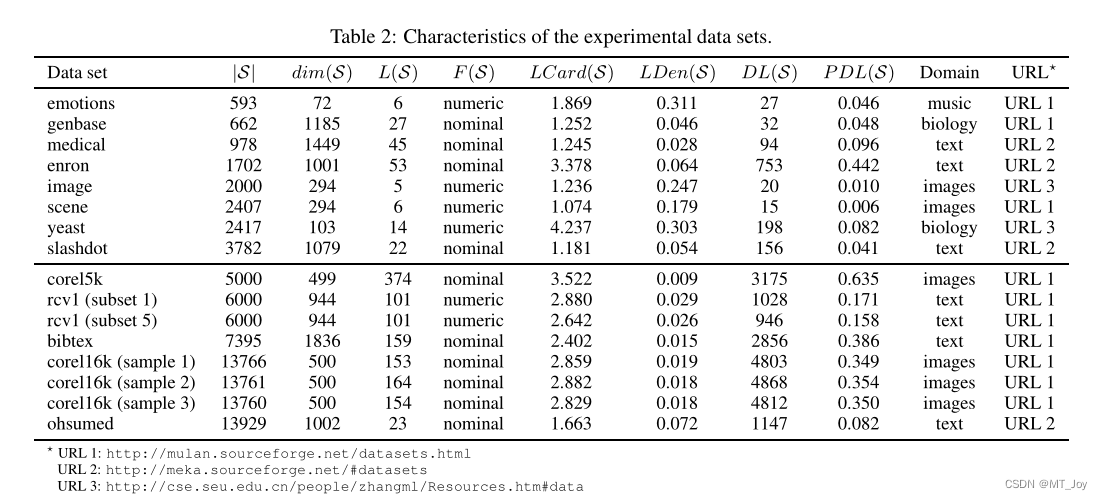

多标签学习处理每个训练示例由单个实例表示同时与一组类标签相关联的问题。对于一个看不见的例子,现有的方法选择基于相同的特征集来确定每个可能的类标签的成员资格,即在所有标签的辨别过程中都采用了看不见的例子的实例表示。然而,这种常用的策略可能不是最优的,因为不同的类标签通常带有它们自己的特定特征,并且利用不同的特征集来区分不同的标签可能是有益的。基于上述反思,我们提出了一种利用标签特定特征进行多标签学习的新策略,其中提出了一种简单而有效的算法,称为 LIFT。简而言之,LIFT 通过对其正负实例进行聚类分析来构造每个标签特定的特征,然后通过查询聚类结果进行训练和测试。对 16 个不同数据集的广泛实验清楚地验证了 LIFT 相对于其他成熟的多标签学习算法的优越性。

现实存在的一种现象

例如,在自动图像标注中,假设天空和沙漠是标签空间中两个可能的标签。直观地说,基于颜色的特征在区分天空和非天空图像时更受欢迎,基于纹理的特征在区分沙漠和非沙漠图像时更受欢迎,而基于颜色和纹理的特征可能在区分其他标签时很有用在标签空间。再举一个例子,在文本分类中,与政府、改革和总统等术语相关的特征可能在区分政治和非政治文件方面很重要,而与体育场、比赛和冠军等术语相关的特征可能在区分体育和非政治文件方面很重要。非体育文件

即在多标签学习中,标签空间中的不同类标签可能带有各自的特定特征。因此,我们假设如果可以在学习过程中使用特定于标签的特征,即每个类标签最相关和最有区别的特征,则可以期望更有效地解决多标签学习问题。

本文提出了一种名为 LIFT 的新算法,即具有标签特定特征的多标签学习。 LIFT 通过两个简单的步骤解决多标签学习问题。首先,对于每个类标签 𝑙k ∈ Y,对其在训练集中的正例和负例进行聚类分析,然后通过查询聚类结果来构造 lk 特有的特征。其次,引入了一系列 q 分类器,其中每个分类器都使用生成的标签特定特征进行训练,而不是 X 下的原始特征。为了彻底评估 LIFT 的有效性,在 16 个常规规模和大规模数据集上进行的广泛的实验清楚地验证了我们的方法与其他最先进的多标签学习算法相比具有优势。

其中公式大致思路为:

正训练实例集 和负训练实例集

表示为:

求正实例和负实例保留的簇数设置为,∙表示集合基数和r∈0,1是控制因此保留的集群数量的比率参数。

![]()

计算数据x分别与所有的正例和负例其欧式距离,相当于映射建立了关系。

根据,任何二元学习器都可以用于归纳分类模型

给定一个未见类的例子 u ∈ X,其相关的标签集被预测为

![]()

根据预测值来判定其是否相关的概率。

结论

我们工作的主要贡献有两个:1)提出了一种通过标签特定特征进行多标签学习的新策略,这为从多标签数据中学习提出了一个新方向; 2) 一种名为 LIFT 的简单算法旨在证明所提出的策略的合理性,其有效性基于广泛的比较研究得到了彻底验证。

5195

5195

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?