论文阅读

Visual Attention Network Arxiv

有两种常见的方式去捕捉长距离的依赖(long-range dependence):

a)使用自注意力机制。自注意力擅长处理一维的序列结构,如果直接用于处理图像,会忽略图像自身的二维结构信息。由于自注意力自身的复杂度问题,难以用于处理高分辨率图像。自注意力机制仅仅考虑了空间上了自适应性,而忽略了通道维度上的自适应性.

b)使用大核卷积来捕捉长距离依赖。大核卷积的不足在于,大卷积核的参数量和计算量太大,难以接受。

文献提出了一种全新的针对于视觉任务的注意力机制,大核注意力机制(Large-Kernel Attention,LKA),并基于LAK提出一种新的简单且有效的视觉主干网络 Visual Attention Network (VAN)。

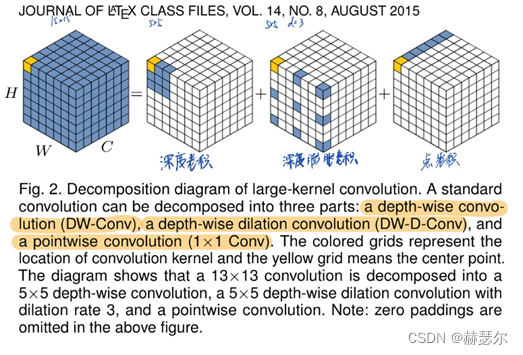

(1)大核卷积的分解:与MobileNet有相似之处,MobileNet将标准卷积分为为两部分,一个深度卷积和一个点卷积(1 × 1 Conv)。而LKA将卷积分解为三部分:深度卷积、深度扩张卷积、和点卷积。

LKA将一个K×K卷积分解为一个k/d×k/d的深度卷积、一个(2d−1)×(2d−1)深度膨胀卷积(扩张率为d)和一个1×1卷积。通过上述分解,可以捕捉到计算成本和参数很小的远程关系。在获得远程关系后,可以生成注意力图。

class LKA(nn.Module):

def __init__(self, dim):

super().__init__()

self.conv0 = nn.Conv2d(dim, dim, 5, padding=2, groups=dim)

self.conv_spatial = nn.Conv2d(dim, dim, 7, stride=1, padding=9, groups=dim, dilation=3)

self.conv1 = nn.Conv2d(dim, dim, 1)

def forward(self, x):

u = x.clone()

attn = self.conv0(x)

a

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3406

3406

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?