文章概况

先给出workflow,直观的进行描述:

这篇文章是基于census transform的改进的SGM算法。开头将左右图像进行census correlation就不必说了,然后经过改进的SGM进行代价聚合,并得到视差图,这里的改进是参考的另一篇文章《An optimized software-based implementation of a census based stereo matching algorithm》,感兴趣的话可以去阅读以下,主要就是牺牲一点准确度,达到降低时间复杂度和内存占用率的目的。然后进行 置信度检测和纹理检测,把通过两个检测的像素点的视差保留,其他都置为0,从而得到的是初始视差图。然后就视情况分开两步走了:

- 对于真实场景,根据纹理的强弱,对纹理图像进行分割。然后在分割块内,利用有效的视差进行视差平面的拟合。然后判断分割块是否可用于视差优化,如果可以,则用视差平面对其视差值进行计算,如果不能,则该分割快不进行视差优化。

- 对于middleburry数据集,用mean-shift进行分割。后面的原理与真实场景一样。

最终得到的是优化后的视差图。

1、census correlation

就是普通的census transform,然后用汉明距离进行代价计算。

2、Modified Semi-Global Matching

这部分看论文吧,总的来说就是牺牲准确度,换取计算效率和空间效率。这里涉及到一个参数 n r n_r nr。

3、Confidence and Texture Check

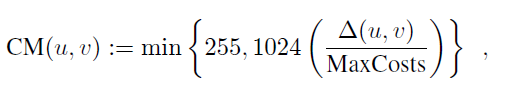

Confidence :

Δ

(

u

,

v

)

\Delta(u,v)

Δ(u,v)是指最小的两个聚合代价的差值,MaxCosts是最大可能的聚合代价,这个是一个上界,跟计算census transform时的窗口大小有关。设置255只是为了最多用一个字节来存储这个值。

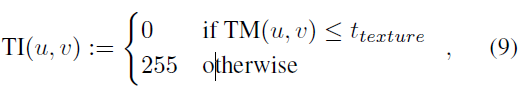

Texture :

这里就是计算n * m区域内的灰度的方差,方差小于一定阈值的就是弱纹理区域。

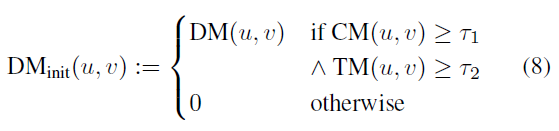

check :

置信度高于一定阈值以及纹理方差大于一定阈值的像素点保留视差值,其他的点的视差都设为0.这样就得到了初始视差图。

4、Segmentation and Plane Fitting

这里在概述已经说得挺清楚了。对于彩图的分割可以看关于mean-shift 的论文。

而对于纹理图是基于上面的TM得到的:

然后对纹理图进行纹理分割,分割的规则是将255的区域视为一个大区域,而将0的区域的连通域作为一个区域。

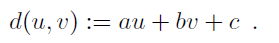

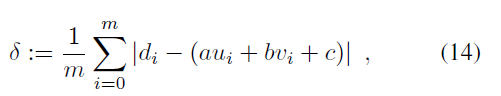

然后就是在区域块内,利用有效视差进行视差平面的计算,计算的规则应该就是逐步计算各个系数:

5、Disparity Map Refinement

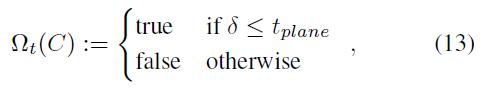

判断区域块是否可以用来进行视差优化。

对于彩色图分割,用下面的准则来判断:

对于纹理分割,用下面的准则来判断:

只有为true的平面才能用来进行视差优化,也就是将该区域内视差为0的点进行视差填充,用上一步计算的视差平面进行填充。

实验结果

借鉴

这里基于视差平面的弱纹理优化可以用来进行弱纹理区域的填充,但可想而知,时间复杂度肯定要提高。

699

699

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?