点击上方“小白学视觉”,选择加"星标"或“置顶”

重磅干货,第一时间送达

3D 对象检测问题在需要决策或与现实世界中的对象交互的机器人应用中尤为重要,3D 对象检测从图像中恢复对象的 6 DoF 姿态和尺寸。虽然最近开发的 2D 检测算法能够处理视点和杂波的较大变化,但准确的 3D 对象检测在很大程度上仍然是一个悬而未决的问题。

文章[1] 提出了一种从单个图像进行 3D 对象检测和姿态估计的方法,他们首先使用深度卷积神经网络回归相对稳定的 3D 对象属性,然后将这些估计与 2D 对象边界框提供的几何约束相结合,以生成完整的 3D 边界框。

给定估计的方向和尺寸以及 3D 边界框的投影,与 2D 检测窗口紧密匹配的约束,它们恢复平移和对象的 3D 边界框。

透视变换

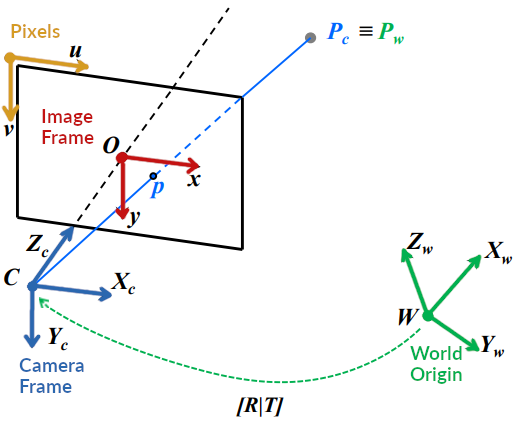

为了从数学上研究这篇文章,我们需要一个坐标系。坐标系主要有两种,一种是相机坐标系,一种是世界坐标系。

在相机坐标系取摄像机的光学中心作为原点,X轴是水平方向,y轴是垂直方向,以及Z轴指向由照相机观察到的方向。世界坐标系的原点可以任意选择,与相机的具体位置无关。

相机模型中经常涉及到四个坐标系:

图像像素坐标系

成像平面坐标系

相机坐标系

世界坐标系

世界坐标系

在环境中选择一个参考坐标系来描述相机和物体的位置,该坐标系称为世界坐标系。相机坐标系和世界坐标系之间的关系可以用旋转矩阵R和平移向量t来描述。假设世界坐标系中P的坐标为(X,Y,Z)_w,则相机坐标系与世界坐标系之间存在如下转换关系:

本文介绍了如何利用深度学习和几何约束进行3D对象检测,特别是从单个图像中估计3D边界框。通过深度卷积神经网络回归3D对象属性,结合2D边界框信息,生成准确的3D边界框。文章探讨了相机坐标系、世界坐标系以及两者之间的转换,同时展示了如何通过约束最小化重投影误差来求解平移,从而提高3D检测精度。

本文介绍了如何利用深度学习和几何约束进行3D对象检测,特别是从单个图像中估计3D边界框。通过深度卷积神经网络回归3D对象属性,结合2D边界框信息,生成准确的3D边界框。文章探讨了相机坐标系、世界坐标系以及两者之间的转换,同时展示了如何通过约束最小化重投影误差来求解平移,从而提高3D检测精度。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?