1、回归分析基本概念:

- 回归分析的特点:

- 变量y称为因变量,处于被解释的特殊地位;

- 因变量y是随机变量,自变量x可以是随机变量,也可以是非随机的确定变量;

- 回归分析侧重于考察变量之间的数量变化规律,并通过一定的数学表达式来描述变量之间的关系,进而确定一个或者几个变量的变化对另一个特定变量的影响程度;

- 线性回归分析的前提条件:线性、独立性、正态性、等方差性;

2、回归分析模型:

- 建立模型的过程:

- 统计描述:应用回归方程定量描述两个变量间的关系;

- 统计推断:进行假设检验;

- 统计应用:利用模型进行统计预测或控制;

- 线性模型的建立过程:

- 绘制散点图,选择估计模型:考察两变量间是否有某种趋势,是直线还是曲线趋势;常见的估计模型有线性模型、分段模型、曲线模型;

- 依照估计模型,得出简单线性回归方程

:其中

表示回归直线在

轴上的截距;

则为回归系数,即直线的斜率,通常我们采用最小二乘法求得:

,然后利用公式

求得

;

- 依照方程,进行统计推断:即方程所来自的总体的直线回归关系是否确实存在,这要看是否对总体有

;

- 回归系数的

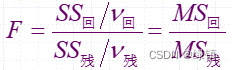

检验/联合假设检验:

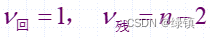

,即回归均方和残差均方之比;其中

,即回归均方和残差均方之比;其中 ,而

,而 指的是

指的是,

指的是

指的是;

- 回归系数的

检验/student

检验:

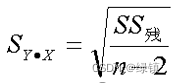

,其中

,而

;值得注意的是,在简单线性回归模型里,由于只有一个自变量,回归模型的方差分析等价于对回归系数进行的

;值得注意的是,在简单线性回归模型里,由于只有一个自变量,回归模型的方差分析等价于对回归系数进行的检验,且

;

- 总体回归系数的区间估计;

- 决定系数:

,即回归平方和与总平方和之比;

,即回归平方和与总平方和之比;

- 回归系数的

- 回归方程的应用:

- 研究因素间的依存关系:自变量和因变量之间是否存在线性关系,或者因变量依赖自变量变化而变化的规律;

- 估计与预测:可用易测定的一组给定的自变量的观测值来推算较难测定的

值;

- 统计控制:是利用回归方程进行逆估计,即因变量

给出一个确定的值或在一定范围内波动时,通过控制自变量的取值来实现;

- 简单线性回归应用的注意事项:

- 在进行简单回归分析之前,应绘制散点图;

- 作回归分析时,要注意两变量间是否存在实际意义;

- 两变量间存在直线关系时,不一定表明彼此之间就存在因果关系;

- 建立回归方程后,须对回归系数进行假设检验;

- 使用回归方程进行估计与预测时,一般只适用于原来的观测范围,即自变量的取值范围,不能随意将范围扩大;

- 在线性回归分析时,要注意远离群体的极端值对回归效果的影响;

- 回归方程检验的注意事项:

- 回归方程是否存在的检验:

检验是检验自变量全体对因变量

是否产生显著影响;

- 所有自变量是否都对因变量有显著影响的检验:当一个回归方程通过了

检验之后,并不能说明这个回归方程中所有的自变量都对因变量

有显著影响,因此,还要对回归系数进行检验;

- 回归方差是否有效性的检验:样本决定系数与残差分析;

- 回归方程是否存在的检验:

3、残差分析:

- 残差分析:一个线性回归方程通过了

检验或

检验,只是表明变量

与

之间的线性关系是显著的,或者说线性回归方程是有效的,但不能保证数据拟合得很好,也不能排除由于意外原因而导致的数据不完全可靠。只有当与模型中的残差项有关的假定满足时,才表明模型有效;

- 残差的概念:实际观测值

与通过回归方程给出的回归值之差

, 残差

可以看做是误差项的估计值;一般认为,如果一个回归模型满足所给出的基本假定,所有残差应是在

附近随机变化,并在变化幅度不大的一条带子内;

- 残差图:以自变量

作横轴,以残差为纵坐标,将相应的残差点画在直角坐标系上,就可以得到残差图;

4、多重共线性:

- 多重共线性:指线性回归模型中的解释变量之间由于存在精确相关关系或高度相关关系而使模型估计失真或难以估计准确;一般来说,由于经济数据的限制使得模型设计不当,导致设计矩阵中解释变量间存在普遍的相关关系。完全共线性的情况并不多见,一般出现的是在一定程度上的共线性,即近似共线性;

- 多重共线性的后果:对线性回归模型

,基本假设之一是自变量,

之间不存在严格的线性关系,如不然,则会对回归参数估计带来严重影响,详细如下:

- OLS估计量的方差增大;

- 难以区分每个解释变量的单独影响;

- 变量的显著性检验失去意义;

- 回归模型缺乏稳定性;

- 多重共线性的诊断与消除:应对回归模型进行共线性诊断,可利用自变量之间的相关系数矩阵,容忍度,方差膨胀因子等统计方法来进行共线性诊断;若自变量之间存在多重共线性,我们可以把自变量从模型中删除以消除多重共线性的影响,并重新建立多重线性回归方程。最好多用几种筛选自变量的方法(如前进法、后退法、逐步回归分析、最优回归子集法等)筛选自变量,结合专业知识和统计学知识,综合分析和比较,从而得到比较优的多重回归方程。

1404

1404

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?