DAIR-V2X: A Large-Scale Dataset for Vehicle-Infrastructure Cooperative 3D Object Detection

论文地址:https://arxiv.org/abs/2204.05575 (CVPR2022)

数据地址:https://thudair.baai.ac.cn/

github:https://github.com/AIR-THU/DAIR-V2X

作者:清华大学人工智能产业研究院、清华大学计算机科学与技术系、百度、中科院

摘要

- 第一个大规模、多模式、多视角的真实场景数据集

- 数据集的困难

- 时间同步

- 空间同步

- 数据传输成本

- 一个时间补偿融合框架,Time Compensation Late Fusion (TCLF)

简介

- 自动驾驶的安全挑战

- 没有全局感知

- 没有长距离感知

- 基础设备+车端设备=Level 5 自动驾驶

- 能够提供全局感知,实现视野增强,去除盲点

贡献

- 开源这个数据集

- 车路协同感知3D检测

- 证明了协同感知的有效性,并且建立了基线模型

相关工作

- 自动驾驶数据集

- 原来的数据集中没有 车路协同的数据集

- 3D目标检测

- 基于2D图像的3D检测 (ImV oxelNet)

- 基于点云的3D检测(PointPillars, SECOND, 3DSSD)

- 多模态的3D检测(点云和图像)(Point-painting and MVXNet)

- 困难点:盲点、长距离感知

- 多传感器融合

- 前期融合(early fusion)数据级融合,原始数据直接融合()

- 中期融合( intermediate fusion)特征级融合,将模型提取出来的特征进行融合()

- 后期融合(late fusion)决策级融合(本文基线采用),将模型的输出信息进行融合()

- 车路融合感知

- V2X技术在实际中的运用

DAIR-V2X数据集

- 采集设备

- 坐标系

- 数据采集

- 数据采集

- 数据标注

- 隐私保护

任务&评估

- 与传统3D目标检测相比,具有新特征

- 需要权衡速度与精度(大量原始数据传输,会导致传输代价增大,难以实现)

- 由于异步触发以及传输时间消耗,导致时空同步误差

- 时间同步误差:

- |tv − ti| ≤ 10ms 同步误差10ms

- 车路协同的3D目标检测

- 真值怎么确定?车端与路端

- 同步与异步之间的时间间隔

- 以轨迹id进行位置估计作为一个准确的位置

- 评估指标:

- 检测精度(AP) 以车为一个中心的矩形区域[0, -39.12, 100, 39.12]

- 传输代价AB (Average Byte)(传输时间花销)

基准测试

-

VIC3D object detection

-

给了一个baseline,需要学习,复现

-

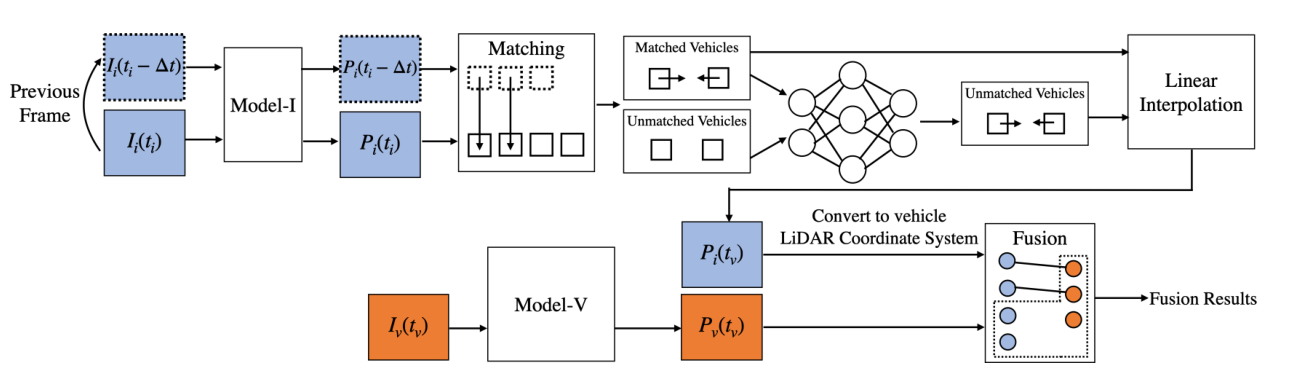

Time Compensation Late Fusion (TCLF) framework

- 估计路侧端两帧之间的速度

- 估计路侧端两帧之间的状态

- 在后期进行融合

-

-

对比实验说这个3个问题

- 车路协同是比单一有效的

- 时间补偿是有效的

- 数据级融合AP>特征级融合>决策级融合

-

SV3D Detection 单个视角的目标跟踪

总结

- 提出一个大的真是车路协同数据集

- 相较于传统的3D目标检测任务,考虑到时间同步,从而传输速率需要考虑

- 提出了时间补偿网络

- 给了基线模型,方便大家比较

学习心得:

- 写作感觉通俗易懂

- 做数据很大,是填补了车路协同感知的空白,并且开源,值得好评

- 数据做了几个大的基础分析(数据级融合,特征级融合,决策级融合的AP比较)(车路协同感知与单视角感知比较)(时间同步的比较)

- 数据做得质量很高,进行时间同步了,非常值得学习

- 数据之间的传输速率,是需要考虑的重点,传感器之间的时间同步问题,也需要仔细研究。

- 依托该数据,可以做3D的目标检测与跟踪,是一个很不错的选择。

2388

2388

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?