先看一段代码:

import torch

import torch.nn as nn

a=torch.tensor([1,2],dtype=torch.float32)

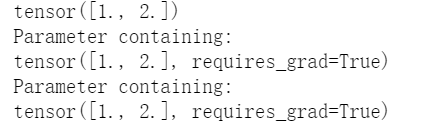

print(a)

print(nn.Parameter(a))

print(nn.parameter.Parameter(a))

结论:

- nn.Parameter=nn.parameter.Parameter

- parameter本质仍然是一个tensor。

- nn.Parameter的作用是:将一个不可训练的类型Tensor转换成可以训练的类型parameter,并且会向宿主模型注册该参数,成为一部分。即

model.parameters()会包含这个parameter。从而,在参数优化的时候可以自动一起优化,这就不需要我们单独对这个参数进行优化啦。

其中2的证明如下:

不少童鞋会想这个nn.Parameter(tensor)和对一个tensor直接进行`requires_grad=True`有什么区别?这两者不是一样的! 即下面的w1和w2功能是不一样的:

#对一个tensor直接进行`requires_grad=True`

w1=torch.tensor([1,2],dtype=torch.float32,requires_grad=True)

#nn.Parameter(tensor)

a=torch.tensor([3,4],dtype=torch.float32)

w2=nn.Parameter(a)

功能哪里不一样?其实就是上面说的结论中的第3条,对一个tensor直接进行requires_grad=True确实也变成了可训练的tensor,但这个tensor无法像parameter那样自动包括在 model.parameters()中。

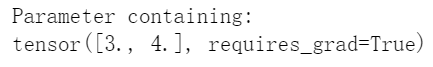

最后,我们做一个验证:

class mod(nn.Module):

def __init__(self):

super(mod,self).__init__()

self.w1=torch.tensor([1,2],dtype=torch.float32,requires_grad=True)

a=torch.tensor([3,4],dtype=torch.float32)

self.w2=nn.Parameter(a)

def forward(self,inputs):

o1=torch.dot(self.w1,inputs)#使用了带梯度的普通tensor

o2=torch.dot(self.w2,inputs)#使用了parameter

return o1+o2

model=mod()

for p in model.parameters():

print(p)

我们发现,只有parameter会在model.parameters()中,这意味这,w1参数需要手动单独优化。

补充:

上述好像只打印了参数,没有打印参数名称,有点low。高级的如下:

model.state_dict()

#或者

for para in model.named_parameters():

print(para)

本文详细介绍了在PyTorch中,nn.Parameter与tensor的requires_grad=True之间的差异。nn.Parameter不仅使张量变为可训练,还会将其自动注册到模型的参数列表中,便于优化。通过实例展示了当直接使用requires_grad=True时,张量不会被包含在model.parameters()中,需要手动优化。总结了nn.Parameter的主要功能,并提供了验证代码以说明其效果。

本文详细介绍了在PyTorch中,nn.Parameter与tensor的requires_grad=True之间的差异。nn.Parameter不仅使张量变为可训练,还会将其自动注册到模型的参数列表中,便于优化。通过实例展示了当直接使用requires_grad=True时,张量不会被包含在model.parameters()中,需要手动优化。总结了nn.Parameter的主要功能,并提供了验证代码以说明其效果。

875

875

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?