model.py文件:

# -*- coding: utf-8 -*-

# @Author : XZC

# @Time : 2022/12/5 12:14

import torch

from torch import nn

# 搭建神经网络

class XZC(nn.Module):

def __init__(self):

super(XZC, self).__init__()

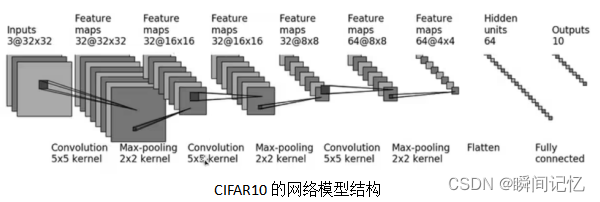

self.model=nn.Sequential(

# in_channels,out_channels,kernel_size,stride,padding

nn.Conv2d(3,32,5,1,2),

nn.MaxPool2d(2),

nn.Conv2d(32,32,3,1,2),

nn.MaxPool2d(2),

nn.Conv2d(32,64,5,1,2),

nn.MaxPool2d(2),

nn.Flatten(),

nn.Linear(64*4*4,64),

nn.Linear(64,10)

)

def forward(self,x):

x=self.model(x)

return x

if __name__ == '__main__':

xzc=XZC()

input=torch.ones((64,3,32,32))

output=xzc(input)

print(output.shape)train.py文件:

# -*- coding: utf-8 -*-

# @Author : XZC

# @Time : 2022/12/5 11:49

import torchvision

from torch import nn

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

from model import *

# 准备数据集

train_data=torchvision.datasets.CIFAR10(root='data',train=True,transform=torchvision.transforms.ToTensor(),

download=True)

test_data=torchvision.datasets.CIFAR10(root='data',train=False,transform=torchvision.transforms.ToTensor(),

download=True)

# length 长度

train_data_size=len(train_data)

test_data_size=len(test_data)

print("训练数据集的长度:{}".format(train_data_size))

print("测试数据集的长度:{}".format(test_data_size))

# 利用DataLoader来加载数据集

train_dataloader=DataLoader(train_data,batch_size=64)

test_dataloader=DataLoader(test_data,batch_size=64)

# 搭建神经网络,model.py文件

# 创建网络模型

xzc=XZC()

# 损失函数

loss_fn=nn.CrossEntropyLoss()

# 优化器

learning_rate=0.01

optimizer=torch.optim.SGD(xzc.parameters(),lr=learning_rate)

# 设置训练网络的一些参数

# 记录训练的次数

total_train_step=0

# 记录测试的次数

total_test_step=0

# 记录训练的轮数

epoch=10

# 添加tensorboard

writer=SummaryWriter("logs_train")

for i in range(epoch):

print("----------第{}轮训练开始----------".format(i+1))

# 训练步骤开始

# xzc.train()

for data in train_dataloader:

imgs,targets=data

outputs=xzc(imgs)

# 计算真实值与目标值之间的误差

loss=loss_fn(outputs,targets)

# 优化器优化模型

optimizer.zero_grad()

loss.backward()

optimizer.step()

total_train_step=total_train_step+1

# loss.item()将值转换成真实数字

if total_train_step%100==0:

print("训练次数:{},loss:{}".format(total_train_step,loss.item()))

writer.add_scalar("train_loss",loss.item(),total_train_step)

# 测试步骤开始

# xzc.eval()

total_test_loss=0

total_accuracy=0

with torch.no_grad():

for data in test_dataloader:

imgs,targets=data

outputs=xzc(imgs)

loss=loss_fn(outputs,targets)

total_test_loss=total_test_loss+loss.item()

accuracy=(outputs.argmax(1)==targets).sum()

total_accuracy=total_accuracy+accuracy

print("整体测试集上的loss:{}".format(total_test_loss))

print("整体测试集上的正确率:{}".format(total_accuracy/test_data_size))

writer.add_scalar("test_loss",total_test_loss,total_test_step)

writer.add_scalar("test_accuracy",total_accuracy/test_data_size,total_test_step)

total_test_step=total_test_step+1

#保存每一轮的模型

torch.save(xzc,"xzc_{}.pth".format(i))

print("模型已保存")

writer.close()

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?