class RGCNConv(in_channels: Union[int, Tuple[int, int]],

out_channels: int, num_relations: int,

num_bases: Optional[int] = None,

num_blocks: Optional[int] = None,

aggr: str = 'mean', root_weight: bool = True,

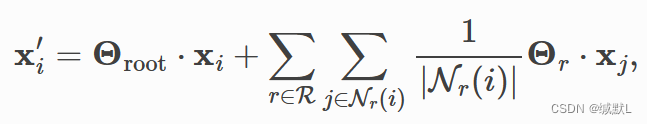

is_sorted: bool = False, bias: bool = True, **kwargs)公式:

in_channels:每个输入样本的大小。元组对应于源维度和目标维度的大小。在没有给定输入特征的情况下,这个参数应该对应于图中的节点数。

out_channels:每个输出样本的大小。

num_relations:关系的数量。

num_bases:这一层将使用基分解正则化方案,其中num_bases表示要使用的bases的数量。

(默认值:None)

num_blocks:如果设置,该层将使用block-diagonal-decomposition正则化方案,

其中num_blocks表示要使用的块数量。(默认值:None)

aggr:要使用的聚合模式 ("add", "mean", "max"). (default: "mean")

root_weight :如果设置为False,则该层不会将转换后的根节点特征添加到输出中。(默认值True)

is_sorted :如果设置为True,则假设edge_index按照edge_type排序。这避免了数据的内部重新排序,可以提高运行时间和内存效率。(默认值:False)

bias:如果设置为False,层将不会学习加性偏差。(默认值True)

**kwargs:conv.messageppassing的附加参数。

本文详细解释了RGCNConv类的参数,包括输入通道数、输出通道数、关系数量、基分解和块分解正则化选项、聚合模式、根节点权重、排序策略以及偏置项。它是一个用于图卷积网络的构建模块,提供深度学习在图数据处理中的灵活性。

本文详细解释了RGCNConv类的参数,包括输入通道数、输出通道数、关系数量、基分解和块分解正则化选项、聚合模式、根节点权重、排序策略以及偏置项。它是一个用于图卷积网络的构建模块,提供深度学习在图数据处理中的灵活性。

1756

1756

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?