TCSD Triple Complementary Streams Detector for ComprehensiveDeepfake Detection

主要贡献

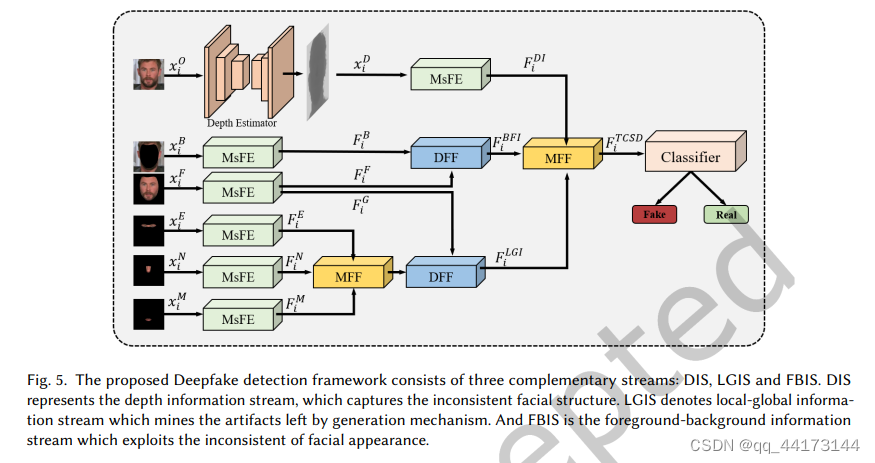

现有的人脸检测方法没有从全局角度考虑检测问题、没有利用多种信息之间的相关性。本文设计了一个深度信息估计模块来提取深度信息(DI)。通过提取图像前景与背景信息的不一致性及局部信息与全局信息(FBI、LGI)的不一致性,以获得更有效的伪造线索。此外,我们设计了基于注意力的多尺度特征提取模块(MsFE),从深度信息、前景背景信息和局部全局信息中充分提取特征。最后,提出了两种基于注意力的特征融合模块(DFF, MFF),实现伪造特征的自适应融合。得到一个三流互补检测器TCSD。

背景介绍

Deepfake的生成过程与相机成像过程完全不同,必然会留下篡改痕迹。在此之前,许多基于手工特征的方法被提出,例如:不可信的镜面反射,不自然的眨眼,头部姿势、边缘拼接痕迹、光流、心跳,嘴唇的动作等等。随着技术的改进这些手工特征都可以被技术手段掩盖。至于早期基于神经网络的方法都比较粗糙。包括MesoNet,XceptionNet ,递归神经网络(RNN)。基于补丁的方法更加关注本地的伪造模式。基于注意力的方法集中于放大有用的特征;同时对于帧的分析工作更加细化,如分析像素与区域之间的关系、时空不一致、3D分解和自洽性等。此外,通过应用模糊和压缩增强,有助于获得一般化的痕迹来检测。当前方法多数集中于单一的线索,如颜色空间伪像,视觉不一致,以及频域伪影.然而,Deepfake技术破坏了视频中包含的多域信息之间的一致性。

目前存在的问题以及研究方向

一方面,需要挖掘深度伪造检测的新视角。另一方面,是否可以进一步探索图像中包含的多视角信息的相关性。鉴于此,我们设计了一个新颖的框架,专注于挖掘更多的互补特征来检测Deepfake。本文一方面贡献了一个检测的新视角:深度信息DI;另外一方面结合前景-背景信息FBI、局部-全局信息LGI设计出一个高效的多尺度特征提取模块。最终结合两个模块进行检测。

创新点(灵感来源)

- 真实图像的深度信息DI会更加的连贯,更清晰的反应人脸面部特征,而deepfake由于后期处理会显的模糊。

- 融合不同角度的多种特征。

相关工作

多媒体篡改方式

- 早期:在3维空间中修改人脸的特征点,如Face2Face。

- 基于图形的方法:面部交换,首先使用稀疏检测的人脸标志提取人脸区域,然后使用输入图像的纹理来最小化投影形状和局部标志之间的差异。最后,渲染模型与图像混合,并进行颜色校正。对所有源帧和目标帧执行这些步骤,直到视频结束。

- 传统的生成方法只能遵循固定模式,使得其看起来不太真实。

- 深度学习技术成为当下主流。Deepfakes是第一个使用深度学习进行人脸交换的算法,它为源人脸和目标人脸训练单独的autoencoder,在转换阶段使用目标人脸的解码器对源目标人脸的编码人脸特征进行解码,达到人脸交换的目的。Korshunova提出了一个框架,将输入身份转换为目标身份,同时保留姿势、面部表情和光照。Bao等人提出了一个基于生成对抗网络(GAN)的框架来分开人脸的身份和属性,以便在开放域中重新组合不同的身份和属性来进行身份保持人脸合成。Nirkin等人[48]提议FSGAN换脸重演。变脸者可以处理面部遮挡,该网络被训练成以自我监督的方式恢复异常区域,而无需任何人工注释。

多媒体检测方式

- Deepfake大致可以分成两类:基于手工特征的方法和基于深度学习的方法。大多数基于手工特征的方法旨在发现高级视觉伪像,这是由于生成方法缺乏生成能力造成的。并且这些手工制作的特点很容易克服。

- 早期提出的简单基于CNN的方法:Afchar等人提出两个浅层网络Meso-4和MesoInception-4来检测Deepfake,这两个网络的层数和参数都很少。Li et al. and Güera et al. 通过RNN考虑时间信息,发现篡改涉及修改单个图像和将多个图像编码到视频中,从而导致时间上的不一致。但是这些方法提取的特征都比较粗糙。为了更细致的提取侦查线索,张等人。[67]提出了一个模拟器来模拟人工智能生成图像的频域中的棋盘状伪像,这是由神经网络的上采样操作引起的。然后,由模拟器生成的图像训练的检测器可以有效地检测合成图像。在[11],Chen等人提出了MagDR,这是一种用于防御Deepfake对抗攻击的掩模引导的检测和重建流水线。在[45],Chugh等人提出了一种基于音频和视觉模态之间的不相似性的Deepfake视频检测方法,称为模态不一致分数。Mittal等人在[12].他们分析输入视频的音频和视觉模态之间的相似性相关性,并提取两种模态的有效线索来推断真实性。在[42],罗等利用高频噪声进行人脸伪造检测。他们设计了三个模块来提取高频特征。首先是多尺度高频特征提取模块。第二个是残差引导的空间注意模块。最后是跨通道注意模块,用于促进彼此的特征学习。王等人。[62]提出一个基于注意力的数据增强框架,引导检测器提炼和放大其注意力。和在[71],朱等人将人脸图像视为底层3D几何和光照环境介入的产物,并将其分解为计算机图形学视图。在此基础上,他们使用照明结合身份纹理作为面部细节的线索来检测微妙的伪造图案。此外,他们利用监督注意机制来突出处理区域,并引入两个流来利用面部图像和面部细节作为多模态任务。刘等[39提出了一种新的空间相位浅层学习(SPSL)方法,该方法通过结合空间图像和相位谱来捕捉人脸伪造的上采样伪影以提高可移植性。和赵等[68]提出一种多注意力深度伪检测网络,集中于放大不同局部的浅层特征中的细微伪影。韩等[23]提出了一种双流网络来检测视频级的Deepfake,具有处理低质量数据的能力。然而,这些方法侧重于挖掘单视图伪影,而忽略了多视图信息之间的相关性。

- 与上述方法不同该文章致力于探索一个新的视角(DI),使用更加全面的信息完成检测。

提出的框架

DI分析

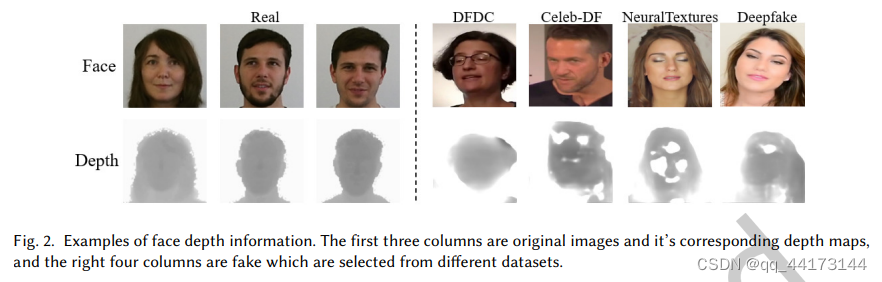

- 图像深度信息:图像深度是视点与人脸表面点之间的距离,反映了人脸的整体结构信息。对于真实图像,相机的成像过程实际上是对场景的视觉采样,这个过程可以记录物体本身的结构信息和物体之间的相关信息。因此,真实人脸提取深度信息可以很好地反映人脸的结构信息。而对于生成图像,Deepfake利用神经网络对低维特征向量进行上采样来生成视觉上高质量的图像,而忽略了深度信息。此外,将生成的人脸融合到原始背景这一操作会影响深度信息的连续性。因此,从深度角度看,Deepfake人脸图像与真实人脸图像存在差异

- 反映全局面部结构信息的图像深度是视点和面部表面点之间的距离。对于真实图像,相机成像过程实际上是对场景的视觉采样,这个过程可以记录物体本身的结构信息以及物体之间的相关信息。因此,真实人脸图像的DI可以反映完整的结构信息。

- 对于生成的图像,Deepfake仅利用神经网络通过对低维特征向量进行上采样来生成视觉上高质量的图像,而忽略了重构的深度信息。因此伪人脸图像的DI是不一致的。此外,生成的人脸被包裹并嵌入到原始背景中。这种操作带来的噪声导致深度信息的连续性被破坏,深度信息不能被正确恢复。

- 3DMM [8]是一个通用的3D人脸模型,用固定的关键点来表示人脸。然而,这些关键点不能完全捕获伪造缺陷,因为当前的伪造方法很好地保持了面部轮廓信息。相比之下,我们的方法通过点对点相关来模拟人脸深度信息,以放大伪造线索,因此我们的方法可以获得比3DMM更好的检测结果。

- 左边三个是原始图像以及其对应的深度信息图,右边四列是从不同数据集选择的假图像

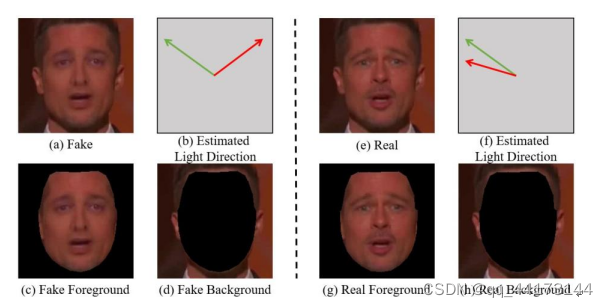

前景-背景信息FBI分析

- 我们将人脸图像中的人脸区域作为前景,其他区域看做背景。通常,图像中的前景-背景部分应该包含高度一致的环境信息,因为环境以相同的方式影响两者。然而,在假人脸中,网络只对人脸部分进行变换,而不对图像中的背景进行编码或变换。从而破坏了前景-背景部分环境信息的一致性。以光照为例进行分析,环境影响最大的是各种类型的光,真实人脸中,标准的反射模型是lambert表面反射模型,即在给定的特定光源下,从任何视点都可以获得相同亮度的表面。即可以通过每个店的估计光线方法的加权平均来获得物体的光线方向。

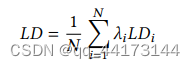

LDi表示第i个点的光线方向,λ是方向估计器的权重,N表示背景处于前景位置的点的数量。通过计算真实图像前景与背景部分之间的光照方向差异很小。因此,所提出的MsFE可以很好地感知FBI,补充深度信息以获得全面的伪造线索。

全局-局部信息LGI分析

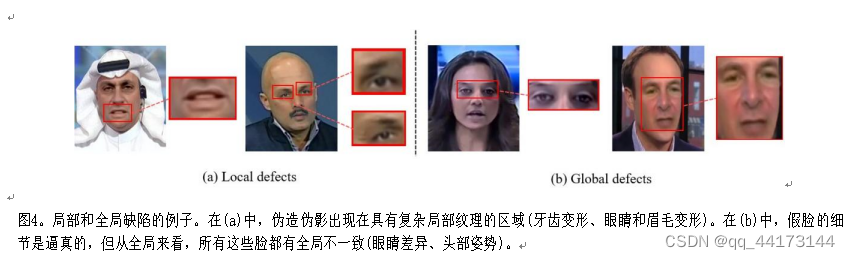

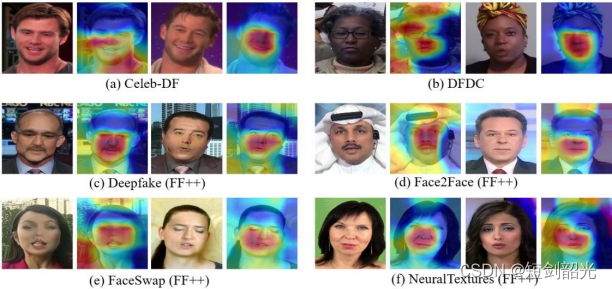

- 全局特征表示图像的整体属性,如颜色、纹理、外观特征或不重叠区域之间的相关性。由于像素级的低视觉特征,全局特征具有良好的不变性。局部特征是从图像的局部区域提取的,包括边缘、点、线等常见的局部特征。局部特征使得能够以更精细的粒度表征局部信息。对于人脸图像,全局特征可以反映不同局部区域之间的联系,而局部特征是局部外观的高维表示。

- 神经网络的生成规则是通过多个反卷积层将低维特征上采样到图像中,这些操作会导致视觉伪像,即使是最先进的生成方法也会有缺陷,特别是在具有更复杂纹理的区域,如眼、鼻和嘴。

- 基于上述分析,MsFE还用于从局部-全局信息中提取特征,以补充深度信息,从而获得全面的伪造线索。

网络结构

整体架构

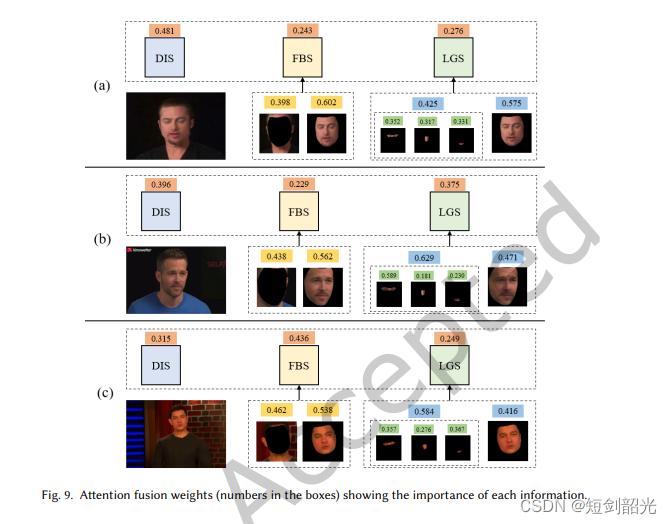

提出了三个互补流的TCSD——DIS、FBIS和LGIS。DIS感知面部结构不一致,FBIS挖掘假面部区域(前景)和真实背景之间的差异,而LGIS利用局部和全局面部外观之间的相关性来挖掘相互作用以捕捉伪像。这三个特征被用来导出用于检测的最终特征。

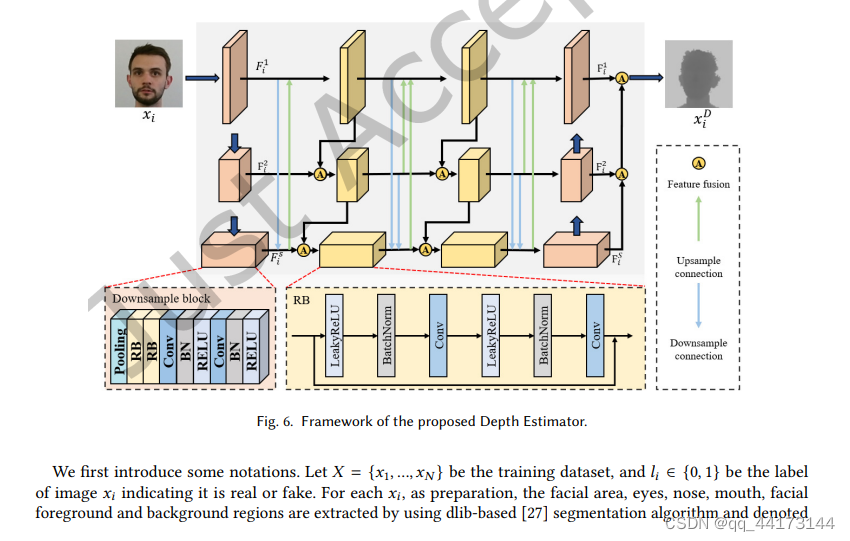

深度估计器的框架Depth Estimator

- 提出多状态深度估计模块。并且遵循多分支模式,允许不同状态下多个互连分支的通信和融合。

- 首先构造标准化的编码解码生成过程,以单个RGB图像作为输入,每个卷积块的输出被视为一个尺度。

- 最后通过残差模块(RB)不同尺度的特征相互作用以导出强调的尺度特征,上述尺度特征是为了获得像素级深度图。

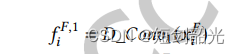

- 在深度估计器之后的处理中,为了有效平衡特征之间的关系并且生成更具鉴别性的特征,采用基于注意力的双特征模块DFF。首先将不同特征映射到相同的维度上面,然后计算相互作用权重系数,接下来原特征的引入是为了稳定网络的训练。整个过程可以表示为:

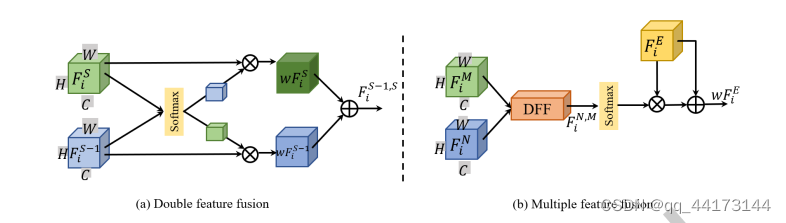

双特征融合模块DFF

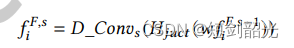

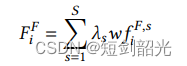

DFF包括三个功能 - 融合DI估计器中的不同状态信息 - 融合FBI - 融合LGI- 多特征融合模块MFF包含两个功能 - 融合眼睛、鼻子、嘴巴信息以获得局部信息(a)

- 融合3个互补信息用于检测特征(b)

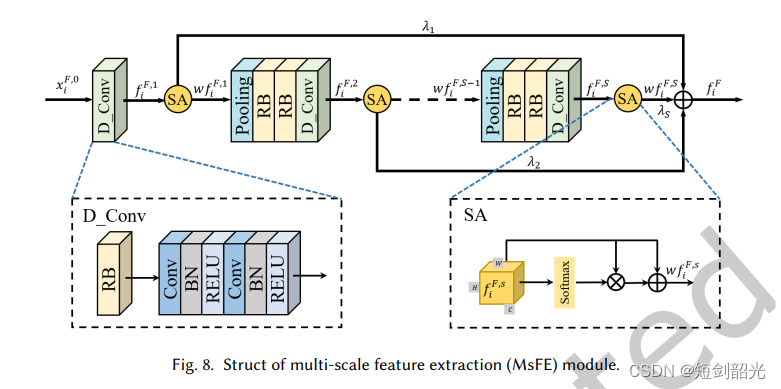

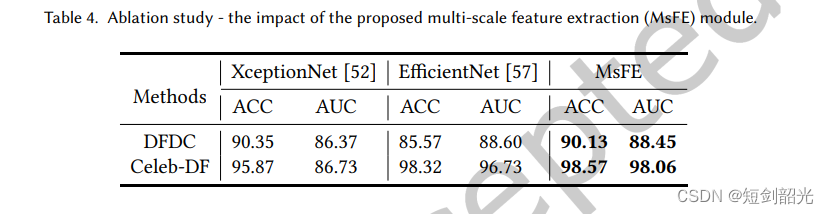

多尺度特征提取模块MSFE

其用于从不同的尺度阶段有效地收集重要信息。

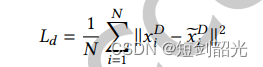

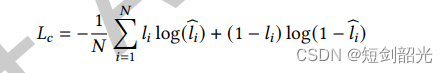

损失函数

DIS中深度估计是一个标准的回归问题,所以我们采用均方误差(MSE)作为损失函数

在分类阶段我们使用全局二元交叉熵作为损失函数:

实验过程

- 数据集选择:FaceForensics++ , Celeb-DF (v2) ,DFDC [16], DeeperForensics 1.0 and WildDeepfake

- 为了提高运算效率,减少一些无关信息对判别的干扰,从原始图像中裁剪出包含丰富背景信息的人脸区域。在深度信息估计阶段,所有人脸区域和深度背景的大小调整为64 × 64。而在伪造检测阶段,所有人脸区域大小调整为64 × 64。在RGB上,图像都是从0到255的整数RGB表示。

- 当数据集不够大时,应该应用数据扩充。我们随机旋转,移动,翻转图像。通过数据增强改善数据集中的相关数据,可以防止网络学习不相关的特征,提高整体性能。

- 两阶段的训练策略。在第一阶段,我们仅优化深度估计器,并使用“He initialization”来初始化网络权重方法。我们设置深度估计器中的尺度数= 5,深度估计器中的状态数= 2.在估计器和MsFE中使用的每个残差块中的卷积层具有64个滤波器,后跟具有负斜率值0.1的LeakyReLU。批量大小设置为256。我们使用ADAM优化器的初始学习速率为10E-4,在每100步后衰减成0.9。训练过程在100批次后结束。

- 在第二阶段,我们初始化并优化互补流网络。首先,确定深度估计器的参数。其次,我们训练三重互补流网络。值得注意的是,深度估计模块仅在真实数据上学习,而不使用数据增强来避免干扰。在第二阶段,使用上述数据扩充来提高框架的泛化能力。我们使用初始学习率为10E-4的ADAM optimizer,它在每100步后衰减10E-6,也是100批次

- 实验环境Nvidia GTX 3090

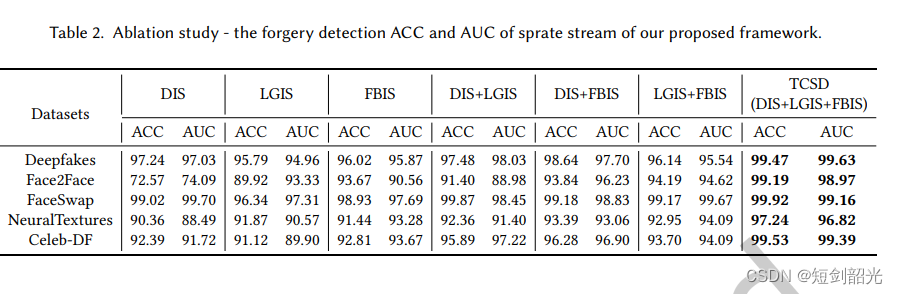

每个视图信息的影响

对每个流分别进行测试,以证明每个框架的有效性

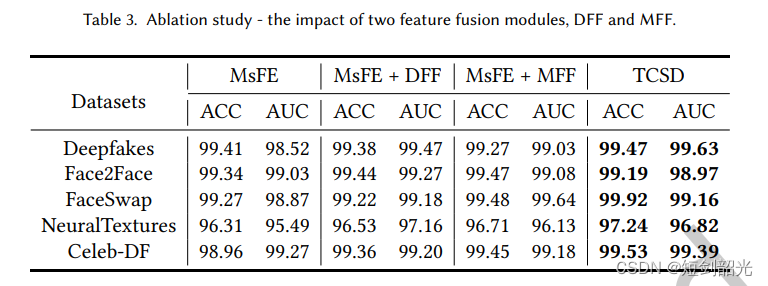

每个模块的影响

对比实验

对于每个数据集,训练集、验证集和测试集中的人脸图像的比例被设置为6∶2∶2。为了更好地展示所提出的TCSD的优越性,我们将结果与检测Deepfake的最新方法进行了比较。

权重展示

6个不同操作集的激活图

693

693

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?