图神经网络面临挑战:

大规模图数据的GNN模型中的节点选择。

为什么使用采样?

图神经网络与其他神经网络不同,给定节点的嵌入递归地取决于其所有邻居的嵌入,并且这种依赖性随着层数呈指数增长。这种现象被成为邻居爆炸。目前已经提出的解决方法:node-wise sampling、layer-wise sampling、subgraph sampling。

固定概率采样的不充分性:

1)固定概率的采样不能保证采样结果是最优的。2)固定概率的采样不能与神经网络的优化更新动态结合。3)泛化能力差。

提出的方案:

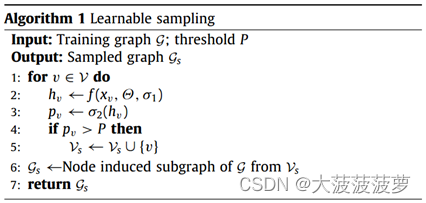

提出一种可学习的采样方法,考虑参数化的采样节点嵌入(包含关于图结构的信息)。该方法可以利用神经网络,比固定概率的采样方法更灵活,更适应优化过程的动态,并且可以推广到更多的图神经网络模型。结构如下图所示:

设x1,x2,…,xN是节点的特征,其中N=|V|是节点的数量。首先,通过GNN层,图的结构信息被包括在节点的嵌入中:![]() 。其中,f 是基于GNN模型的结构信息提取函数,最简单的可以是GCN。θ 为要训练的参数;σ1是激活函数。然后,通过一些概率激活函数 σ2 对包含图结构信息的节点嵌入

。其中,f 是基于GNN模型的结构信息提取函数,最简单的可以是GCN。θ 为要训练的参数;σ1是激活函数。然后,通过一些概率激活函数 σ2 对包含图结构信息的节点嵌入 ![]() 进行概率化,以获得节点 u 的采样概率

进行概率化,以获得节点 u 的采样概率 ![]() 。选取概率大于阈值 p∈(0,1) 的节点构造子图

。选取概率大于阈值 p∈(0,1) 的节点构造子图![]() 。然后,采样节点的特征

。然后,采样节点的特征![]() 在由采样节点形成的子图

在由采样节点形成的子图![]() 上继续向前传播。

上继续向前传播。![]() 。其

。其![]() ,

,![]() 是采样节点的集合。

是采样节点的集合。

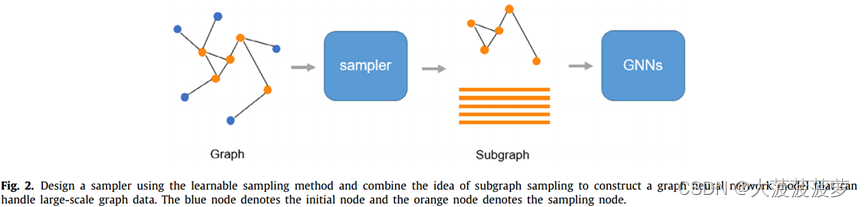

1、与子图采样结合:

设计了一个可学习采样器,使用该采样器来获得子图。如下图所示:

采样器需要设计结构信息提取函数并选择阈值超参数。文章考虑了以下三种基于GNN的结构信息提取函数。1)简单提取函数2)基于图注意力机制的多头注意力提取函数3)基于MixHop GCN的高阶提取功能。阈值超参数的设置为:假设目标采样节点的数量为n,则选择第n个最大的 ![]() 值作为阈值超参数 p。

值作为阈值超参数 p。

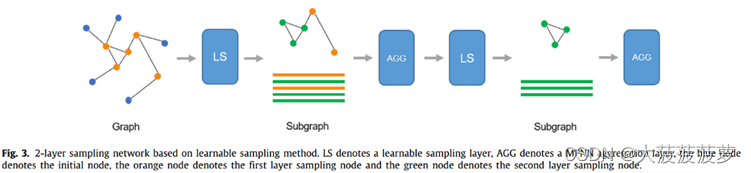

2、与逐层采样结合

基于可学习采样方法的双层采样网络如下图所示,其中结构信息提取函数与上述相同。

参考文献:Zhao W, Guo T, Yu X, et al. A learnable sampling method for scalable graph neural networks[J]. Neural Networks, 2023, 162: 412-424.

7302

7302

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?