这篇文章基于DCN(可变形卷积)提出了一种DCN变体TDAN,隐式的运动补偿机制,flow-free的方法。与VESPCN使用flow-based方法不同。VSR通常的结构都是对齐网络+融合SR网络。在这篇文章中,对齐网络部分提出了改进,融合SR部分还是使用普通的结构,融合采用的是最简单的早期融合。

原文链接:TDAN: Temporally-Deformable Alignment Network for Video Super-Resolution

参考目录:超分之TDAN

TDAN: Temporally-Deformable Alignment Network for Video Super-Resolution

Abstract

这篇文章出发点是:对齐多帧连续图像很重要,但是基于光流flow-based的方式来对齐参考帧与支持帧,很容易出现伪影。于是提出了一种flow-free的方法。

- 由于摄像机或物体的不同运动,参考帧和每个支持帧没有对齐。因此,时间对齐对VSR来说是一个关键的步骤。以前的VSR方法都是基于光流来进行时间对准,但是这种方法非常

依赖于光流估计,如果估计值不准,那么会很大程度的影响到后续图像重建的质量。

为了解决这个问题,作者提出了一种时间可变形对齐网络(TDAN),在不计算光流的情况下,在特征级自适应对齐参考帧和每个支持帧。TDAN的对齐方法是基于DCN的一种变体。与DCN类似,TDAN使用来自参考帧和每个支持帧的特征来动态预测偏移量。通过使用相应的核进行卷积,TDAN网络使支持帧与参考帧对齐。TDAN能够缓解重建过程出现的遮挡和伪影。

VESPCN中对齐模块使用的是STN的变体,原理是学习图像两帧之间的运动估计得到运动矢量,然后通过重采样的方式来恢复支持帧的估计值,并且使其近似于参考帧。这个过程中需要用到图像运动的分析,光流是一定存在的。且输入运动估计模块的是图像本身,所以这个过程是image-wise的。

TDAN中对齐模块使用的是DCN的变体,原理是通过学习特征图像采样位置的偏移来确定偏移后的特征值,并趋近于参考帧的特征,是一种feature-wise的方法,且避免了光流估计。

1 Introduction

在视频超分任务中,由于相机抖动和物体的运动,会导致不同帧间图像发生变化,因此对齐相邻帧图像是必不可少的一个步骤。以往的对齐方式都是基于光流flow-based的方法,但其过于依赖运动估计的准确性,使得光流估计的误差很容易导致输出估计图像产生各种artifacts。

对此本文提出了一种不基于光流flow-free的对齐方法TDAN,一种隐式的运动补偿机制,通过学习支持帧特征位置的偏移,让卷积核提取变换后的特征图新位置像素,再重建支持帧,能够有效的避开光流方法。TDAN具有很强的能力和灵活性,能够处理时态场景中的各种运动条件。

本文的贡献有三个方面:

- 提出了一种

one-stage的特征级可变形对齐网络(TDAN),是一种flow-free方法; - 网络整体由两部分组成:基于DCN的对齐网络TDAN + 融合SR网络,是一种端到端可训练VSR框架;

- 在Vid4数据集上实现了SOTA的表现。

2 Method

2.1 Overview

整体结构:

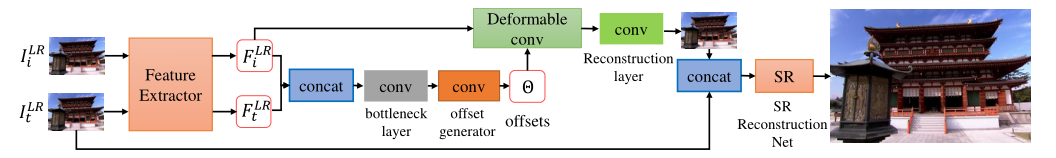

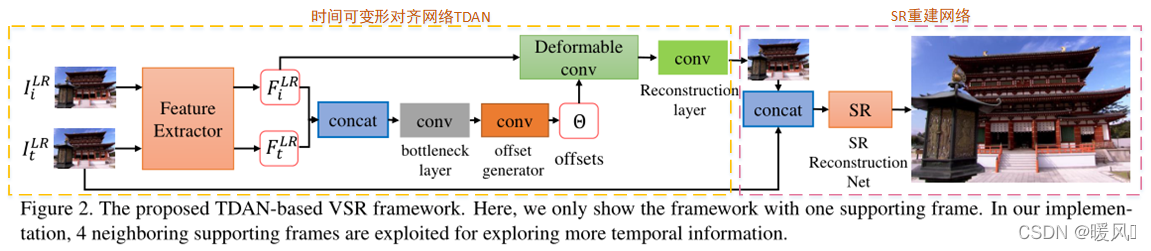

由两个子网络组成:一个用于将每个支持帧与参考帧对齐的时间可变形对齐网络(TDAN)和一个用于预测HR帧的SR重建网络。

接下来用 I t L R ∈ R H × W × C I_t^{LR}\in\mathbb{R}^{H\times W\times C} ItLR∈RH×W×C 表示视频第 t t t帧, I t H R ∈ R s H × s W × C I_{t}^{HR}\in \mathbb{R}^{sH\times sW\times C} ItHR∈RsH×sW×C 表示视频第 t t t帧对应的高分辨率图像,即Ground Truth,其中 s s s为SR放大倍率,而 I t H R ′ ∈ R s H × s W × C I_t^{HR'}\in\mathbb{R}^{sH\times sW\times C} ItHR′∈RsH×sW×C 表示超分的结果。

VSR的目标就是每次将视频中连续的2 N + 1 N+1 N+1帧 { I i L R } t − N t + N \{I_i^{LR}\}^{t+N}_{t-N} {

IiLR}t−Nt+N 输入进网络,超分出 I t H R ′ I_t^{HR'} ItHR′。

在这 2 N + 1 2N+1 2N+1帧中,第 t t t帧 I t L R I_t^{LR} ItLR为参考帧,其余 2 N 2N 2N帧 { I t − N L R , ⋯ , I t − 1 L R , I t + 1 L R , ⋯ , I t + N L R } \{I_{t-N}^{LR},\cdots, I_{t-1}^{LR}, I_{t+1}^{LR},\cdots, I_{t+N}^{LR}\} {

It−NLR,⋯,It−1LR,It+1LR,⋯,It+NLR}为支持帧。

整体网络结构分为两部分:

TDAN对齐网络。对齐物体或相机运动带来的内容不匹配问题。SR重建网络。将对齐后的 2 N + 1 2N+1 2N+1帧进行融合然后超分的过程。

TDAN对齐网络:

对齐网络每次输入2帧,其中一帧是固定参考帧 I t L R I_t^{LR} ItLR,另一帧是支持帧 I i L R , i ∈ { t − N , ⋯ , t − 1 , t + 1 , ⋯ t + N } I_i^{LR},i\in\{t-N, \cdots, t-1,t+1, \cdots t+N\} IiLR,i∈{

t−N,⋯,t−1,t+1,⋯t

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2919

2919

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?