- ICCV 2021

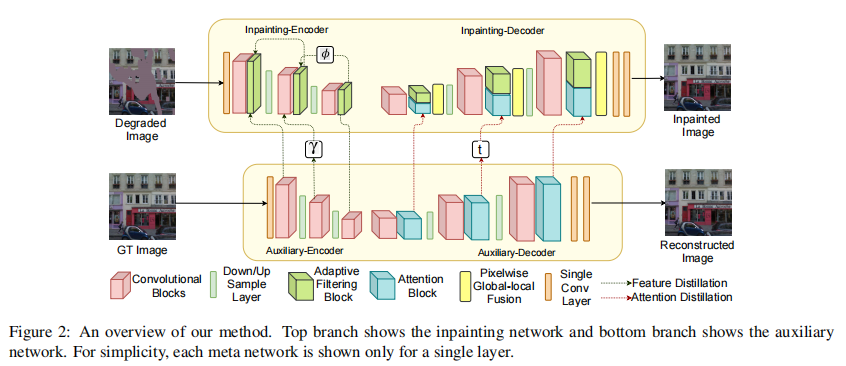

-本文主要工作:①利用知识蒸馏的方式,构建辅助任务AN网络在训练时为修复网络IN提供特征 级监督。

②利用交叉蒸馏CD和自蒸馏技术SD和编码端的completion-block进行精准填充

③在编码段利用Attention Block 和 Pixlewise Globl-Local Fusion Module进行增 强不同区域之间相关性

- 网络结构

主要工作:

- 构建了两个网络IN和AN,两者的骨干网络均为Encoder-Decoder。而后以知识蒸馏的方式,其中AN作为教师模型,IN作为学生模型,利用AN对IN进行特征监督,以此对失真图像进行重建。

-编码器中的监督

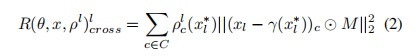

①交叉蒸馏cross-distillation

利用AN网络中的特征(教师)来监督IN网络中的特征(学生),但并非通过特征差来进行特征级监督,而是通过一些简单的卷积层r进行转换,再进行特征差的计算。此外,利用一组全连接层对每一个level级别的特征进行加权,关注更重要的通道。这部分的Loss函数如下:其中M为mask,pc为权重,r为meta-network元网络。

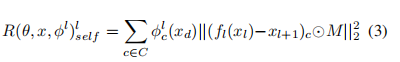

②自蒸馏self-distillation

利用IN网络中深层特征(教师)来监督其浅层网络的特征(学生),与交叉蒸馏的机制大抵一致。但由于size的不同,所以要先经过下采样。这部分的Loss函数如下:

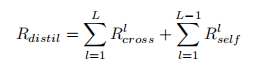

这部分的整体损失函数为:

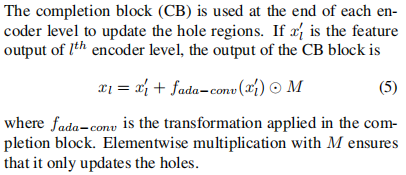

编码器中的Adaptive Completion Block:作者认为encoder层的主要任务有两个:提取未失真区域的信息 和 进行孔洞填充。作者使用了Completion block更新孔洞区域,公式如下。其中adv-conv为自适应卷积层

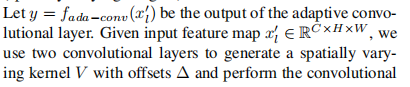

自适应卷积层:

其中y为自适应卷积层的输出,xl 为输入特征图。

- 解码器中利用蒸馏进行注意力转移

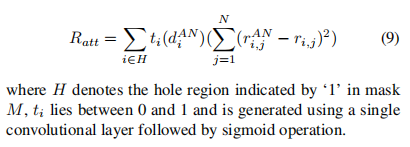

由于AN网络中特征没有被破坏,因此AN中不同的斑块之间的成对相似度是相对准确的。作者利用这些知识,指导IN网络注意力计算。

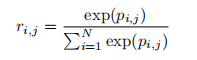

与利用卷积计算attention不同,作者使用矩阵乘法来计算不同patch之间的相似度。不同patch的权重计算公式如下:

![]()

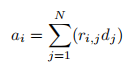

而后,输出可以表示为:

该部分的Loss可以表示为:

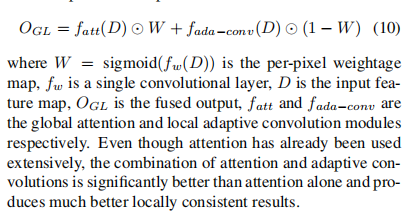

- 像素自适应 全局-局部融合(PGL)

作者提出子啊解码器中直接部署一个注意力模块可能会导致重复和模糊,如缺失区域和背景区域之间存在不连续性。虽然注意力擅长远距离建模,但提取局部特征的能力基奥查。CNN可以较好的捕获边缘和形状等特征。故而借助注意力和CNN进行融合输出:

2973

2973

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?