使用seq2seq模型架构实现英译法任务

前言

学习目标:

- 更深一步了解seq2seq模型架构和翻译数据集.

- 掌握使用基于GRU的seq2seq模型架构实现翻译的过程.

- 掌握Attention机制在解码器端的实现过程.

seq2seq模型架构:

seq2seq模型架构分析:

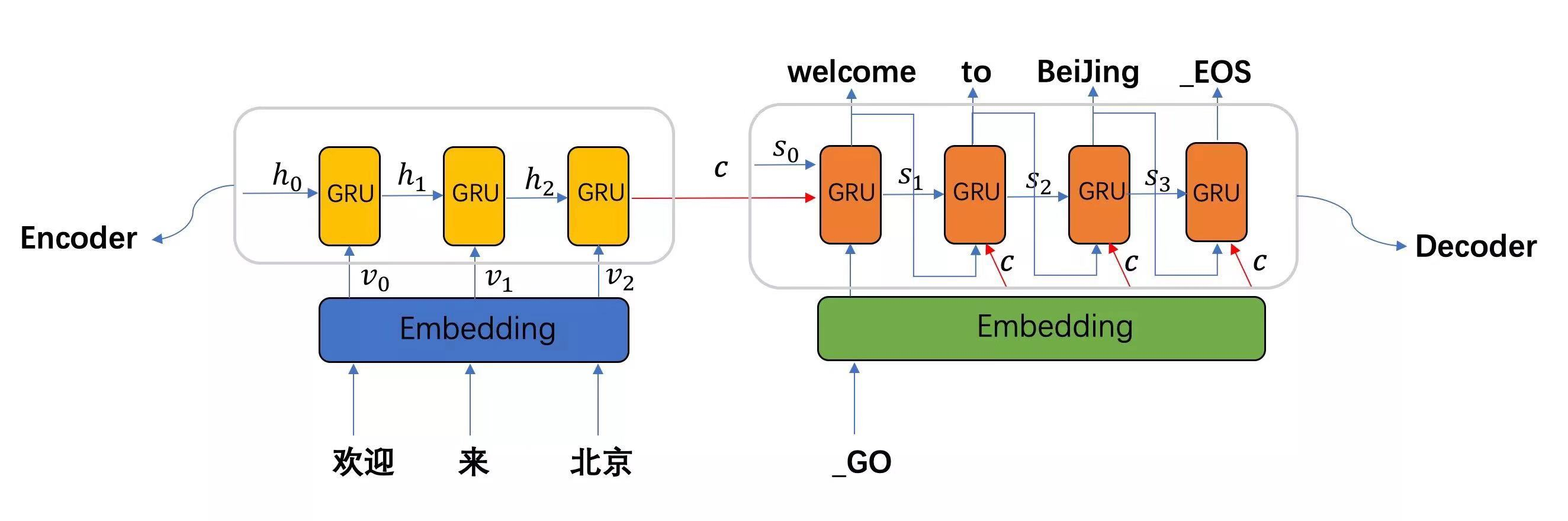

从图中可知, seq2seq模型架构, 包括两部分分别是encoder(编码器)和decoder(解码器), 编码器和解码器的内部实现都使用了GRU模型, 这里它要完成的是一个中文到英文的翻译: 欢迎 来 北京 --> welcome to BeiJing. 编码器首先处理中文输入"欢迎 来 北京", 通过GRU模型获得每个时间步的输出张量,最后将它们拼接成一个中间语义张量c, 接着解码器将使用这个中间语义张量c以及每一个时间步的隐层张量, 逐个生成对应的翻译语言.

翻译数据集:

下载地址

该博客详细介绍了如何利用GRU和Attention机制构建seq2seq模型,实现英文到法文的翻译任务。包括数据预处理、编码器与解码器的构建、模型训练及Attention效果分析。

该博客详细介绍了如何利用GRU和Attention机制构建seq2seq模型,实现英文到法文的翻译任务。包括数据预处理、编码器与解码器的构建、模型训练及Attention效果分析。

订阅专栏 解锁全文

订阅专栏 解锁全文

2145

2145

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?