Simple Contrastive Graph Clustering(简易的对比图聚类)

文章目录

1. 来源

2022 arxiv

2. 动机

对比学习因其良好的性能而在深度图聚类中引起了广泛的关注。

- 然而,复杂的数据扩充和耗时的图卷积操作削弱了这些方法的效率。

为了解决这一问题,作者提出了一个简单的对比图聚类(SCGC)算法,从网络架构、数据增强和目标函数的角度来改进现有的方法。在架构方面,网络包括两个主要部分,即预处理和网络骨干。

- 一个简单的低通去噪操作将邻居信息聚合作为一个独立的预处理,并且只包含两个多层感知器(MLPs)作为主干。

- 对于数据增强,模型没有在图上引入复杂的操作,而是通过设计参数非共享的暹罗编码器和直接干扰节点嵌入来构造同一顶点的两个增强视图。

- 最后,在目标函数方面,为了进一步提高聚类性能,设计了一种新的跨视图结构一致性目标函数,以提高学习网络的判别能力。

3. 模型框架

- 首先通过低通去噪操作对节点属性进行预处理。

- 然后,结构对比模块仅用两个mlp对平滑的节点属性进行编码;

- 并通过设计参数非共享的暹罗编码器和扰动节点嵌入来构建节点嵌入的增强视图。

- 此外,还设计了一种新的面向邻居的对比损失,以保持横视图结构的一致性,从而提高了网络的鉴别能力。

4. 方法介绍

4.1 总览

作者提出了一种简单的对比图聚类(SCGC)算法。SCGC的框架如上图所示。它主要由低通去噪操作和结构对比模块(SCM)两个组件组成。

4.2 低通去噪操作

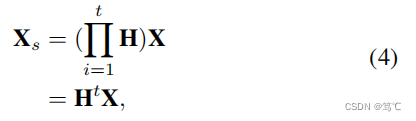

最近的一些工作已经证明了拉普拉斯滤波器可以达到与图卷积运算相同的效果。由于它们的成功,作者引入了一个低通去噪操作,在训练前将邻居信息聚合作为一个独立的预处理。这样,就可以有效地过滤出属性中的高频噪声。具体地说,模型引入了一个图拉普拉斯滤波器:

其中

L

~

\tilde L

L~ 为对称归一化图的拉普拉斯矩阵。随后,叠加 t 层的图拉普拉斯滤波器如下:

其中,

X

s

X_s

Xs表示平滑的属性矩阵。此外,

H

t

H^t

Ht表示堆叠的t层图拉普拉斯滤波器,它可以滤除节点属性中的高频噪声。

通过这种低通去噪操作,过滤掉了属性中的高频噪声,从而提高了聚类性能和训练效率。

4.3 结构对比模块

在本节中,作者设计了结构对比模块(SCM),以保持即使跨两个不同的视图的结构一致性,从而提高了网络的鉴别能力。

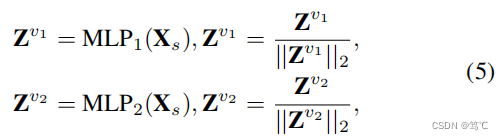

具体来说,作者首先用设计的参数非共享MLP编码器对平滑属性Xs进行编码,然后用

l

2

l^2

l2 -norm对学习到的节点嵌入进行归一化如下:

其中

Z

v

1

Z ^{v_1}

Zv1和

Z

v

2

Z ^{v_2}

Zv2表示学习节点嵌入的两个增广视图。值得一提的是,MLP1和MLP2具有相同的架构,但参数不共享,因此

Z

v

1

Z ^{v_1}

Zv1和

Z

v

2

Z ^{v_2}

Zv2在训练过程中会包含不同的语义信息。

此外,作者通过简单地在

Z

v

2

Z ^{v_2}

Zv2中加入随机高斯噪声,进一步保持了两种视图之间的差异:

其中,

N

∈

R

N

×

d

N∈R^{N×d}

N∈RN×d从高斯分布N(0,σ)中采样。

综上所述,作者通过设计参数非共享编码器,直接扰动节点嵌入,而不是对图引入复杂的操作,构造了两个增强视图 Z v 1 Z ^{v_1} Zv1和 Z v 2 Z ^{v_2} Zv2,从而提高了训练效率。此外,最近的研究表明,复杂的数据在图上的扩充,如加边、掉边和图扩散,可能会导致语义漂移。通过实验也验证了类似的结论。

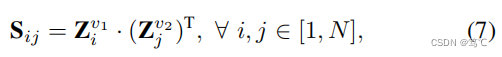

随后,作者设计了一种新的面向邻居的对比损失来保持横视图结构的一致性。具体地说,我们计算了

Z

v

1

Z ^{v_1}

Zv1和

Z

v

2

Z ^{v_2}

Zv2之间的交叉视图样本相似度矩阵

S

∈

R

N

×

N

S∈R^{N×N}

S∈RN×N,公式如下:

其中,

S

i

j

S_{ij}

Sij表示第一个视图中第

i

i

i 个节点嵌入与第二个视图中第

j

j

j 个节点嵌入的余弦相似度。然后,我们强制交叉视图样本相似度矩阵

S

S

S 等于自环邻接矩阵

A

^

∈

R

N

×

N

\hat A∈R^{N×N}

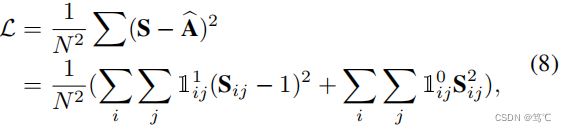

A^∈RN×N,如公式所述:

其中,

1

i

j

1

1^1 _{ij}

1ij1表示如果

A

^

i

j

=

1

\hat A_{ij}=1

A^ij=1,

1

i

j

0

1^0 _{ij}

1ij0表示如果

A

^

i

j

=

0

\hat A_{ij}=0

A^ij=0。在这里,将同一节点的交叉视图邻居视为正样本,而将其他非邻居节点视为负样本。然后把阳性样本拉在一起,同时推开阴性样本。

更准确地说,在式(8)中,第一项迫使节点与起邻居保持相似一致甚至跨越两个不同的视图,而第二项最小化节点和它的非邻居之间的一致性。这种面向邻居的对比目标函数通过保持交叉视图结构的一致性,增强了网络的鉴别能力,从而提高了聚类性能。

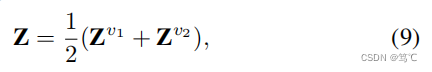

4.4 融合和聚类

在本节中,作者首先以线性的方式融合节点嵌入的两个增强视图,公式如下:

其中,

Z

∈

R

N

×

d

Z∈R^{N×d}

Z∈RN×d表示生成的面向聚类的节点嵌入。然后直接执行K-means算法,得到聚类结果。

4.5 目标函数

该方法的优化目标是在式(8)中得到的面向邻域对比损失 。在训练过程中,使用广泛使用的Adam优化器来最小化目标损失。

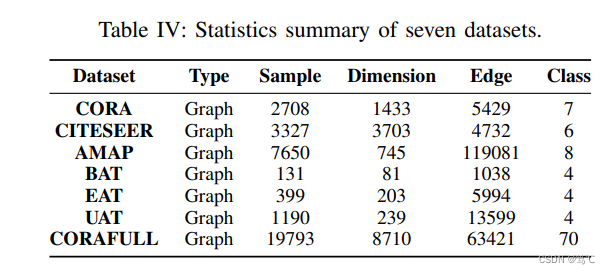

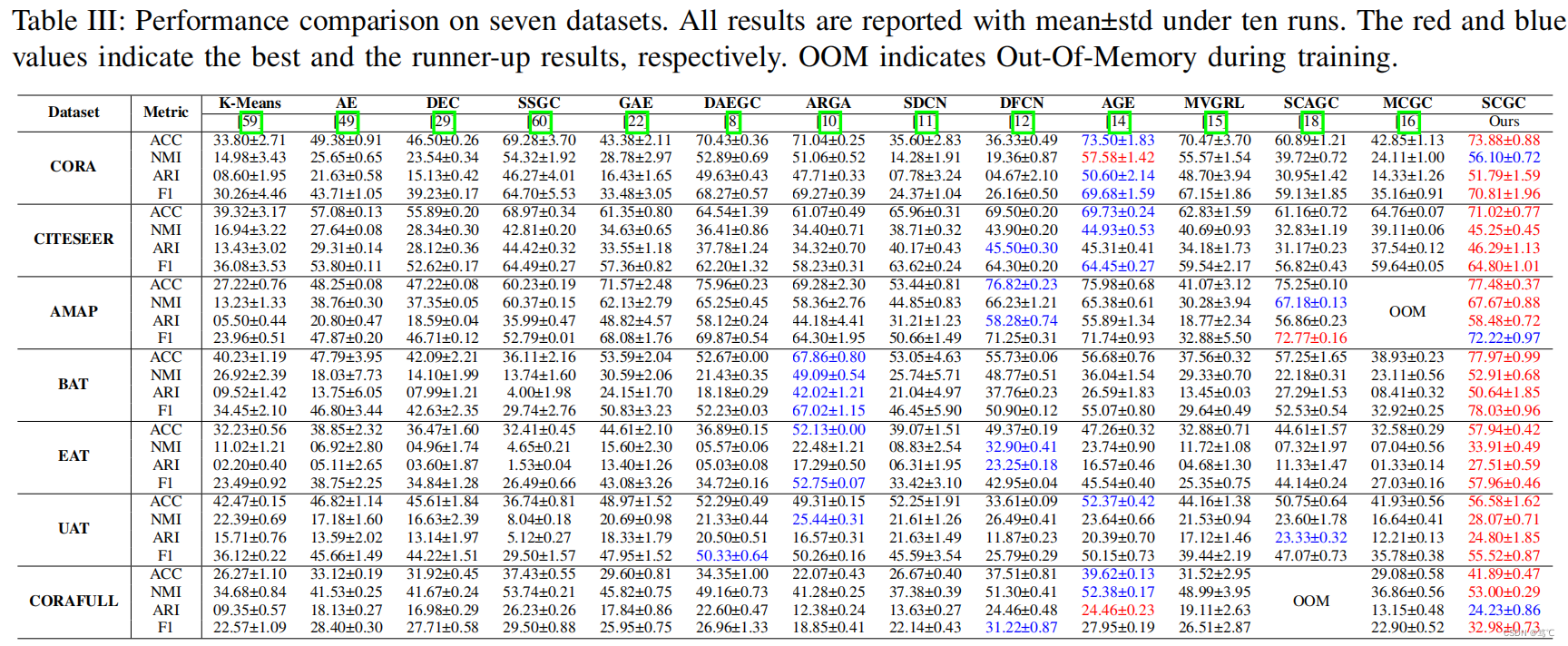

5. 实验

6. 总结

本文提出了一种对比深度图聚类方法,即简单对比图聚类(SCGC),从网络架构、数据增强和目标函数等方面改进了现有的方法。在架构方面,网络主要包括预处理和网络骨干两个部分。具体地说,

- 一个简单的低通去噪操作将邻居信息聚合作为一个独立的预处理。通过此操作,有效地过滤掉了属性中的高频噪声,从而提高了图聚类性能。

- 此外,只有两个mlp作为骨干。

- 对于数据增强,通过设置参数非共享编码器和扰动节点嵌入来构造不同的图视图,而不是在图上引入复杂的操作。

- 此外,作者还提出了一种新的面向邻居的对比损失来保持横视图结构的一致性,从而提高了网络的鉴别能力。

得益于SCGC的简单性,它不需要预训练,并且节省了网络训练的时间和空间。值得注意的是,该算法优于最近的对比深度聚类竞争对手,平均加速速度至少为7倍。在7个数据集上的大量实验结果证明了SCGC的有效性和优越性。今后,为大规模图数据设计深度图聚类方法是值得尝试的。

1128

1128

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?