支持向量机

线性可分:存在一条直线分开

线性不可分:不存在一条直线分开

线性可分:

假设:

用数学严格的定义线性可分

若yᵢ=+1,w₁x₁+w₂x₂+b>0

若yᵢ=-1,w₁x₁+w₂x₂+b<0

用向量形式来定义线性可分

线性可分定义的最简化形式

对于一个训练样本集{(Xᵢ,Yᵢ)},在i=1~N线性可分,是指存在(w,b),使得对于i=1~N,有

yᵢ(wᵀXᵢ+b)>0

支持向量机寻找的最优分类直线应满足:

(1)该直线分开了两类;

(2)该直线最大化间隔

(3)该直线处于间隔的中间,到所有支持向量距离相等。

待求(w,b)

为了推出超平面的优化

以下有两个事实:

用a去缩放(w,b)使得其变成(aw,ab)

最终使得支持向量x₀上有![]()

,而在非支持向量上![]()

注:支持向量指分类中到超平面最近的点

右面的1可以改为任意正数

在最优化理论中,如果一个问题是凸优化问题,我们可以把它当成一个已经解决的问题,因为它有一个唯一的一个全局极值,我们可以应用梯度下降算法得到极值

在最优化理论中,如果一个问题是凸优化问题,我们可以把它当成一个已经解决的问题,因为它有一个唯一的一个全局极值,我们可以应用梯度下降算法得到极值

线性不可分情况

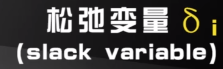

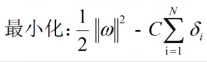

我们需要放松限制条件,对每个训练样本及标签(Xᵢ,Yᵢ)设置一个松弛变量

比例因子C是人为设定的

人为事先设定的参数叫算法的超参数

在实验中要不断变化C的值,同时每个C都要测试算法的识别率,最后选取超参数最大值C。

支持向量机是超参数很少的算法模型

对于线性不可分情况,将特征空间由低维映射到高维,再用线性超平面对数据进行分类

定理

在一个M维空间上随机取N个训练样本,随机的对每个训练样本赋予标签+1,-1,假设这些训练样本线性可分的概率为P(M),当M趋于无穷大时P(M)=1

核函数

不用知道Φ(x)的具体形式

知道K(X₁,X₂)=Φ(X₁)ᵀΦ(X₂)也能完成对测试样本类别的预测

K(X₁,X₂)为核函数

注:核函数不能随便取

原问题与对偶问题

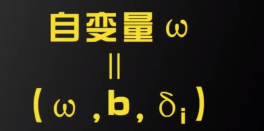

自变量为w是多维向量 f(w)为定义函数

注:截图中L函数中hi的总和是1~M

定义对偶问题

综合原问题与对偶问题的定义得:

定理一:如果w*为原问题解,(a*,b*)是对偶问题的解则:f(w*)>=θ(a*,b*)

将f(w*)-θ(a*,b*)定义为对偶差距 >=0

强队偶定理

如果原问题的目标函数是凸函数,限制条件是线性函数,f(w*)=θ(a*,b*)

若f(w*)=θ(a*,b*),由定理一可以推出,对于所有的i=1~K,要么aᵢ=0,要么gᵢ(w*)=0,这个条件称为KKT条件

因原问题中的限制条件gᵢ(w)<=0,因此将支持向量机的优化问题中的

最终得到

最后得到

由此可以看出,两个限制条件都是线性的,目标函数是凸的,满足强对偶定理

而不等式gᵢ被分成了

不存在hᵢ(w)

所以可以将对偶问题写成

如何化为对偶问题

将获得的三个式子代入到表达中

375

375

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?