机器学习笔记第十一章

什么是集成学习?

Voting Classifier

少数服从多数

Soft Voting

更合理的投票,有权值

要求集合的每一个模型都能估计概率

逻辑回归本身就是基于概率的

KNN

决策树

SVC

Bagging 和 Pasting

每一个子模型不需要太高的准确率

-

取样:放回取样、不放回取样

放回取样(Bagging) 不放回取样(Paasting)

更多和Bagging相关的讨论

OOB OUT-OF-Bag

放回取样导致一部分样本很有可能没有取到

平均大约有37%的样本没有取到

不使用测试数据集

差异化:

随机森林

决策树在节点划分上,在随机的特征子集上寻找最优划分特征

增加随机性

Extra-Tree

更加快的训练速度

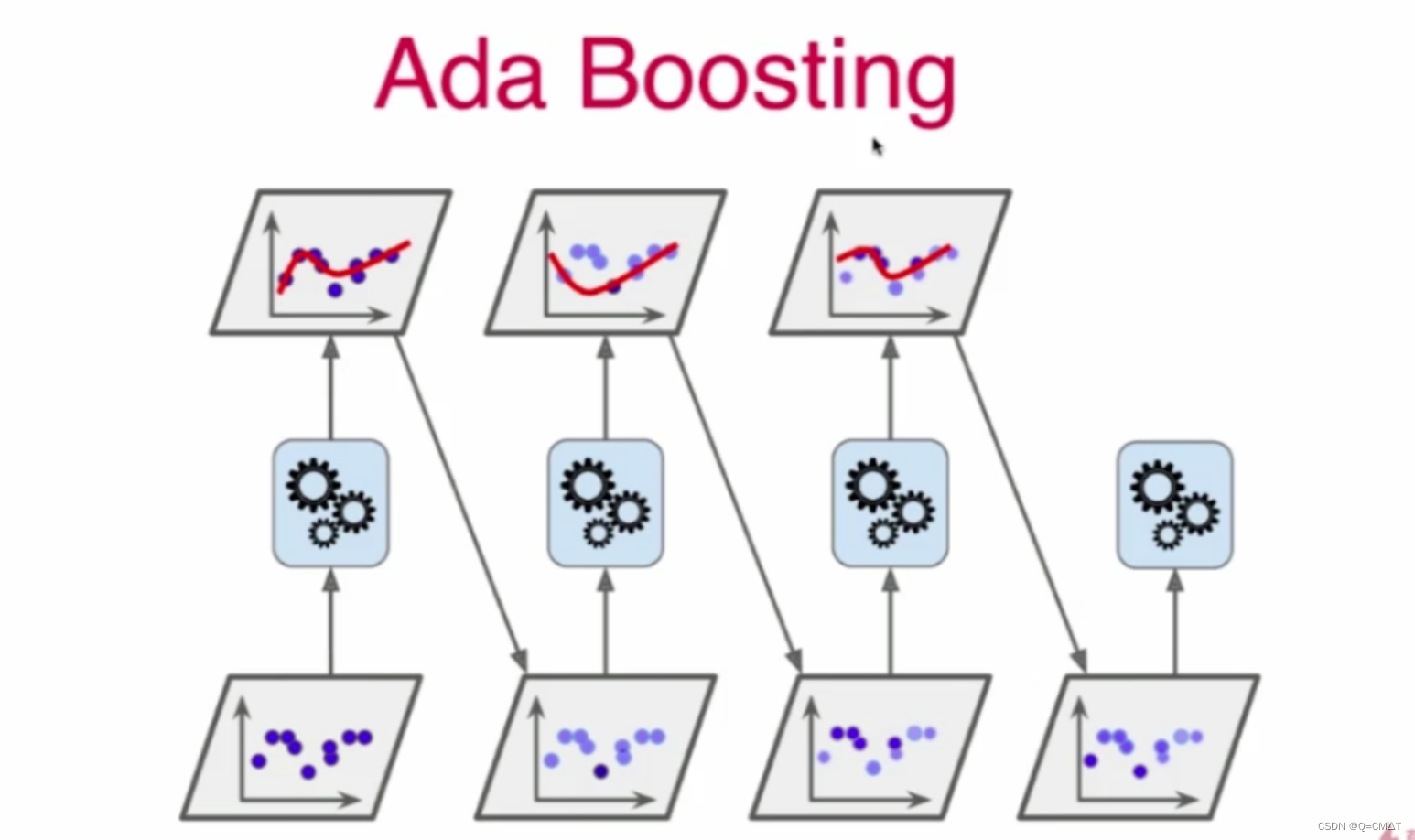

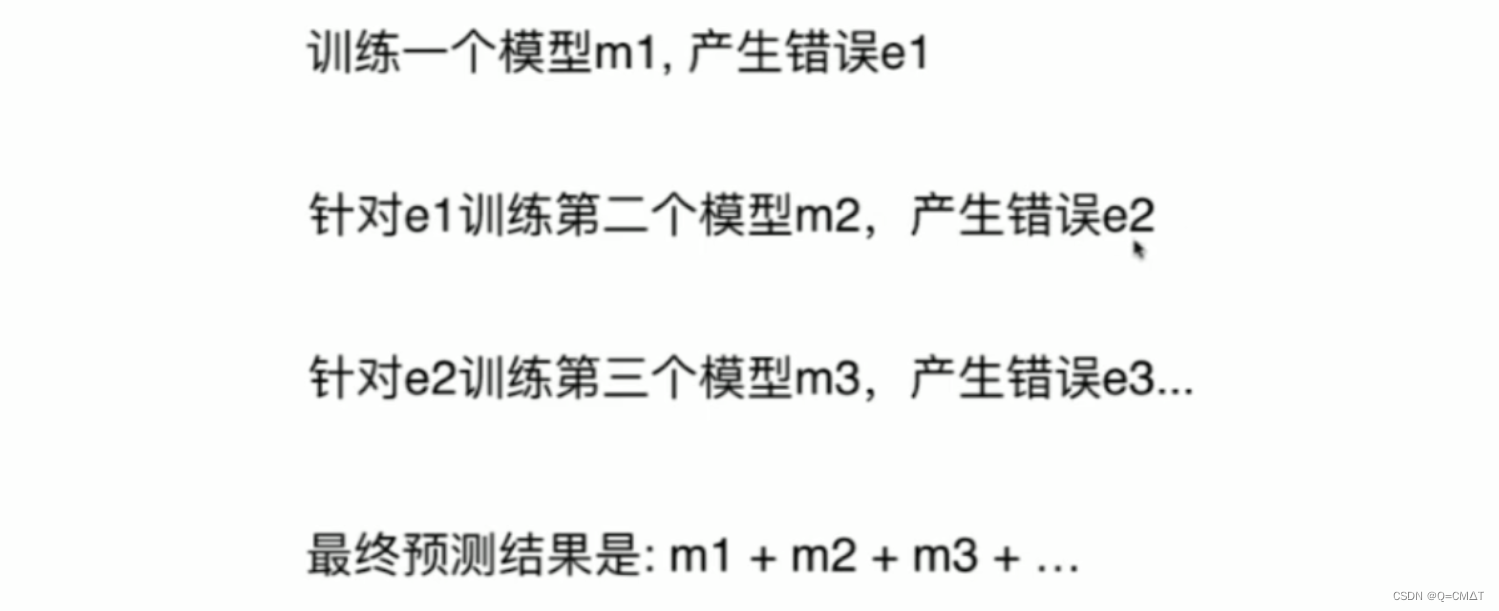

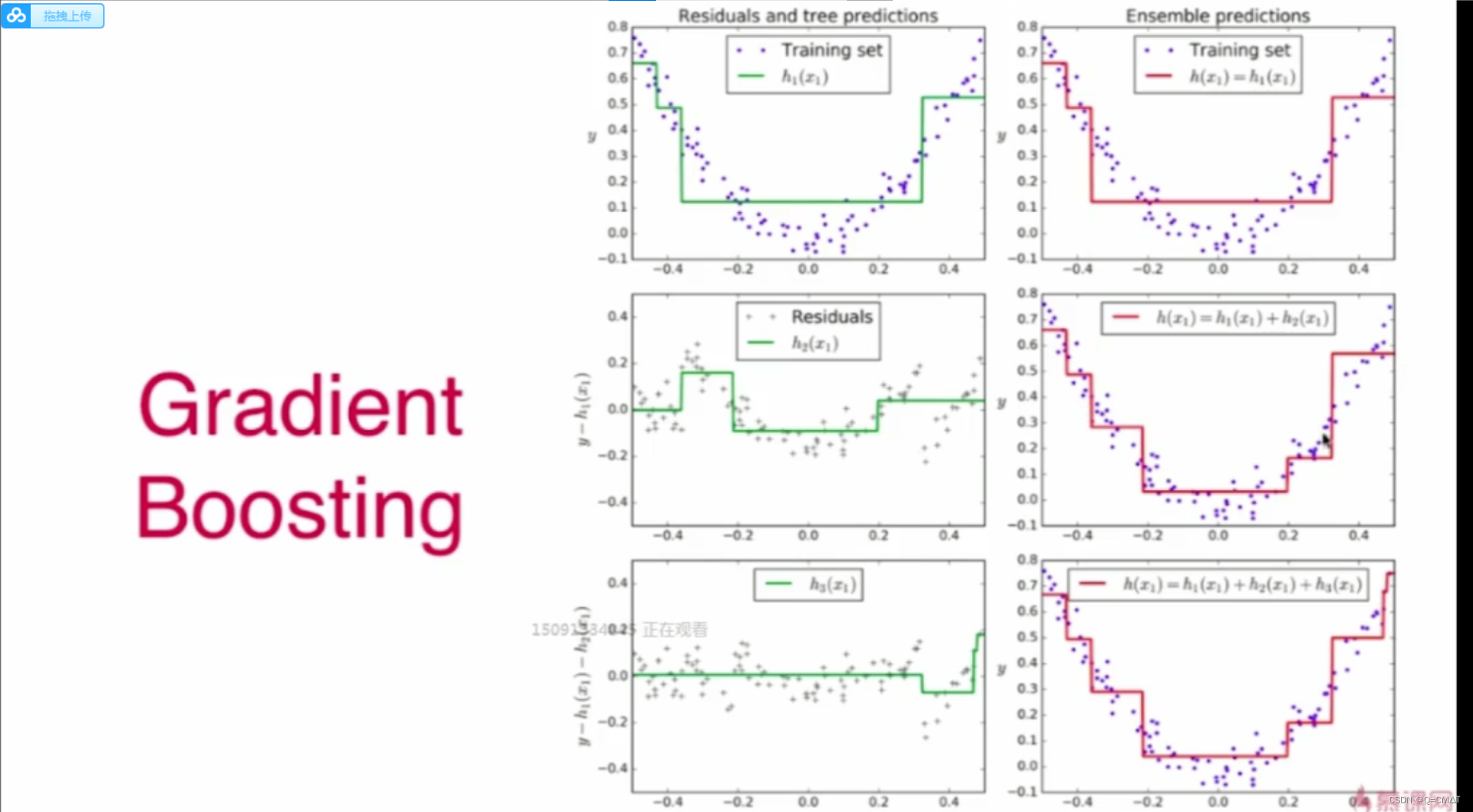

Ada Boosting 和 Gradient Boosting

Ada Boosting

Gradient Boosting

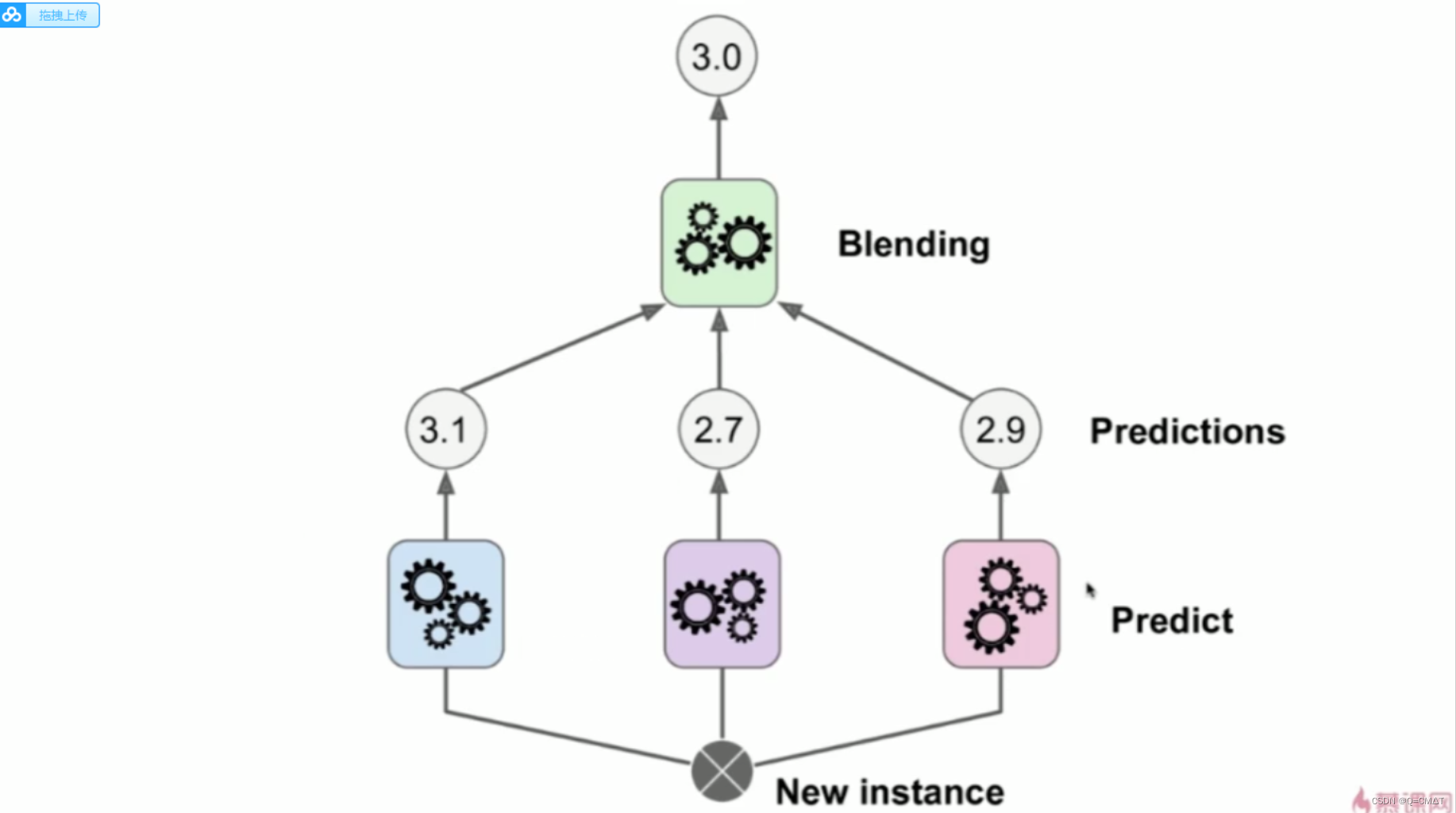

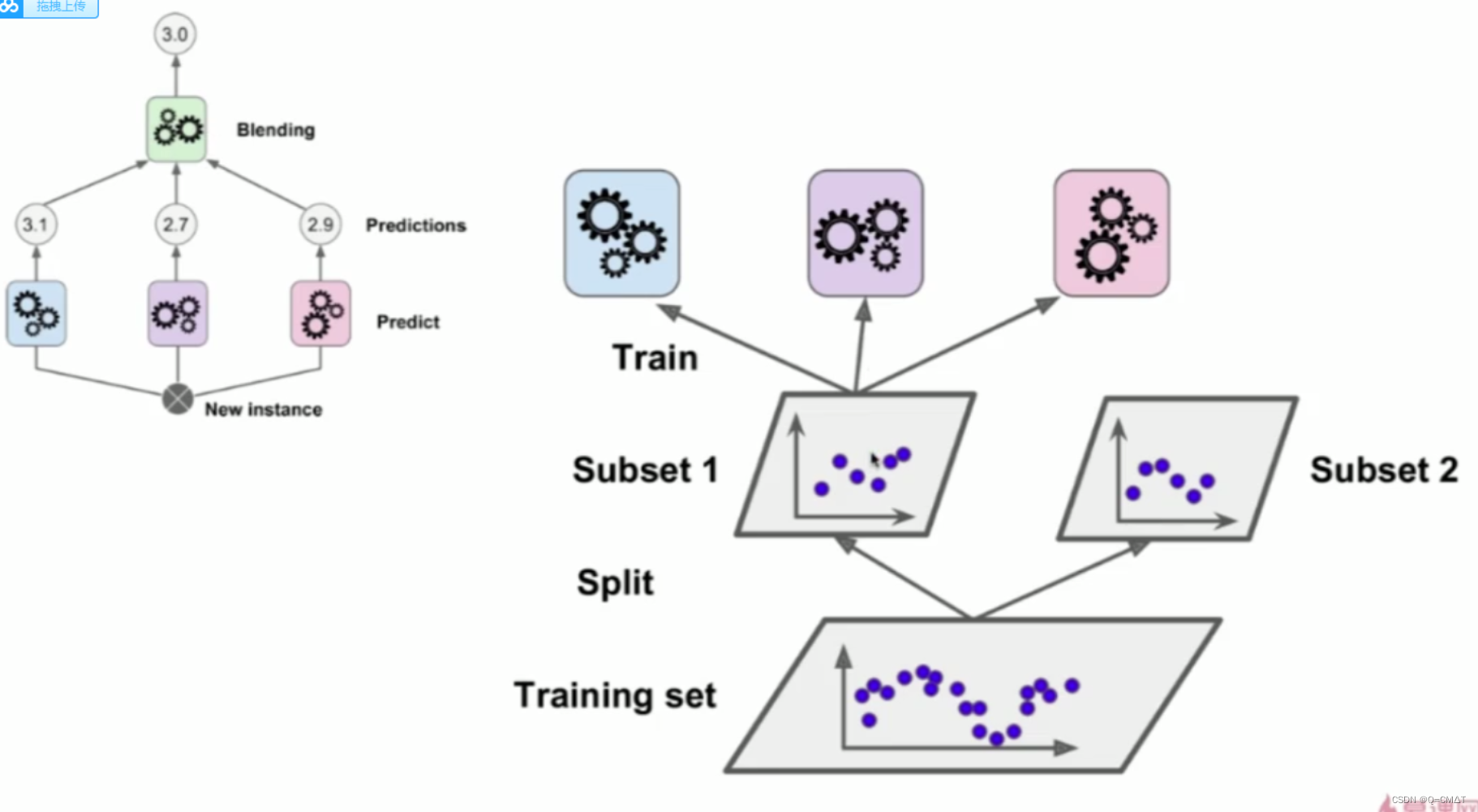

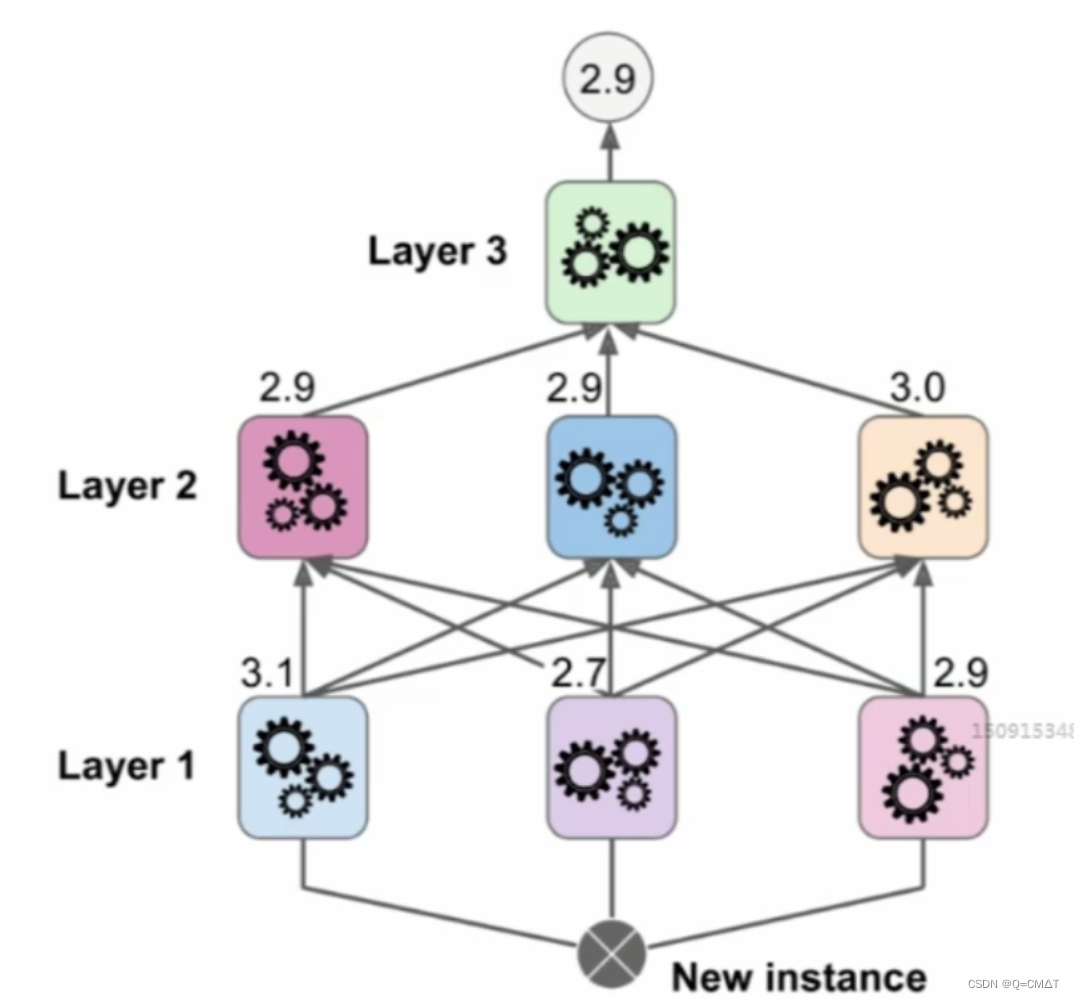

stacking

更复杂的模型

691

691

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?