机器学习笔记第九章

支撑向量机(Support Vector Machine)

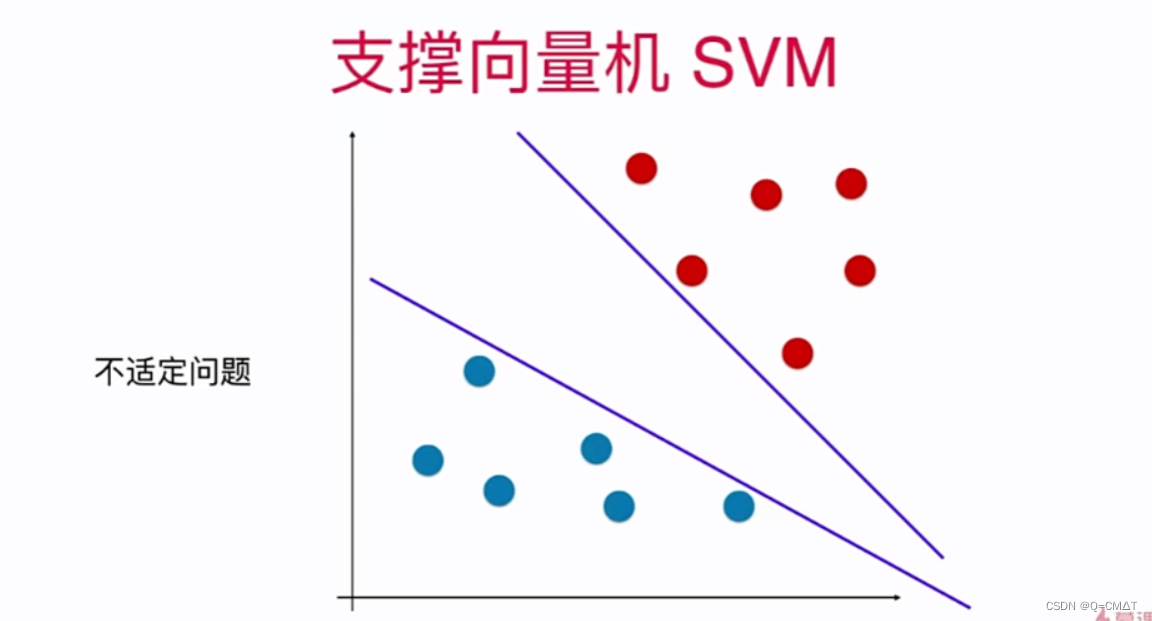

不适定问题

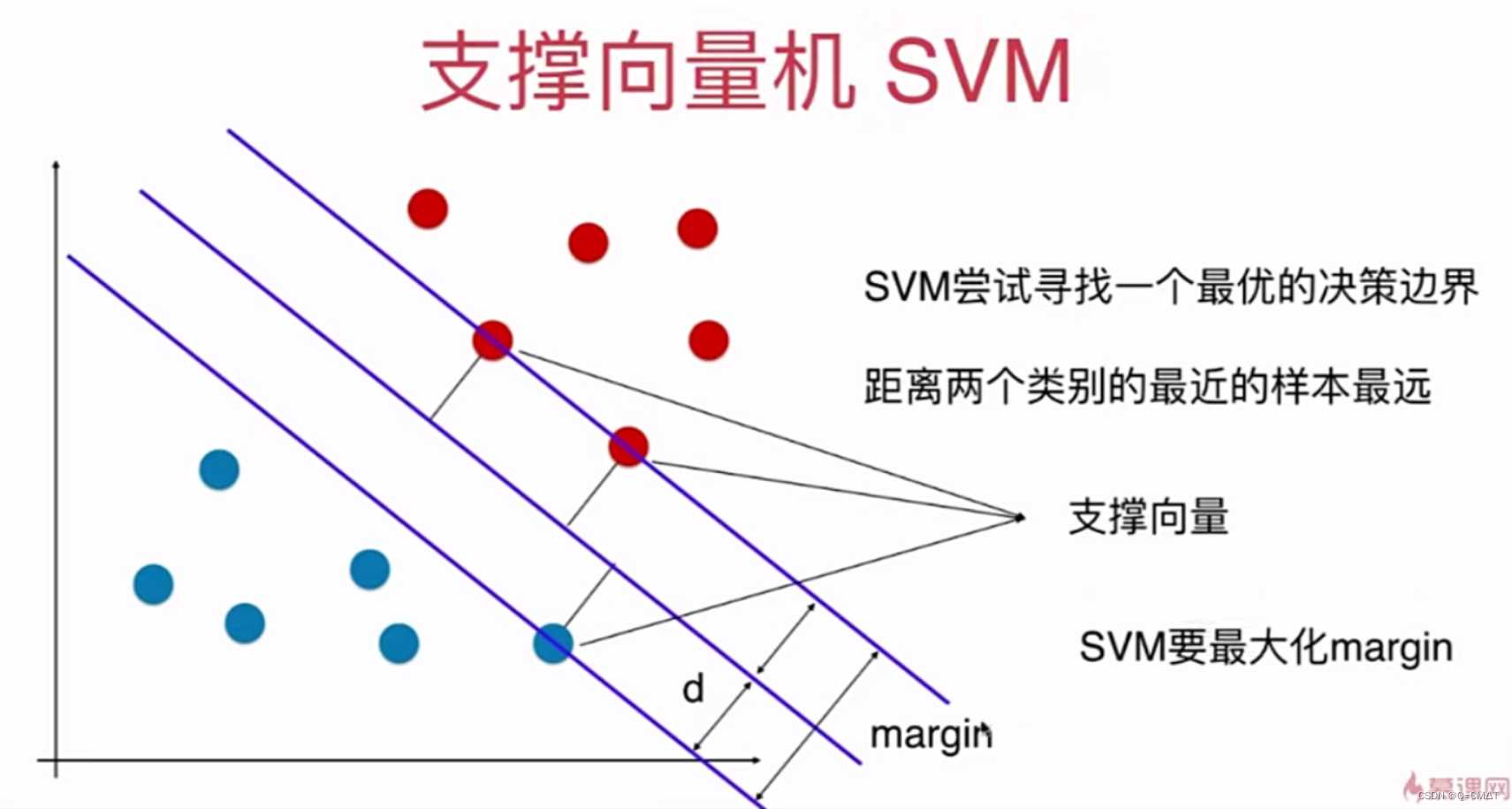

支撑向量是SVM非常重要的元素

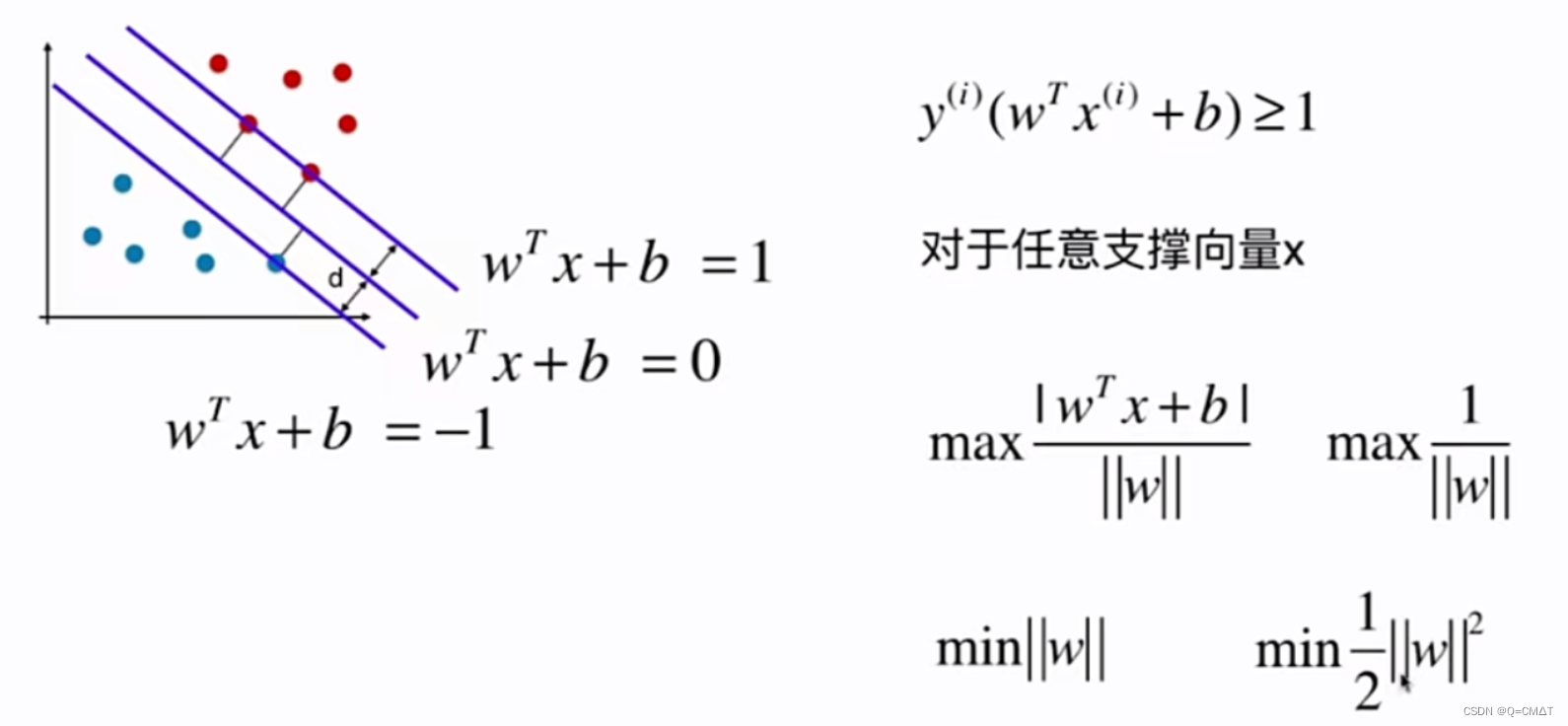

解决线性可分问题

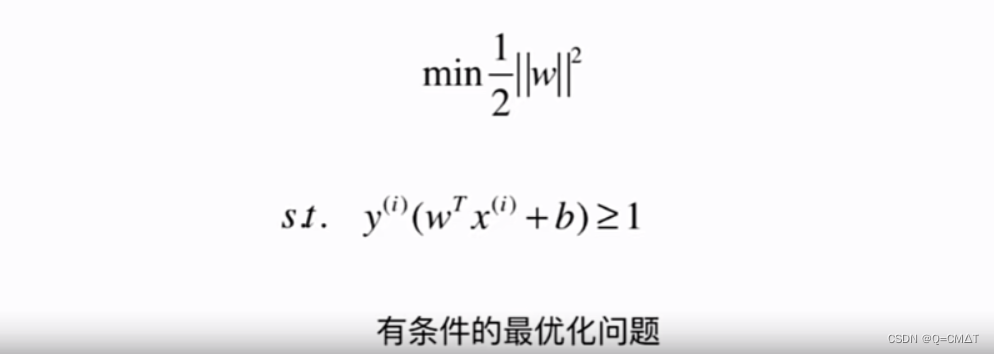

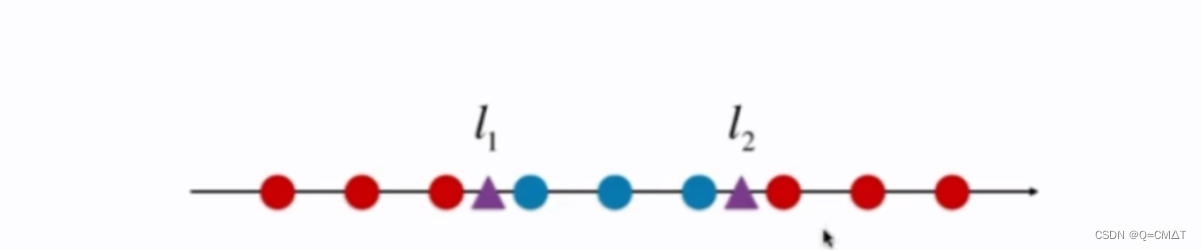

Hard Margin SVM

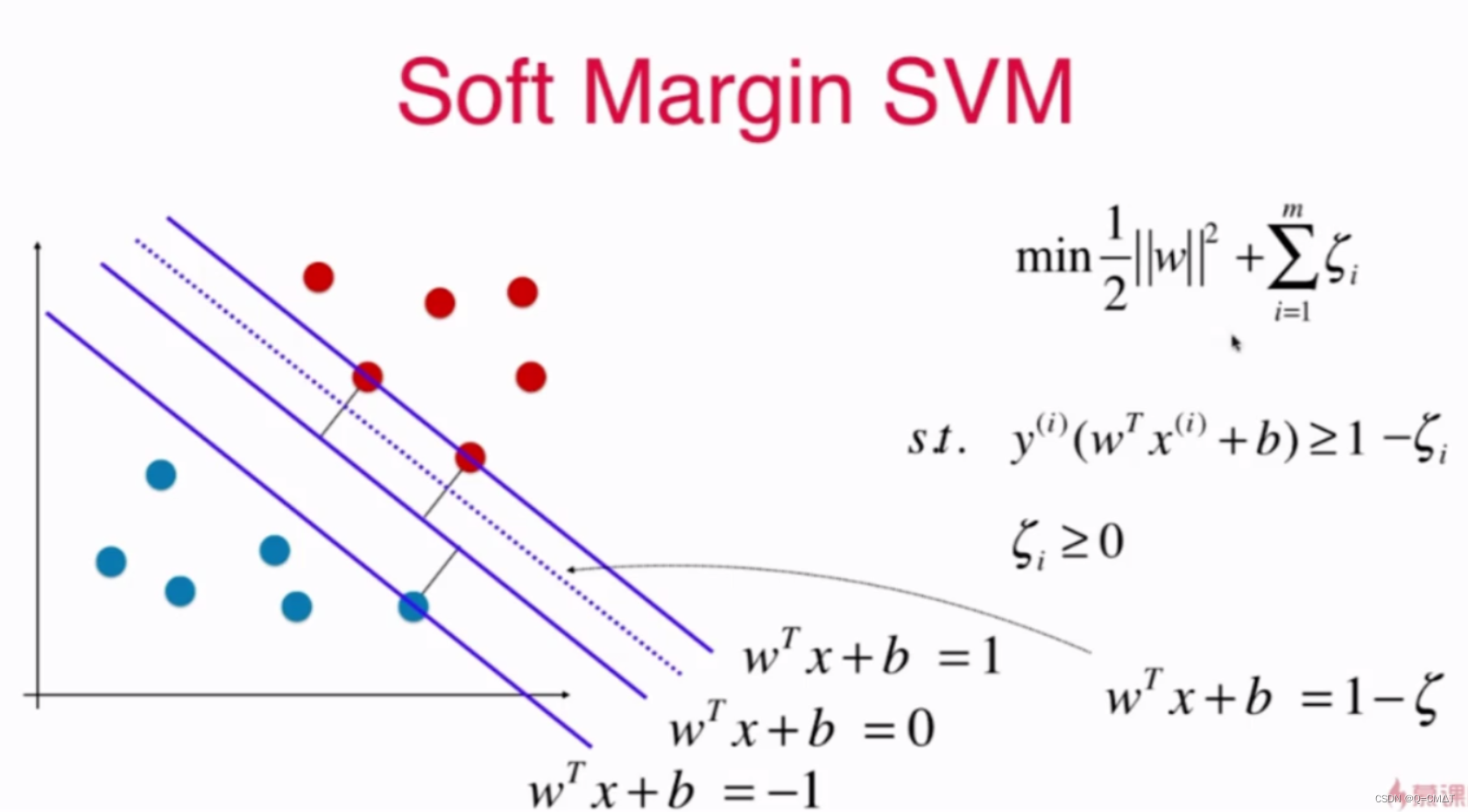

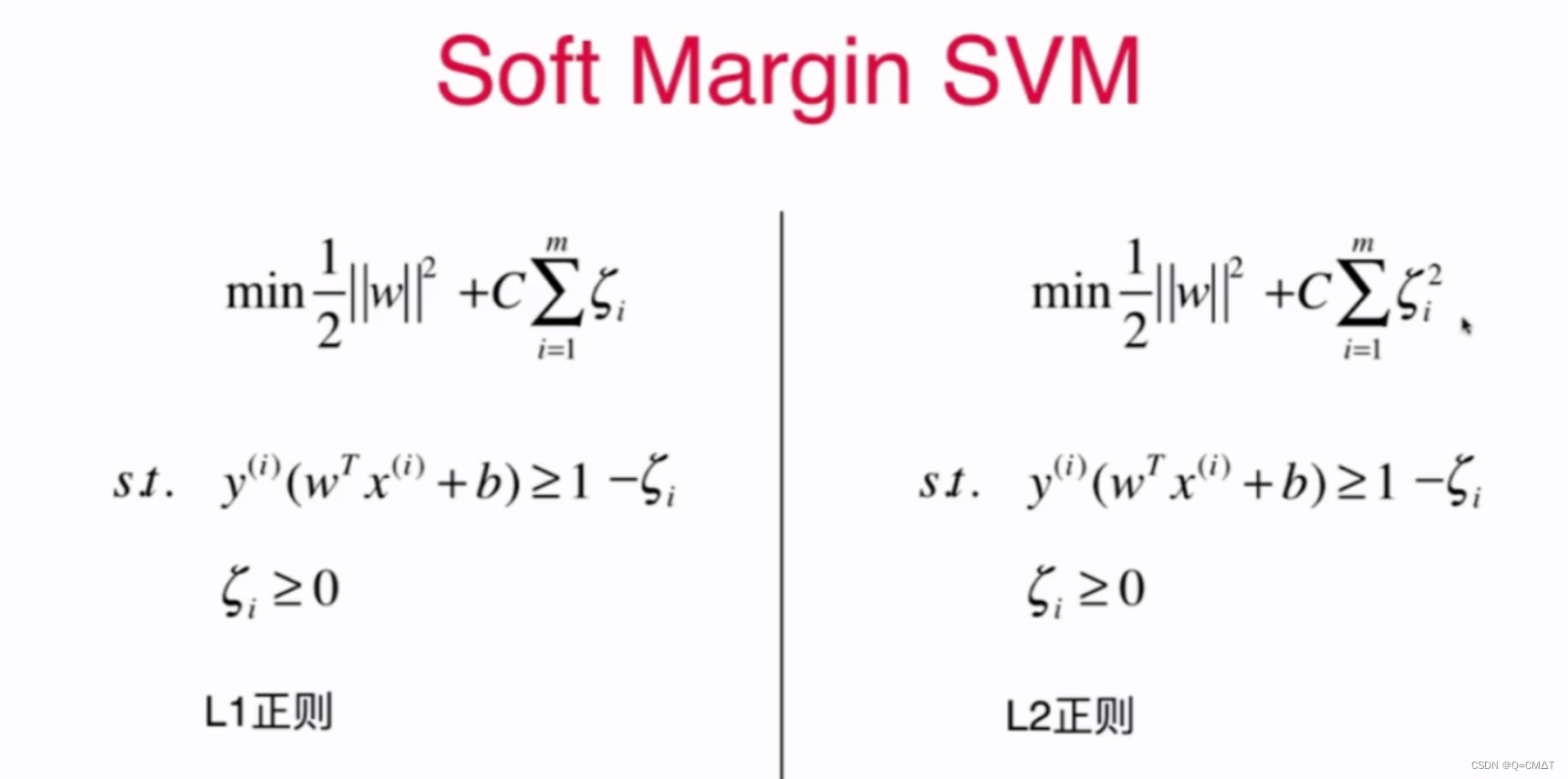

Soft Margin SVM

SVM要最大化margin

就是最优化的问题。

Soft Margin 和 SVM 的正则化

scikit-learn 中的 SVM

实际使用SVM和KNN一样,要做数据标准化处理

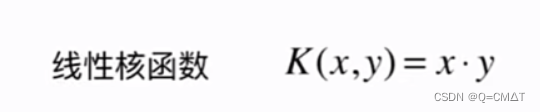

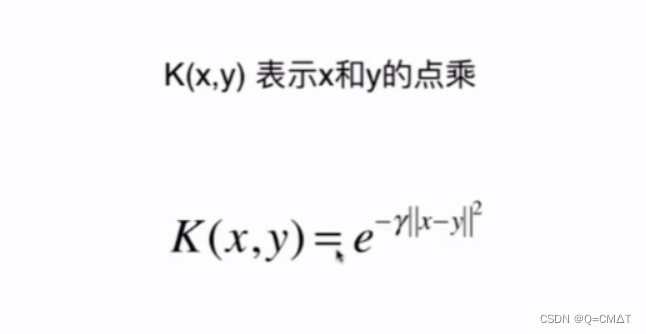

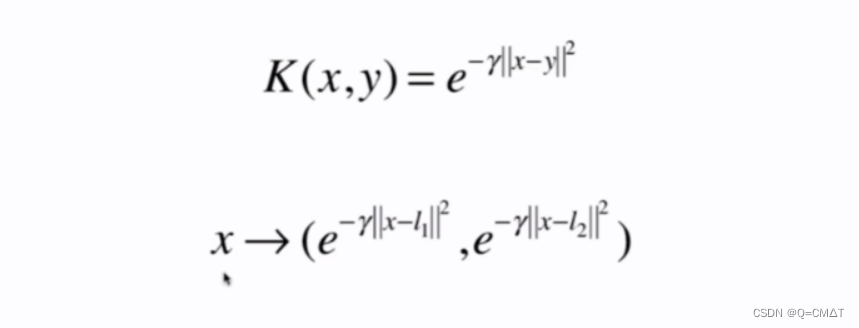

核函数 kernel function

使用核函数可以节省空间,因为一般计算都是将低维升到高维之后算出

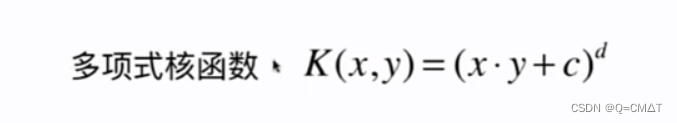

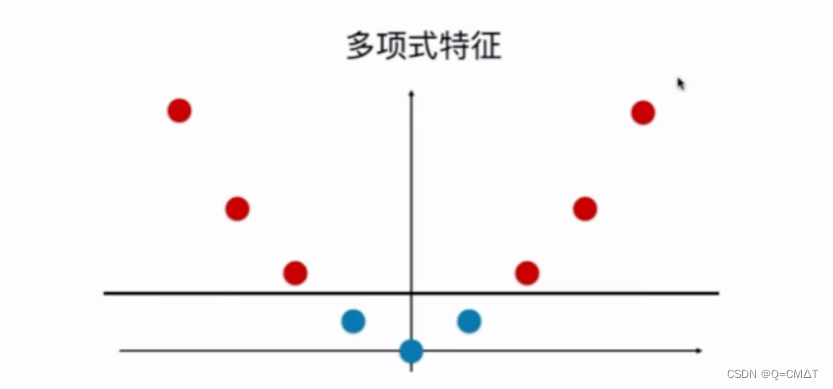

多项式核函数

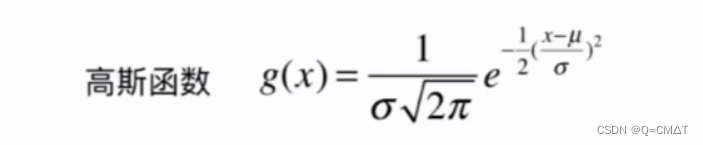

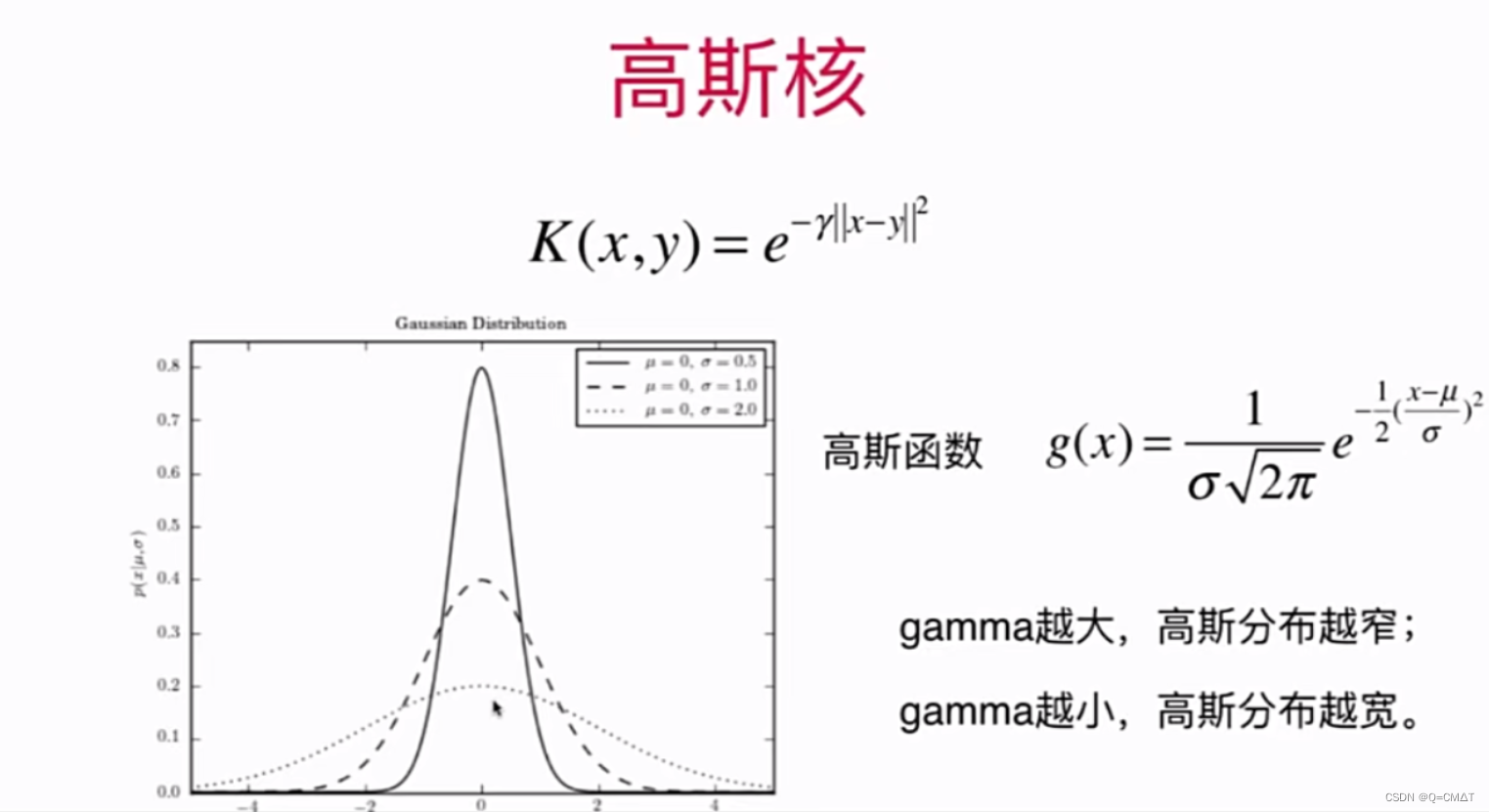

高斯核函数

RBF核:高斯核函数

将每一个样本点映射到一个无穷维的特征空间

多项式特征

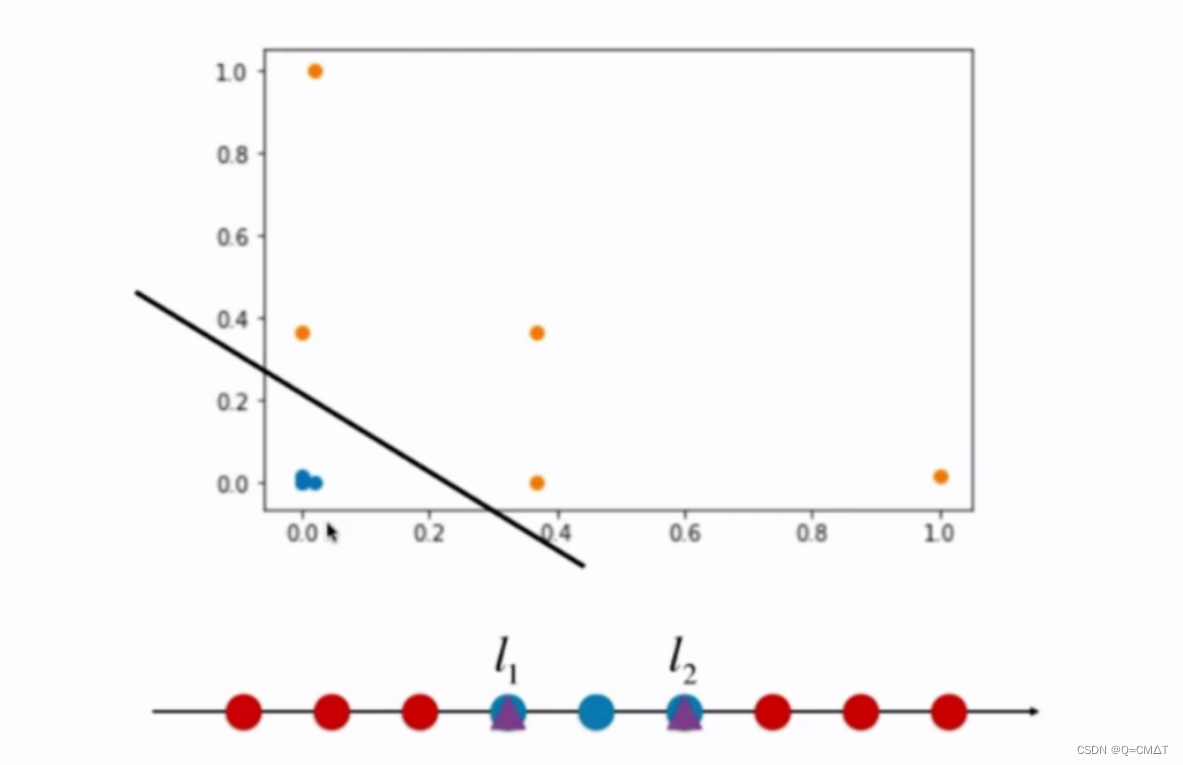

依靠升维使得原本线性不可分的数据线性可分

高斯核:

升维过程:

高斯核:对于每一个数据点都是landmark,m*n的数据映射成了m * m的数据

自然语言处理:数据是高维的,但是数据很少

scikit-learn当中的高斯核函数的使用

4416

4416

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?