机器学习笔记第十章

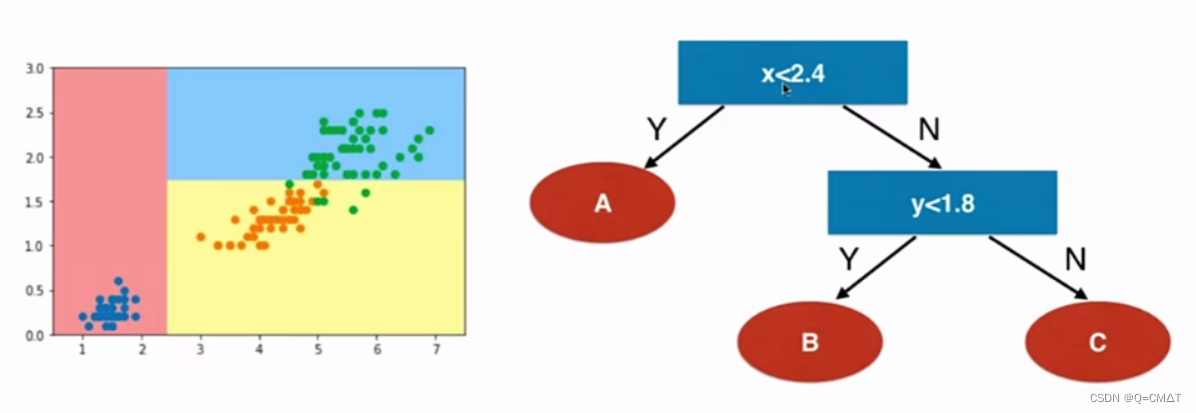

决策树:非参数的学习算法,可以解决分类问题,天然解决多分类问题,也可以解决回归的问题,具有非常好的可解释性。

问题:每个节点在哪个维度上做划分?某个维度在哪个值上做划分?

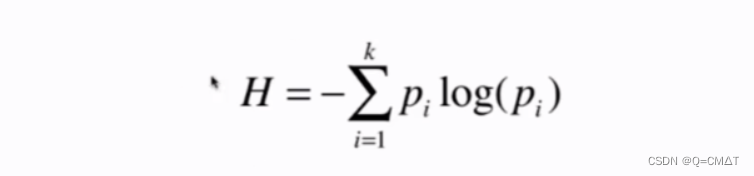

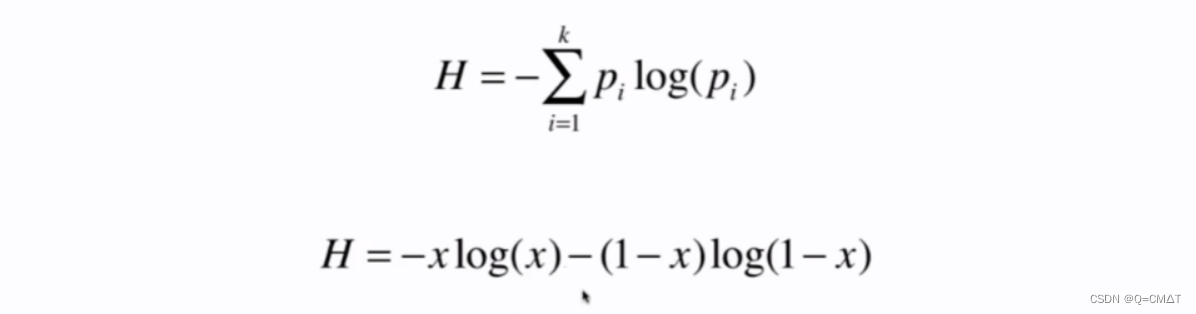

信息熵:

熵在信息论中代表随机变量不确定度的度量

熵越大,数据的不确定性越高

熵越小,数据的不确定性越低

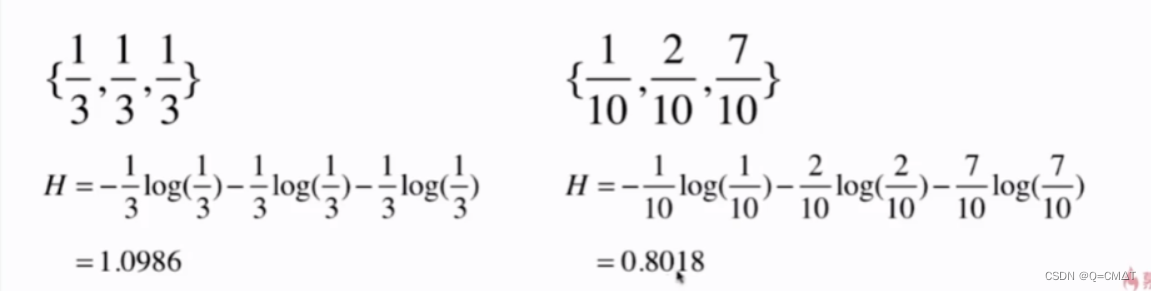

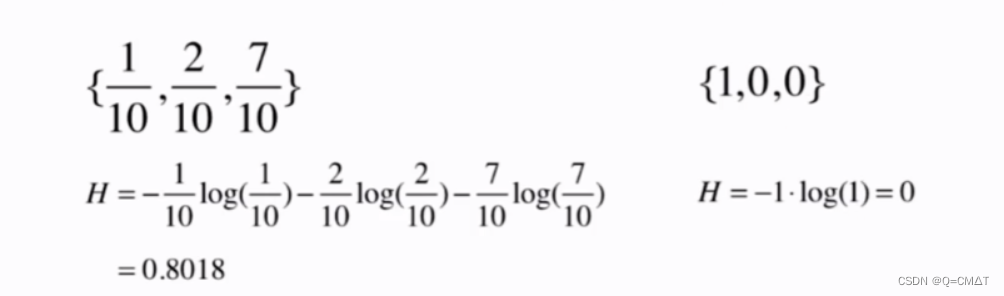

例子:

使用信息熵寻找最优划分

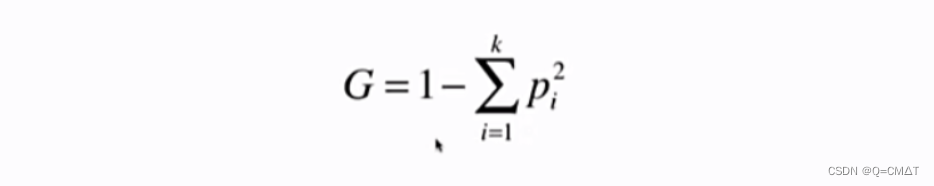

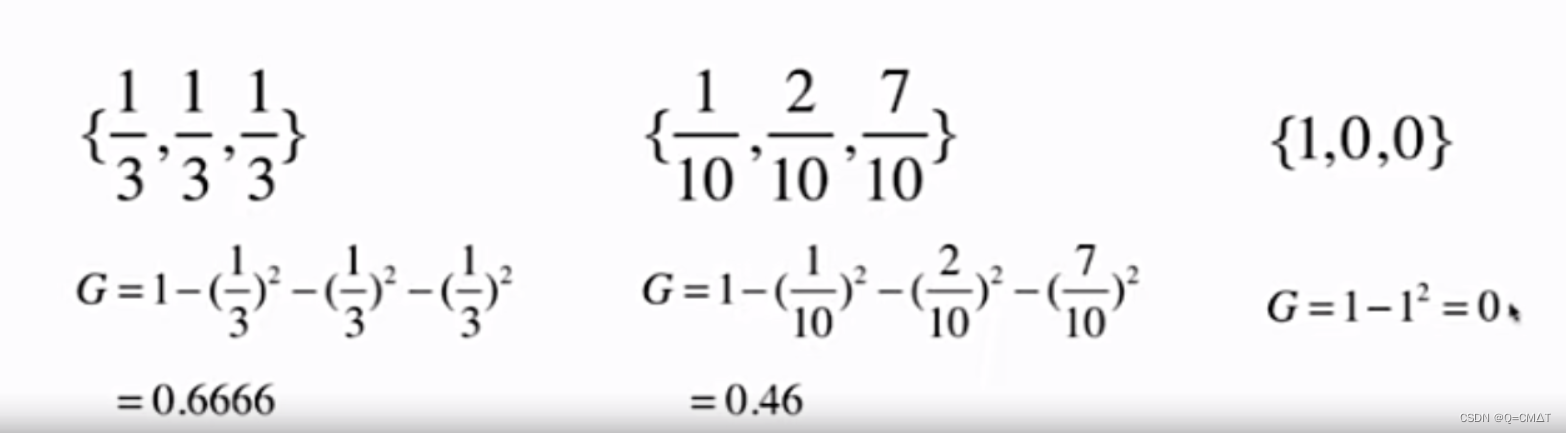

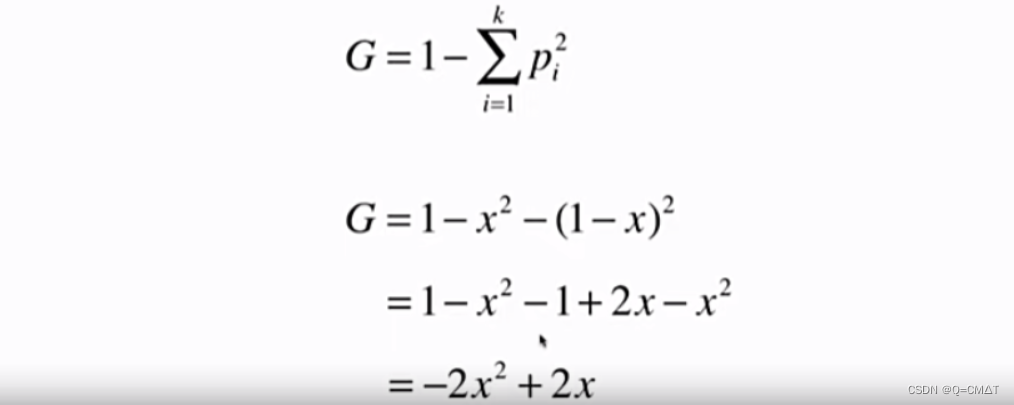

基尼系数

例子:

特例:

信息熵 vs 基尼系数

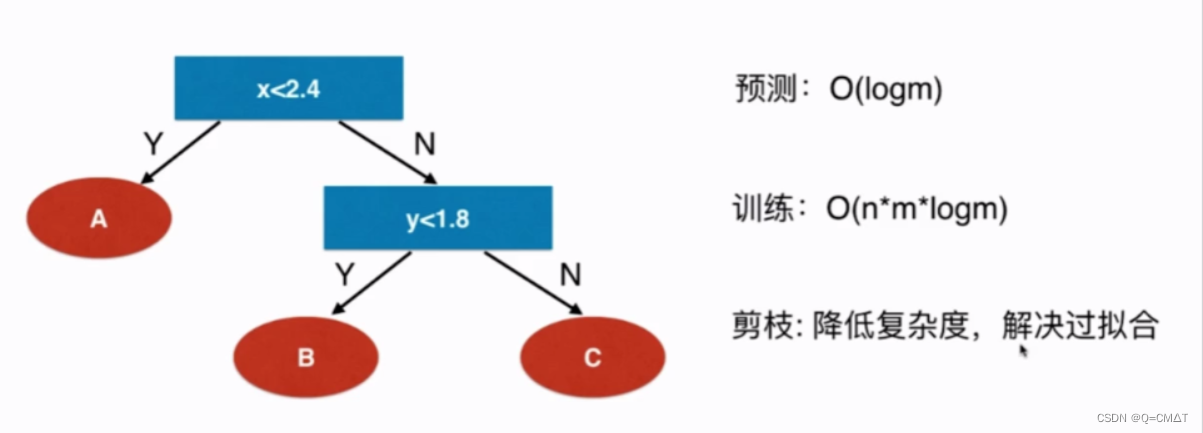

CART与决策树中的超参数

Classification and Regression Tree

根据某个维度d和某个阈值v进行二分

scikit-learn的决策树实现方法CART

复杂度:

决策树解决回归的问题

vote

使用投票来决定

699

699

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?