论文题目:SLSG: Industrial Image Anomaly Detection by Learning Better Feature Embeddings and One-Class Classification

摘要

在一类分类设置下的工业图像异常检测具有重要的实用价值。然而,大多数现有模型在执行特征嵌入时难以提取可分的特征表示,并且在执行一类分类时难以构建正常特征的紧凑描述。这样做的一个直接后果是,大多数模型在检测违反上下文关系的逻辑异常方面表现不佳。针对更有效、更全面的异常检测,我们提出了一种基于自监督学习和自注意图卷积(SLSG)的异常检测网络。

SLSG使用生成预训练网络来帮助编码器学习正常模式的嵌入和位置关系的推理。随后,SLSG通过模拟异常样本引入了异常的伪先验知识,通过比较模拟的异常,SLSG可以更好地总结正常特征,缩小用于一类分类的超球体。

此外,通过构建更通用的图结构,SLSG对图像中元素之间的密集和稀疏关系进行了全面建模,进一步加强了对逻辑异常的检测。在基准数据集上的大量实验表明,SLSG实现了优越的异常检测性能,证明了我们方法的有效性。

动机

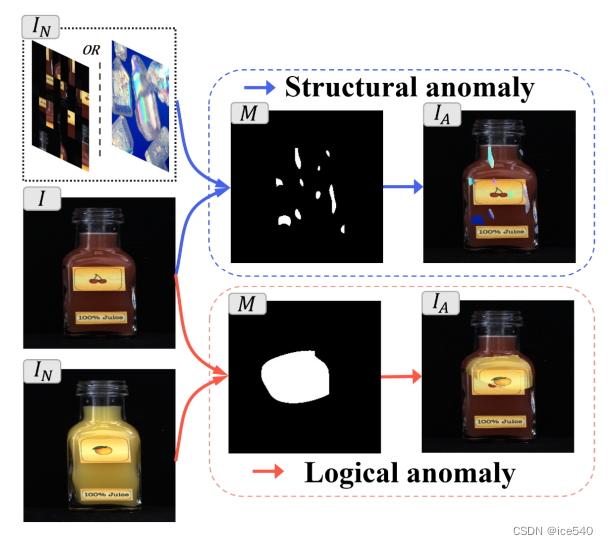

特征嵌入时的不足:现有模型一般使用基于ImageNet预训练的模型做特征提取,这种方式存在域适应问题、缺少对位置信息的表征、特征粒度可能较大(预训练过程一般是分类任务,异常定位一般做分割任务)。

一类分类时的不足:现有大多模型只观察正常样本,难以对正常样本建立紧凑的描述,此外无法有效分辨逻辑异常。

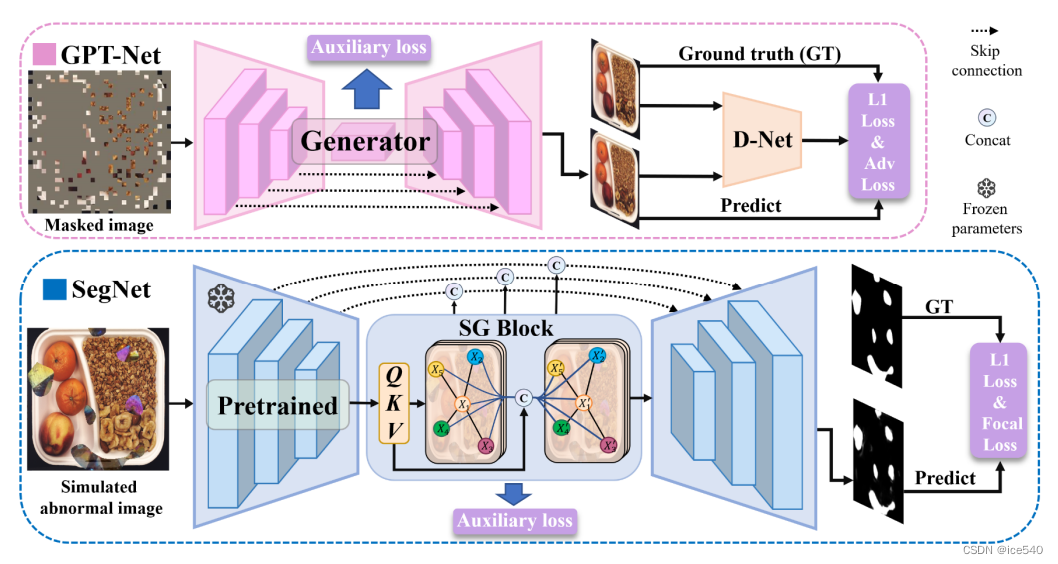

Pipeline

分为预训练过程(GPT-Net)和训练过程(SegNet)。预训练过程通过GPT-Net学习特征嵌入,训练编码器;训练过程通过SegNet训练一类分类器(解码器)。

SLSG使用生成预训练网络(GPT-Net)对编码器进行预训练,该过程通过判别网络(D-Net)引入对抗性损失,以提高重建图像的清晰度。然后,SLSG使用预先训练的编码器和一类分类解码器来组成分割网络(SegNet)。SegNet借助模拟的异常样本进行端到端的像素级异常定位。此外,SegNet在瓶颈结构处引入了一种基于自注意的图卷积网络(SG块),以更好地捕捉逻辑异常。

即包括两个自监督任务,一个自注意力图卷积。

GPT-Net

通过预测网格掩模和大尺度掩模的图像对编码器进行训练,优势:缓解域适应问题、提取的特征粒度更小、学习位置关系的推理,可以更好地检测逻辑异常。(类似MAE的训练方式)

应该注意的是,GPT-Net的作用是训练一个编码器,该编码器用于对包括复杂逻辑关系在内的正常模式进行建模。该过程不考虑任何异常的先验知识,因为编码器很难对多变的异常模式的建立一致描述。

Seg-Net

通过引入模拟的异常更好地指导解码器的训练。

其中使用了基于自注意力的图卷积模块(SG block)

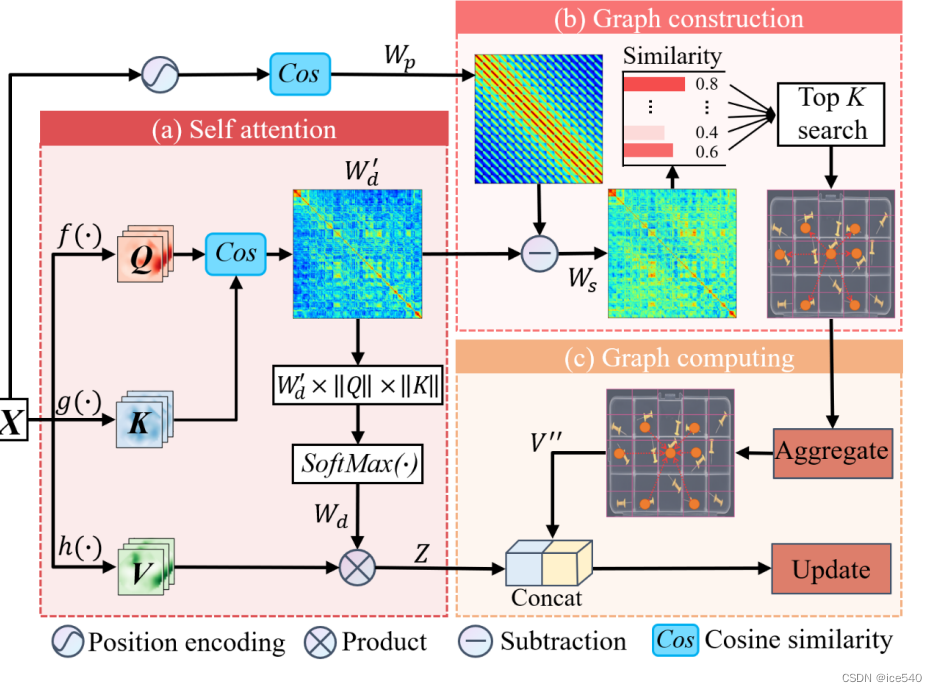

一般来说,与结构性异常相比,逻辑性异常的检测相对困难,因为逻辑性异常通常需要在大的感受野和交叉邻域位置关系的帮助下进行判断。经过GPT-Net的预训练,SegNet的编码器可以提取含有位置信息的特征。同时,增强解码器对位置关系的敏感性可以进一步提高模型检测逻辑异常的能力。因此,我们在SegNet的解码过程中引入了SG块。 SG块使用CNN提取的深度特征图进行建模,因为深度特征图有更多的语义信息,同时保证了更大的理论感知领域。此外,考虑到CNN架构不善于对深层特征图中的斑块之间的远程依赖关系进行建模,如图4所示,SG块使用基于自注意的图卷积网络对全局密集关系和跨邻里稀疏关系进行建模。

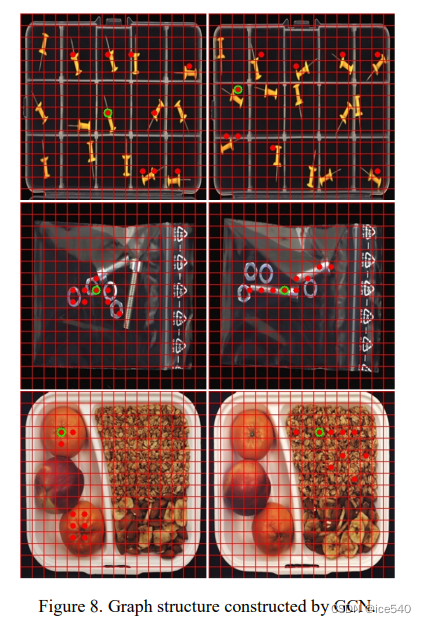

对于编码器输出的深度特征图X∈R^(W×H×C_in ),其网格结构可以被视为图的一个特例。在这个图中,每个具有通道C_in的斑块可以被看作是一个节点,而边只存在于节点和它周围的邻域之间。在前面的讨论中,通过自我关注,我们探索了所有节点之间的密集关系。进一步说,构建一个更广义的图,从而用GCN来强调节点之间的跨邻域关键关系,可能有助于模型处理更复杂的逻辑异常。

对于X∈R^(W×H×C_in ),我们首先将其转换为更一般的图结构G(V,E),其中V是节点集。对于边集E的构造,我们可以用相似性矩阵W_s来索引每个节点v_i的前K个相似节点并建立连接关系[48]。那么,如何构建相似性矩阵W_s?

直接使用由自我关注产生的密集相似性矩阵W_d来构建节点间的稀疏边,会有一定的缺陷。由于语义信息的空间连续性,对于图中的一个节点v_i,其由W_d索引的最相似的节点有很高的概率出现在节点v_i的周边。在这种情况下,借助GCN对远程依赖关系进行建模的目的就无法实现。因此,我们需要消除由于节点之间位置接近而产生的多余的语义相似性。

稀疏相似度 = 稠密相似度 - 位置相似度

更新的时候是拼接全局稠密关系特征和跨邻域稀疏关系特征。

推理阶段:在推理阶段,SegNet可以在获得输入图像后直接进行异常定位。(已经学习到一类分类的决策边界)

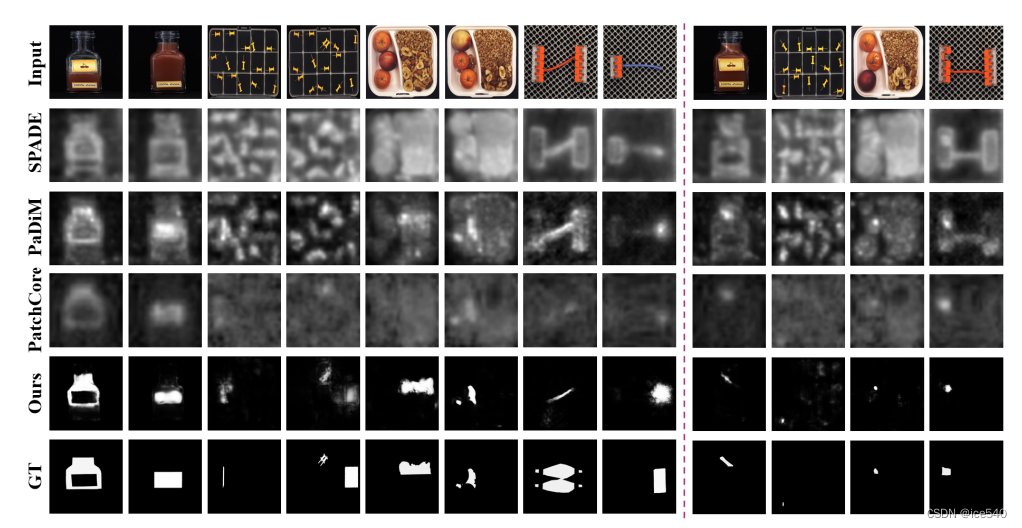

实验

定位

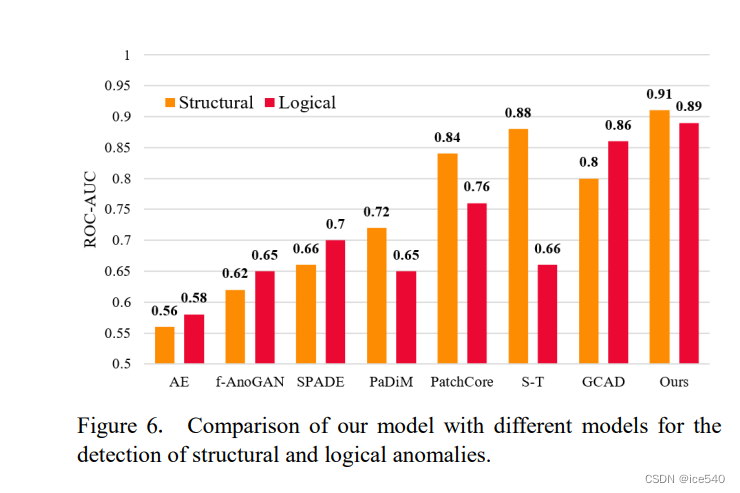

对逻辑异常的检测效果更好

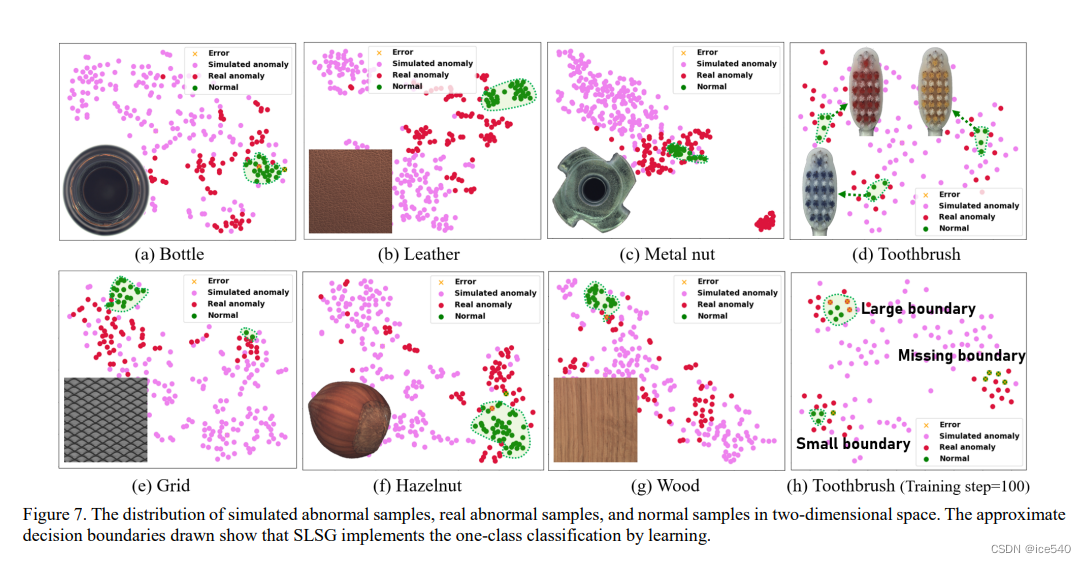

学习到的一类分类决策边界

对于图7中的每个子图,我们具体地将训练期间产生的模拟异常样本、所有正常样本和测试集中的真实异常样本可视化。我们还标记了在推理阶段被SLSG错误分类的样本和近似的决策边界。从可视化的结果来看,有三个主要结论:(1)一些模拟的异常样本的分布与真实的异常样本的分布相吻合。这表明一些模拟的异常样本可以充当真实的异常样本,证明了异常模拟策略的有效性;(2)正常样本的分布是集中的,异常样本的分布比较分散。这说明正常样本的特征容易归纳,而异常样本的特征多样,难以统一;(3)结合模型的训练过程(图7-h),可以认为,通过比较高度一致的正常样本和多变的模拟异常样本,SLSG构建了一个单类分类决策边界。利用这个决策边界,SLSG可以更好地区分正常样本和未见过的非正常样本。

GCN

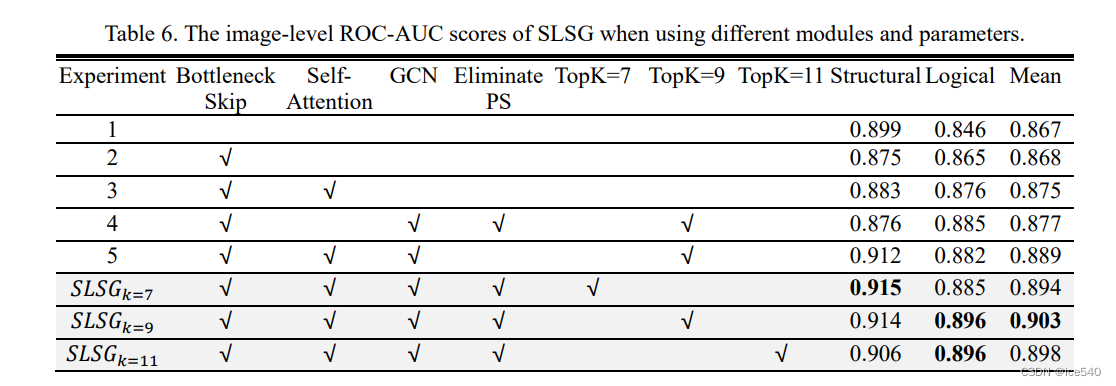

消融实验

损失函数消融实验

总结

在本文中,我们提出了一种叫做SLSG的新方法来解决半监督图像异常检测。SLSG使用一个生成性的预训练网络来学习正常图像的特征嵌入。同时,它使用模拟的异常图像来提供异常的伪优先知识,从而训练出一个具有紧凑决策超球的端到端单类分类器来完成异常检测。同时,在推理掩码区域和构建一般图结构的帮助下,SLSG可以捕捉到图像中元素之间的长程依赖关系。大量的实验证明了SLSG的全面和卓越的异常检测性能。此外,由于端到端的异常识别和全卷积结构,SLSG的计算成本也比较小。

SLSG是一种基于自监督学习和自注意图卷积的异常检测网络,解决了现有模型在特征嵌入和一类分类中的不足。通过GPT-Net预训练和SegNet训练,SLSG能更好地检测逻辑异常,特别是在构建紧凑的正常模式描述和捕捉图像元素间的关系上表现出色。实验表明,SLSG在基准数据集上取得了优越的异常检测性能。

SLSG是一种基于自监督学习和自注意图卷积的异常检测网络,解决了现有模型在特征嵌入和一类分类中的不足。通过GPT-Net预训练和SegNet训练,SLSG能更好地检测逻辑异常,特别是在构建紧凑的正常模式描述和捕捉图像元素间的关系上表现出色。实验表明,SLSG在基准数据集上取得了优越的异常检测性能。

2317

2317

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?