1.算力单位

TOPS:指的是每秒钟可以执行的整数运算次数,它代表着计算机在处理图像、音频等任务时的处理能力。TOPS的单位是万亿次每秒(trillion operations per second)。一般是指整数运算能力INT8。

TFLOPS:指的是每秒钟可以执行的浮点运算次数,它代表着计算机在处理科学计算、机器学习等任务时的处理能力。TFLOPS的单位是万亿次每秒(trillion floating point operations per second)。一般是指单精度性能FP32。

如果设置,将使用16位浮点数进行训练,可以减少内存使用并可能加速训练。

在深度学习中,我们可以选择不同的数值精度来进行模型的训练和计算。不同的精度会影响计算资源的使用、训练速度和模型的精确度。

FP16 (Half Precision,半精度):

这种方式使用16位的浮点数来保存和计算数据。想象一下,如果你有一个非常精细的秤,但现在只用这个秤的一半精度来称重,这就是FP16。它不如32位精度精确,但计算速度更快,占用的内存也更少。

BF16 (BFloat16):

BF16也是16位的,但它在表示数的方式上和FP16不同,特别是它用更多的位来表示数的大小(指数部分),这让它在处理大范围数值时更加稳定。你可以把它想象成一个专为机器学习优化的“半精度”秤,尤其是在使用特殊的硬件加速器时。

FP32 (Single Precision,单精度):

这是使用32位浮点数进行计算的方式,可以想象为一个标准的、全功能的精细秤。它在深度学习中非常常见,因为它提供了足够的精确度,适合大多数任务。

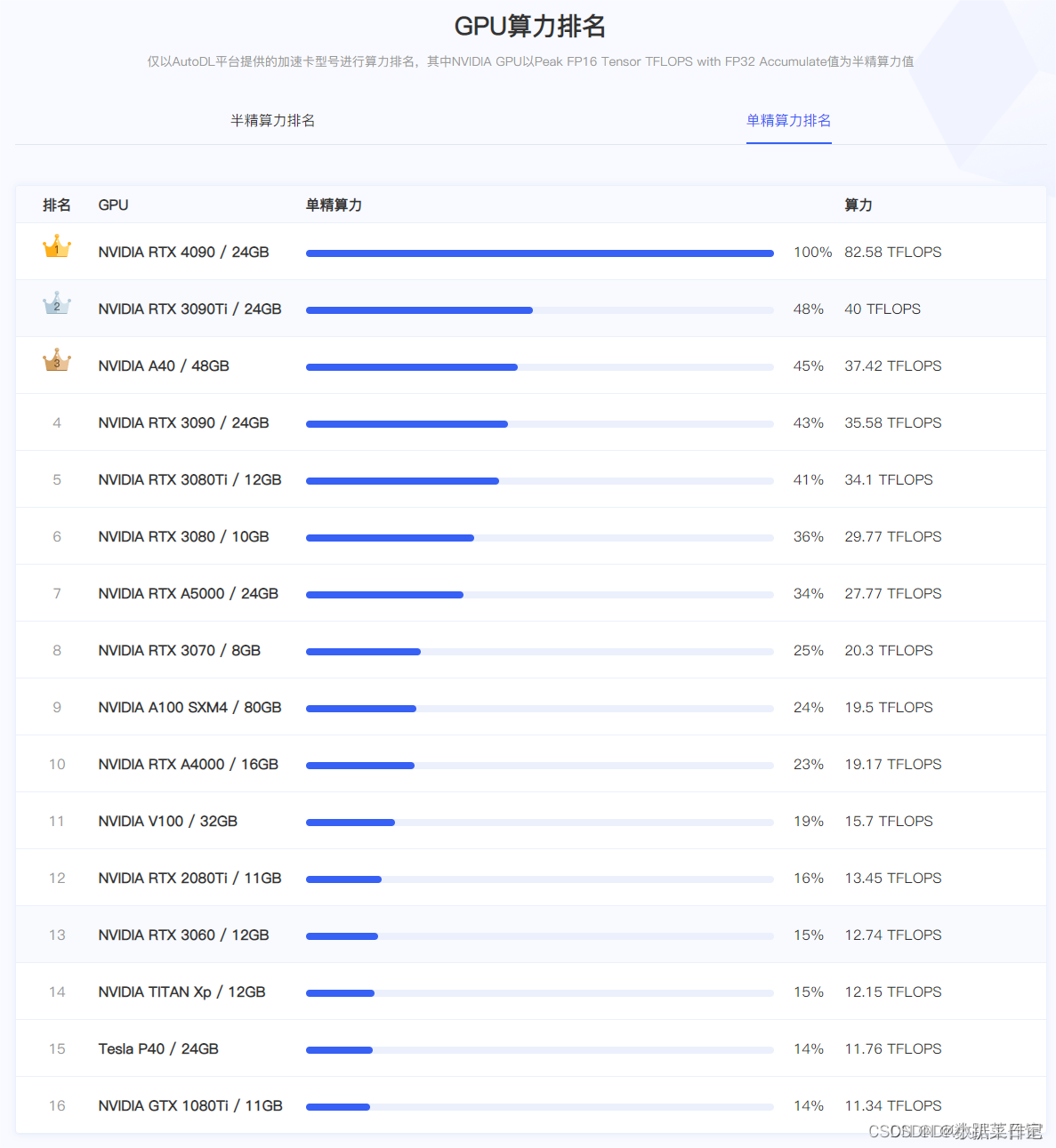

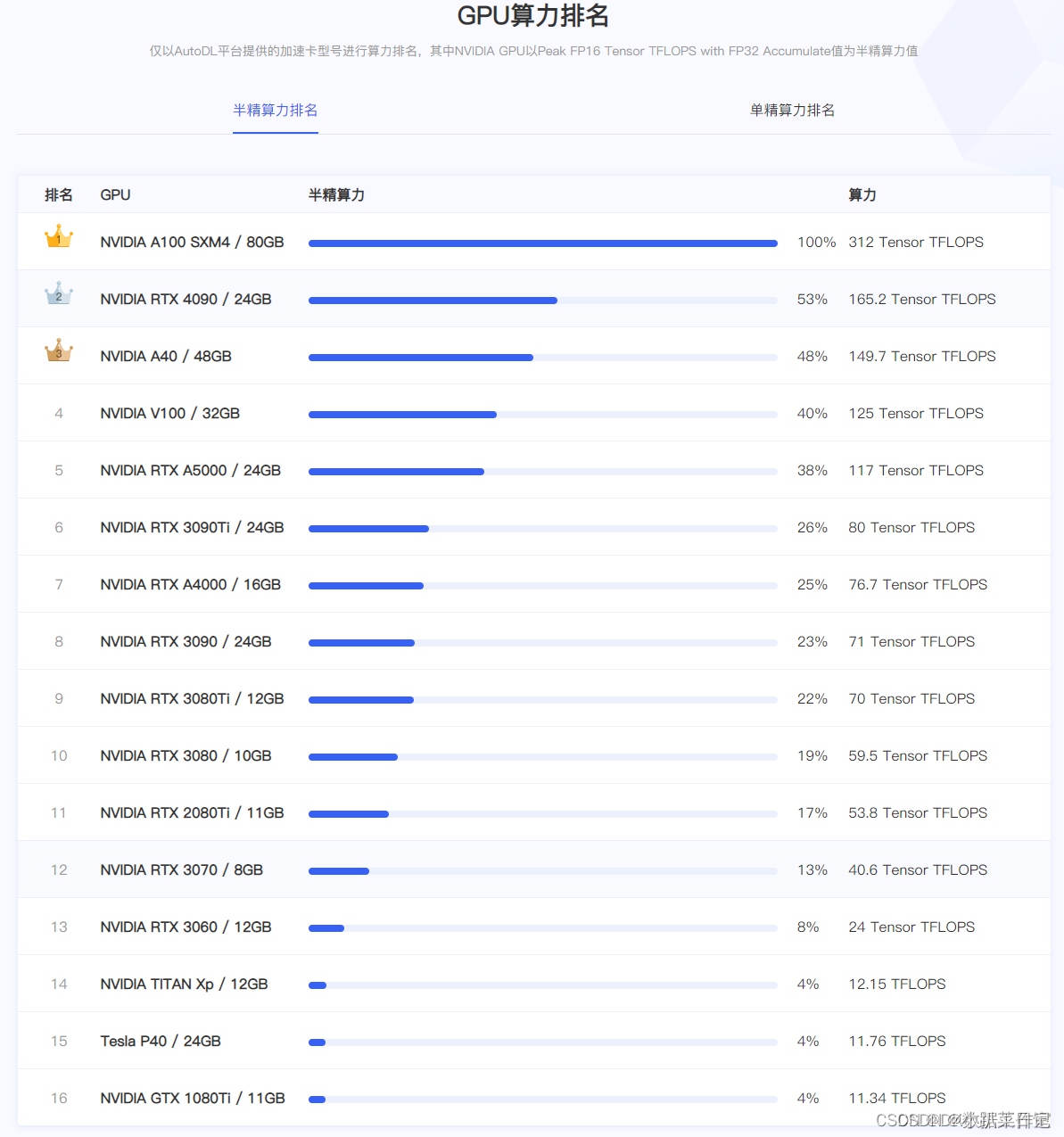

2.对比

| 显卡 | 显存(G) | 浮点算力FP32(TFLOPS) | 浮点算力FP16(Tensor TFLOPS) |

| RTX4090 | 24 | 82.58 | 165.2 |

| RTX3090 | 24 | 35.58 | 71 |

7993

7993

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?