一、决策树简介

决策树是什么?

决策树是一种树形结构,树中每个内部节点表示一个特征上的判断,每个分支代表一个判断结果的输出,每个叶子节点代表一种分类结果

决策树的建立过程:

1.特征选择:选取有较强分类能力的特征。

2.决策树生成:根据选择的特征生成决策树。

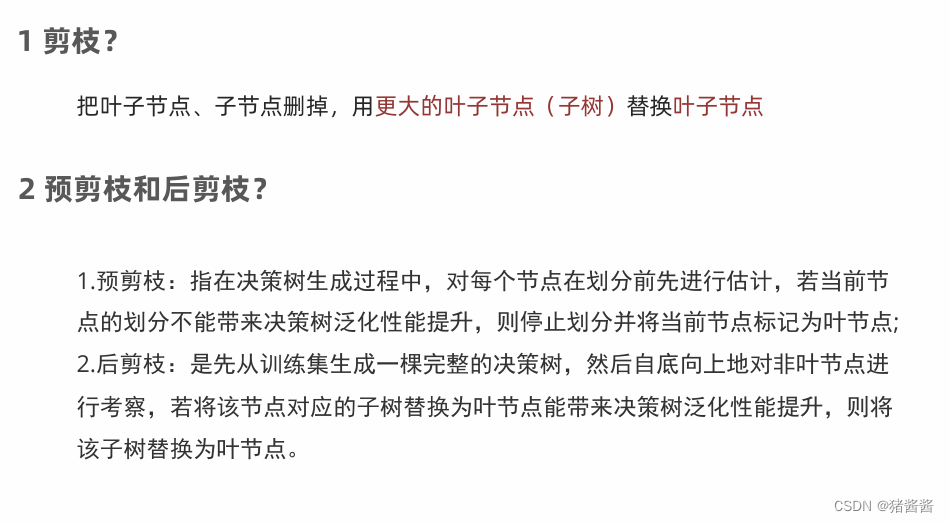

3.决策树也易过拟合,采用剪枝的方法缓解过拟合。

决策树的分类:

ID3树 :基于信息增益

C4.5树 :基于信息增益率

cart树 :基于基尼指数

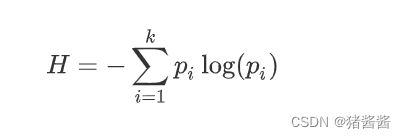

二、信息熵

熵在物理中表示的是物质的不稳定程度,还有著名的熵增定律,那么信息熵是怎么定义的呢?

熵在信息论中代表随机变量不确定度的度量。

熵越大,数据的不确定性度越高

熵越小,数据的不确定性越低

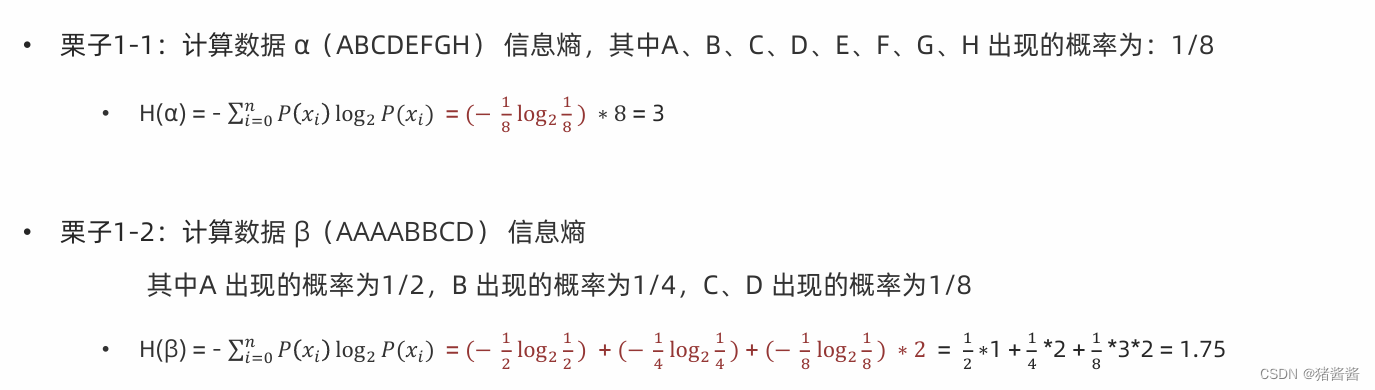

举个栗子:

1.数据α:ABCDEFGH

2.数据β:AAAABBCD

数据α 包含了8 种信息,数据β 包含了4 种信息, 特征α 的信息熵大于特征β 的信息熵。

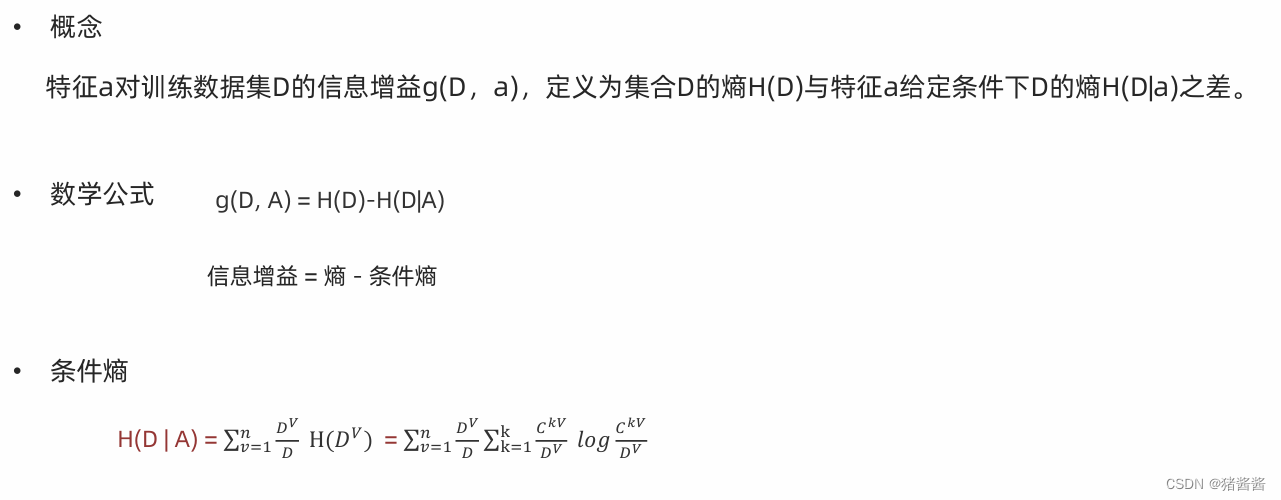

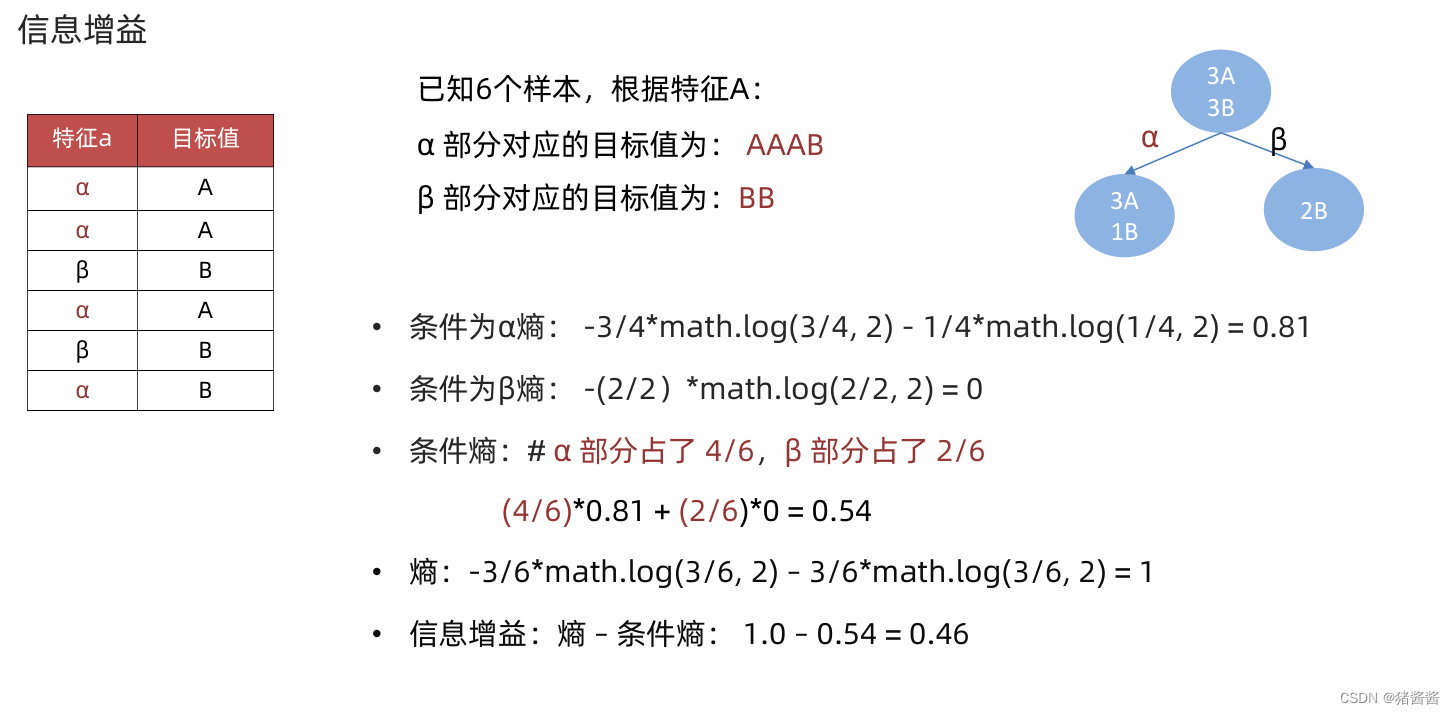

三、信息增益

四、ID3 决策树(不支持连续特征)

1. 计算每个特征的信息增益

2. 使用信息增益最大的特征将数据集 拆分为子集

3. 使用该特征(信息增益最大的特征)作为决策树的一个 节点

4. 使用剩余特征对子集重复上述(1,2,3)过程

其实用大白话来说,ID 3树就是选择一个对目标值影响最大的特征来对目标划分,影响最大是指让目标的信息熵变小的程度越大,对目标划分是指根据特征划分,将目标划分为一个一个的树叶,这样构成一个数之后,预测样本的目标时就可以从树顶向下一步一步比对,将找到对应的目标分为哪类。

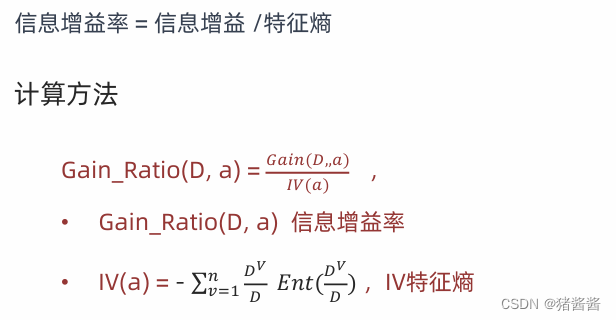

五、C4.5 决策树(不适合连续特征)

C4.5是在ID3树上进行改进的,由于ID3的算法导致会选择分类较多的那个特征作为首选特征进行分类,所以为了消除这种影响创建了C4.5决策树,他在计算信息的增益的基础上,又计算了特征熵,让信息增益比上特征熵就可以消除这种影响,我们把这个比值叫做信息增益率。

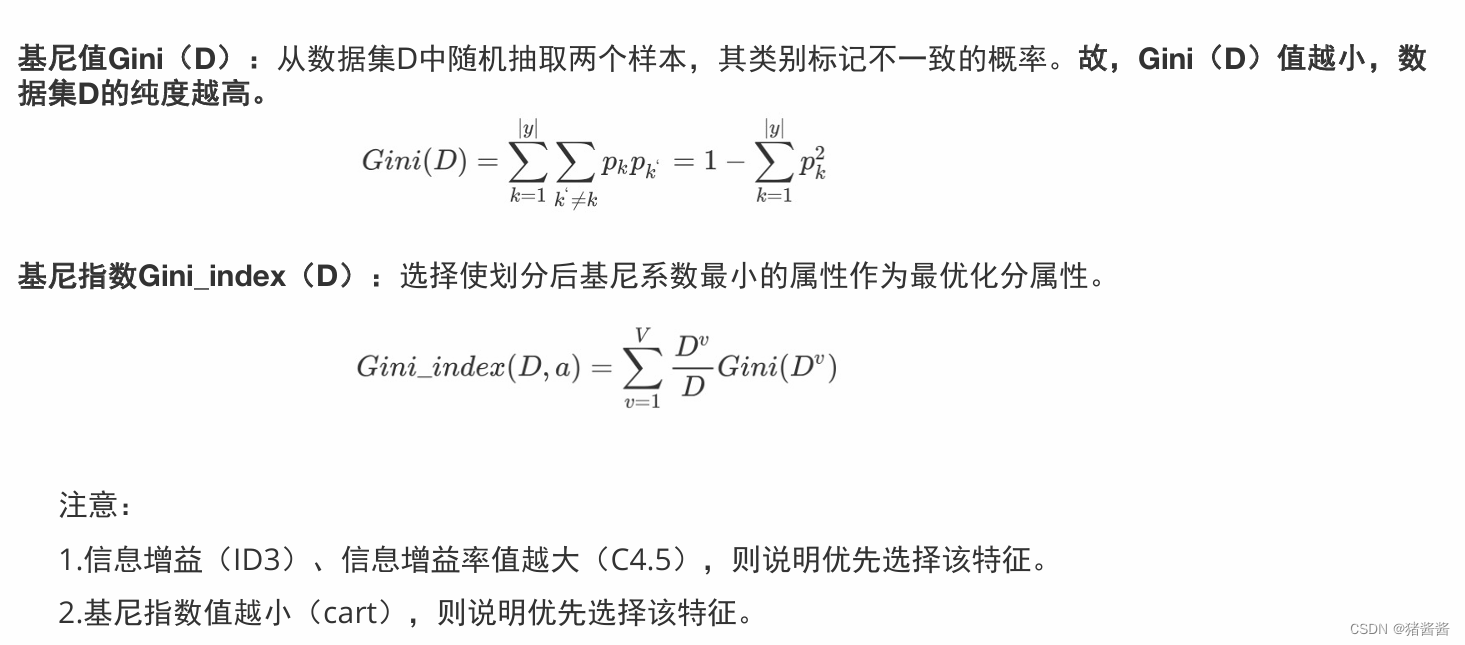

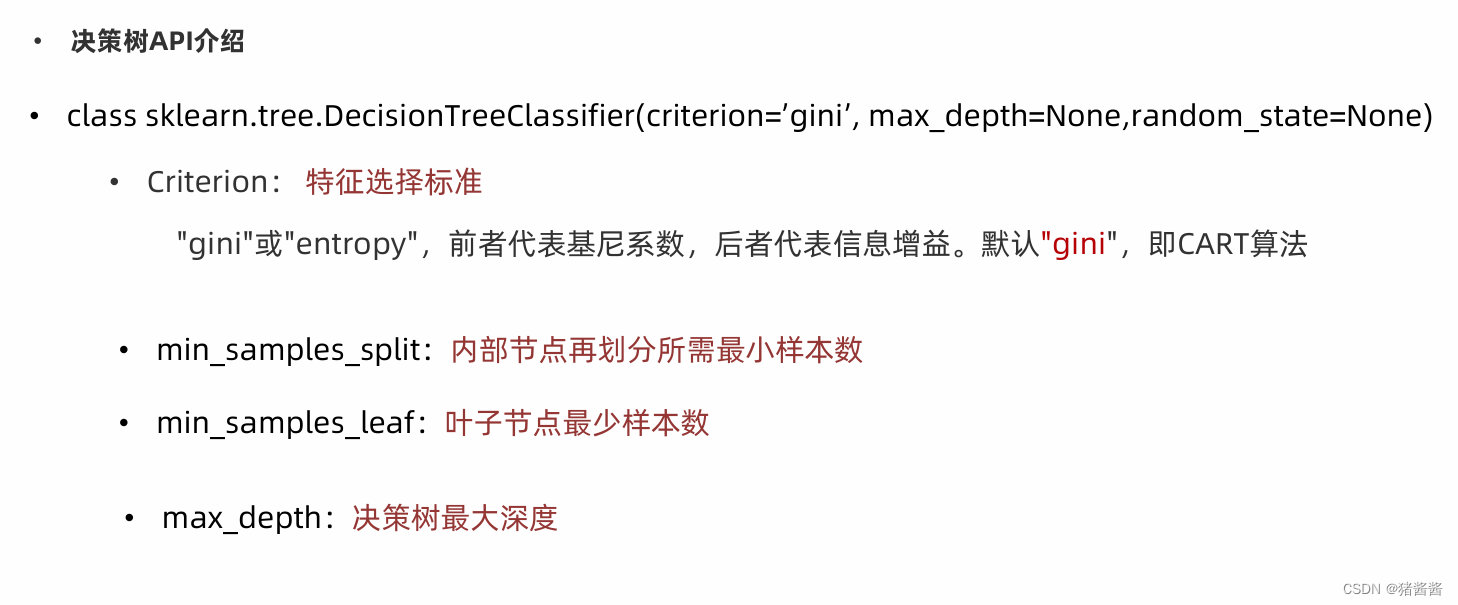

六、cart 决策树 (既可以用来分类又可以回归)

七、正则化(剪枝)

决策树的正则化叫做剪枝,分为预剪枝和后剪枝,一般用的多的还是预剪枝

2054

2054

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?