本文部分内容来自zouxy09的博客,谢谢!http://blog.csdn.net/zouxy09/article/details/9993371

以及斯坦福大学深度学习教程:http://ufldl.stanford.edu/wiki/index.php/UFLDL教程

CNN结构的连接比权值多很多,因为权值共享。CNN通过数据驱动的方式学习得到一些滤波器,作为提取输入的特征的一种方法。

典型CNN中开始几层都是卷积和下采样交替,然后在最后是一些全连接层。在全连接层时已经将所有两维特征map转化为全连接一维输入。

1、前向传播

假设该网络能处理c类分类问题,共N个训练样本。定义平方误差代价函数:

2、反向传播

调整参数。

批量梯度下降法是一种常用的优化目标函数的方法,通过对目标函数关于参数求导,来更新参数,其目标函数延梯度下降的方向快速逼近最小值。所以每次迭代都按照如下公式对

反向传播算法的思路如下:

3、卷积神经网络训练参数时的不同处

3.1卷积层

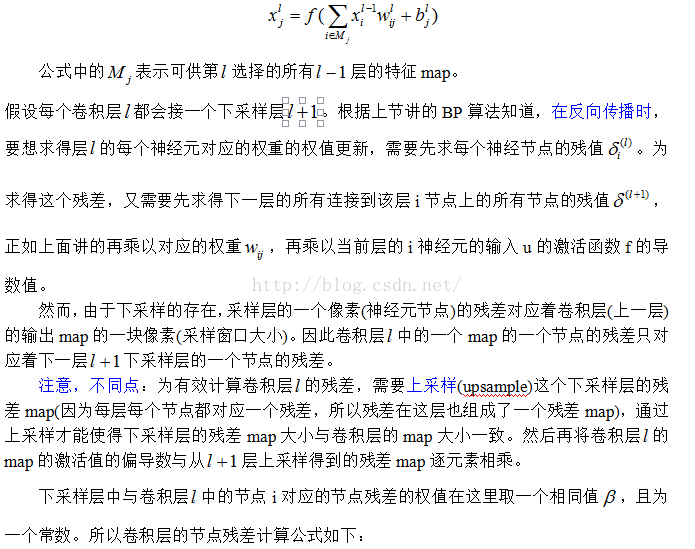

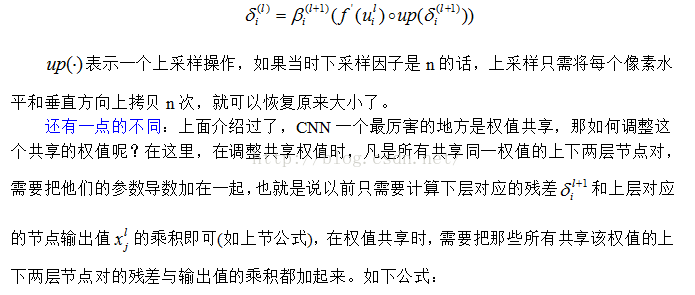

CNN中卷积层的BP更新。在卷积层,上层的特征map被一个可以学习的卷积核进行卷积,然后通过一个激活函数,就可以得到输出特征map。每个输出map可以组合卷积多个输入map,正向传播时如下计算:

本文介绍了卷积神经网络(CNN)的训练过程,包括前向传播、反向传播算法,以及CNN在卷积层和下采样层的参数调整。此外,还提到了CNN的MATLAB代码实现,源自斯坦福大学深度学习教程和zouxy09的博客分享。

本文介绍了卷积神经网络(CNN)的训练过程,包括前向传播、反向传播算法,以及CNN在卷积层和下采样层的参数调整。此外,还提到了CNN的MATLAB代码实现,源自斯坦福大学深度学习教程和zouxy09的博客分享。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3368

3368

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?