一、线性回归。

定义:利用数理统计中回归分析,来确定两种或两种以上变量间相 互依赖的定量关系的一种统计分析方法

线性回归要素:训练集、输出数据、模型、数据维度

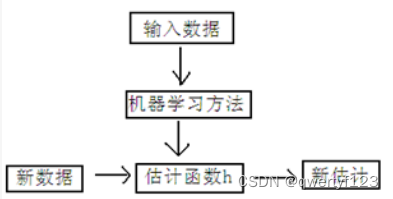

学习过程:

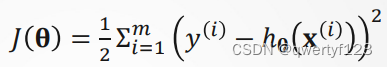

构造代价函数,寻找超平面参数θ,以求得获得最优解

代价函数:

二、线性二分类问题。

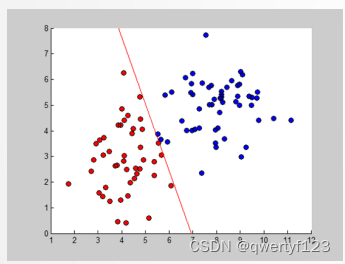

2.1 线性分类

定义:线性分类器则透过特征的线性组合来做出分类决定,以达到 此种目的。简言之

样本通过直线(或超平面)可分。

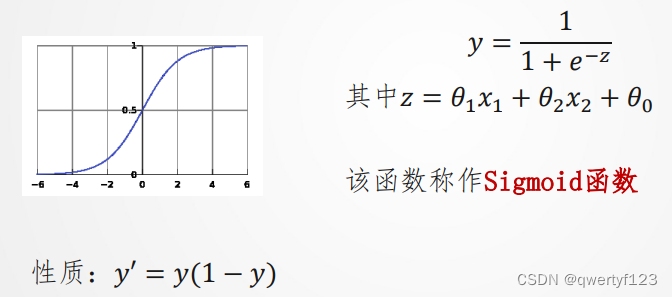

进一步,因为我们最终需要概率,结果在0-1之间,因此需要对值 做一个变换:

上述和回归方程一致,只是加了S函数,因此又称作softmax回归,注意y(i)只能取0,1。

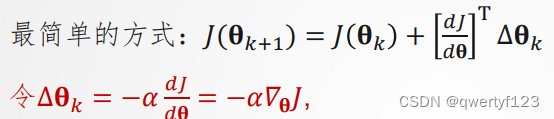

2.2 梯度下降法

三、对数回归与多分类回归。

3.1 指数回归

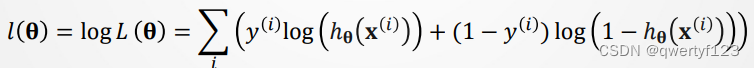

二分类问题可使用条件概率描述,且根据Bayes公式,二分类问题可使用条件概率描述,假设各样本相互独立,即服从Bernoulli分布。则的合理估计值应当是 让所有样本事件产生的几率最大,即应当是极大似然的,因此可以得到极大似然估计。

似然函数:

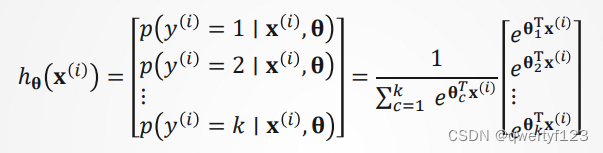

3.2 多分类回归

对于有𝑘个标记的分类问题,构造分类函数与多个分割超平面:

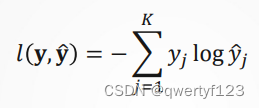

取代价函数:

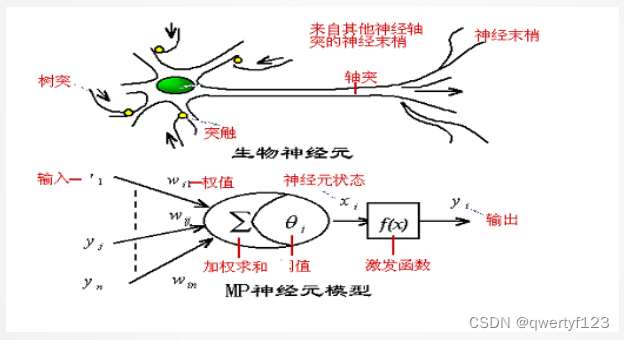

四、神经元模型

4.1 神经元模型

生物神经元:Integrate-and-fire模型、Spiking模型

人工神经元模型: M-P模型

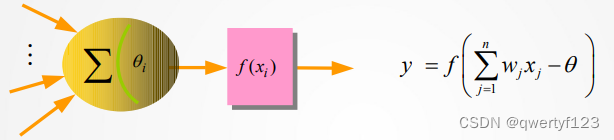

单神经元模型:

4.2 作用函数:

非对称型sigmoid函数、对称型sigmoid函数、对称阶跃型函数

4.3 Hebb规则

连接权值的调整量与输入与输出的乘积成正比

4.4 bp神经网络原理

BP网络由输入层、隐藏层、输出层组成。

输入层:信息的输入端,是读入你输入的数据的

隐藏层:信息的处理端,可以设置这个隐藏层的层数(在这里一层隐藏层,q个神经元)

输出层:信息的输出端,也就是我们要的结果

v,w分别的输入层到隐藏层,隐藏层到输出层的是权重

对于上图的只含一个隐层的神经网络模型:BP神经网络的过程主要分为两个阶段,第一阶段是信号的正向传播,从输入层经过隐含层,最后到达输出层;第二阶段是误差的反向传播,从输出层到隐含层,最后到输入层,依次调节隐含层到输出层的权重和偏置,输入层到隐含层的权重和偏置。

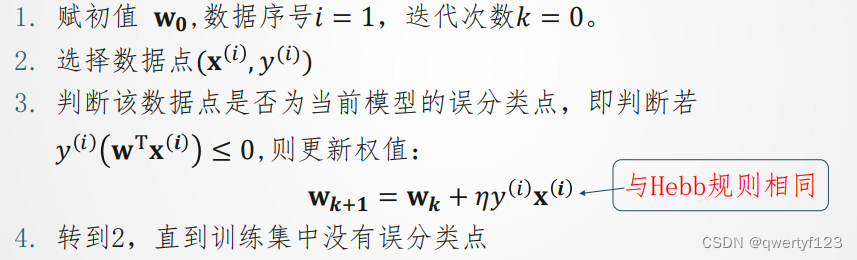

五、感知机模型

5.1 感知机原理

感知机(Perceptron)是1957年,由Rosenblatt提出,是神经网络和支持向量机的基础。

5.2 感知机模型

𝑦 = 𝑓 (𝑥) = 𝑠𝑖𝑔𝑛(𝐰T𝐱)

定义损失函数,以此判断样本是否正确分类。

寻找超平面参数,以此获得最优解。

训练数据集,建立监督学习模型,输入为w。

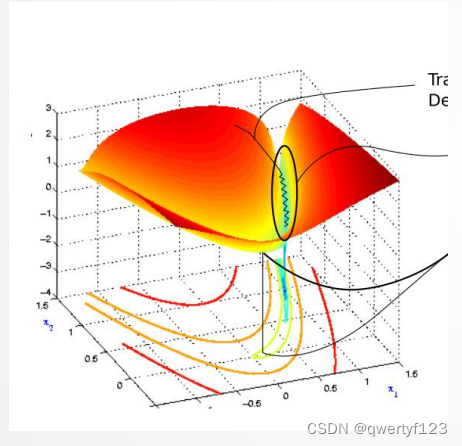

六、性能优化:

6.1 病态曲率

图为损失函数轮廓。在进入以蓝色 标记的山沟状区域之前随机开始。颜色实际上表示损失函数在特定点 处的值有多大,红色表示最大值,蓝色表示最小值。我们想要达到最 小值点,为此但需要我们穿过山沟 。这个区域就是所谓的病态曲率。

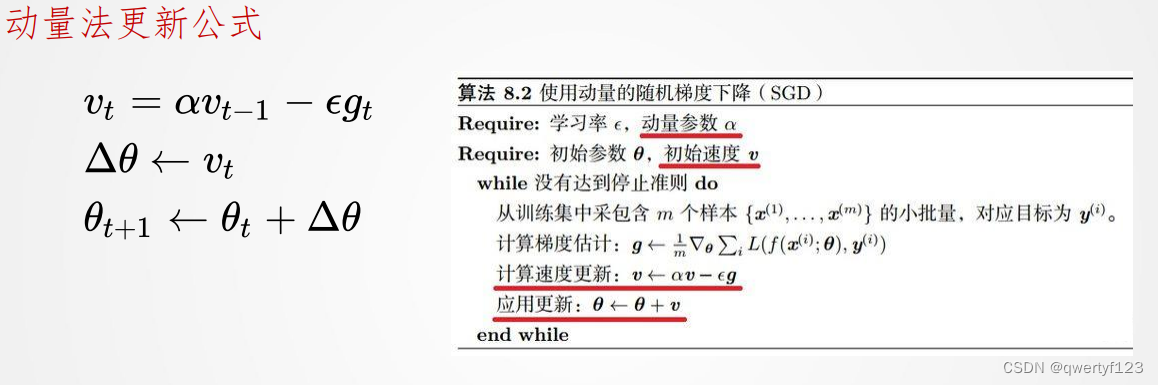

如果把原始的 SGD 想象成一个纸团在重力作用向下滚动,由 于质量小受到山壁弹力的干扰大,导致来回震荡;或者在鞍点 处因为质量小速度很快减为0,导致无法离开这块平地。

动量方法相当于把纸团换成了铁球;不容易受到外力的干扰,轨迹更加稳定;同时因为在鞍点处因为惯性的作用,更有可能离开平地。

6.2自适应梯度算法

Adaptive Gradient:自适应梯度

参数自适应变化:具有较大偏导的参数相应有一个较大的学习 率,而具有小偏导的参数则对应一个较小的学习率

具体来说,每个参数的学习率会缩放各参数反比于其历史梯度 平方值总和的平方根

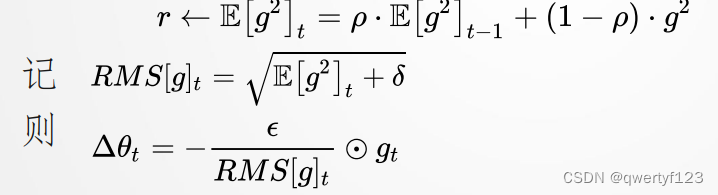

RMSProp: Root Mean Square Prop

RMSProp 解决 AdaGrad 方法中学习率过度衰减的问题,RMSProp 使用指数衰减平均以丢弃遥远的历史,使其能够快 速收敛;此外,RMSProp 还加入了超参数 𝜌 控制衰减速率。

具体来说(对比 AdaGrad 的算法描述),即修改 𝑟 为

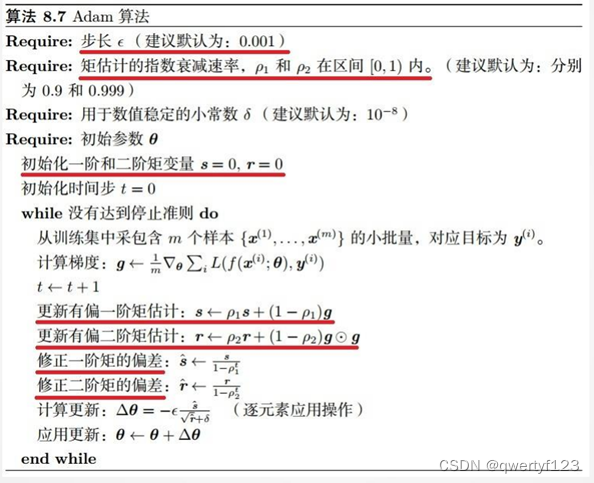

Adam算法

Adam 在 RMSProp 方法的基础上更进一步:

除了加入历史梯度平方的指数衰减平均(𝑟)外,还保留了历史梯度的指数衰减平均(𝑠),相当于动量。Adam 行为就像一个带有摩擦力的小球,在误差面上倾向于平坦的极小值。

684

684

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?