spark-env.sh

export JAVA_HOME=/usr/local/jdk1.7

export HADOOP_CONF_DIR=/usr/local/hadoop/etc/hadoop

export SPARK_MASTER_IP=10.67.2.21

export MASTER=spark://10.67.2.21:7077

export SPARK_WORKER_CORES=1

export SPARK_LOCAL_IP=10.67.2.21

1.启动master

export JAVA_HOME=/usr/local/jdk1.7

export HADOOP_CONF_DIR=/usr/local/hadoop/etc/hadoop

export SPARK_MASTER_IP=10.67.2.21

export MASTER=spark://10.67.2.21:7077

export SPARK_WORKER_CORES=1

export SPARK_LOCAL_IP=10.67.2.21

1.启动master

sbin/start-master.sh

2.启动slave

在conf/slaves中配上本机的主机名,如是ubuntu

并执行: ./start-slaves.sh --master spark://ubuntu:7077 --webui-port 8082

3.thriftserver启动./start-thriftserver --master spark://ubuntu:7077

请注意:

1.需要在/etc/hosts配置主机名与ip的对应关系

2.如果是虚拟机的话,一定将ip配定死;不能够是DHCP动态IP;要不然在重新启动计算机后,ip发生了变化,可能会导致查询假死的问题(log中会报错连接不上hdfs的问题,用旧ip)

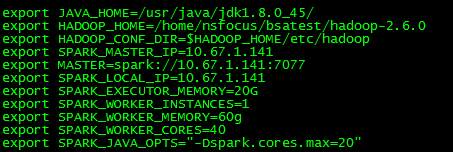

性能比较好的配置文件:

thriftserver启动时:

4545

4545

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?