机器学习的定义:

对于某类任务T和性能度量P,如果一个计算机程序在T上以P衡量的性能随着经验E而自我完善,那么我们称这个计算机程序在从经验E学习。

回归问题:问题的解是连续值,如股票、放假预测

分类问题:问题的解是有限个离散值

有监督的学习:事先知道正确问题和正确答案,让机器学习一个模型,在遇到同类的新问题的时候,能预测出答案

无监督的学习:事先不知道答案,主要用于分类问题,如划分聚类,多组混合声音的分离

m:训练样本数量

xi:输入变量

yi:输出变量

(x(i),y(i)),第i个训练样本,训练集的第i行

X输入空间,Y输出空间

h:训练的假设函数,x到y的映射

单变量线性回归

代价函数:

θ0,θ1,模型参数

hθ(x)=θ0+θ1x

求解θ0与θ1,最小化问题即(hθ(x)-y)最小化

线性回归的整体目标函数

平方误差代价函数是解决回归问题最常用的手段

-------------

假设hθ(x)=θ1x

hθ(x),对于固定的θ,是x的函数;

J(θ1),是θ1的函数,假设有3个样本(1,1),(2,2),(3,3),要找到是J(θ1)最小化的θ1

当

假设hθ(x)=θ0+θ1x

平方误差代价函数如右面弓形图所示,位于同一个同心圆上的所有θ0、θ1,J是相同的

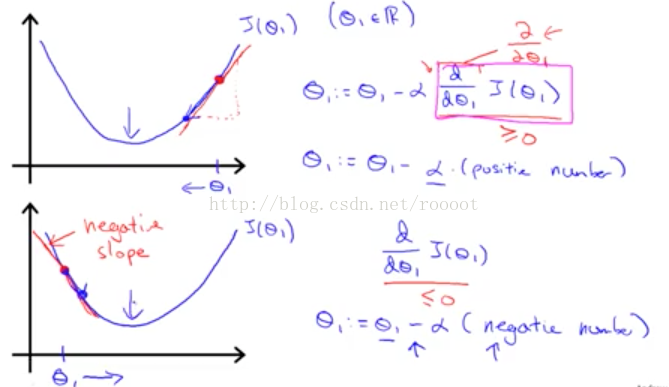

梯度下降法

形象比喻:在山上,环顾四周,找出当前最快的下山方向,然后走一步,然后重复这个过程;

数学表达:

θ0、θ1要同步更新,即2个分别用上一次θ0、θ1的计算,然后再将2个新的值作为下一次计算的输入。 α为学习速率

对θ1求导数,相当于求J(θ1)在那点的斜率

越靠近最优解时,斜率越来越小,所以更新幅度会越来越小。

针对上面赋值表达式中的微分项进行拆解,得到:

其中第二个表达式中多乘以了个xii, 是因为2次方求导的话还会对里面的等式进一步求导。

643

643

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?