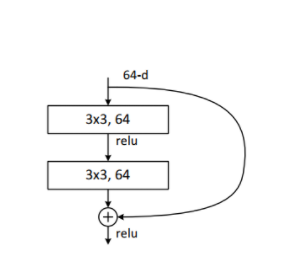

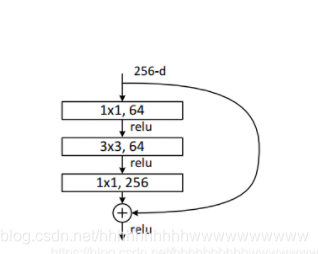

在ResNet网络结构中会用到两种残差模块,一种是以两个3*3的卷积网络串接在一起作为一个残差模块,另外一种是1*1、3*3、1*1的3个卷积网络串接在一起作为一个残差模块。如下图所示:

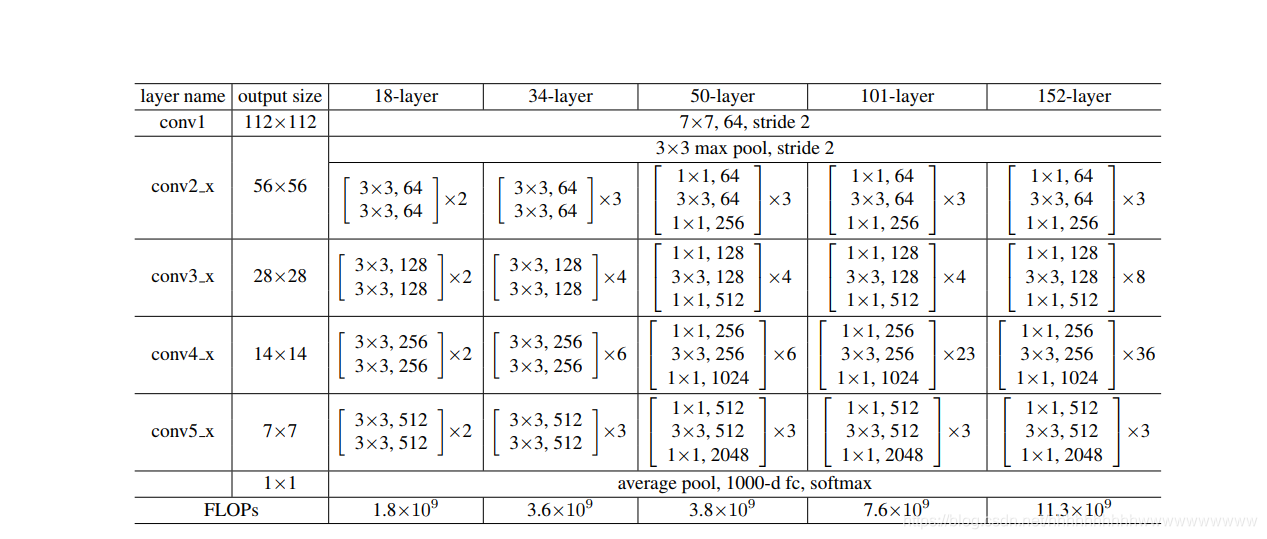

ResNet有不同的网络层数,比较常用的是18-layer,34-layer,50-layer,101-layer,152-layer。他们都是由上述的残差模块堆叠在一起实现的。 下图展示了不同的ResNet模型。

实现残差模块

=======

第一个残差模块

第一个残差模块

class BasicBlock(layers.Layer):

def init(self, filter_num, stride=1):

super(BasicBlock, self).init()

self.conv1 = layers.Conv2D(filter_num, (3, 3), strides=stride, padding=‘same’)

self.bn1 = layers.BatchNormalization()

self.relu = layers.Activation(‘relu’)

self.conv2 = layers.Conv2D(filter_num, (3, 3), strides=1, padding=‘same’)

self.bn2 = layers.BatchNormalization()

if stride != 1:

self.downsample = Sequential()

self.downsample.add(layers.Conv2D(filter_num, (1, 1), strides=stride))

else:

self.downsample = lambda x: x

def call(self, input, training=None):

out = self.conv1(input)

out = self.bn1(out)

out = self.relu(out)

out = self.conv2(out)

out = self.bn2(out)

identity = self.downsample(input)

output = layers.add([out, identity])

output = tf.nn.relu(output)

return output

第二个残差模块

第二个残差模块

class Block(layers.Layer):

def init(self, filters, downsample=False, stride=1):

super(Block, self).init()

self.downsample = downsample

self.conv1 = layers.Conv2D(filters, (1, 1), strides=stride, padding=‘same’)

self.bn1 = layers.BatchNormalization()

self.relu = layers.Activation(‘relu’)

self.conv2 = layers.Conv2D(filters, (3, 3), strides=1, padding=‘same’)

self.bn2 = layers.BatchNormalization()

self.conv3 = layers.Conv2D(4 * filters, (1, 1), strides=1, padding=‘same’)

self.bn3 = layers.BatchNormalization()

if self.downsample:

self.shortcut = Sequential()

self.shortcut.add(layers.Conv2D(4 * filters, (1, 1), strides=stride))

self.shortcut.add(layers.BatchNormalization(axis=3))

def call(self, input, training=None):

out = self.conv1(input)

out = self.bn1(out)

out = self.relu(out)

out = self.conv2(out)

out = self.bn2(out)

out = self.relu(out)

out = self.conv3(out)

out = self.bn3(out)

if self.downsample:

shortcut = self.shortcut(input)

else:

shortcut = input

output = layers.add([out, shortcut])

output = tf.nn.relu(output)

return output

ResNet18, ResNet34

==================

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers, Sequential

第一个残差模块

class BasicBlock(layers.Layer):

def init(self, filter_num, stride=1):

super(BasicBlock, self).init()

self.conv1 = layers.Conv2D(filter_num, (3, 3), strides=stride, padding=‘same’)

self.bn1 = layers.BatchNormalization()

self.relu = layers.Activation(‘relu’)

self.conv2 = layers.Conv2D(filter_num, (3, 3), strides=1, padding=‘same’)

self.bn2 = layers.BatchNormalization()

if stride != 1:

self.downsample = Sequential()

self.downsample.add(layers.Conv2D(filter_num, (1, 1), strides=stride))

else:

self.downsample = lambda x: x

def call(self, input, training=None):

out = self.conv1(input)

out = self.bn1(out)

out = self.relu(out)

out = self.conv2(out)

out = self.bn2(out)

identity = self.downsample(input)

output = layers.add([out, identity])

output = tf.nn.relu(output)

return output

class ResNet(keras.Model):

def init(self, layer_dims, num_classes=10):

super(ResNet, self).init()

预处理层

self.padding = keras.layers.ZeroPadding2D((3, 3))

self.stem = Sequential([

layers.Conv2D(64, (7, 7), strides=(2, 2)),

layers.BatchNormalization(),

layers.Activation(‘relu’),

layers.MaxPool2D(pool_size=(3, 3), strides=(2, 2), padding=‘same’)

])

resblock

self.layer1 = self.build_resblock(64, layer_dims[0])

self.layer2 = self.build_resblock(128, layer_dims[1], stride=2)

self.layer3 = self.build_resblock(256, layer_dims[2], stride=2)

self.layer4 = self.build_resblock(512, layer_dims[3], stride=2)

全局池化

self.avgpool = layers.GlobalAveragePooling2D()

全连接层

self.fc = layers.Dense(num_classes, activation=tf.keras.activations.softmax)

def call(self, input, training=None):

x=self.padding(input)

x = self.stem(x)

x = self.layer1(x)

x = self.layer2(x)

x = self.layer3(x)

x = self.layer4(x)

[b,c]

x = self.avgpool(x)

x = self.fc(x)

return x

def build_resblock(self, filter_num, blocks, stride=1):

res_blocks = Sequential()

res_blocks.add(BasicBlock(filter_num, stride))

for pre in range(1, blocks):

res_blocks.add(BasicBlock(filter_num, stride=1))

return res_blocks

def ResNet34(num_classes=10):

return ResNet([2, 2, 2, 2], num_classes=num_classes)

def ResNet34(num_classes=10):

return ResNet([3, 4, 6, 3], num_classes=num_classes)

model = ResNet34(num_classes=1000)

model.build(input_shape=(1, 224, 224, 3))

print(model.summary()) # 统计网络参数

ResNet50、ResNet101、ResNet152

============================

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers, Sequential

第一个残差模块

class Block(layers.Layer):

def init(self, filters, downsample=False, stride=1):

super(Block, self).init()

self.downsample = downsample

self.conv1 = layers.Conv2D(filters, (1, 1), strides=stride, padding=‘same’)

self.bn1 = layers.BatchNormalization()

self.relu = layers.Activation(‘relu’)

self.conv2 = layers.Conv2D(filters, (3, 3), strides=1, padding=‘same’)

self.bn2 = layers.BatchNormalization()

self.conv3 = layers.Conv2D(4 * filters, (1, 1), strides=1, padding=‘same’)

self.bn3 = layers.BatchNormalization()

if self.downsample:

self.shortcut = Sequential()

self.shortcut.add(layers.Conv2D(4 * filters, (1, 1), strides=stride))

self.shortcut.add(layers.BatchNormalization(axis=3))

def call(self, input, training=None):

out = self.conv1(input)

out = self.bn1(out)

out = self.relu(out)

out = self.conv2(out)

out = self.bn2(out)

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Python开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip1024c (备注Python)

做了那么多年开发,自学了很多门编程语言,我很明白学习资源对于学一门新语言的重要性,这些年也收藏了不少的Python干货,对我来说这些东西确实已经用不到了,但对于准备自学Python的人来说,或许它就是一个宝藏,可以给你省去很多的时间和精力。

别在网上瞎学了,我最近也做了一些资源的更新,只要你是我的粉丝,这期福利你都可拿走。

我先来介绍一下这些东西怎么用,文末抱走。

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

(4)200多本电子书

这些年我也收藏了很多电子书,大概200多本,有时候带实体书不方便的话,我就会去打开电子书看看,书籍可不一定比视频教程差,尤其是权威的技术书籍。

基本上主流的和经典的都有,这里我就不放图了,版权问题,个人看看是没有问题的。

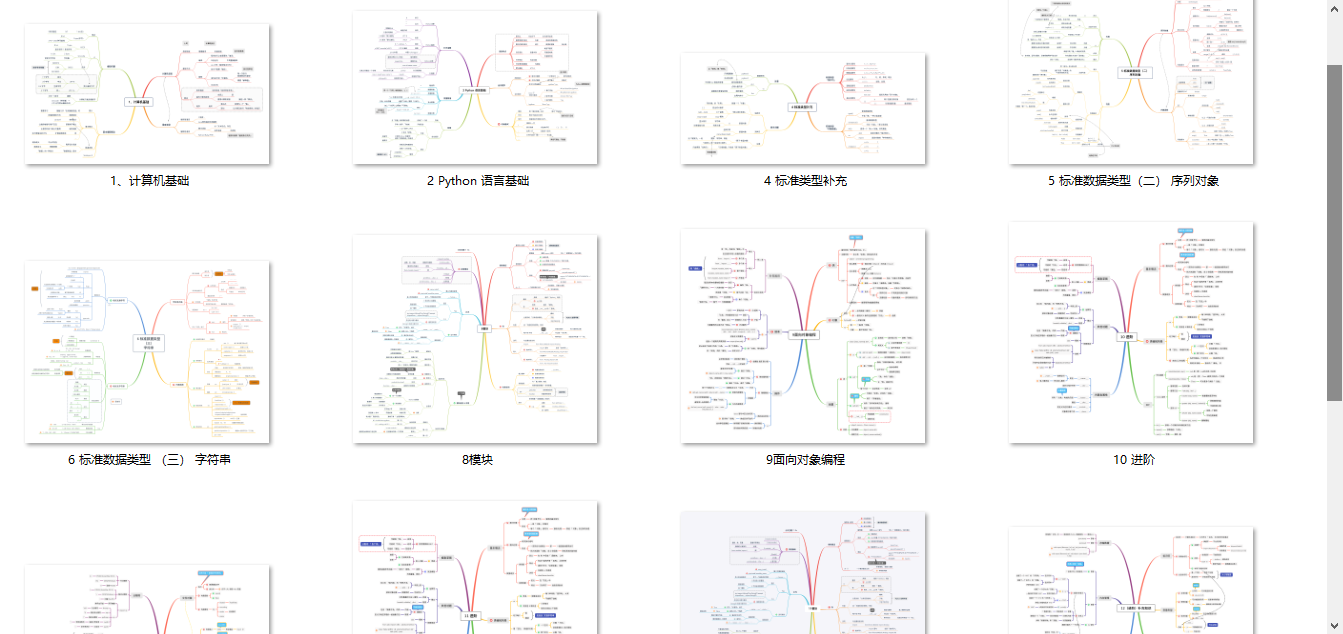

(5)Python知识点汇总

知识点汇总有点像学习路线,但与学习路线不同的点就在于,知识点汇总更为细致,里面包含了对具体知识点的简单说明,而我们的学习路线则更为抽象和简单,只是为了方便大家只是某个领域你应该学习哪些技术栈。

(6)其他资料

还有其他的一些东西,比如说我自己出的Python入门图文类教程,没有电脑的时候用手机也可以学习知识,学会了理论之后再去敲代码实践验证,还有Python中文版的库资料、MySQL和HTML标签大全等等,这些都是可以送给粉丝们的东西。

这些都不是什么非常值钱的东西,但对于没有资源或者资源不是很好的学习者来说确实很不错,你要是用得到的话都可以直接抱走,关注过我的人都知道,这些都是可以拿到的。

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

ps://img-blog.csdnimg.cn/c741a91b05a542ba9dc8abf2f2f4b1af.png)

(6)其他资料

还有其他的一些东西,比如说我自己出的Python入门图文类教程,没有电脑的时候用手机也可以学习知识,学会了理论之后再去敲代码实践验证,还有Python中文版的库资料、MySQL和HTML标签大全等等,这些都是可以送给粉丝们的东西。

这些都不是什么非常值钱的东西,但对于没有资源或者资源不是很好的学习者来说确实很不错,你要是用得到的话都可以直接抱走,关注过我的人都知道,这些都是可以拿到的。

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

[外链图片转存中…(img-oQRBxwLd-1712878913780)]

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?