1.前言

上一篇主要研究了《最小二乘用于分类》也实现了模式识别。然而,虽然与错误分类率对应的0/1损失的间隔函数是单调非增的,但是L2损失并不是单调非增的,所以使用最小二乘学习法进行模式识别还是有些不自然。这里,再次综述一下支持向量机分类器,关于SVM的话题已经写了近10篇文章了。本文更偏重于介绍支持向量机分类器中所使用的损失概念,并且讨论支持向量机分类器向鲁棒学习进行拓展的方法。

2.间隔最大化分类

这里将对基于间隔最大化原理的支持向量机分类器算法做详细分析。首先从线性的2分类问题进行说明。

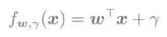

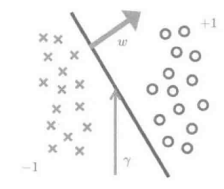

w为把正样本与负样本隔离开的超平面的法线,γ为截距,如下图所示:

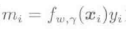

w是分类超平面的法线,γ是截距只要能够对各个训练样本的间隔:

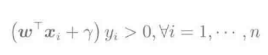

为正时的w和γ进行学习,就可以利用这个模型对所有的训练样本进行正确地分类了:

像上式那样没有等号的开集约束条件,在数学上坑你比较难以处理,所以这里利用参数w和γ的值可以任意决定的性质,将其变换为如下别这样包含等号的闭集约束条件:

当存在满足这样条件的w和γ时,我们称这样的训练样本为线性可分样本。2.1 硬间隔支持向量机分类器

对于线性可分的训练样本,可以把所有的训练样本都正确分类的解有无数个。这里一般选取能够最充裕地把正样本和负样本进行分离的超平面做为最优解、这个最充裕的概念,是与正则化后的间隔的最小值相对应的:

本文详细介绍了有监督分类中的支持向量机,包括间隔最大化的硬间隔和软间隔分类器,以及如何通过二次规划求解支持向量机问题。同时,探讨了支持向量机的稀疏性和应用核映射实现非线性模型的方法。

本文详细介绍了有监督分类中的支持向量机,包括间隔最大化的硬间隔和软间隔分类器,以及如何通过二次规划求解支持向量机问题。同时,探讨了支持向量机的稀疏性和应用核映射实现非线性模型的方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?