Backpropagation算法是目前绝大多数神经网络在优化参数时用到的算法,具有快速方便容易实现的优点。那么它是如何实现的呢?

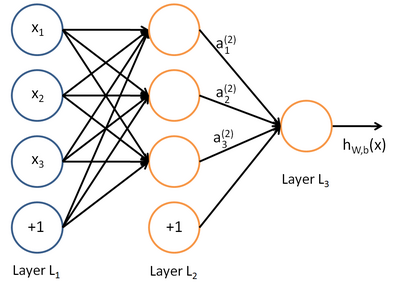

首先看一张典型神经网络结构图:

上图是一个包含了输入层L1、一个 隐含层L2和输出层L3的简单神经网络,它的处理流程为根据输入层的input以及相应的权重和偏置(图中黑色带箭头的边),通过隐含层的加工,最终将结果映射到输出层得到结果。模型可以抽象表示为 y=f(x),x,y分别表示输入输出向量,在分类问题中,y表示相应的类别 ,显然这是一个判别模型。

由神经网络的处理过程,想要得到输出 y ,我们必须知道上图中每条边的参数值,这也是神经网络中最重要的部分。在神经网络中是通过迭代的方法来计算这些参数的,具体来讲就是,首先初始化这些参数,通过神经网络的前向传导过程计算得到输出

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3717

3717

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?