LSTM-Multihead-Attention回归预测 基于长短期记忆神经网络(LSTM)结合多头注意力机制(Multihead-Attention)多变量回归预测[可以修改为时序预测,购买前免费]

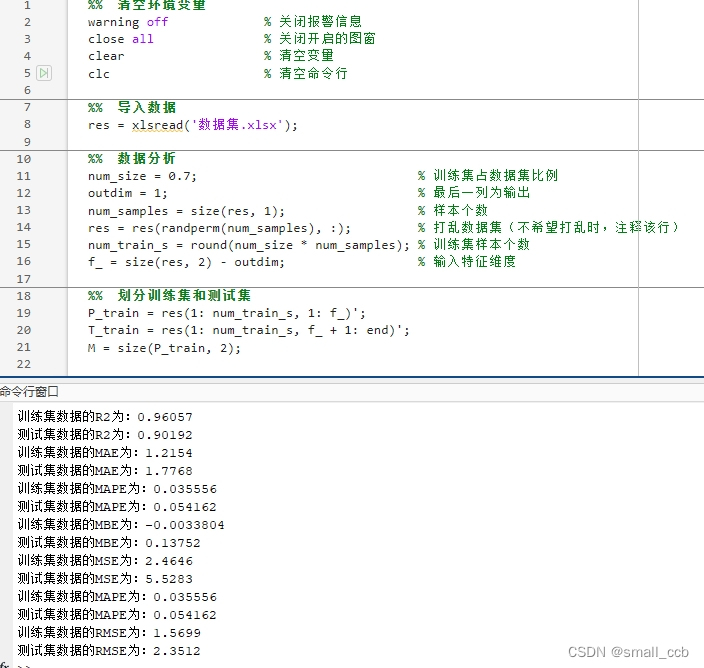

[灯泡]程序已经调试好,[灯泡]无需更改代码替换数据集即可运行!数据格式为excel!

[灯泡]LSTM可以更换为GRU,BiLSTM等

[灯泡]多头注意力(Multi-Head Attention)是一种基于自注意力机制(self-attention)的改进方法。自注意力是一种能够计算出输入序列中每个位置的权重,因此可以很好地处理序列中长距离依赖关系的问题。

❶、运行环境要求MATLAB版本为2021b及其以上

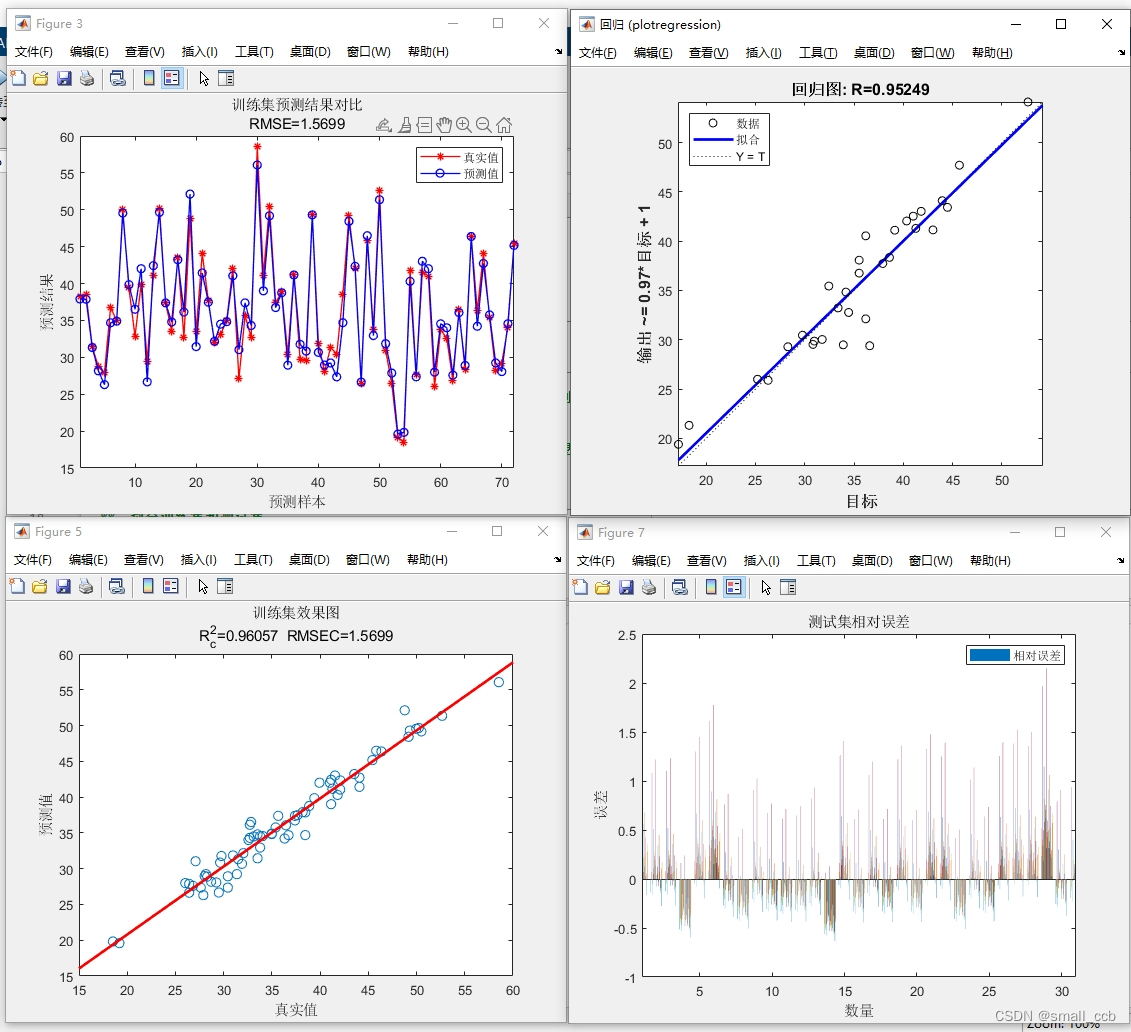

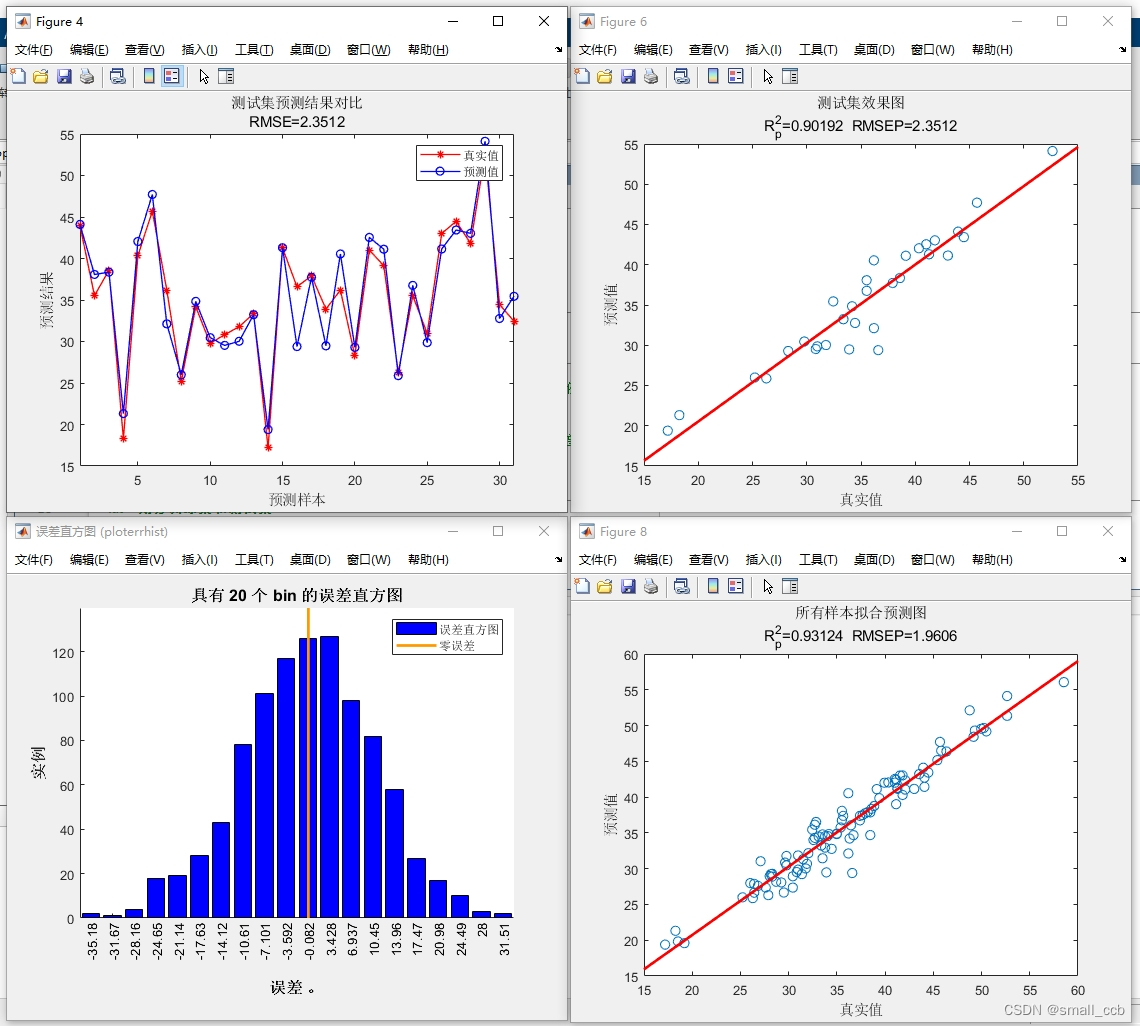

❷、评价指标包括:R2、MAE、MBE、MAPE、MSE、RMSE等,图很多,符合您的需要

❸、代码中文注释清晰,质量极高

❹、赠送测试数据集,可以直接运行源程序。替换你的数据即可用 适合新手小白

注:保证源程序运行,售出概不退换,不负责讲解。

1750

1750

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?