一.最大似然估计

选择一个(一组)参数使得实验结果具有最大概率。

A. 如果分布是离散型的,其分布律,

是待估计的参数,这里我们假设

为已知量,则:设X1, X2, ... , Xn 是来自于X的样本,X1,X2,...Xn的联合分布律为:

设x1,x2,...xn是X1,X2,..Xn的一个样本值,则可知X1,..Xn取x1,..,x2的概率,即事件{X1 = x1,...,Xn=xn}发生的概率为:

这里,因为样本值是已知的,所以(2)是的函数,

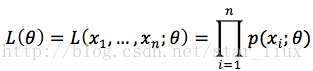

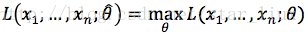

最大似然估计:已知样本值x1,...xn,选取一组参数,使概率

为最大估计值。即取

的极大似然估计值。

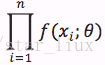

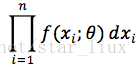

B.如果分布X是连续型,其概率密度

为待估计参数,则事件X1,...Xn的联合密度为:

设x1,..xn为相应X1,...Xn的一个样本值,则随机点(X1,...,Xn)落在(x1,..xn)的领域内的概率近似为:

最大似然估计即为求

而变,故似然函数为:

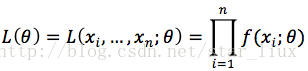

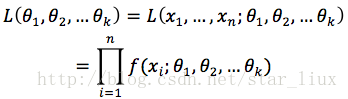

C. 求最大似然估计参数的步骤:

(1) 写出似然函数:

这里,n为样本数量,似然函数表示n个样本(事件)同时发生的概率。

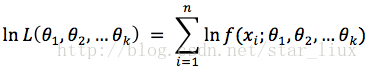

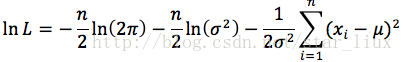

(2) 对似然函数取对数:

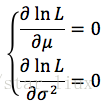

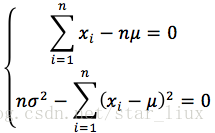

(3) 将对数似然函数对各参数求偏导数并令其为0,得到对数似然方程组。

(4) 从方程组中解出各个参数。

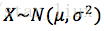

D. 举例:

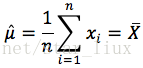

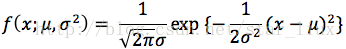

设

解:X的概率密度为:

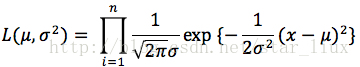

似然函数为:

令

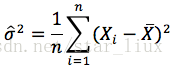

解得:

二.逻辑回归

逻辑回归不是回归,而是分类。是从线性回归中衍生出来的分类策略。当y值为只有两个值时(比如0,1),线性回归不能很好的拟合时,用逻辑回归来对其进行二值分类。

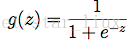

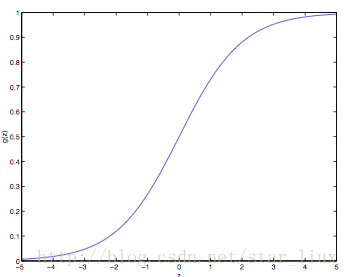

这里逻辑函数(S型函数)为:

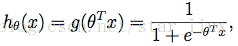

于是,可得估计函数:

这里,我们的目的是求出一组值,使得这组

可以很好的模拟出训练样本的类值。

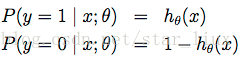

由于二值分类很像二项分布,我们把单一样本的类值假设为发生概率,则:

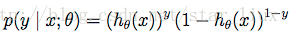

可以写成概率一般式:

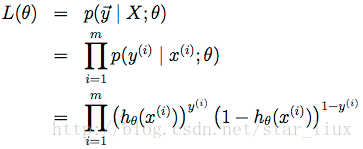

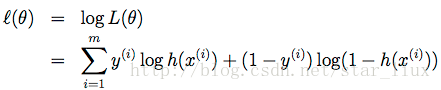

由最大似然估计原理,我们可以通过m个训练样本值,来估计出值,使得似然函数值最大:

这里,

我们用随机梯度上升法,求使

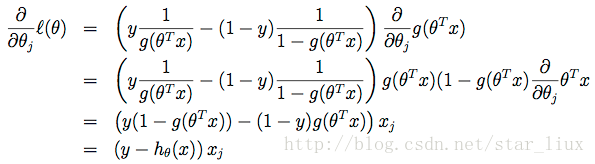

值,迭代函数为:

这里

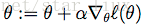

分量进行求导,得:

于是,随机梯度上升法迭代算法为:

repeat until convergence{

for i = 1 to m{

}

}

思考:

我们求最大似然函数参数的立足点是步骤C,即求出每个参数方向上的偏导数,并让偏导数为0,最后求解此方程组。由于中参数数量的不确定,考虑到可能参数数量很大,此时直接求解方程组的解变的很困难。于是,我们用随机梯度上升法,求解方程组的值。

备注:

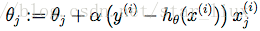

(a) 公式(14)的化简基于g(z)导函数,如下:

(b) 下图为逻辑函数g(z)的分布图:

7333

7333

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?