二、使用

1)Ollama 常用命令

Ollama 都有哪些指令?

终端输入 ollama:

Usage:

ollama [flags]

ollama [command]

Available Commands:

serve Start ollama

create Create a model from a Modelfile

show Show information for a model

run Run a model

pull Pull a model from a registry

push Push a model to a registry

list List models

ps List running models

cp Copy a model

rm Remove a model

help Help about any command

Flags:

-h, --help help for ollama

-v, --version Show version information

Use "ollama [command] --help" for more information about a command.

我们翻译过来,和 docker 命令非常类似:

ollama serve # 启动ollama

ollama create # 从模型文件创建模型

ollama show # 显示模型信息

ollama run # 运行模型,会先自动下载模型

ollama pull # 从注册仓库中拉取模型

ollama push # 将模型推送到注册仓库

ollama list # 列出已下载模型

ollama ps # 列出正在运行的模型

ollama cp # 复制模型

ollama rm # 删除模型

2)Ollama 模型库

类似 Docker 托管镜像的 Docker Hub,Ollama 也有个 Library 托管支持的大模型。

从0.5B 到 236B,各种模型应有尽有,大家可以根据自己的机器配置,选用合适的模型。

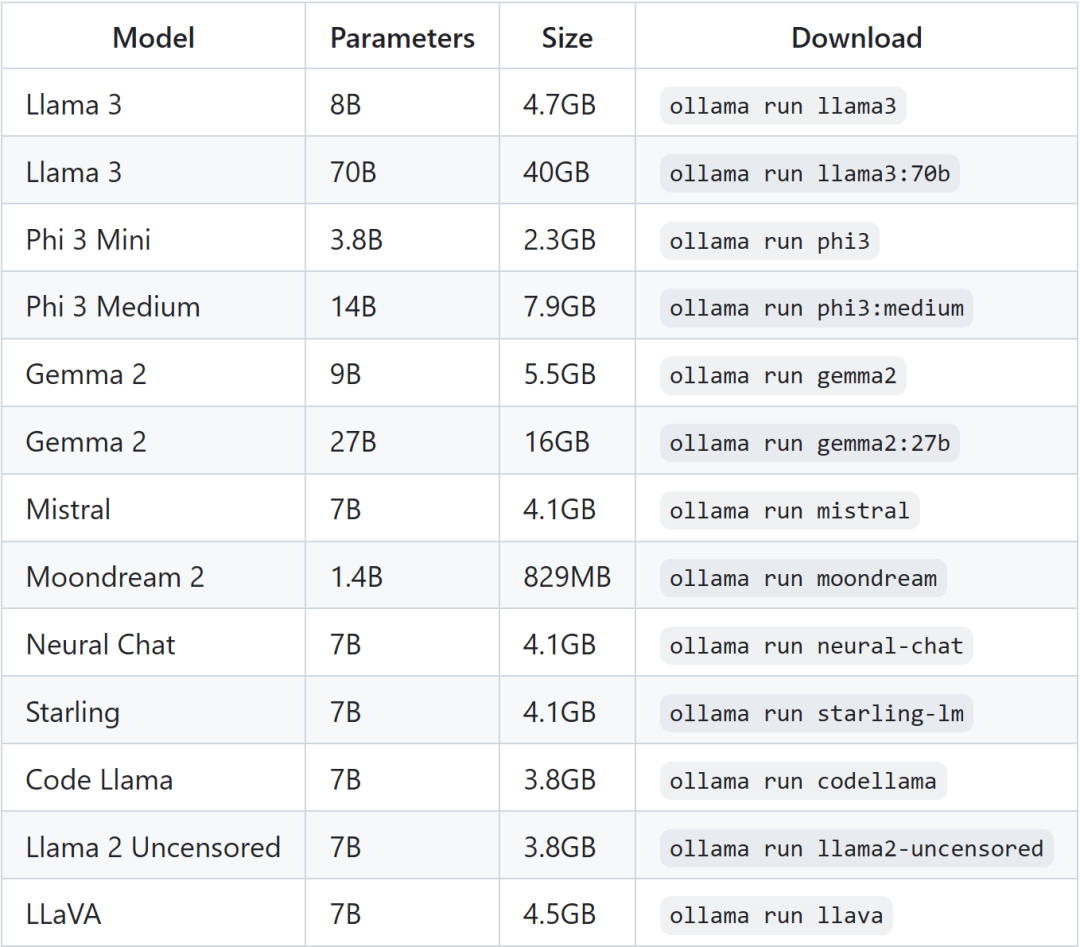

同时,官方也贴心地给出了不同 RAM 推荐的模型大小,以及命令:

注:至少确保,8GB的 RAM 用于运行 7B 模型,16GB 用于运行 13B 模型,32GB 用于运行 33B 模型。这些模型需经过量化。

因为我的是一台没有 GPU 的轻量级服务器,所以跑一个 0.5B 的 qwen 模型,给大家做下演示:

root@535ec4243693:/# ollama run qwen2:0.5b

pulling manifest

pulling 8de95da68dc4... 100% ▕████████████████████████████████████▏ 352 MB

pulling 62fbfd9ed093... 100% ▕████████████████████████████████████▏ 182 B

pulling c156170b718e... 100% ▕████████████████████████████████████▏ 11 KB

pulling f02dd72bb242... 100% ▕████████████████████████████████████▏ 59 B

pulling 2184ab82477b... 100% ▕████████████████████████████████████▏ 488 B

verifying sha256 digest

writing manifest

removing any unused layers

success

3)自定义模型

如果要使用的模型不在 Ollama 模型库怎么办?

GGUF (GPT-Generated Unified Format)模型

GGUF 是由 llama.cpp 定义的一种高效存储和交换大模型预训练结果的二进制格式。

Ollama 支持采用 Modelfile 文件中导入 GGUF 模型。

下面我们以本地的 llama3 举例,详细介绍下实操流程:

step 1: 新建一个文件名为 Modelfile 的文件,然后在其中指定 llama3 模型路径:

FROM /root/models/xxx/Llama3-FP16.gguf

step 2: 创建模型

ollama create llama3 -f Modelfile

step 3: 运行模型

ollama run llama3

终端出现 >>,开启和 Ollama 的对话旅程吧~

下面是几个常用案例:

- 多行输入:用"""包裹

>>> """Hello,

... world!

... """

I'm a basic program that prints the famous "Hello, world!" message to the console.

- 多模态模型:文本 + 图片地址

>>> What's in this image? /Users/jmorgan/Desktop/smile.png

The image features a yellow smiley face, which is likely the central focus of the picture.

- 将提示作为参数传递

$ ollama run llama3 "Summarize this file: $(cat README.md)"

Ollama is a lightweight, extensible framework for building and running language models on the local machine.

PyTorch or Safetensors 模型

Ollama 本身不支持 PyTorch or Safetensors 类型,不过可以通过 llama.cpp 进行转换、量化处理成 GGUF 格式,然后再给 Ollama 使用。

关于 llama.cpp 的使用,小伙伴可以前往官方仓库:https://github.com/ggerganov/llama.cpp。下载后需要编译使用,成功后会在目录下生成三个可执行文件:

main:模型推理

quantize:模型量化,包括1.5位、2位、3位、4位、5位、6位和8位整数量化

server:提供模型API服务

不过我们只能需要用到它的模型转换功能,还是以 llama3 举例:首先安装项目依赖,然后调用 convert.py 实现模型转换:

pip install -r requirements.txt

python convert.py /root/xxx/Llama3-Chinese-8B-Instruct/ --outtype f16 --vocab-type bpe --outfile ./models/Llama3-FP16.gguf

提示词实现模型定制

刚才我们介绍了 Modelfile,其中我们还可以自定义提示词,实现更个性化的智能体。

假设现在你从模型库下载了一个 llama3:

ollama pull llama3

然后我们新建一个 Modelfile,其中输入:

FROM llama3

# 设置温度参数

PARAMETER temperature 0.7

# 设置SYSTEM 消息

SYSTEM """

你是猴哥的 AI 智能助手,将基于猴哥发表的所有文章内容回答问题,拒绝回答任何无关内容。

"""

Ollama 实现模型量化

Ollama 原生支持 FP16 or FP32 模型的进一步量化,支持的量化方法包括:

Q4_0 Q4_1 Q5_0 Q5_1 Q8_0

K-means Quantizations:

Q3_K_S Q3_K_M Q3_K_L Q4_K_S Q4_K_M Q5_K_S Q5_K_M Q6_K

在编写好 Modelfile 文件后,创建模型时加入 -q 标志:

FROM /path/to/my/gemma/f16/model

ollama create -q Q4_K_M mymodel -f Modelfile

最后

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频,免费分享!

一、大模型全套的学习路线

L1级别:AI大模型时代的华丽登场

L2级别:AI大模型API应用开发工程

L3级别:大模型应用架构进阶实践

L4级别:大模型微调与私有化部署

达到L4级别也就意味着你具备了在大多数技术岗位上胜任的能力,想要达到顶尖水平,可能还需要更多的专业技能和实战经验。

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、大模型经典PDF书籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

有需要全套的AI大模型学习资源的小伙伴,可以微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】

358

358

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?