- 参考LectureNotes4

- 参考BackPropagation Through Time

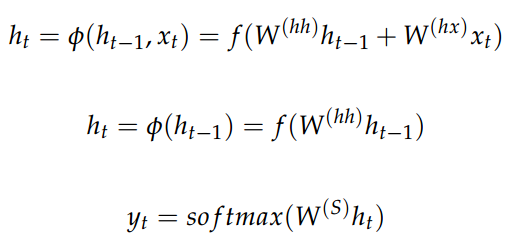

- 语言模型

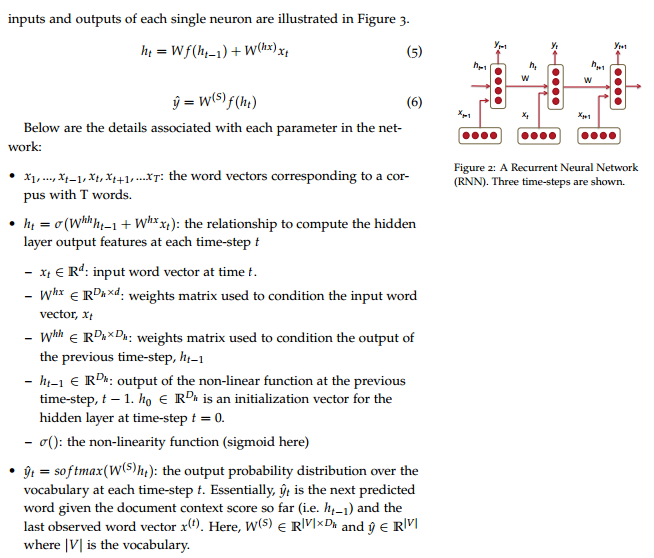

- rnn

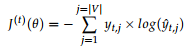

- 损失函数:交叉熵

- Vanishing Gradient 和 Gradient Explosion Problems 问题解决办法:

- 改变对 Whh 的初始化方法

- 不使用sigmoid,而使用ReLU

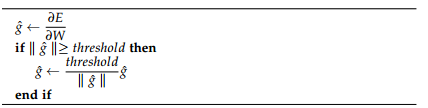

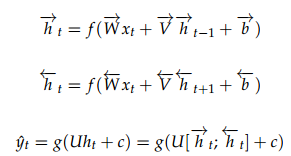

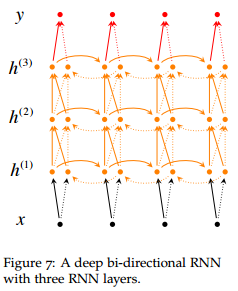

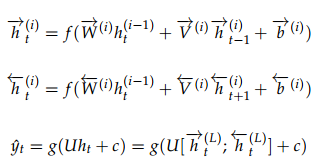

- Deep Bidirectional RNN:可以参考”Bidirectional Recurrent Neural Networks”

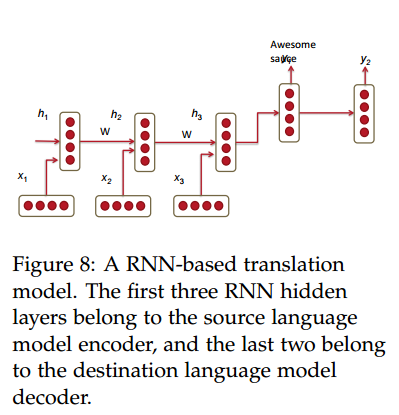

- 将RNN应用于翻译模型

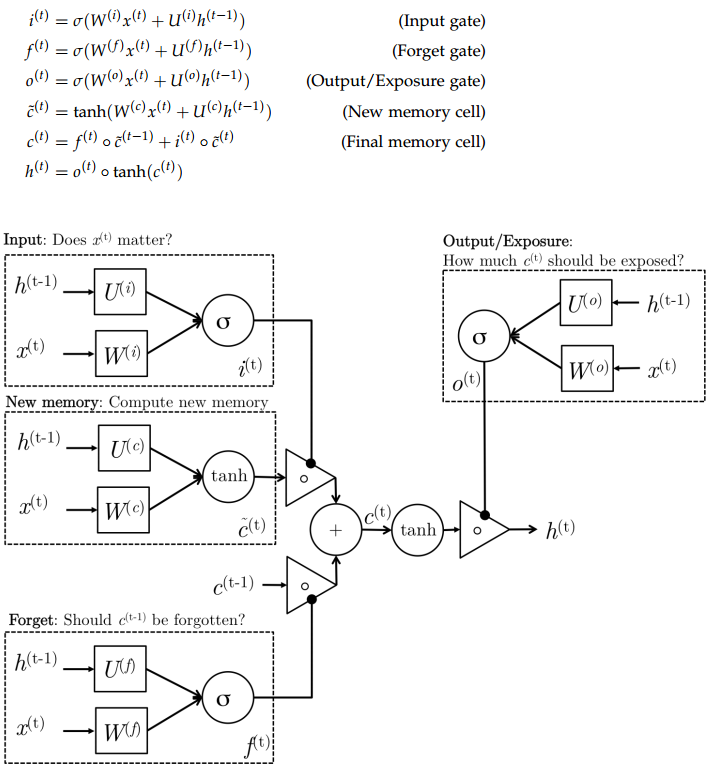

- 使用不同gate function可以达到不同效果

- LSTM

RNN学习(二) 一些常见的RNN

最新推荐文章于 2022-08-07 18:33:48 发布

1029

1029

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?