h-swish激活函数出自MobileNetV3论文(论文链接:https://arxiv.org/abs/1905.02244),该激活函数为了近似swish激活函数。swish激活函数具有:无上界、有下界、平滑、非单调等特点,可使神经网络层具有更丰富的表现能力。但swish函数有个缺点,计算量比较大,其函数表达式如下:

![[公式]](https://img-blog.csdnimg.cn/ba252fbc5467490b8ccdd93016f08c93.png)

式中贝塔为可训练参数。

为了适应轻量级网络使用,MobileNetV3作者提出了h-swish函数,该函数使用常见的算子组合而成,因此几乎所有框架都可实现,且在对效果影响不大的条件下使得计算量大大降低,h-swish函数如下:

![[公式]](https://img-blog.csdnimg.cn/d2b36dcfe3394f0aa456049fe516b0d4.png)

两者函数图像如下:

def relu6(inputs):

return tf.minimum(tf.maximum(inputs,0),6)

def h_swish(inputs):

relu6_ = tf.multiply(relu6(inputs+3)/6,inputs)

return relu6_

z = np.linspace(-10,10,50)

from matplotlib import pyplot as plt

plt.plot(h_swish(z),color = 'r')

plt.plot(tf.multiply(tf.sigmoid(z),z), '--', color = 'g')

plt.legend(['h_swish','swish'])

plt.show()

下面定义一个网络residual_model,使用h-swish作为激活函数:

def residual_block(inputs,n_neurons):

x = keras.layers.Dense(n_neurons, kernel_initializer="he_normal")(inputs)

x = h_swish(x)

return tf.add(inputs,x)

def residual_model(num):

inputs = keras.layers.Input(shape=(6,))

x = inputs

for i in range(num):

x = residual_block(x,6)

outputs = keras.layers.Dense(1)(x)

model = tf.keras.Model(inputs=inputs,outputs=outputs)

return model

def relu6(inputs):

return tf.minimum(tf.maximum(inputs,0),6)

def h_swish(inputs):

relu6_ = tf.multiply(relu6(inputs+3)/6,inputs)

return relu6_

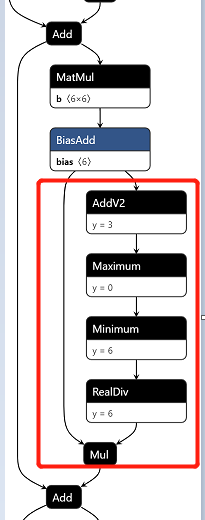

residual_model定义了一个比较简单的具有残差结构的网络,残差结构有三层,其中的s-wish函数 部分转化为静态图后如下所示:

图中红框标出的就是h-swish函数部分。

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?