大家好!今天我要向大家介绍一个超级有趣的话题——FLUX全生态!这个工具能够让你轻松实现文生图、高清放大、图生图、局部重绘等功能,让你的创作更加有趣和独特。

想象一下,你有一个强大的AI助手,它能够根据你的文字描述生成出令人惊叹的图像,或者将你的低分辨率图片放大成高清图像,甚至能够根据你的图片生成新的图片,或者对图片的局部进行重绘。无论是创作新的艺术作品,还是修复老照片,FLUX都能够轻松实现。

而且,FLUX的效果简直无敌!无论是图像的清晰度、细节的处理还是整体的艺术效果,都能够让你惊叹不已。如果你对这个工具的效果有任何质疑,那么请大胆尝试,它会让你眼前一亮!

此外,FLUX还提供了一套完整的教程,让你能够轻松掌握这些功能的技巧。无论是新手还是专业人士,都能够通过这套教程快速上手,创作出令人惊叹的图像作品。

所以,如果你对AI图像生成充满好奇,或者想要让你的创作更加独特和吸引人,那就赶紧试试FLUX吧!它将会给你带来无尽的惊喜和乐趣!

当然,不是说对显存要求不够就不能用FLUX了,今天这篇笔记将会介绍一个东西来降低FLUX在电脑上的使用门槛,这个东西叫做量化模型。

简单来说量化是一种以损失少量精度为前提对模型进行压缩的手段,这样就可以降低模型的计算量。

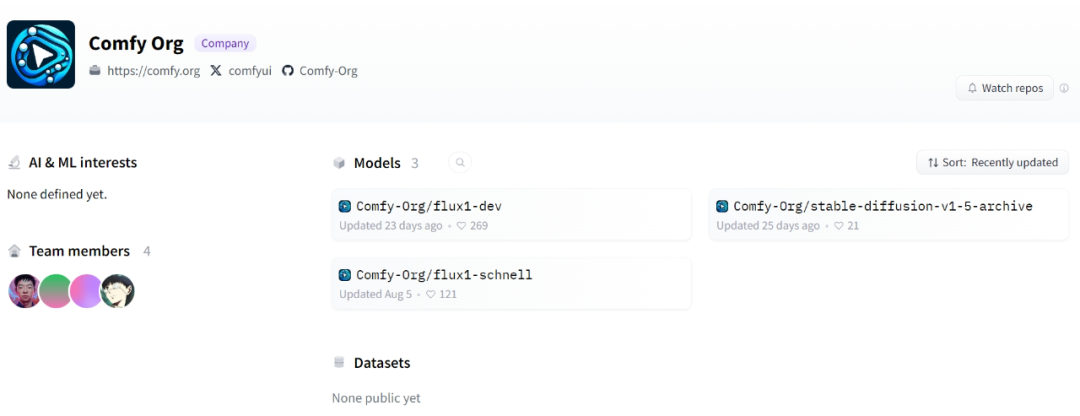

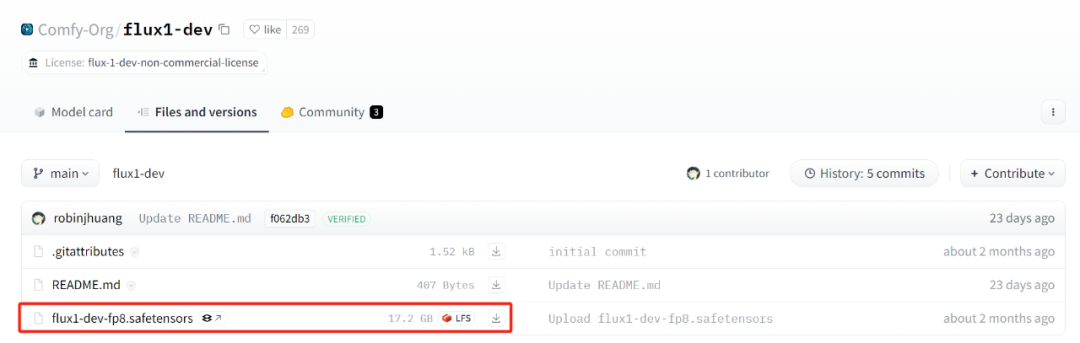

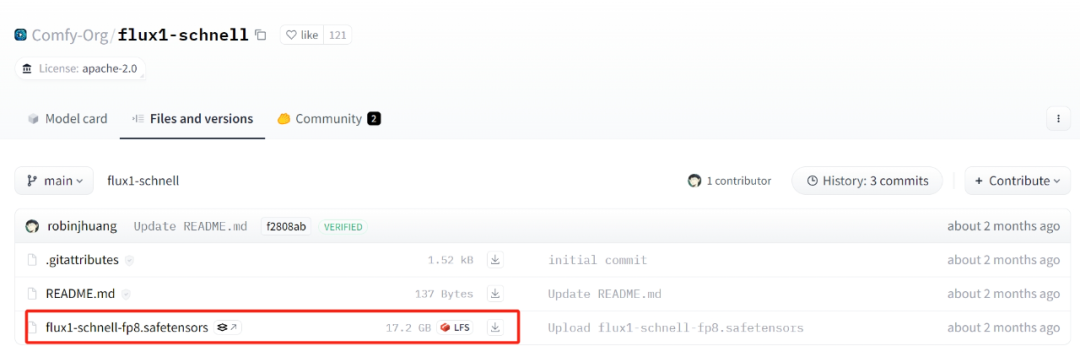

原版FLUX的模型精度是fp16,而ComfyUI的开发团队ComfyOrg针对FLUX开源的两款模型制作出了fp8的量化版本。

https://huggingface.co/Comfy-Org

这也很大程度上降低了FLUX对设备条件的要求。

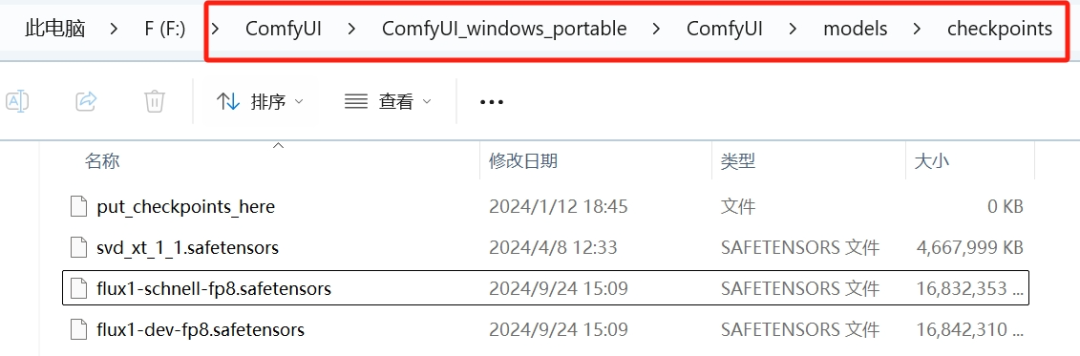

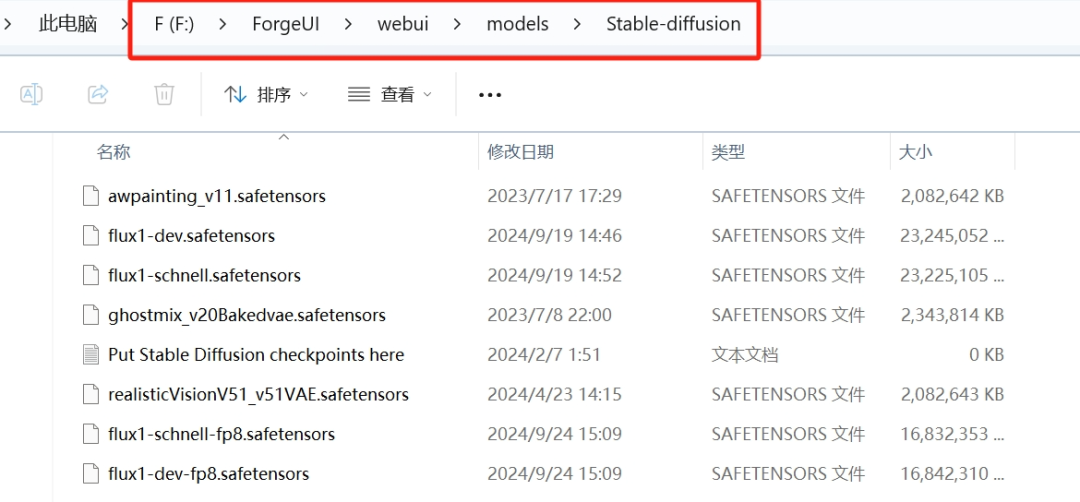

放置文件的位置和之前的有些不同,如果是ComfyUI就放在这个路径:

ComfyUI(根目录)/models/checkpoints

如果是ForgeUI的话就放在这个路径:

**WebUI(根目录)/models/stable-diffusion

**

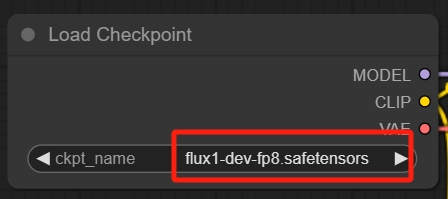

这个模型最大的特点在于可以使用ComfyUI自带的Checkpoint加载器进行加载,当然开发者们也提供了这个fp8版本的标准工作流,只不过这个工作流和之前提到的是一样的。

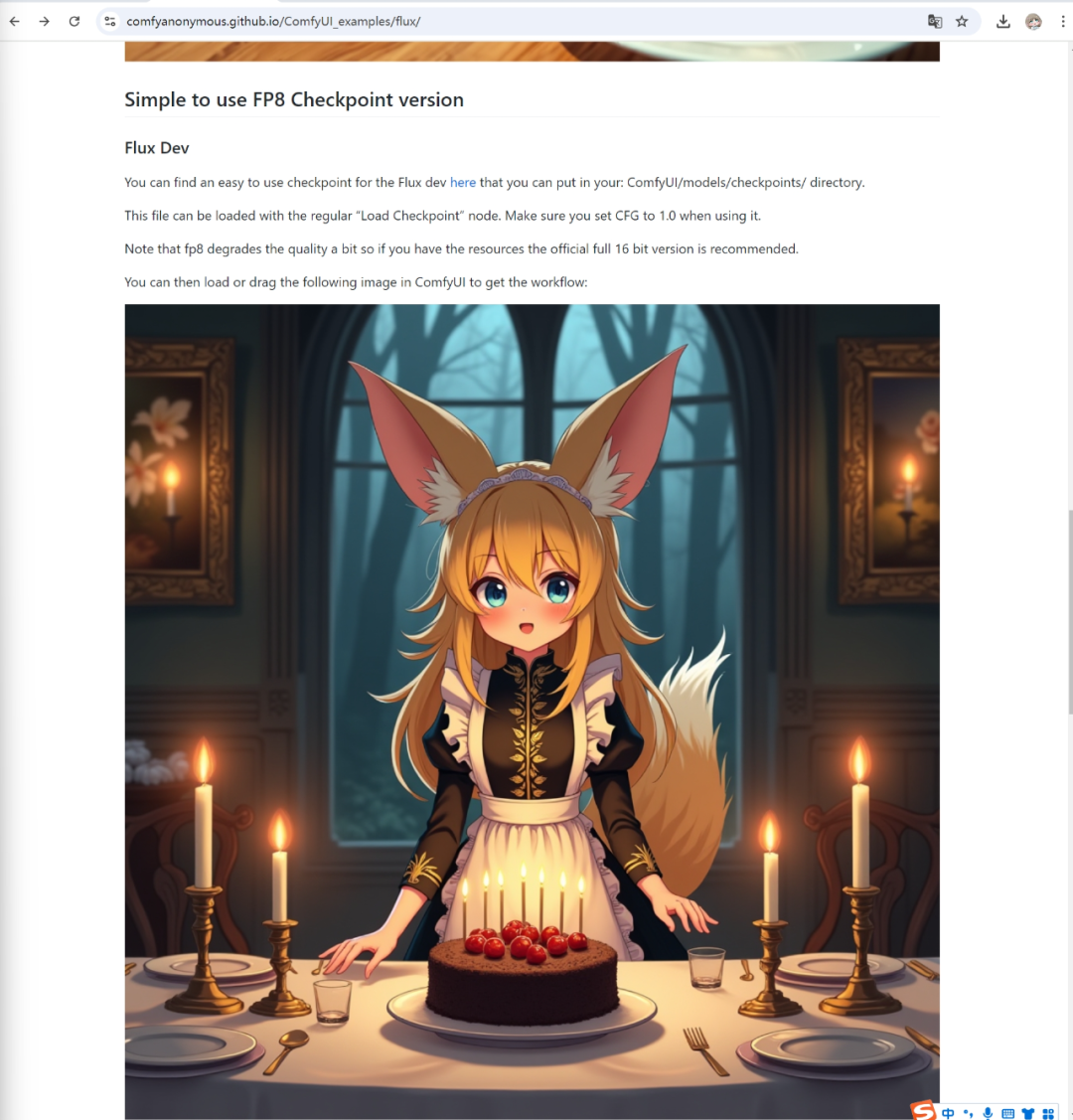

所以只需要去到这个网址将想要的工作流对应的图片拖拽进ComfyUI即可,这里我演示选择的是FP8版本的Flux Dev工作流:

https://comfyanonymous.github.io/ComfyUI_examples/flux/

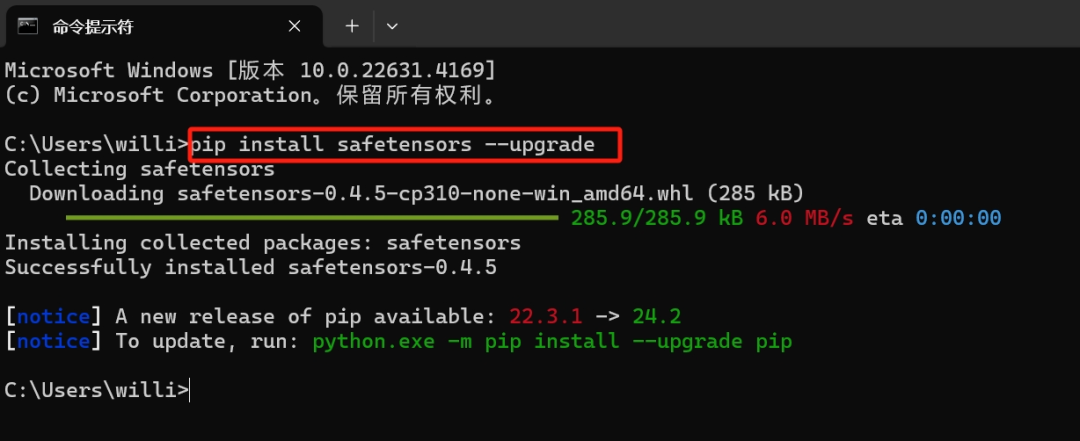

这就是一个标准的文生图流程,操作也很简单,在最左侧的Load Checkpoint这里加载好fp8模型。

然后在文本编码器中输入任意提示词,也可以抄我下面这段:

1girl,wearing sexy maid dress, good hand,4k, high-res, masterpiece, best quality, head:1.3, finely detailed skin, sharp focus, soft lighting, dynamic angle, medium breasts, holding a paper showing words “FLUX FP8”

然后就可以点击最右侧的Queue Prompt进行图片的生成了。

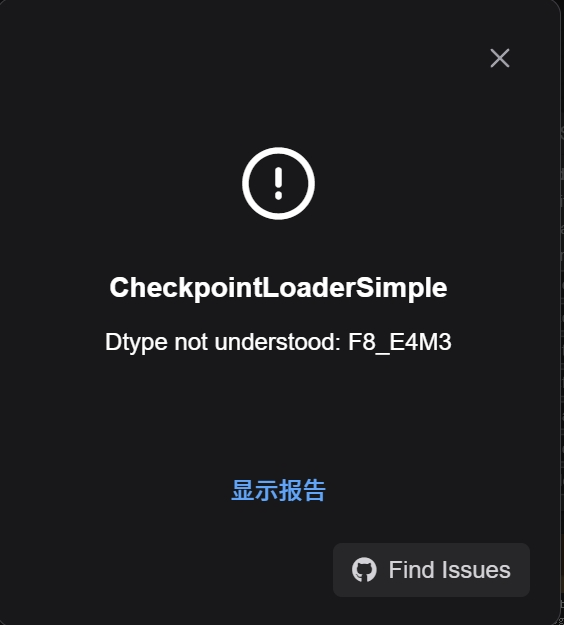

可能有小伙伴在生成图片的过程中遇到了这样一个问题:

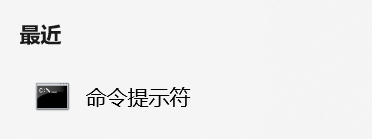

这里目前有两个解决方式,一个先关掉整个ComfyUI,然后搜索命令提示符:

打开后输入这行代码:pip install safetensors --upgrade

然后按回车运行

之后再重启ComfyUI

另一个方法则是将下载的两个fp8模型都删除掉重新安装。

当然有些时候就很奇怪,可能fp8运行不了但是fp16能够运行,这一点我暂时也不是很清楚。

比起fp16模型,fp8模型的生成图片时间能节省约一半,并且能降低大概5-6GB的显存占用,还能节约大概7个G的存储空间,这一点对于一些硬件条件有限的小伙伴来说无疑是很好的一点。

因为fp8模型可以使用checkpoint模型加载器进行加载,所以这个可以很丝滑地结合到其他的工作流中,例如局部重绘。

这个连线看起来好像有点复杂其实不难,感兴趣的小伙伴可以看原教程视频的11:35秒处。

至于如何用ComfyUI来进行重绘可以看我之前写过的一篇笔记

把裤袜换成黑丝(Stable Diffusion进阶篇: ComfyUI 局部重绘)

如果在经历了上述的优化手段之后电脑运行起来还是有点吃力的话,可以尝试一下第一篇笔记中推荐的线上平台,毕竟如果跑不动硬跑的话可能会对电脑造成一些损伤。

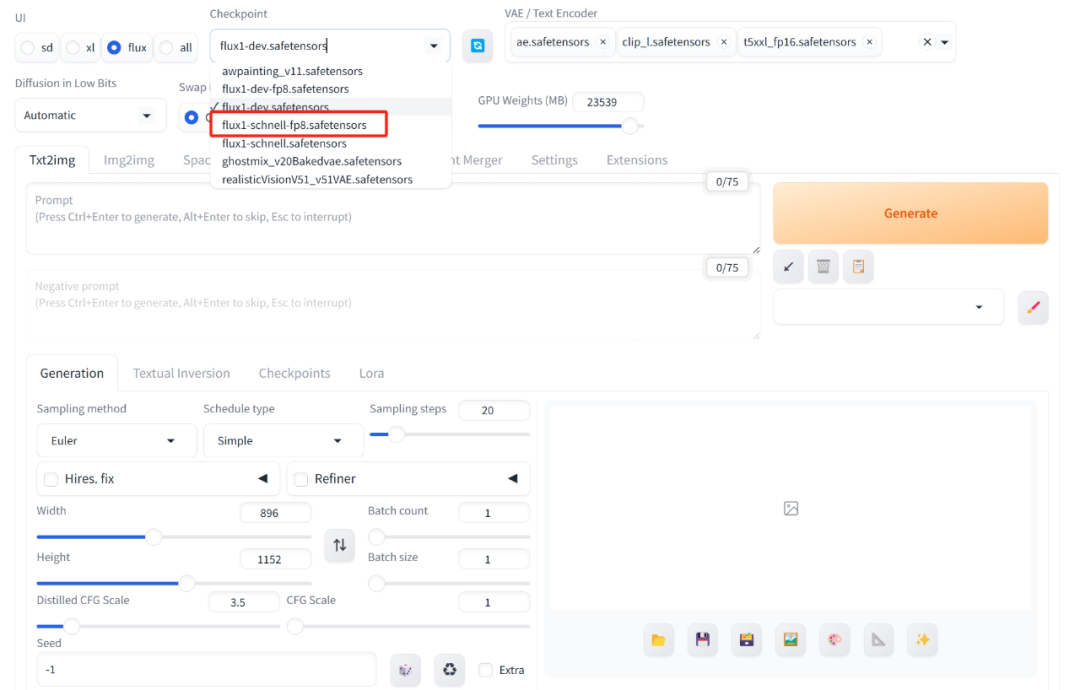

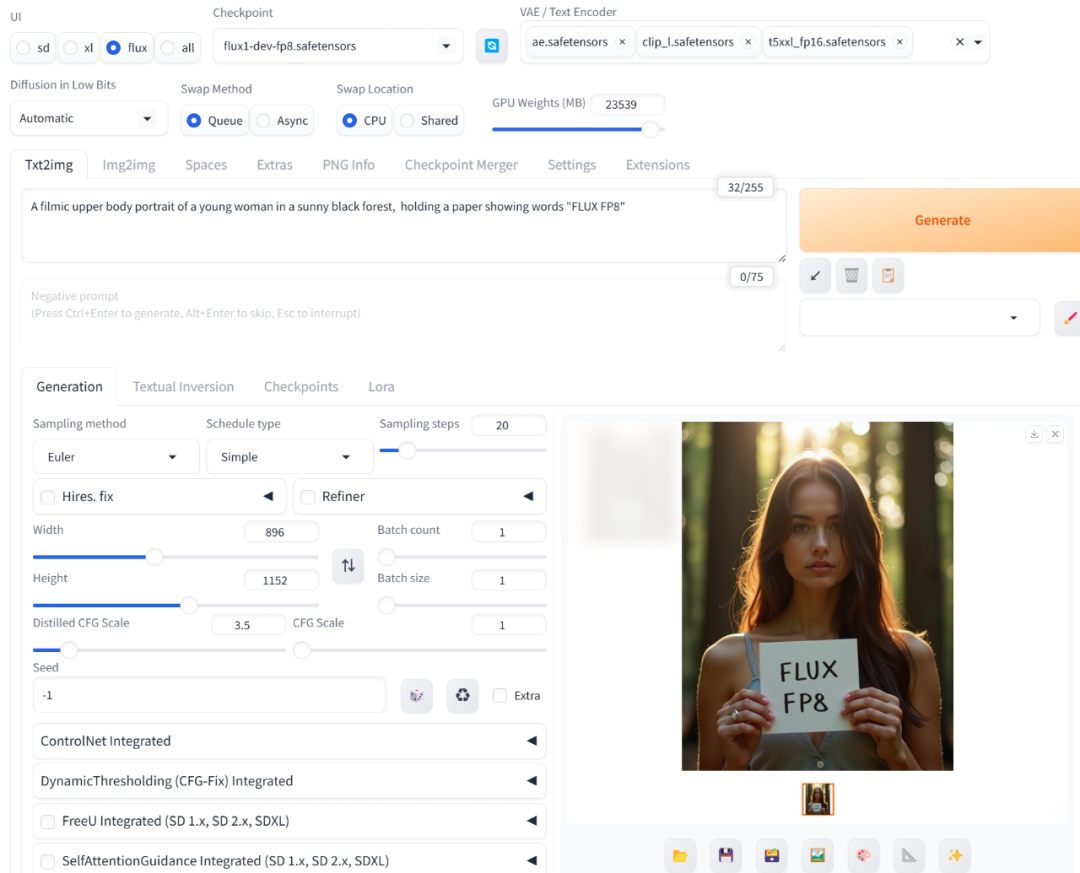

不只是在ComfyUI,ForgeUI中也可以进行调用并加载。

用法也很简单,直接在Checkpoint这里改为fp8模型即可。

出图的速度还是很快,但是由于计算精度下降了,理论上fp8的模型比起fp16的模型出图质量有所下降。

不过就这样肉眼看来好像没有很大区别,条件允许的话还是推荐fp16完整版本。

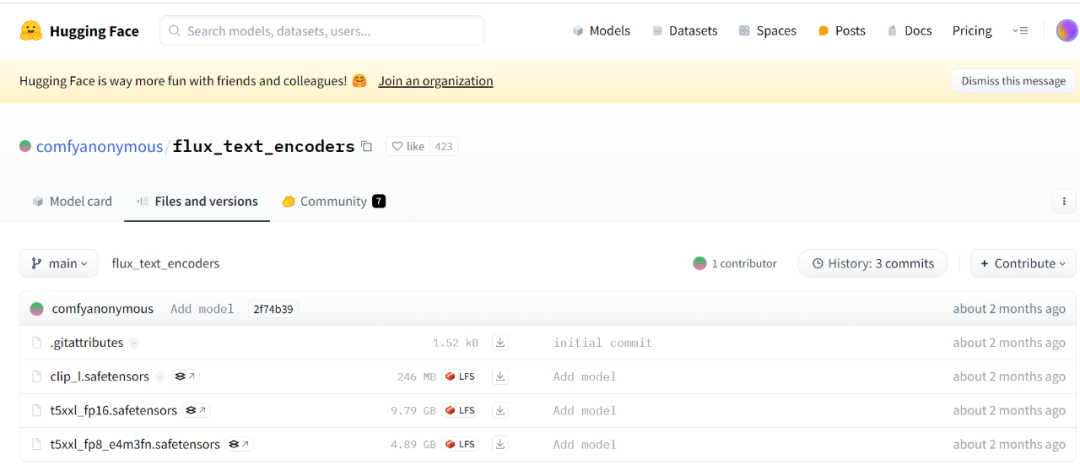

还有些小伙伴可能是显卡显存足够,但是内存不够,那可以使用ComfyOrg优化过的T5XXL文本编码器。

https://huggingface.co/comfyanonymous/flux_text_encoders/tree/main

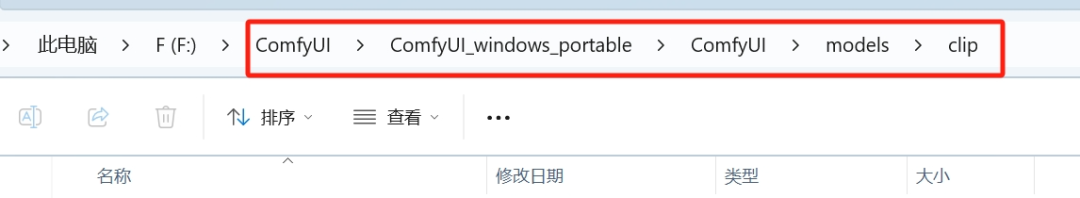

内存不够的话选择那个fp8版本,然后ComfyUI放置在这个路径:

ComfyUI(根目录)/models/clip

ForgeUI的话放在这个路径:

WebUI(根目录)/models/text_encoder

这个加载器可以帮助降低内存要求,从64G降低到32G,但是会略微影响语义的理解能力。

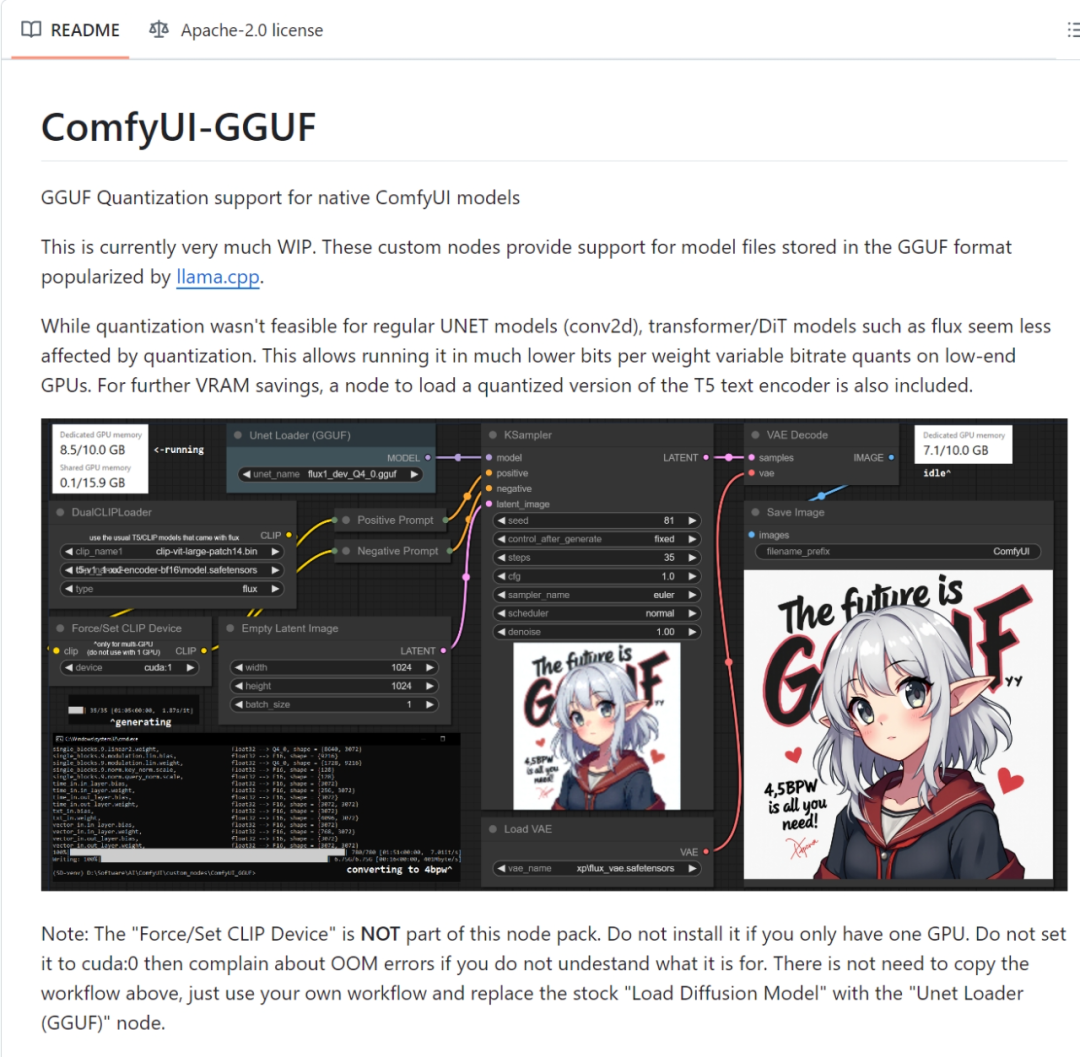

当然社区里还有其他用于降低设备要求或者优化的方法,例如张博士提供的NF4量化模型和特殊的GGUP格式模型等

https://github.com/lllyasviel/stable-diffusion-webui-forge/discussions/981

https://github.com/city96/ComfyUI-GGUF

感兴趣的小伙伴可以根据链接自行下载体验。

今天的内容就到这里啦!

更新慢的其中一个原因是因为使用ComfyUI出图对我来说是一个解决报错的过程,总是时不时出现一些很怪的问题导致我得一直去翻社区找解决方法。

希望今天这篇笔记可以帮助到硬件条件没那么好的同学,下篇笔记就是FLUX最后一篇关于LoRA模型部分。

资料软件免费放送

次日同一发放请耐心等待

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

感兴趣的小伙伴,赠送全套AIGC学习资料和安装工具,包含AI绘画、AI人工智能等前沿科技教程,模型插件,具体看下方。

需要的可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

**一、AIGC所有方向的学习路线**

AIGC所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、AIGC必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新AIGC学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

这份完整版的学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

2625

2625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?