机器人在抓取的过程中,要对深度相机拍摄的点云图进行一些处理,才能分割出待抓取物体

因此本项目采用的是基于DGCNN的点云分割方案。

DGCNN

DGCNN的全称叫做:Dynamic Graph CNN for Learning on Point Clouds

论文地址在这里:

https://arxiv.org/pdf/1801.07829.pdf

源码可以看这个:

https://gitee.com/cleo1999/dgcnn.pytorch/tree/master

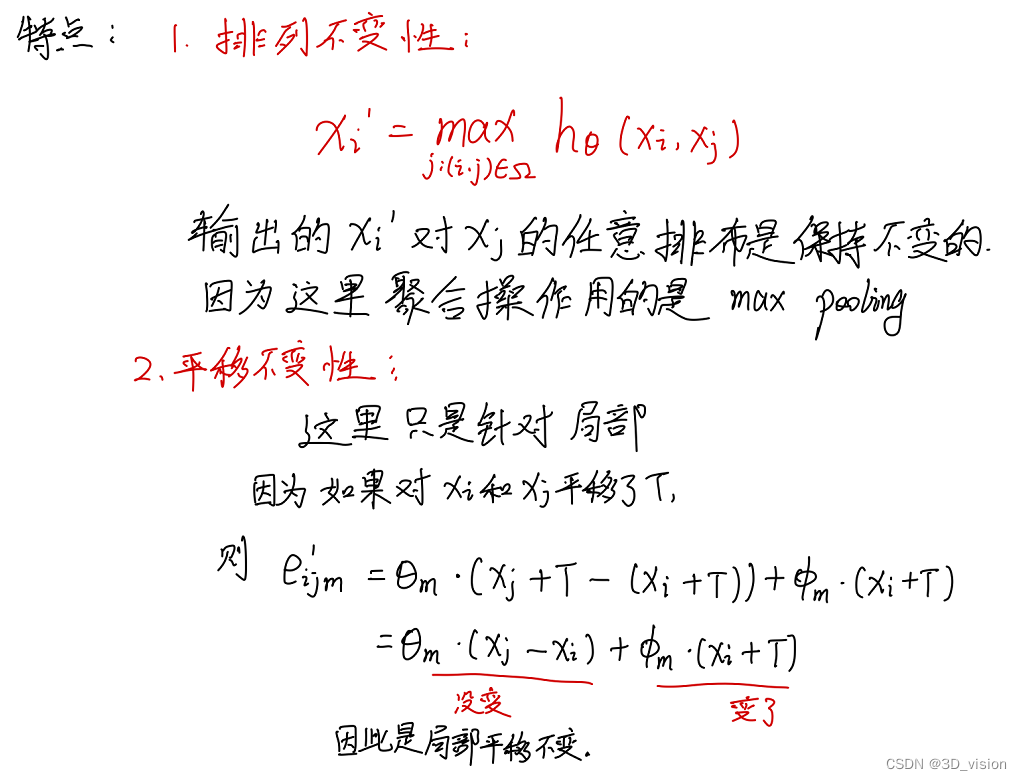

因为本项目只用DGCNN进行点云分割,所以这里只介绍一下DGCNN的点云特征提取和分割方面的,分类相关的就不介绍了。大同小异。

DGCNN的功能类似于PointNet,都是用公开数据集进行点云分类和分割。

论文主要的贡献

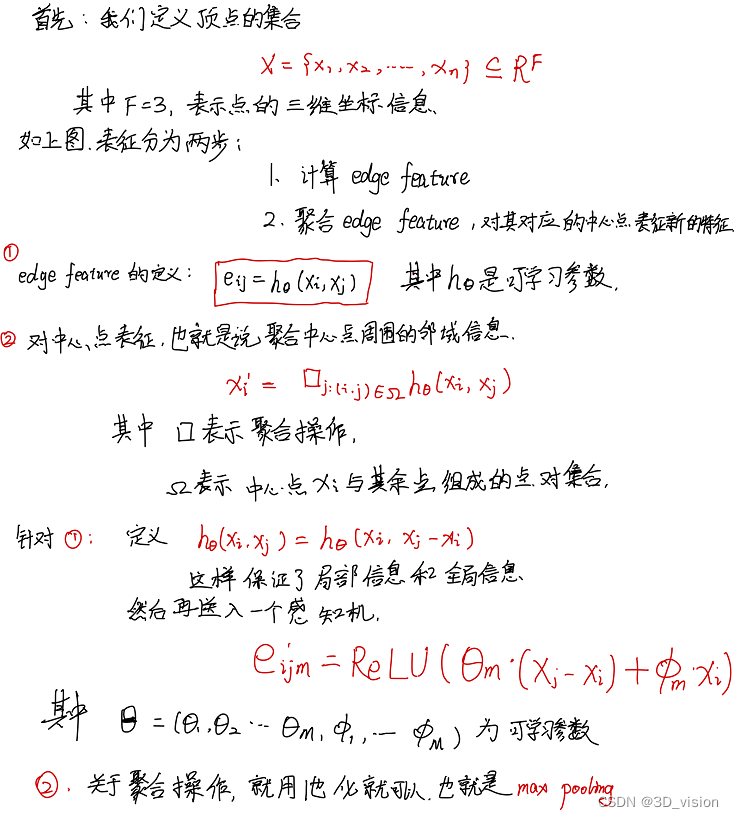

1、设计了EdgeConv,能够非常好地提取点云局部形状的特征,同时还能够保持排列不变性。

2、模型能够通过动态更新层与层之间的图结构来更好地学习点集的语义信息。

3、EdgeConv具有普适性,可以很好地集成到多个已经存在的点云处理的pipeline中。

点云特征提取

这篇文章的两点就在于提出了EdgeConv边卷积模块。

点云这种数据结构是离散的,缺乏拓扑信息(点与点之间的关联并没有显式建立),因此作者提出了EdgeConv模块来通过某种方式建立点与点之间的拓朴关系,增强表征能力。

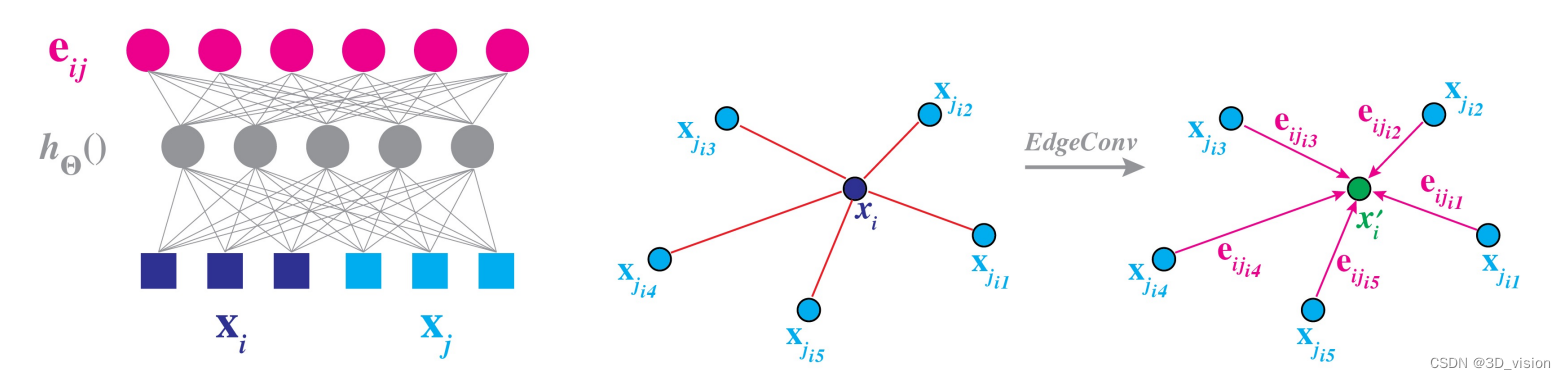

EdgeConv在网络的每一层上动态构建图结构,将每一点作为中心点来表征其与各个邻点的edge feature,再将这些特征聚合从而获得该点的新表征。

EdgeConv实现的实际就是通过构建局部邻域(这种局部邻域既可以建立在坐标空间,也可以建立在特征空间),对每个点表征。

具体看一下EdgeConv的结构:

图结构的动态更新

原文中说不断重新计算各个点在每一层特征空间的近邻,我理解的是每经过一层都进行一次点的特征的更新

特点

网络总体结构

这里的spatial transform其实就是point net中使用到的T-Net(对点云模型做一个矫正),使他具有空间变换不变性。

这里的spatial transform其实就是point net中使用到的T-Net(对点云模型做一个矫正),使他具有空间变换不变性。

ps:如果网络能够对经过平移、旋转、缩放及裁剪等操作的图片得到与未经变换前相同的检测结果,我们就说这个网络具有空间变换不变性(将平移、旋转、缩放及裁剪不变性统称为空间不变性)。

1462

1462

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?