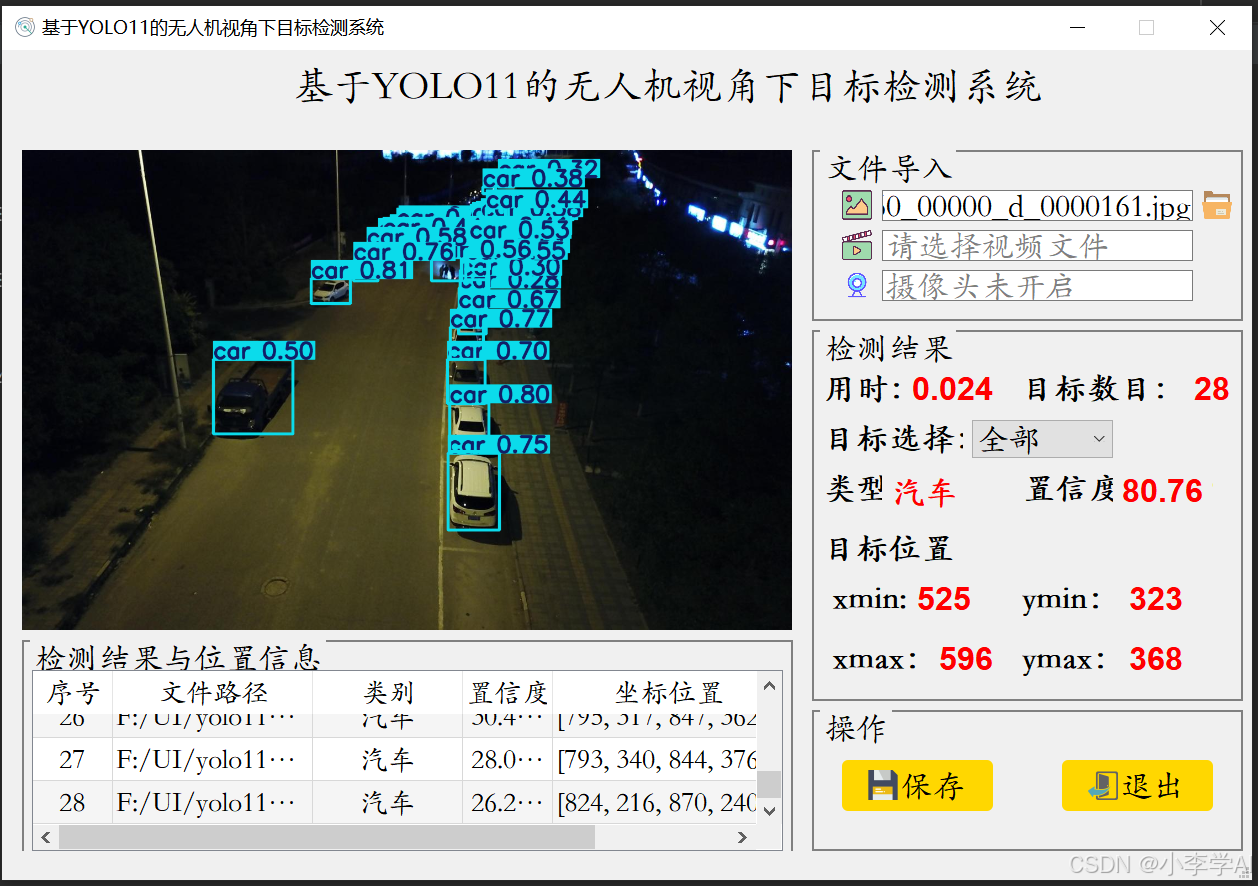

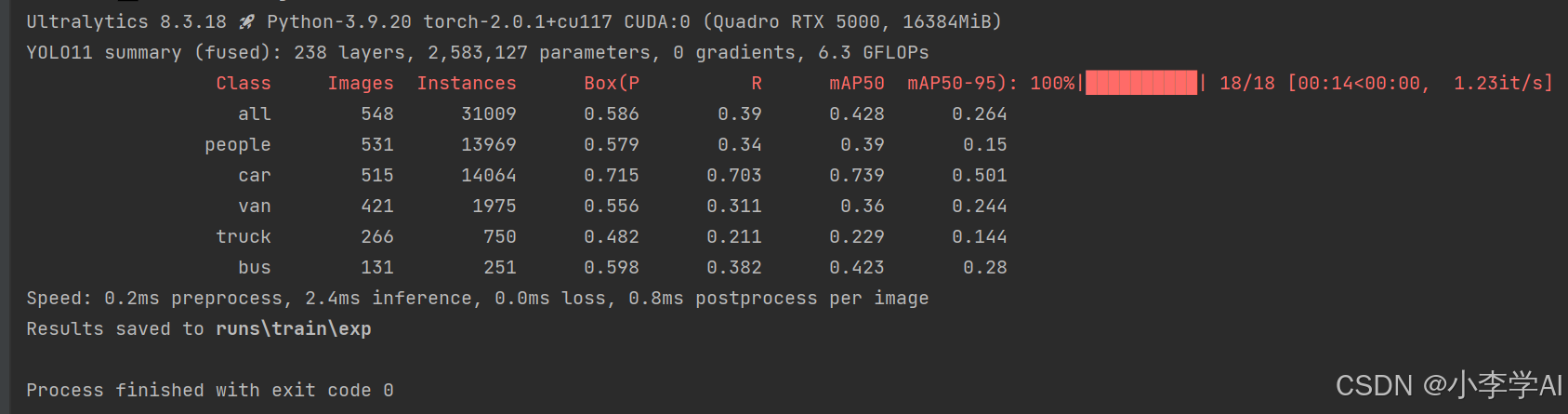

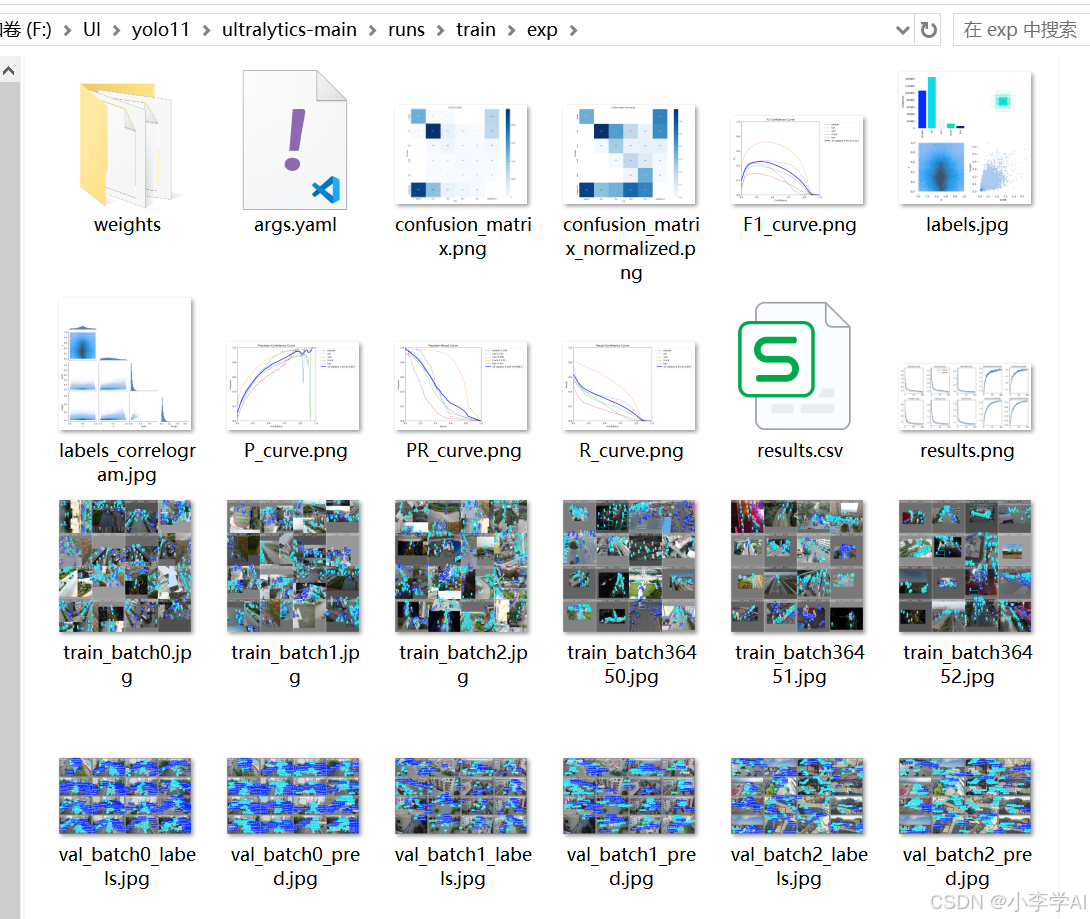

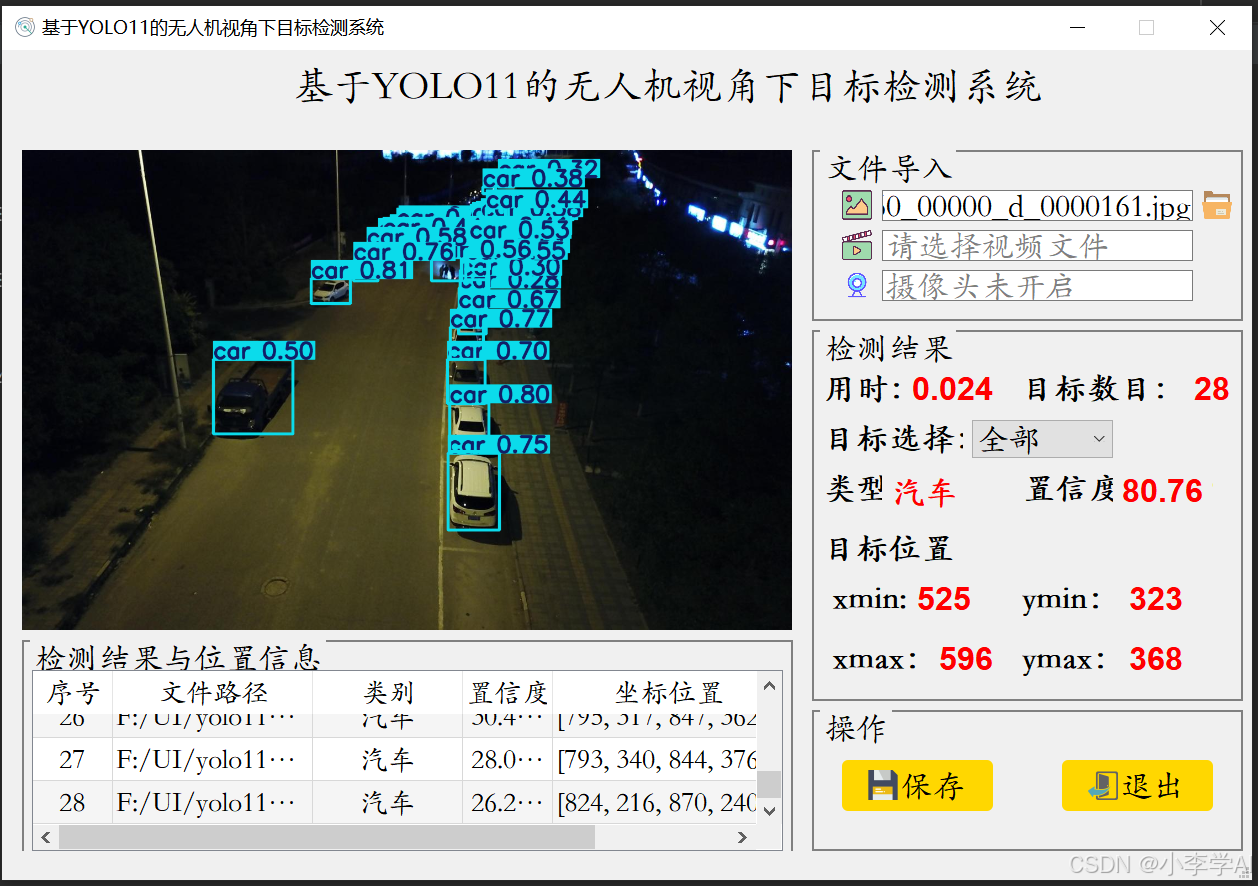

基于YOLO11的无人机视角下目标检测系统 (价格95)

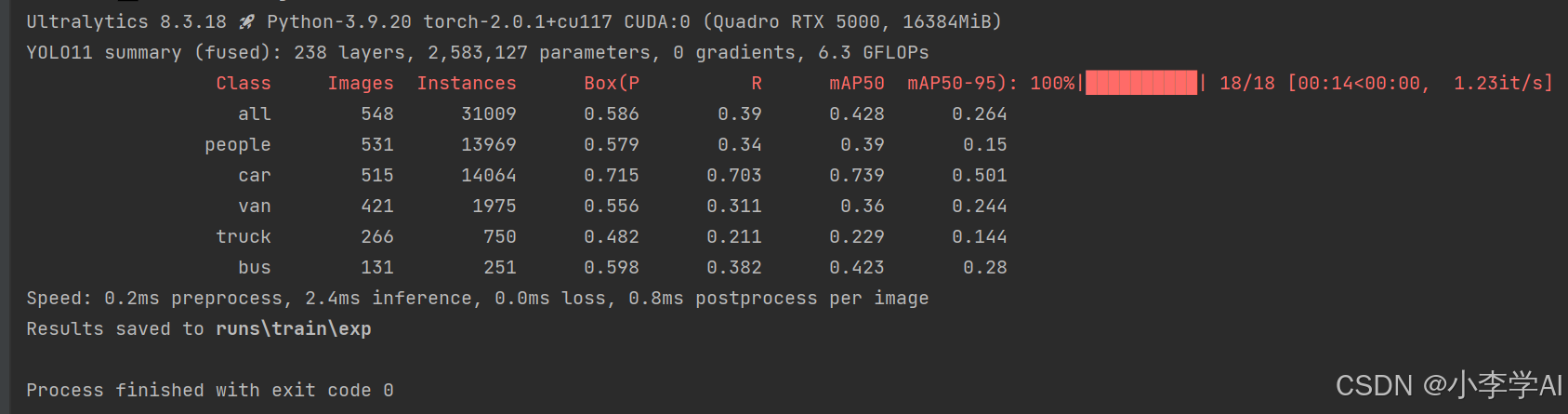

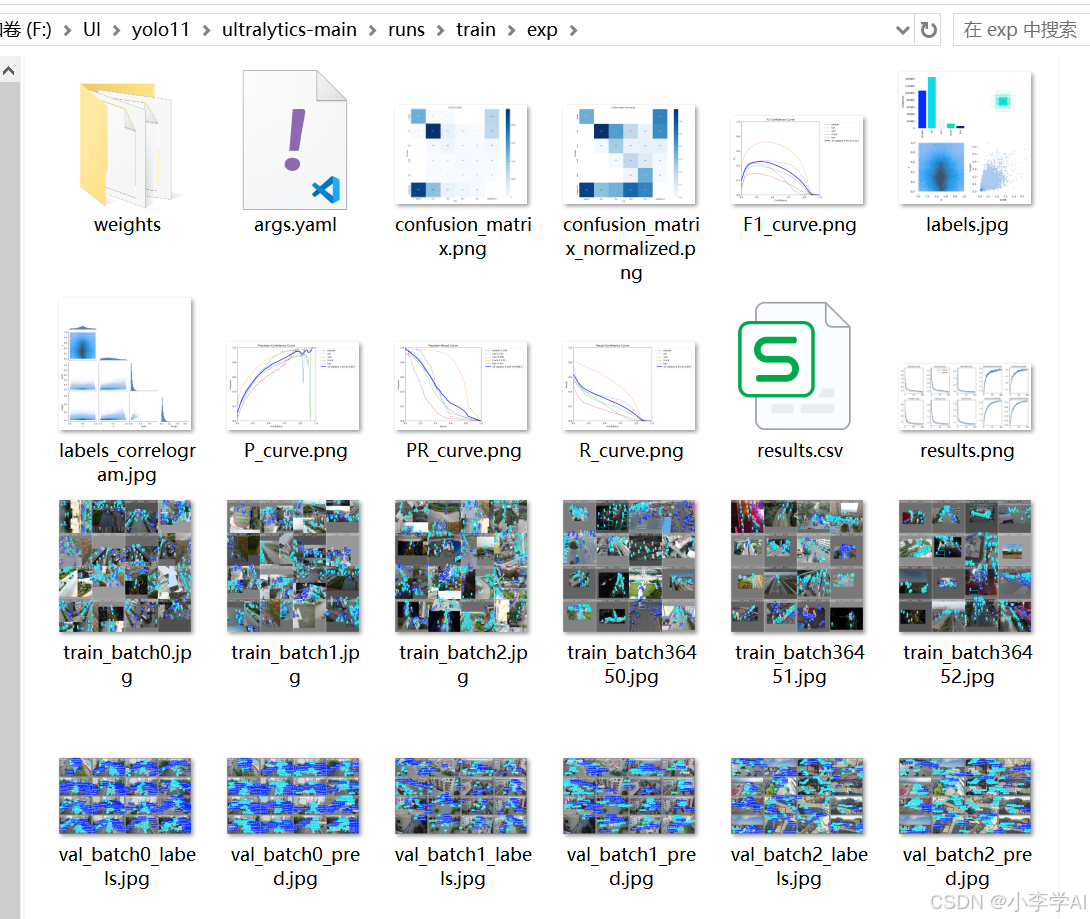

包含 ['人', '汽车', '货车', '卡车', '公共汽车'] 5个类

通过PYQT构建UI界面,包含图片检测,视频检测,摄像头实时检测。

(该系统可以根据数据训练出的yolo11的权重文件,运用在其他检测系统上,如火焰检测,口罩检测等等,可以根据检测目标更改UI界面。)

————————————————

基于YOLO11的无人机视角下目标检测系统 (价格95)

包含 ['人', '汽车', '货车', '卡车', '公共汽车'] 5个类

通过PYQT构建UI界面,包含图片检测,视频检测,摄像头实时检测。

(该系统可以根据数据训练出的yolo11的权重文件,运用在其他检测系统上,如火焰检测,口罩检测等等,可以根据检测目标更改UI界面。)

————————————————

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?