基于核极限学习机(KELM)分类

摘要:本文利用核极限学习机进行优化,并用于分类

1.极限学习机原理概述

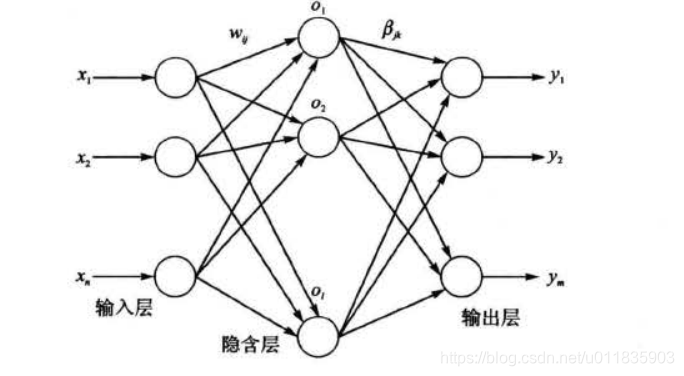

典型的单隐含层前馈神经网络结构如图1 所示,由输入层、隐含层和输出层组成,输 入层与隐含层、隐含层与输出层神经元间全连接。其中,输入层有 n 个神经元,对应 n 个输入变量, 隐含层有 l个神经元;输出层有 m 个神经元 ,对应 m 个输出变量 。 为不失一般性,设输 入层与隐含层间的连接权值 w 为:

w

=

[

w

11

w

12

.

.

.

w

1

,

n

w

21

w

22

.

.

.

w

2

n

.

.

.

w

l

1

w

l

2

.

.

.

w

l

n

]

(1)

w =\left[\begin{matrix}w_{11}&w_{12}&...&w_{1,n}\\ w_{21}&w_{22}&...&w_{2n}\\ ...\\ w_{l1}&w_{l2}&...&w_{ln} \end{matrix}\right]\tag{1}

w=⎣⎢⎢⎡w11w21...wl1w12w22wl2.........w1,nw2nwln⎦⎥⎥⎤(1)

其中,

w

n

w_n

wn表示输入层第

i

i

i个神经元与隐含层第

j

j

j个神经元间的连接权值。

设隐含层与输出层间的连接权值 , 为

β

\beta

β:

β

=

[

β

11

β

12

.

.

.

β

1

m

β

21

β

22

.

.

.

β

2

m

.

.

.

β

l

1

β

l

2

.

.

.

β

l

m

]

(2)

\beta =\left[\begin{matrix} \beta_{11}&\beta_{12}&...&\beta_{1m}\\ \beta_{21}&\beta_{22}&...&\beta_{2m}\\ ...\\ \beta_{l1}&\beta_{l2}&...&\beta_{lm} \end{matrix}\right] \tag{2}

β=⎣⎢⎢⎡β11β21...βl1β12β22βl2.........β1mβ2mβlm⎦⎥⎥⎤(2)

其中,自

β

j

k

\beta_{jk}

βjk表示隐含层第 j 个神经元与输出层第 k个神经元间的连接权值。

设隐含层神经元的阈值值 b 为:

b

=

[

b

1

b

2

.

.

.

b

l

]

(3)

b =\left[\begin{matrix}b_1\\ b_2\\ ...\\ b_l \end{matrix}\right]\tag{3}

b=⎣⎢⎢⎡b1b2...bl⎦⎥⎥⎤(3)

设具有 Q 个样本的训练集输入矩阵 X 和输出矩阵 Y 分别为

X

=

[

x

11

x

12

.

.

.

x

1

Q

x

21

x

22

.

.

.

x

2

Q

.

.

.

x

n

1

x

n

2

.

.

.

x

n

Q

]

(4)

X =\left[\begin{matrix}x_{11}&x_{12}&...&x_{1Q}\\ x_{21}&x_{22}&...&x_{2Q}\\ ...\\ x_{n1}&x_{n2}&...&x_{nQ} \end{matrix}\right]\tag{4}

X=⎣⎢⎢⎡x11x21...xn1x12x22xn2.........x1Qx2QxnQ⎦⎥⎥⎤(4)

KaTeX parse error: Undefined control sequence: \matrix at position 11: Y =\left[\̲m̲a̲t̲r̲i̲x̲{y_{11},y_{12},…

设隐含层神经元的激活函数为 g(x),则由图1 可得, 网络的输出 T 为:

T

=

[

t

1

,

.

.

,

t

Q

]

m

∗

Q

,

t

j

=

[

t

1

j

,

.

.

.

,

t

m

j

]

T

=

[

∑

i

=

1

t

β

i

1

g

(

w

i

x

j

+

b

i

)

∑

i

=

1

t

β

i

2

g

(

w

i

x

j

+

b

i

)

.

.

.

∑

i

=

1

t

β

i

m

g

(

w

i

x

j

+

b

i

)

]

m

∗

1

,

(

j

=

1

,

2

,

.

.

.

,

Q

)

(6)

T = [t_1,..,t_Q]_{m*Q},t_j = [t_{1j},...,t_{mj}]^T =\left[\begin{matrix}\sum_{i=1}^t\beta_{i1}g(w_ix_j + b_i)\\ \sum_{i=1}^t\beta_{i2}g(w_ix_j + b_i)\\ ...\\ \sum_{i=1}^t\beta_{im}g(w_ix_j + b_i) \end{matrix}\right]_{m*1},(j=1,2,...,Q)\tag{6}

T=[t1,..,tQ]m∗Q,tj=[t1j,...,tmj]T=⎣⎢⎢⎡∑i=1tβi1g(wixj+bi)∑i=1tβi2g(wixj+bi)...∑i=1tβimg(wixj+bi)⎦⎥⎥⎤m∗1,(j=1,2,...,Q)(6)

式(6)可表示为:

H

β

=

T

’

(7)

H\beta = T’ \tag{7}

Hβ=T’(7)

其中, T’为矩阵 T 的转置; H 称为神经网络的隐含层输出矩阵 , 具体形式如下 :

H

(

w

1

,

.

.

.

,

w

i

,

b

1

,

.

.

.

,

b

l

,

x

1

,

.

.

.

,

x

Q

)

=

[

g

(

w

1

∗

x

1

+

b

1

)

g

(

w

2

∗

x

1

+

b

2

)

.

.

.

g

(

w

l

∗

x

1

+

b

l

)

g

(

w

1

∗

x

2

+

b

1

)

g

(

w

2

∗

x

2

+

b

2

)

.

.

.

g

(

w

l

∗

x

2

+

b

l

)

.

.

.

g

(

w

1

∗

x

Q

+

b

1

)

g

(

w

2

∗

x

Q

+

b

2

)

.

.

.

g

(

w

l

∗

x

Q

+

b

l

)

]

Q

∗

l

(8)

H(w_1,...,w_i,b_1,...,b_l,x_1,...,x_Q) =\left[\begin{matrix} g(w_1*x_1 + b_1)&g(w_2*x_1 + b_2)&...&g(w_l*x_1 + b_l)\\ g(w_1*x_2 + b_1)&g(w_2*x_2 + b_2)&...&g(w_l*x_2 + b_l)\\ ...\\ g(w_1*x_Q + b_1)&g(w_2*x_Q + b_2)&...&g(w_l*x_Q + b_l) \end{matrix}\right]_{Q*l}\tag{8}

H(w1,...,wi,b1,...,bl,x1,...,xQ)=⎣⎢⎢⎡g(w1∗x1+b1)g(w1∗x2+b1)...g(w1∗xQ+b1)g(w2∗x1+b2)g(w2∗x2+b2)g(w2∗xQ+b2).........g(wl∗x1+bl)g(wl∗x2+bl)g(wl∗xQ+bl)⎦⎥⎥⎤Q∗l(8)

2.ELM学习算法

由前文分析可知,ELM在训练之前可以随机产生 w 和 b , 只需确定隐含层神经元个数及隐含层和神经元的激活函数(无限可微) , 即可计算出 β \beta β 。具体地, ELM 的学习算法主要有以下几个步骤:

(1)确定隐含层神经元个数,随机设定输入层与隐含层间的连接权值 w 和隐含层神经元的偏置 b ;

(2) 选择一个无限可微的函数作为隐含层神经元的激活函数,进而计算隐含层输出矩 阵 H ;

(3)计算输出层权值: β = H + T ′ \beta = H^+T' β=H+T′

值得一提的是,相关研究结果表明,在 ELM 中不仅许多非线性激活函数都可以使用(如 S 型函数、正弦函数和复合函数等),还可以使用不可微函数,甚至可以使用不连续的函数作为激活函数。

3.KELM理论基础

核极限学习机(Kernel Based Extreme Learning Machine,KELM)是基于极限学习机(Extreme Learning Machine,ELM)并结合核函数所提出的改进算法,KELM 能够在保留 ELM 优点的基础上提高模型的预测性能。

ELM 是一种单隐含层前馈神经网络,其学习目标函数F(x) 可用矩阵表示为:

F

(

x

)

=

h

(

x

)

×

β

=

H

×

β

=

L

(9)

F(x)=h(x)\times \beta=H\times\beta=L \tag{9}

F(x)=h(x)×β=H×β=L(9)

式中:

x

x

x 为输入向量,

h

(

x

)

h(x)

h(x)、

H

H

H 为隐层节点输出,

β

β

β 为输出权重,

L

L

L 为期望输出。

将网络训练变为线性系统求解的问题,

β

\beta

β根据

β

=

H

∗

⋅

L

β=H * ·L

β=H∗⋅L 确定,其中,

H

∗

H^*

H∗ 为

H

H

H 的广义逆矩阵。为增强神经网络的稳定性,引入正则化系数

C

C

C 和单位矩阵

I

I

I,则输出权值的最小二乘解为

β

=

H

T

(

H

H

T

+

I

c

)

−

1

L

(10)

\beta = H^T(HH^T+\frac{I}{c})^{-1}L\tag{10}

β=HT(HHT+cI)−1L(10)

引入核函数到 ELM 中,核矩阵为:

Ω

E

L

M

=

H

H

T

=

h

(

x

i

)

h

(

x

j

)

=

K

(

x

i

,

x

j

)

(11)

\Omega_{ELM}=HH^T=h(x_i)h(x_j)=K(x_i,x_j)\tag{11}

ΩELM=HHT=h(xi)h(xj)=K(xi,xj)(11)

式中:

x

i

x_i

xi ,

x

j

x_j

xj 为试验输入向量,则可将式(9)表达为:

F

(

x

)

=

[

K

(

x

,

x

1

)

;

.

.

.

;

K

(

x

,

x

n

)

]

(

I

C

+

Ω

E

L

M

)

−

1

L

(12)

F(x)=[K(x,x_1);...;K(x,x_n)](\frac{I}{C}+\Omega_{ELM})^{-1}L \tag{12}

F(x)=[K(x,x1);...;K(x,xn)](CI+ΩELM)−1L(12)

式中:

(

x

1

,

x

2

,

…

,

x

n

)

(x_1 , x_2 , …, x_n )

(x1,x2,…,xn) 为给定训练样本,

n

n

n 为样本数量.

K

(

)

K()

K()为核函数。

4.分类问题

本文对乳腺肿瘤数据进行分类。采用随机法产生训练集和测试集,其中训练集包含 500 个样本,测试集包含 69 个样本 。 测试正则化系数 C 和核函数参数 S 分别为2和4,选取核函数为rbf 高斯核函数。

5.测试结果

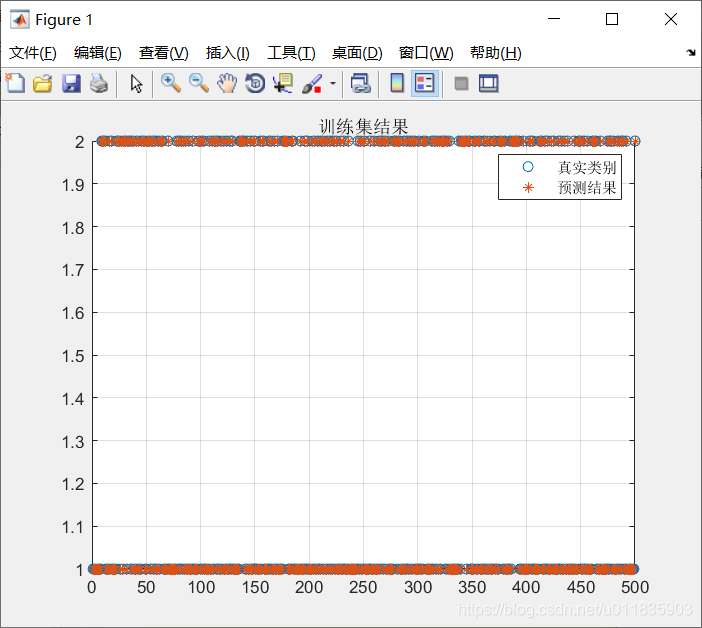

训练集结果如下图所示

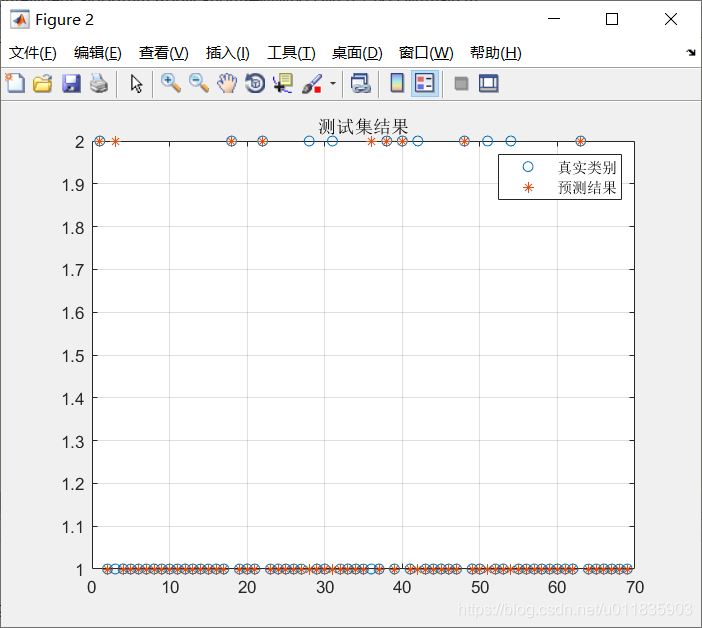

测试集结果如下图所示:

训练集正确率:100%

测试集正确率:89.8551%

病例总数:569 良性:357 恶性:212

训练集病例总数:500 良性:300 恶性:200

测试集病例总数:69 良性:57 恶性:12

良性乳腺肿瘤确诊:55 误诊:2 确诊率p1=96.4912%

恶性乳腺肿瘤确诊:7 误诊:5 确诊率p2=58.3333%

6.Matlab代码

个人资料

1711

1711

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?